====================================================

该API和服务的创建是为了帮助内容创建者获得AI生成的听觉描述,以使他们可以使用这些场景和图像,以使其内容更容易为视力障碍的人使用。

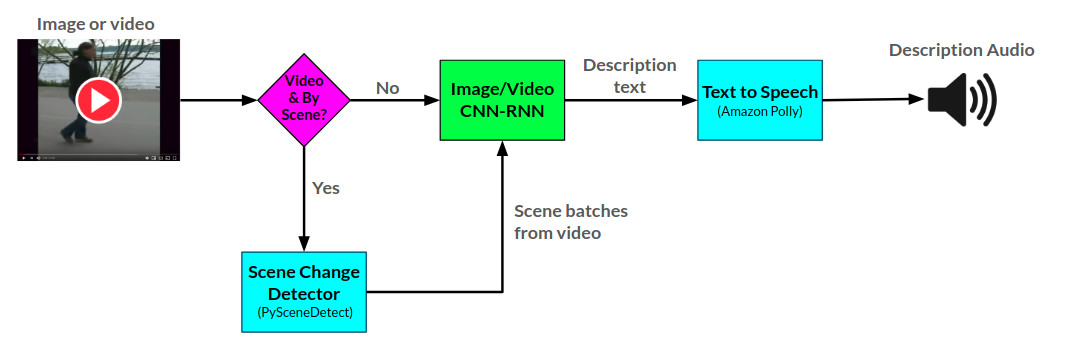

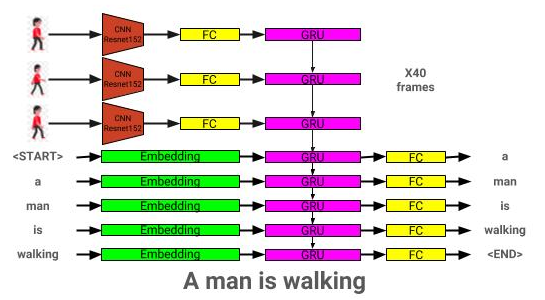

叙述者API使用Pytorch中开发的两个CNN-RNN神经网络为提供的图像和视频生成音频描述:1)基于展示和讲述网络的文本描述网络的图像,以及2)将此网络扩展到文本描述中。视频描述网络还可以用于在视频中每个场景中生成描述。

叙述者的整体弧结可以在这里看到:

图像描述模型体系结构可以在此处看到:

视频说明模型体系结构可以在此处看到:

目前,叙述者以两种方式提供叙述者:1)当前在AWS上托管并通过网站提供的烧瓶Web应用程序,以及2)独立的API:Nornator.py。网站使用的示例可以在网站上看到,并且可以在笔记本/叙述者用法示例中看到使用API的示例。

叙述者API使用Amazon Polly从文本中生成音频描述,并使用Pyscenedect检测视频中的场景更改。

图像描述网络是使用可可2014数据集训练的。

视频描述网络是使用MSR-VTT数据集训练的。

当前最佳的预培训图像描述模型可以从此处下载。

当前最佳的预训练视频说明模型可以从此处下载。

将这些模型放在模型目录中。

├── LICENSE

├── README.md <- The top-level README for developers using this project.

├── data

│ ├── interim <- Intermediate data that has been transformed.

│ ├── processed <- The final, canonical data sets for modeling.

│ └── raw <- The original, immutable data dump.

│

├── models <- Location to store trained models to be used by Narrator

│

├── notebooks <- Example Jupyter notebook + notebooks for validation

│ ├── Narrator-Usage-Examples.ipynb <- Examples of how to use Narrator independently of the web interface

│ ├── Image-Captioner-Validation.ipynb <- Notebook for validating image captioner model

│ ├── Video-Captioner-Validation.ipynb <- Notebook for validating video captioner model

│ └── Data-Analysis.ipynb <- Notebook for analyzing image/data analysis

│

├── results <- Directory to store results

│

├── samples <- Image and video samples to use with Narrator.

│

├── src <- Source code for use in this project.

│ ├── __init__.py <- Makes src a Python module

│ ├── ic_trainer.py <- Module for training image description model

│ ├── ic_validate.py <- Module for evaluating image description model

│ ├── Narrator.py <- Python class for deploying trained image/video description models

│ ├── vc_trainer.py <- Module for training video description model

│ ├── vc_validate.py <- Module for evaluating video description model

│ │

│ ├── models <- Scripts to prepare COCO/MSR-VTT datasets for training

│ │ ├── EncoderCNN.py <-- Pre-trained CNN PyTorch model

│ │ ├── ImageCaptioner.py <- Image Captioner Show-and-tell PyTorch Model

│ │ ├── VideoCaptioner.py <- Video Captioner PyTorch Model

│ │ ├── S2VTCaptioner.py <- S2VT PyTorch PyTorch Model

│ │ ├── YoloObjectDetector.py <- Wrapper for yolo submodule

│ │ └── pytorch-yolo-v3 <- git submodule: https://github.com/ayooshkathuria/pytorch-yolo-v3

│ │

│ ├── prepare <- Scripts to prepare COCO/MSR-VTT datasets for training

│ │ ├── build_coco_vocabulary.py

│ │ ├── build_msrvtt_vocabulary.py

│ │ ├── make_coco_dataset.py

│ │ ├── make_msrvtt_dataset.py

│ │ ├── preprocess_coco_images.py

│ │ ├── preprocess_coco_objects.py

│ │ ├── preprocess_msrvtt_objects.py

│ │ └── preprocess_msrvtt_videos.py

│ │

│ └── utils <- Assistance classes and modules

│ ├── create_transformer.py <- Create image transformer with torchvision

│ ├── TTS.py <- Amazon Polly wrapper

│ ├── ImageDataloader.py <- Torch dataloader for the COCO dataset

│ ├── VideoDataloader.py <- Torch dataloader for the MSR-VTT dataset

│ └── Vocabulary.py <- Vocabulary class

│

│

└── web <- Scripts/templates related to deploying web app with Flask

依赖项可以使用:

pip install -r requirements.txt

| 建筑学 | CNN | 初始化 | 贪婪的 | 梁= 3 |

|---|---|---|---|---|

| LSTM(嵌入:256) | RESNET152 | 随机的 | 0.123 | 0.132 |

| gru(嵌入:256) | RESNET152 | 随机的 | 0.122 | 0.131 |

| LSTM(嵌入:256) | VGG16 | 随机的 | 0.108 | 0.117 |

| 建筑学 | CNN | 初始化 | 贪婪的 | 梁= 3 |

|---|---|---|---|---|

| gru(嵌入:256) | RESNET152 | 随机的 | 0.317 | 0.351 |

| LSTM(嵌入:256) | RESNET152 | 随机的 | 0.305 | 0.320 |

| LSTM(嵌入:256) | VGG16 | 随机的 | 0.283 | 0.318 |

| LSTM(嵌入:512) | RESNET152 | 随机的 | 0.270 | 0.317 |

| LSTM(嵌入:256) | RESNET152 | 预训练的可可 | 0.278 | 0.310 |

本节将展示如何训练自己的图像描述模型。

首先,需要预处理可可的数据集图像和标题进行培训。

python3 src/prepare/make_coco_dataset.py

--coco_path <path_to_cocoapi>

--interim_results_path <interim_results_path>

--results_path <final_results_path>

-coco_path:通往可可api路径的路径(可以从此处下载)

-interm_results_path:存储临时结果的路径(默认:数据/临时/)

-Results_path:存储最终结果的路径(默认:数据/处理/)

这还将组合字幕数据集存储在<coco_path>/annotations/coco_captions.csv中。

python3 src/prepare/build_coco_vocabulary.py

--coco_path <path_to_cocoapi>

--vocab_path <desired_path_of_vocab>

--threshold <min_word_threshold>

--sets <coco_sets_to_include>

-coco_path:通往可可api路径的路径(可以从此处下载)

-Vocab_path:存储可可词汇的路径(默认到数据/padected/coco_vocab.pkl)

- 阈值:添加到词汇中的最小单词发生(默认值:5)

- 集合:可可套装以包括在词汇结构中(默认:'Train2014','Train2017')

python3 src/prepare/preprocess_coco_images.py

--model <base_model_type>

--dir <path_to_images_to_encode>

--continue_preprocessing <continue_preprocessing?>

- 模型:用于预处理的基本CNN模型(选项:['resnet18','resnet50','resnet152','vgg11','vgg11_bn','vgg16','vgg16','vgg16_bn','vgg16_bn','vgg19'vgg19'vgg19'vgg19'''vgg19_bn'bn's speree'' 'densenet121','densenet201','inpection']))

- dir:使用选定模型编码可可图像的路径

-Continue_processing:目录中的剩余图像

编码的文件将放置在DIR中。

python3 src/ic_trainer.py

--models_path <path_to_store_models>

--beam_size <beam_size_to_use_during_validation>

--vocab_path <path_to_coco_vocab>

--captions_path <path_to_coco_captions_file>

--images_path <path_to_coco_image_embeddings>

--lr <learning_rate>

--val_interval <epoch_interval_to_validate_models>

--save_interval <epoch_inteval_to_save_model_checkpoints>

--num_epochs <epochs_to_train_for>

--initial_checkpoint_file <starting_model_checkpoint>

--version <model_version_number>

--batch_size <batch_size>

--coco_set <coco_set>

--load_features <load_or_construct_image_embeddings>

--load_captions <load_or_constructed_caption_encodings>

--preload <preload_image_and_caption_encodings_prior_to_training>

--base_model <CNN_encoder_model>

--embedding_size <size_of_image_embedding>

--embed_size <size_of_RNN_input>

--hidden_size <RNN_hidden_size>

--rnn_type <type_of_RNN_unit_to_use>

-models_path:存储最终模型的路径(默认:型号/)

- beam_size:验证的光束大小(默认:3)

-vocab_path:可可词词的路径(默认:data/pasgented/coco_vocab.pkl)

-captions_path:通往可可标题的路径(默认:os.environ ['home'] +'/programs/cocoapi/annotations/coco_captions.csv')

-images_path:通往可可的路径(默认:os.environ ['home'] +'/database/coco/images/')

-lr:使用的学习率(默认:0.001)

-val_interval:验证时期频率(默认值:10)

-save_interval:保存检查点频率(默认值:10)

-num_epochs:要训练的时期数(默认值:1000)

-initial_checkpoint_file:检查点要从(默认:无)开始培训

- Version:型号版本号(默认:11)

-batch_size:批处理大小(默认:64)

-coco_set:使用(默认:2014)训练的可可数据集

-load_features:加载或构造图像嵌入的选项(默认:true)

-load_captions:加载或构造字幕嵌入的选项(默认:true)

- 预计:在培训之前将数据预加载到系统内存的选项(默认:true)

-base_model:用于预处理的基本CNN模型(选项:['resnet18','resnet50','resnet152','vgg11','vgg11_bn','vgg1_bn','vgg16','vgg16_bn',vgg16_bn','vgg19'vgg19'vgg19',vgg19' 'densenet121','densenet201','inpection']))

-embedding_size:图像嵌入的大小(默认:2048)

-embed_size:RNN输入的大小(默认:256)

-hidden_size:RNN隐藏层的大小(默认:512)

-rnn_type:rnn类型(默认:'lstm')

python3 src/ic_validate.py

--model_path <path_to_trained_ic_model>

--beam_size <beam_size_to_use_during_validation>

--vocab_path <path_to_coco_vocab>

--captions_path <path_to_coco_captions_file>

--images_path <path_to_coco_image_embeddings>

--batch_size <batch_size>

--coco_set <coco_set>

--load_features <load_or_construct_image_embeddings>

--load_captions <load_or_constructed_caption_encodings>

--preload <preload_image_and_caption_encodings_prior_to_training>

--base_model <CNN_encoder_model>

--embedding_size <size_of_image_embedding>

--embed_size <size_of_RNN_input>

--hidden_size <RNN_hidden_size>

--rnn_type <type_of_RNN_unit_to_use>

-Model_path:训练IC模型的路径

- beam_size:验证的光束尺寸

-vocab_path:可可词词的路径(默认:data/pasgented/coco_vocab.pkl)

-captions_path:通往可可标题的路径(默认:os.environ ['home'] +'/programs/cocoapi/annotations/coco_captions.csv')

-images_path:通往可可图像的路径(默认:os.environ ['home'] +'/database/coco/images/')

-batch_size:批处理大小(默认:64)

-coco_set:使用(默认:2014)训练的可可数据集

-load_features:加载或构造图像嵌入的选项(默认:true)

-load_captions:加载或构造字幕嵌入的选项(默认:true)

- 预计:在培训之前将数据预加载到系统内存的选项(默认:true)

-base_model:用于预处理的基本CNN模型(选项:['resnet18','resnet50','resnet152','vgg11','vgg11_bn','vgg1_bn','vgg16','vgg16_bn',vgg16_bn','vgg19'vgg19'vgg19',vgg19' 'densenet121','densenet201','inpection']))

-embedding_size:图像嵌入的大小(默认:2048)

-embed_size:RNN输入的大小(默认:256)

-hidden_size:RNN隐藏层的大小(默认:512)

-rnn_type:rnn类型(默认:'lstm')

本节将展示如何训练自己的视频描述模型。

首先,需要预处理MSR-VTT数据集视频和标题进行培训。

python3 src/prepare/make_msrvtt_dataset.py

--raw_data_path <path_to_raw_msrvtt_data>

--interim_data_path <path_to_store_interim_data>

--final_data_path <path_to_store_final_data>

--continue_converting <continue_conversion>

--train_pct <percentage_to_allocate_to_training_set>

--dev_pct <percentage_to_allocate_to_development_set>

-raw_data_path:RAW MSRVTT数据文件的路径(默认值:'Data/raw/videodatainfo_2017_ustc.json')

-interim_data_path:存储临时结果的路径(默认值:'data/intrim/')

-final_data_path:存储最终结果的路径(默认值:'data/processed/')

-Continue_converting:继续转换MSR-VTT数据集的路径(默认:true)

-train_pct:用于培训的数据集的百分比(默认:0.8)

-DEV_PCT:用于开发的数据集的百分比(默认:0.15)

python3 src/prepare/build_msrvtt_vocabulary.py

--captions_path <path_to_captions>

--vocab_path <desired_path_of_vocab>

--threshold <min_word_threshold>

--sets <coco_sets_to_include>

-coco_path: make_msrvtt_dataset.py生成的MSR-VTT字幕的路径(默认:'data/processed/msrvtt_captions.csv')

-Vocab_path:存储MSR-VTT词汇的路径(默认为数据/处理/msrvtt_vocab.pkl)

- 阈值:添加到词汇中的最小单词发生(默认值:5)

python3 src/prepare/preprocess_msrvtt_videos.py

--model <base_model_type>

--dir <path_to_images_to_encode>

--continue_preprocessing <continue_preprocessing?>

--resolution <CNN_input_resolution>

--num_frames <number_of_frames_to_encode>

--frames_interval <interval_between_frames>

--embedding_size <frame_embedding_size>

- 模型:用于预处理的基本CNN模型(选项:['resnet18','resnet50','resnet152','vgg11','vgg11_bn','vgg16','vgg16','vgg16_bn','vgg16_bn','vgg19'vgg19'vgg19'vgg19'''vgg19_bn'bn's speree'' 'densenet121','densenet201','inpection']))

- dir:使用选定模型进行编码的MSR-VTT视频路径(默认:OS.Environ ['HOME'] +'/database/MSR-VTT/Train-Video/')

-Continue_processing:目录中的剩余视频(默认:true)

- 分辨率:CNN输入分辨率(默认:224)

-num_frames:编码的帧数(默认值:40)

-frames_interval:帧之间的间隔(默认:1)

-embedding_size:CNN OUPUT分辨率(默认:2048)

编码的文件将放置在DIR中。

python3 src/vc_trainer.py

--models_path <path_to_store_models>

--beam_size <beam_size_to_use_during_validation>

--vocab_path <path_to_msrvtt_vocab>

--captions_path <path_to_msrvtt_captions_file>

--videos_path <path_to_msrvtt_video_embeddings>

--lr <learning_rate>

--val_interval <epoch_interval_to_validate_models>

--save_interval <epoch_inteval_to_save_model_checkpoints>

--num_epochs <epochs_to_train_for>

--initial_checkpoint_file <starting_model_checkpoint>

--version <model_version_number>

--batch_size <batch_size>

--load_features <load_or_construct_video_embeddings>

--load_captions <load_or_constructed_caption_encodings>

--preload <preload_image_and_caption_encodings_prior_to_training>

--base_model <CNN_encoder_model>

--embedding_size <size_of_frame_embedding>

--embed_size <size_of_RNN_input>

--hidden_size <RNN_hidden_size>

--rnn_type <type_of_RNN_unit_to_use>

-models_path:存储最终模型的路径(默认:型号/)

- beam_size:验证的光束大小(默认:3)

-Vocab_path:通往MSR-VTT词汇的路径(默认:数据/processed/msrvtt_vocab.pkl)

-captions_path:通往MSR-VTT字幕的路径(默认:data/processed/msrvtt_captions.csv)

-videos_path:通往MSR-VTT视频的路径(默认:os.environ ['home'] +'/database/msr-vtt/train-video/')

-lr:使用的学习率(默认:0.001)

-val_interval:验证时期频率(默认值:10)

-save_interval:保存检查点频率(默认值:10)

-num_epochs:要训练的时期数(默认值:1000)

-initial_checkpoint_file:检查点要从(默认:无)开始培训

- Version:型号版本号(默认:11)

-batch_size:批处理大小(默认:64)

-load_features:加载或构造视频嵌入的选项(默认:true)

-load_captions:加载或构造字幕嵌入的选项(默认:true)

- 预计:在培训之前将数据预加载到系统内存的选项(默认:true)

-base_model:用于预处理的基本CNN模型(选项:['resnet18','resnet50','resnet152','vgg11','vgg11_bn','vgg1_bn','vgg16','vgg16_bn',vgg16_bn','vgg19'vgg19'vgg19',vgg19' 'densenet121','densenet201','inpection']))

-embedding_size:框架嵌入的大小(默认:2048)

-embed_size:RNN输入的大小(默认:256)

-hidden_size:RNN隐藏层的大小(默认:512)

-rnn_type:rnn类型(默认:'lstm')

python3 src/vc_validate.py

--model_path <path_to_trained_vc_model>

--beam_size <beam_size_to_use_during_validation>

--vocab_path <path_to_msrvtt_vocab>

--captions_path <path_to_msrvtt_captions_file>

--videos_path <path_to_msrvtt_video_embeddings>

--batch_size <batch_size>

--load_features <load_or_construct_video_embeddings>

--load_captions <load_or_constructed_caption_encodings>

--preload <preload_image_and_caption_encodings_prior_to_training>

--base_model <CNN_encoder_model>

--embedding_size <size_of_frame_embedding>

--embed_size <size_of_RNN_input>

--hidden_size <RNN_hidden_size>

--rnn_type <type_of_RNN_unit_to_use>

-model_path:训练有素的视频说明模型

- beam_size:验证的光束尺寸

-Vocab_path:通往MSR-VTT词汇的路径(默认:数据/processed/msrvtt_vocab.pkl)

-captions_path:通往MSR-VTT字幕的路径(默认:data/processed/msrvtt_captions.csv)

-videos_path:通往MSR-VTT视频的路径(默认:os.environ ['home'] +'/database/msr-vtt/train-video/')

-batch_size:批处理大小(默认:64)

-load_features:加载或构造视频嵌入的选项(默认:true)

-load_captions:加载或构造字幕嵌入的选项(默认:true)

- 预计:在培训之前将数据预加载到系统内存的选项(默认:true)

-base_model:用于预处理的基本CNN模型(选项:['resnet18','resnet50','resnet152','vgg11','vgg11_bn','vgg1_bn','vgg16','vgg16_bn',vgg16_bn','vgg19'vgg19'vgg19',vgg19' 'densenet121','densenet201','inpection']))

-embedding_size:框架嵌入的大小(默认:2048)

-embed_size:RNN输入的大小(默认:256)

-hidden_size:RNN隐藏层的大小(默认:512)

-rnn_type:rnn类型(默认:'lstm')