语言模型是无监督的多任务学习者

该项目是OpenAI GPT-2模型的Pytorch实施。它提供模型培训,句子产生和指标可视化。它被认为既可以理解又优化。我们设计的代码是可理解的。另外,我们使用一些技术来提高性能。

在培训GPT-2模型之前,应准备语料库数据集。我们建议通过使用Expanda来构建自己的语料库。取而代之的是,培训模块需要使用其词汇文件的令牌化培训和评估数据集。

准备数据集后,您可以使用以下方式训练GPT-2:

$ python -m gpt2 train --train_corpus build/corpus.train.txt

--eval_corpus build/corpus.test.txt

--vocab_path build/vocab.txt

--save_checkpoint_path ckpt-gpt2.pth

--save_model_path gpt2-pretrained.pth

--batch_train 128

--batch_eval 128

--seq_len 64

--total_steps 1000000

--eval_steps 500

--save_steps 5000

要从上一个检查点文件中恢复培训,请使用--from_checkpoint [last checkpoint file]选项。如果要使用多个GPU训练GPT-2,请使用--gpus [number of gpus]选项。

命令行使用的细节如下:

usage: gpt2 train [-h] --train_corpus TRAIN_CORPUS --eval_corpus EVAL_CORPUS

--vocab_path VOCAB_PATH [--seq_len SEQ_LEN]

[--layers LAYERS] [--heads HEADS] [--dims DIMS]

[--rate RATE] [--dropout DROPOUT]

[--batch_train BATCH_TRAIN] [--batch_eval BATCH_EVAL]

[--base_lr BASE_LR] [--wd_rate WD_RATE]

[--total_steps TOTAL_STEPS] [--eval_steps EVAL_STEPS]

[--save_steps SAVE_STEPS]

[--save_model_path SAVE_MODEL_PATH]

[--save_checkpoint_path SAVE_CHECKPOINT_PATH]

[--from_checkpoint FROM_CHECKPOINT]

[--from_pretrained FROM_PRETRAINED] [--use_amp]

[--use_grad_ckpt] [--gpus GPUS]

optional arguments:

-h, --help show this help message and exit

Corpus and vocabulary:

--train_corpus TRAIN_CORPUS

training corpus file path

--eval_corpus EVAL_CORPUS

evaluation corpus file path

--vocab_path VOCAB_PATH

vocabulary file path

Model configurations:

--seq_len SEQ_LEN maximum sequence length

--layers LAYERS number of transformer layers

--heads HEADS number of multi-heads in attention layer

--dims DIMS dimension of representation in each layer

--rate RATE increase rate of dimensionality in bottleneck

--dropout DROPOUT probability that each element is dropped

Training and evaluation:

--batch_train BATCH_TRAIN

number of training batch size

--batch_eval BATCH_EVAL

number of evaluation batch size

--base_lr BASE_LR default learning rate

--wd_rate WD_RATE weight decay rate

--total_steps TOTAL_STEPS

number of total training steps

--eval_steps EVAL_STEPS

period to evaluate model and record metrics

--save_steps SAVE_STEPS

period to save training state to checkpoint

Saving and restoring:

--save_model_path SAVE_MODEL_PATH

save trained model weights to the file

--save_checkpoint_path SAVE_CHECKPOINT_PATH

save training state to the checkpoint file

--from_checkpoint FROM_CHECKPOINT

load last training state from checkpoint file

--from_pretrained FROM_PRETRAINED

initialize parameters from pretrained model

Extensions:

--use_amp use automatic mixed-precision in training

--use_grad_ckpt use gradient checkpointing in transformer layers

--gpus GPUS number of gpu devices to use in training

训练GPT-2后,您可以在交互式模式下使用训练有素的模型生成句子。

$ python -m gpt2 generate --vocab_path build/vocab.txt

--model_path model.pth

--seq_len 64

--nucleus_prob 0.8

命令行使用的细节如下:

usage: gpt2 generate [-h] --vocab_path VOCAB_PATH --model MODEL

[--seq_len SEQ_LEN] [--layers LAYERS] [--heads HEADS]

[--dims DIMS] [--rate RATE] [--top_p TOP_P] [--use_gpu]

optional arguments:

-h, --help show this help message and exit

--vocab_path VOCAB_PATH

vocabulary file path

--model_path MODEL_PATH

trained GPT-2 model file path

Model configurations:

--seq_len SEQ_LEN maximum sequence length

--layers LAYERS number of transformer layers

--heads HEADS number of multi-heads in attention layer

--dims DIMS dimension of representation in each layer

--rate RATE increase rate of dimensionality in bottleneck

Generating options:

--nucleus_prob NUCLEUS_PROB

probability threshold for nucleus sampling

--use_gpu use gpu device in inferencing

估计训练模型的性能的一种方法是通过评估数据集计算客观指标,这在训练阶段未使用。

$ python -m gpt2 evaluate --model_path model.pth --eval_corpus corpus.test.txt --vocab_path vocab.txt

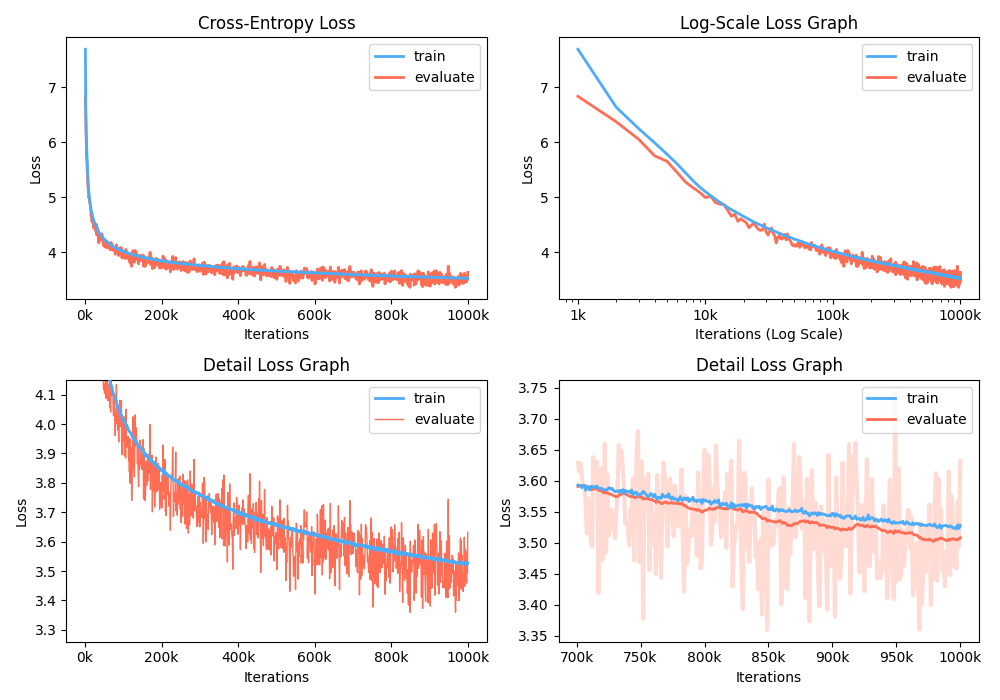

此外,您还可以通过可视化记录的指标来分析培训损失图。

$ python -m gpt2 visualize --model_path model.pth --interactive

示例图就是波纹管:

在训练期间,您可以使用Nvidia Apex使用Fused Cuda层和混合精液优化。选项--use_amp在训练中启用自动混合精度。在使用这些性能提升之前,您应该按照存储库来安装NVIDIA APEX库,或运行BelOWS:

$ git clone https://github.com/NVIDIA/apex

$ cd apex

$ pip install -v --no-cache-dir --global-option="--cpp_ext" --global-option="--cuda_ext" ./

如果您无法安装库或GPU设备不支持快速的混合精液训练(确切地说,GPU应通过张量核心支持混合精液加速),则可以在单精度模式下训练该模型。混合精液培训是一种选择。在这种情况下,您仍然可以使用融合的CUDA层,例如Adam Optimizer和训练中的层归一化。

您可以在Google Colab中玩受过训练的GPT2模型!以上笔记本包含文本生成和指标评估。您需要将受过训练的模型,词汇文件和评估数据集上传到Google Cloud Storage。

对于对GPT2韩国兴趣感兴趣的人,我们重写了上述笔记本,以提供gpt2-ko-302M型号的案例,尤其是该型号,该模型接受了大约5.04b的韩国文档培训。您可以在此笔记本中播放演示。

该项目已获得Apache-2.0许可。