أصدرت أكاديمية Alibaba Damo مؤخراً نموذجًا كبيرًا متعدد اللغات يسمى Babel ، بهدف كسر حواجز اللغة العالمية وتمكين الذكاء الاصطناعي من فهم والتواصل باستخدام لغة أكثر من 90 ٪ من سكان العالم. هذه الخطوة المبتكرة تمثل خطوة مهمة في مجال معالجة اللغة.

في الوقت الحاضر ، تركز العديد من نماذج اللغة الكبيرة على اللغات الغنية بالموارد مثل اللغة الإنجليزية والفرنسية والألمانية ، في حين يتم التغاضي عن اللغات التي تحتوي على قاعدة مستخدمين كبيرة مثل الهندية والبنغالية والأوردو. تشبه هذه الظاهرة الموقف الذي يتم فيه تهميش مستخدمي اللغة الصغيرة في المؤتمرات العالمية.

تم إطلاق بابل لتغيير هذا الموقف. يدعم النموذج أكثر من 25 لغات منطوقة في العالم ، والتي تغطي أكثر من 90 ٪ من سكان العالم. والأهم من ذلك ، أن بابل يولي أيضًا اهتمامًا خاصًا للسواحيلية ، الجاوية ، اللغات البورمية وغيرها من اللغات التي نادراً ما توجد في Open Source LLM. ستجلب هذه الخطوة خدمات لغة AI أكثر ملاءمة وأفضل لمليارات الأشخاص الذين يستخدمون هذه اللغات.

على عكس أساليب التدريب التقليدية المستمرة ، يستخدم بابل تقنية فريدة لتوسيع الطبقة لتعزيز قدرات النموذج. يمكن فهم هذه الطريقة على أنها زيادة "احتياطي المعرفة" بطريقة أكثر تطوراً بناءً على النموذج الأصلي ، وبالتالي تحسين الأداء مع ضمان كفاءة الحوسبة. أطلق فريق الأبحاث نموذجين مميزين: Babel-9b ، تم تحسينه لاستدلال GPU أحادي الكفاءة والضبط ؛ و Babel-83b ، وهو "كبير" 83 مليار معلم يهدف إلى وضع معيار جديد لمجلة LLM مفتوحة المصدر.

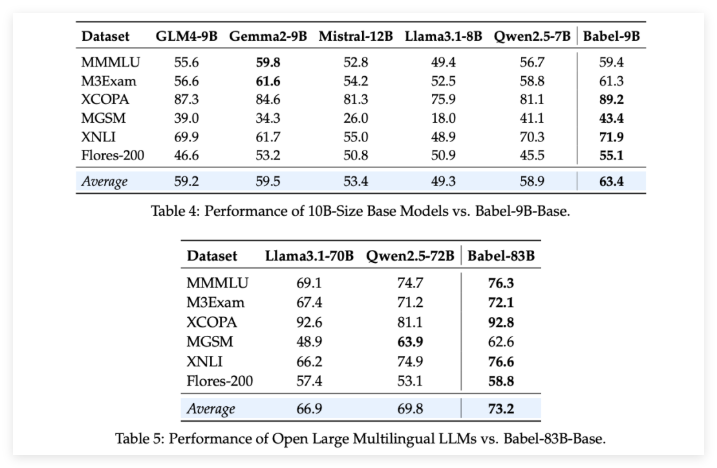

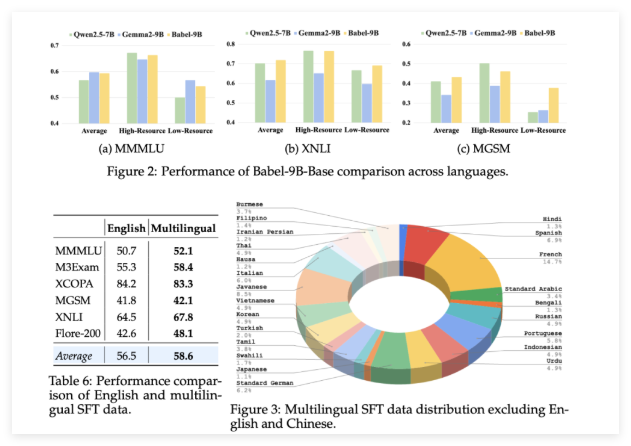

للتحقق من قوة بابل ، أجرى فريق البحث تقييمات صارمة على مهام متعددة اللغات. النتائج مثيرة: سواء كان بابل-9 مليارات المعلمة 9 مليارات أو 83 مليار معلم بابل 83 ب ، فإنه يتجاوز نماذج أخرى مفتوحة المصدر بنفس المقياس في معايير متعددة. على سبيل المثال ، كان أداء بابل جيدًا في مهام مثل المعرفة العالمية (MMMLU ، M3EXAM) ، المنطق (MGSM ، XCOPA) ، الفهم (XNLI) ، والترجمة (FLORES-200).

تجدر الإشارة بشكل خاص إلى أنه عندما يتعامل بابل مع لغات مكافحة الموارد ، زاد معدل دقتها بنسبة 5 ٪ إلى 10 ٪ مقارنة مع LLM المتعددة اللغات السابقة. يوضح هذا تمامًا أنه على الرغم من أن بابل يحسن تغطية اللغة ، إلا أنه يولي أيضًا الانتباه إلى أداء النموذج بلغات مختلفة.

الأمر الأكثر إثارة للدهشة هو أنه بعد الإشراف الخاضع للإشراف (SFT) على أكثر من مليون بيانات محادثة ، فإن إصدارات دردشة بابل بابل-9 ب-وابل-83 ب-تشات تُظهر إمكانات محادثة قوية ، وأدائها يمكن مقارنتها ببعض طرز الذكاء الاصطناعي العليا. على سبيل المثال ، تمكن Babel-83B-Chat من التنافس مع GPT-4O في مهام معينة. لا شك في أن هذا يضخ حيوية جديدة في مجتمع المصادر المفتوحة ، مما يثبت أن نموذج المصدر المفتوح يمكن أن يكتسب أيضًا موقعًا رائدًا في إمكانات متعددة اللغات.

المشروع: https://babel-llm.github.io/babel-llm/

Github: https: //github.com/babel-llm/babel-llm