mean teacher

1.0.0

紙-----尼普斯2017海報--------尼普斯2017 Spotlight幻燈片----博客文章

由Harri Valpola(好奇的人工智能公司)的Antti Tarvainen撰寫

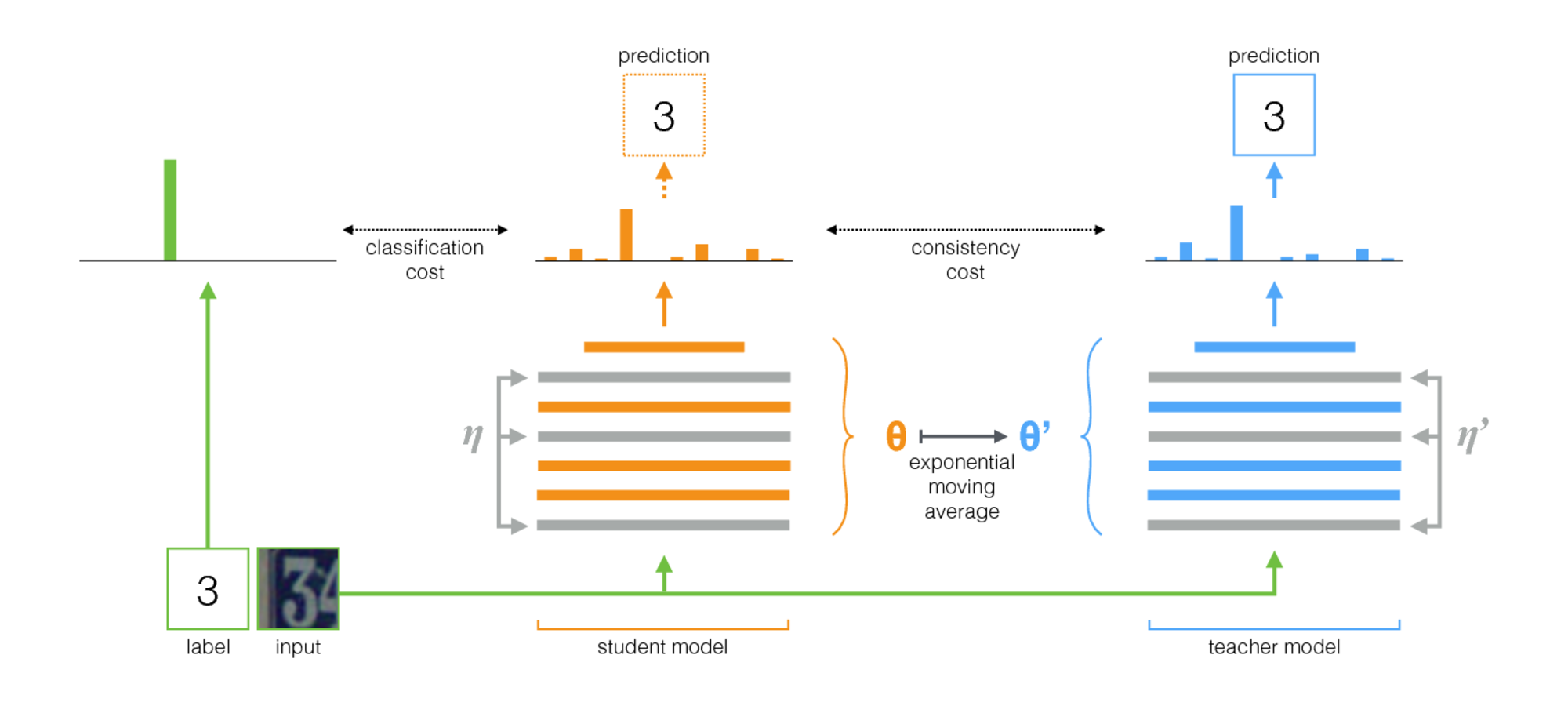

平均教師是半監督學習的簡單方法。它包括以下步驟:

我們的貢獻是最後一步。 Laine和Aila [Paper]使用了學生和老師之間的共享參數,或者使用了教師預測的臨時合奏。相比之下,平均教師更準確,適用於大型數據集。

卑鄙的老師在現代建築中效果很好。將平均教師與重新NET結合在一起,我們在ImageNet和Cifar-10數據集上的半監督學習中提高了最先進的狀態。

| Imagenet使用10%的標籤 | TOP-5驗證錯誤 |

|---|---|

| 變異自動編碼器[紙] | 35.42±0.90 |

| 平均教師Resnet-152 | 9.11±0.12 |

| 所有標籤,最先進的[紙] | 3.79 |

| CIFAR-10使用4000個標籤 | 測試錯誤 |

|---|---|

| CT-GAN [紙] | 9.98±0.21 |

| 平均老師Resnet-26 | 6.28±0.15 |

| 所有標籤,最先進的[紙] | 2.86 |

有兩個實現,一個用於張量,另一種用於Pytorch。 Pytorch版本可能更容易適應您的需求,因為它遵循典型的Pytorch成語,並且有一個自然的位置可以添加模型和數據集。讓我知道是否需要澄清。

關於本文的結果,使用傳統的Convnet體系結構進行了張曲流版本的實驗。使用剩餘網絡的實驗使用Pytorch版本運行。

平均老師介紹了兩個新的超參數:EMA衰減率和一致性成本重量。這些中的每一個的最佳值取決於數據集,模型和Minibatches的組成。您還需要選擇如何在MiniBatches中交織未標記的樣本和標記樣品。

以下是一些可以讓您入門的經驗法則: