在歐洲計算機視覺會議(ECCV)2024

(2024.08.07)我們發布了基於Kepoint的面部圖像動畫的推理腳本!請參考以獲取更多說明。

(2024.07.15)我們發布了基於軌蹟的圖像動畫的訓練代碼!請參考以獲取更多說明。

MOFA-VIDEO將出現在ECCV 2024中! ???????

我們已經發布了Gradio推理代碼和混合控件的檢查點!請參考以獲取更多說明。

通過擁抱面空間的免費在線演示即將到來!

如果您覺得這項工作很有趣,請隨時給予一個!

|  |  |

| 軌跡 +地標控制 | ||

|  |  |  |

| 軌跡控制 | |||

|  |  |  |  |

| 地標控制 | ||||

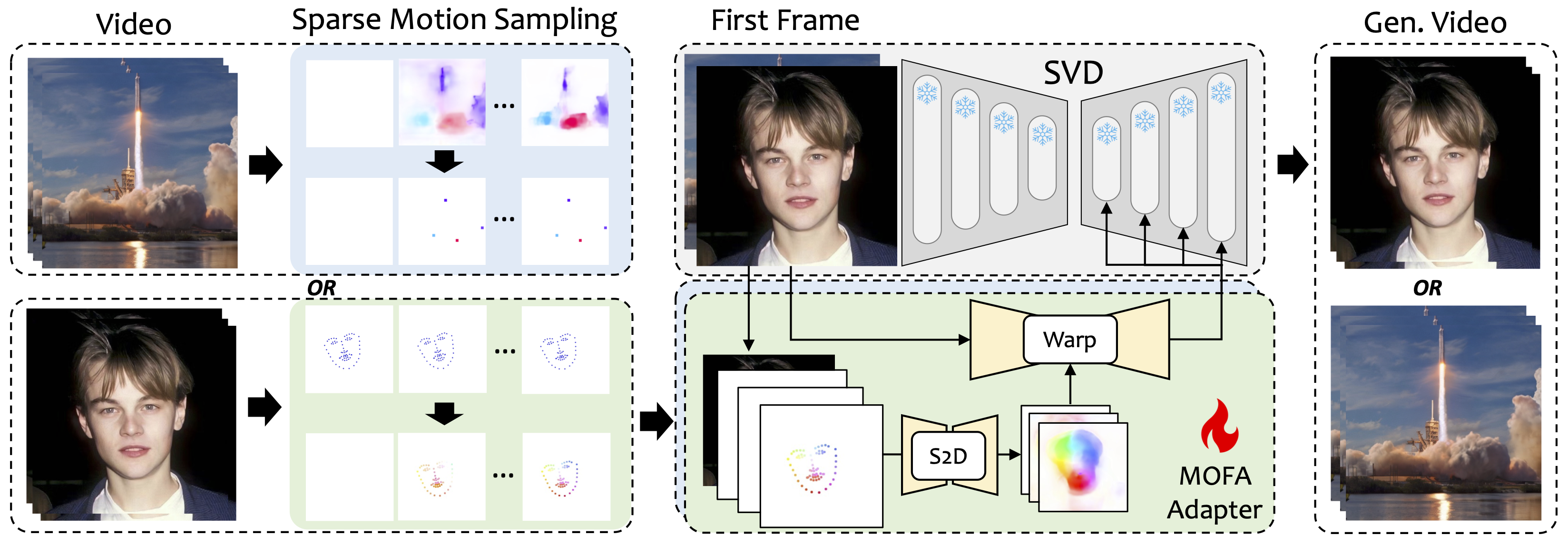

我們介紹了MOFA-VIDEO,該方法旨在將不同域的運動調整為冷凍視頻擴散模型。通過採用稀疏到密度(S2D)運動產生和基於流動的運動適應性,MOFA-VIDEO可以使用各種類型的控制信號(包括軌跡,關鍵點序列及其組合)有效地對單個圖像進行動畫。

在訓練階段,我們通過稀疏運動採樣生成稀疏的控制信號,然後訓練不同的MOFA適配器通過預訓練的SVD生成視頻。在推論階段,可以將不同的MOFA適配器組合在一起以共同控製冷凍的SVD。

git clone https://github.com/MyNiuuu/MOFA-Video.git

cd ./MOFA-Video

該演示已在11.7的CUDA版本上進行了測試。

cd ./MOFA-Video-Hybrid

conda create -n mofa python==3.10

conda activate mofa

pip install -r requirements.txt

pip install opencv-python-headless

pip install "git+https://github.com/facebookresearch/pytorch3d.git"

重要的:requirements.txt在需求中的4.5.0的Gradio版本應嚴格遵循,因為其他版本可能會導致錯誤。

從此處下載CMP的檢查點,然後將其放入./MOFA-Video-Hybrid/models/cmp/experiments/semiauto_annot/resnet50_vip+mpii_liteflow/checkpoints 。

從HuggingFace Repo下載ckpts文件夾,其中包含必要的驗證檢查點,並將其放在./MOFA-Video-Hybrid下。您可以使用git lfs下載整個ckpts文件夾:

git lfs 。它通常用於在擁抱面上具有大型模型檢查點的克隆存儲庫。git clone https://huggingface.co/MyNiuuu/MOFA-Video-Hybrid下載完整的HuggingFace存儲庫,目前僅包括ckpts文件夾。ckpts文件夾移至GitHub存儲庫。注意:如果您遇到錯誤git: 'lfs' is not a git command ,則可以嘗試使用此解決方案對我的情況有效。

最後,檢查點應被視為./MOFA-Video-Hybrid/ckpt_tree.md 。

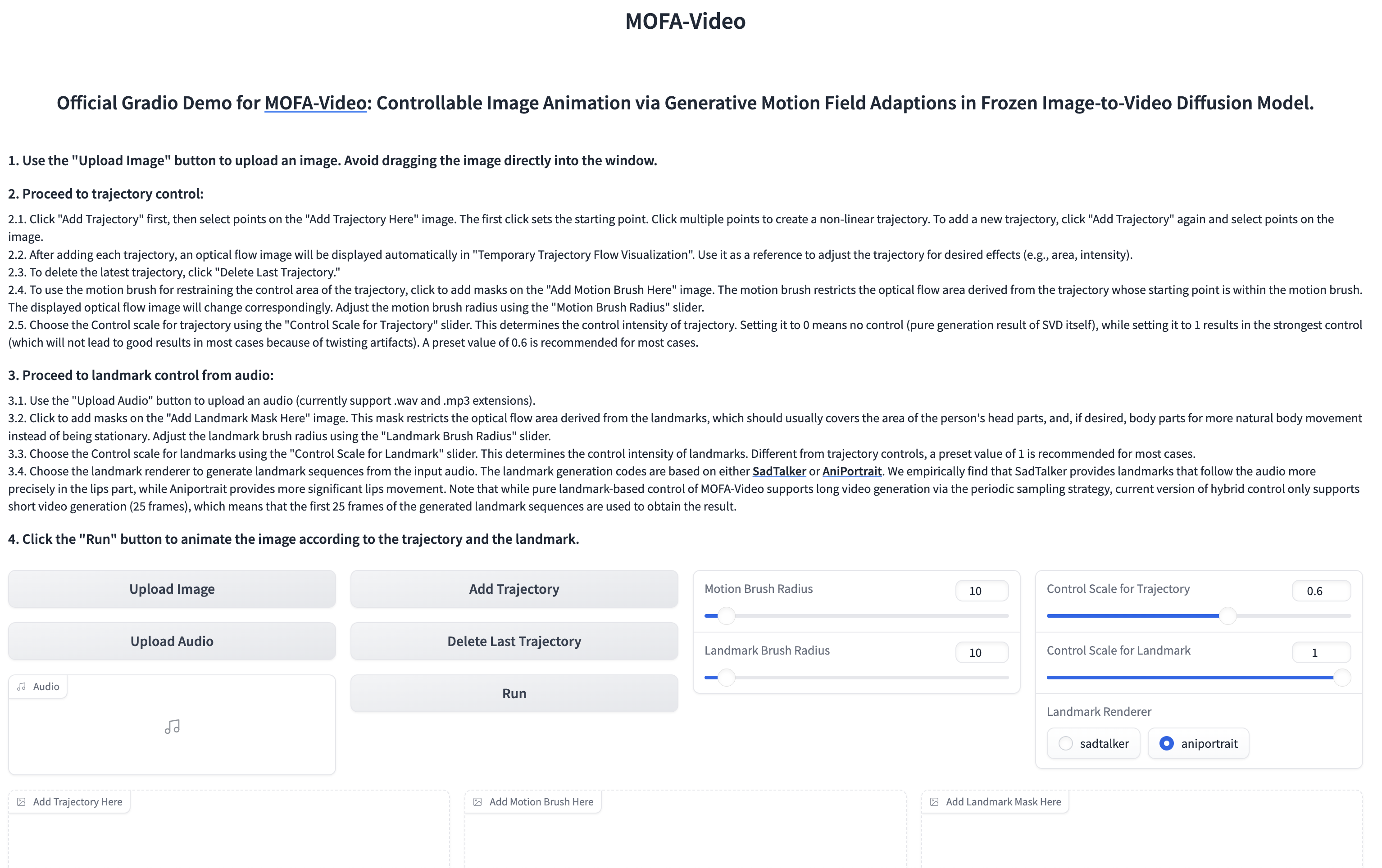

使用音頻使面部零件動畫

cd ./MOFA-Video-Hybrid

python run_gradio_audio_driven.py

??? Gradio接口顯示如下。請在推理過程中請參閱Gradio接口上的說明!

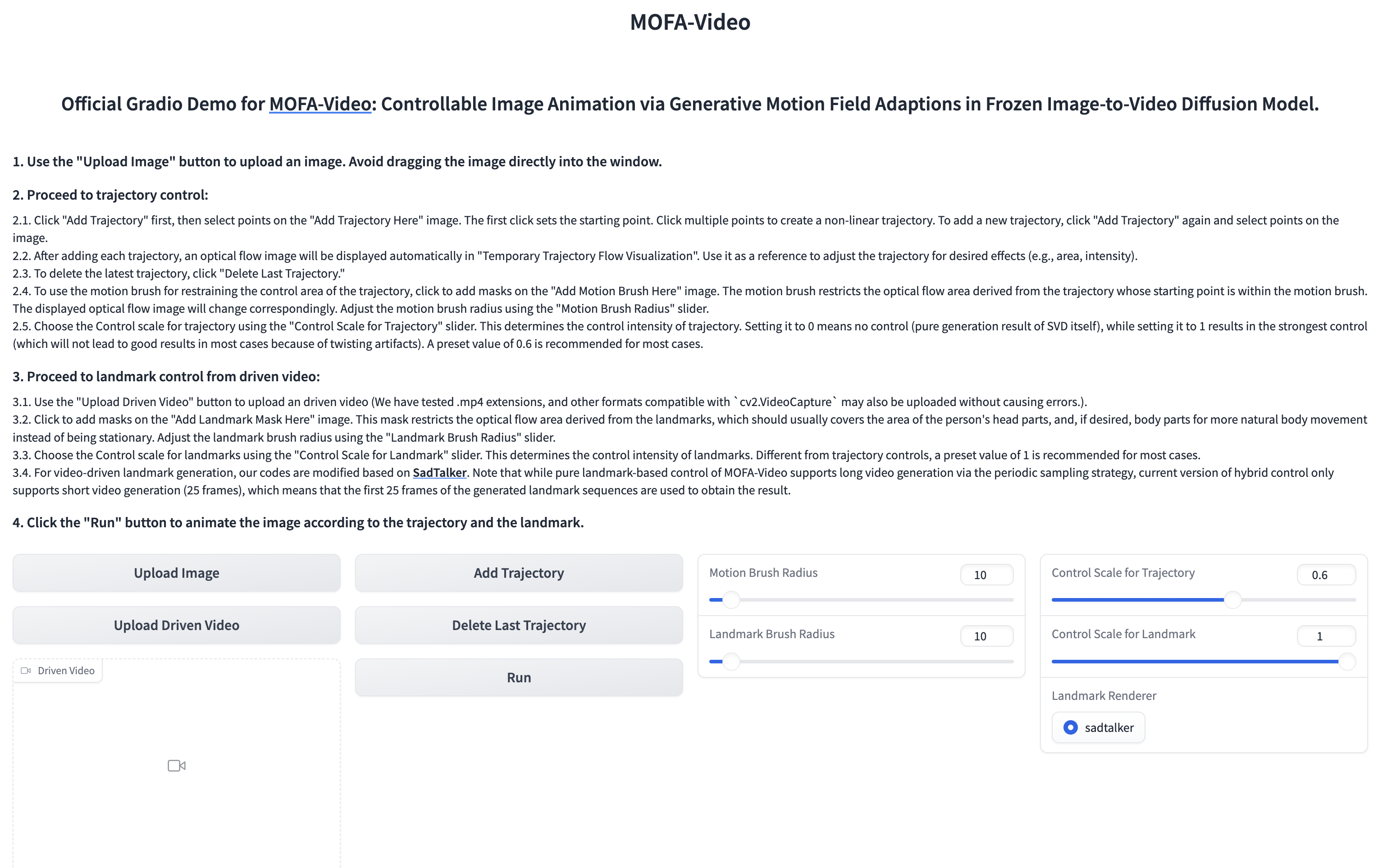

使用參考視頻使面部零件動畫

cd ./MOFA-Video-Hybrid

python run_gradio_video_driven.py

??? Gradio接口顯示如下。請在推理過程中請參閱Gradio接口上的說明!

請參閱此處以獲取說明。

請參考以獲取更多說明。

@article{niu2024mofa,

title={MOFA-Video: Controllable Image Animation via Generative Motion Field Adaptions in Frozen Image-to-Video Diffusion Model},

author={Niu, Muyao and Cun, Xiaodong and Wang, Xintao and Zhang, Yong and Shan, Ying and Zheng, Yinqiang},

journal={arXiv preprint arXiv:2405.20222},

year={2024}

}

我們真誠地感謝以下項目的代碼發布:Dragnuwa,Sadtalker,Aniportrait,擴散器,SVD_XTEND,條件 - 動作範圍和Unimatch。