SyntaSpeech

Pretrained Models for LJ, Biaobei, and LibriTTS.

| | | 中文文档

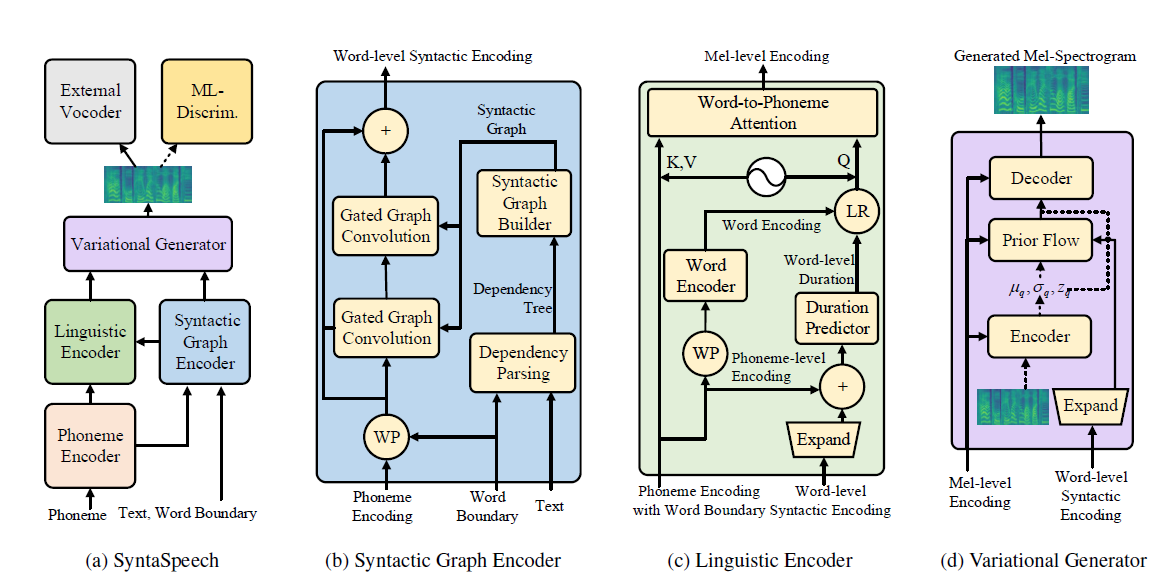

该存储库是我们IJCAI-2022论文的官方Pytorch实施,在其中我们建议语法为语法 - 意识到非自动性退休文本到语音。

我们的语法是基于Portaspeech(Neurips 2021)建立的,具有三个新功能:

conda create -n synta python=3.7

condac activate synta

pip install -U pip

pip install Cython numpy==1.19.1

pip install torch==1.9.0

pip install -r requirements.txt

# install dgl for graph neural network, dgl-cu102 supports rtx2080, dgl-cu113 support rtx3090

pip install dgl-cu102 dglgo -f https://data.dgl.ai/wheels/repo.html

sudo apt install -y sox libsox-fmt-mp3

bash mfa_usr/install_mfa.sh # install force alignment tools 请按照以下步骤运行此存储库。

您可以直接将我们的二进制数据集用于LJSpeech和Biaobei。下载它们,然后将它们解压缩到data/binary/文件夹中。

至于Libritts,您可以下载RAW数据集并使用我们的data_gen模块对其进行处理。详细说明可以在DOSC/prepar_data中找到。

我们为三个数据集提供了培训的辅助训练模型。具体而言,Hifi-gan用于ljspeech和biaobei,for libritts的平行波。下载并将其解压缩到checkpoints/文件夹中。

然后,您可以在三个数据集中训练Syntaspeech。

cd < the root_dir of your SyntaSpeech folder >

export PYTHONPATH=./

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/lj/synta.yaml --exp_name lj_synta --reset # training in LJSpeech

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/biaobei/synta.yaml --exp_name biaobei_synta --reset # training in Biaobei

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/libritts/synta.yaml --exp_name libritts_synta --reset # training in LibriTTStensorboard --logdir=checkpoints/lj_synta

tensorboard --logdir=checkpoints/biaobei_synta

tensorboard --logdir=checkpoints/libritts_syntaCUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/lj/synta.yaml --exp_name lj_synta --reset --infer # inference in LJSpeech

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/biaobei/synta.yaml --exp_name biaobei_synta --reset --infer # inference in Biaobei

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/libritts/synta.yaml --exp_name libritts_synta --reset ---infer # inference in LibriTTS 纸上的音频样本可以在我们的演示页面中找到。

我们还为LJSpeech提供了拥抱表演页面。在那里尝试您有趣的句子!

@article{ye2022syntaspeech,

title={SyntaSpeech: Syntax-Aware Generative Adversarial Text-to-Speech},

author={Ye, Zhenhui and Zhao, Zhou and Ren, Yi and Wu, Fei},

journal={arXiv preprint arXiv:2204.11792},

year={2022}

}

我们的代码基于以下存储库: