SyntaSpeech

Pretrained Models for LJ, Biaobei, and LibriTTS.

| | | 中文文档

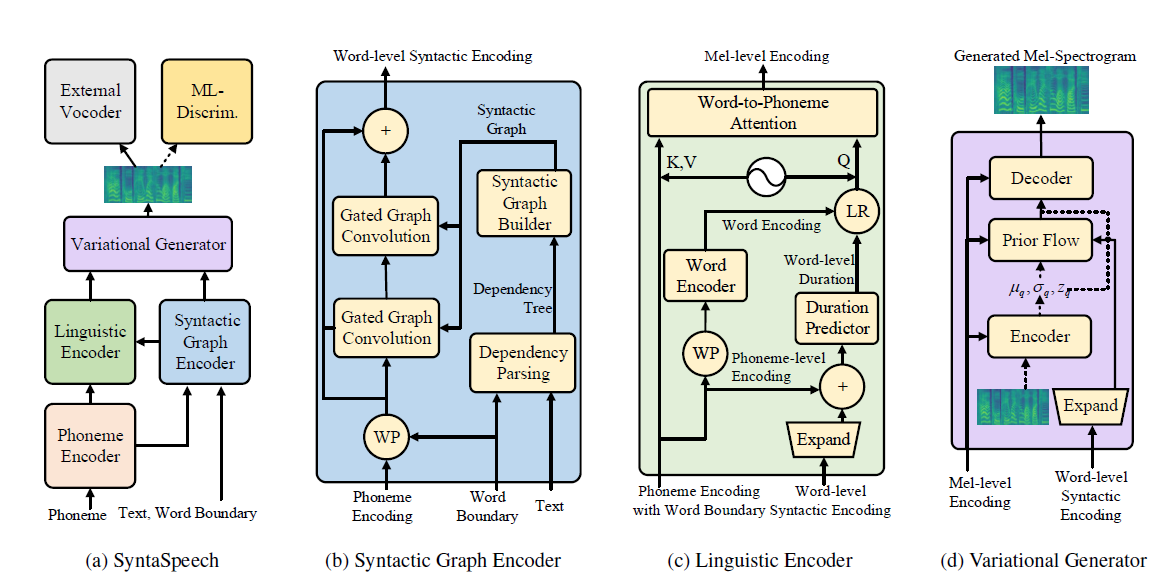

このリポジトリは、IJCAI-2022ペーパーの公式のPytorch実装であり、Syntaxを認識していない非自動性テキストからスピーチのためにSyntaspeechを提案します。

Syntaspeechは、3つの新機能を備えたPartaspeech(Neurips 2021)に基づいて構築されています。

conda create -n synta python=3.7

condac activate synta

pip install -U pip

pip install Cython numpy==1.19.1

pip install torch==1.9.0

pip install -r requirements.txt

# install dgl for graph neural network, dgl-cu102 supports rtx2080, dgl-cu113 support rtx3090

pip install dgl-cu102 dglgo -f https://data.dgl.ai/wheels/repo.html

sudo apt install -y sox libsox-fmt-mp3

bash mfa_usr/install_mfa.sh # install force alignment tools 次の手順に従って、このレポを実行してください。

ljspeechとbiaobeiには、2装ナ化されたデータセットを直接使用できます。それらをダウンロードして、 data/binary/フォルダーに解凍します。

Librittsについては、RAWデータセットをダウンロードして、 data_genモジュールで処理できます。詳細な指示は、dosc/prepare_dataにあります。

3つのデータセットのボコーダーの事前に訓練されたモデルを提供します。具体的には、LjspeechとBiaobeiのHifi-Gan、LibrittsのParallelwavegan。 checkpoints/フォルダーにダウンロードして解凍します。

次に、3つのデータセットでSynTaspeechをトレーニングできます。

cd < the root_dir of your SyntaSpeech folder >

export PYTHONPATH=./

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/lj/synta.yaml --exp_name lj_synta --reset # training in LJSpeech

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/biaobei/synta.yaml --exp_name biaobei_synta --reset # training in Biaobei

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/libritts/synta.yaml --exp_name libritts_synta --reset # training in LibriTTStensorboard --logdir=checkpoints/lj_synta

tensorboard --logdir=checkpoints/biaobei_synta

tensorboard --logdir=checkpoints/libritts_syntaCUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/lj/synta.yaml --exp_name lj_synta --reset --infer # inference in LJSpeech

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/biaobei/synta.yaml --exp_name biaobei_synta --reset --infer # inference in Biaobei

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/libritts/synta.yaml --exp_name libritts_synta --reset ---infer # inference in LibriTTS 論文のオーディオサンプルは、デモページにあります。

また、ljspeech用のハギングフェイスデモページも提供しています。そこで興味深い文章を試してみてください!

@article{ye2022syntaspeech,

title={SyntaSpeech: Syntax-Aware Generative Adversarial Text-to-Speech},

author={Ye, Zhenhui and Zhao, Zhou and Ren, Yi and Wu, Fei},

journal={arXiv preprint arXiv:2204.11792},

year={2022}

}

私たちのコードは、次のレポに基づいています。