| | | 中文文档

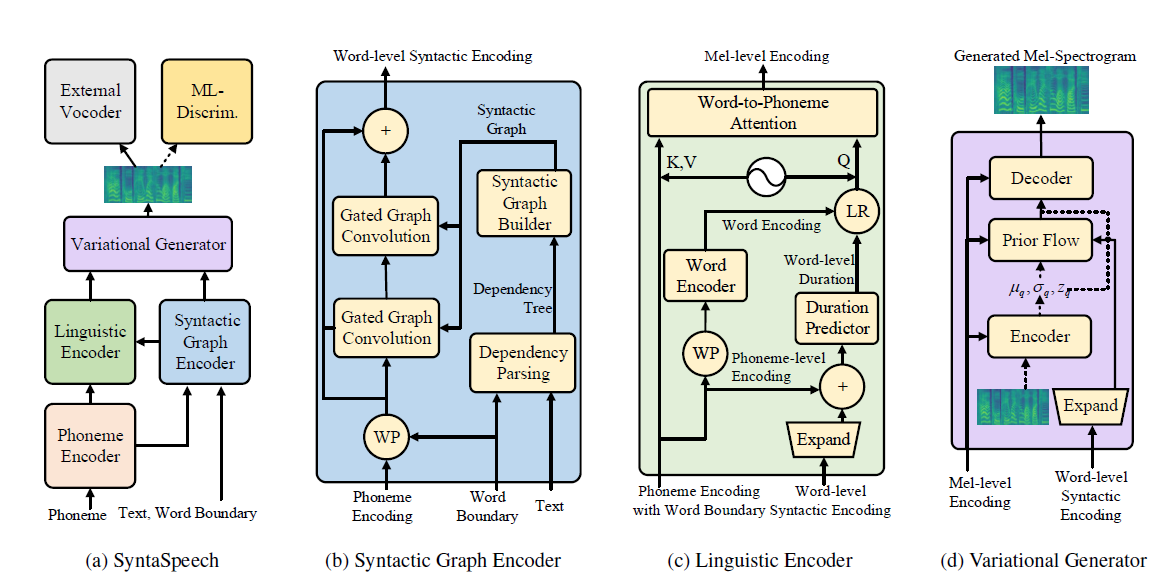

Этот репозиторий является официальной внедрением Pytorch нашей статьи IJCAI-2022, в которой мы предлагаем Syntaspeech для синтаксического неавторегрессивного текста в речь.

Наш Syntaspeech построен на основе Portaspeech (Neurips 2021) с тремя новыми функциями:

conda create -n synta python=3.7

condac activate synta

pip install -U pip

pip install Cython numpy==1.19.1

pip install torch==1.9.0

pip install -r requirements.txt

# install dgl for graph neural network, dgl-cu102 supports rtx2080, dgl-cu113 support rtx3090

pip install dgl-cu102 dglgo -f https://data.dgl.ai/wheels/repo.html

sudo apt install -y sox libsox-fmt-mp3

bash mfa_usr/install_mfa.sh # install force alignment tools Пожалуйста, выполните следующие шаги, чтобы запустить это репо.

Вы можете напрямую использовать наши бинаризованные наборы данных для LJSPEECH и Biobei. Загрузите их и разкачивайте их в data/binary/ папку.

Что касается Libritts, вы можете загрузить необработанные наборы данных и обработать их с нашими модулями data_gen . Подробные инструкции можно найти в DOSC/PREPARE_DATA.

Мы предоставляем предварительно обученную модель Vocoders для трех наборов данных. В частности, Hifi-Gan для LJSPEECH и Biobei, ParallelWavegan для Libritts. Загрузите и разкачивайте их в checkpoints/ папку.

Затем вы можете обучить Syntaspeech в трех наборах данных.

cd < the root_dir of your SyntaSpeech folder >

export PYTHONPATH=./

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/lj/synta.yaml --exp_name lj_synta --reset # training in LJSpeech

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/biaobei/synta.yaml --exp_name biaobei_synta --reset # training in Biaobei

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/libritts/synta.yaml --exp_name libritts_synta --reset # training in LibriTTStensorboard --logdir=checkpoints/lj_synta

tensorboard --logdir=checkpoints/biaobei_synta

tensorboard --logdir=checkpoints/libritts_syntaCUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/lj/synta.yaml --exp_name lj_synta --reset --infer # inference in LJSpeech

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/biaobei/synta.yaml --exp_name biaobei_synta --reset --infer # inference in Biaobei

CUDA_VISIBLE_DEVICES=0 python tasks/run.py --config egs/tts/libritts/synta.yaml --exp_name libritts_synta --reset ---infer # inference in LibriTTS Образцы аудио в бумаге можно найти на нашей демонстрационной странице.

Мы также предоставляем демо -страницу HuggingFace для LJSPEECH. Попробуйте свои интересные предложения там!

@article{ye2022syntaspeech,

title={SyntaSpeech: Syntax-Aware Generative Adversarial Text-to-Speech},

author={Ye, Zhenhui and Zhao, Zhou and Ren, Yi and Wu, Fei},

journal={arXiv preprint arXiv:2204.11792},

year={2022}

}

Наши коды основаны на следующих репо: