เมื่อเร็ว ๆ นี้สถาบันอัลเลนแห่งปัญญาประดิษฐ์ (AI2) เปิดตัวรูปแบบภาษาขนาดใหญ่ล่าสุด - Olmo232B โมเดลนี้ไม่เพียง แต่แสดงถึงความสำเร็จล่าสุดของซีรี่ส์ Olmo2 แต่ยังเปิดตัวความท้าทายที่ทรงพลังให้กับโมเดลที่เป็นกรรมสิทธิ์ที่ปิดด้วยทัศนคติที่ "เปิดกว้าง" แอตทริบิวต์โอเพ่นซอร์สของ Olmo232b เป็นคุณสมบัติที่สะดุดตาที่สุด AI2 เปิดเผยข้อมูลทั้งหมดรหัสน้ำหนักและกระบวนการฝึกอบรมโดยละเอียดทั้งหมดซึ่งตรงกันข้ามกับรุ่นปิดบางรุ่น

AI2 หวังที่จะส่งเสริมการวิจัยและนวัตกรรมที่กว้างขึ้นผ่านวิธีการที่เปิดกว้างและร่วมมือกันนี้ทำให้นักวิจัยทั่วโลกสามารถก้าวไปข้างหน้าบนไหล่ของ Olmo232B ในยุคของการแบ่งปันความรู้การซ่อนตัวไม่ใช่วิธีแก้ปัญหาระยะยาว การเปิดตัว Olmo232B เป็นเหตุการณ์สำคัญที่สำคัญในเส้นทางการพัฒนาของ AI ที่เปิดกว้างและเข้าถึงได้

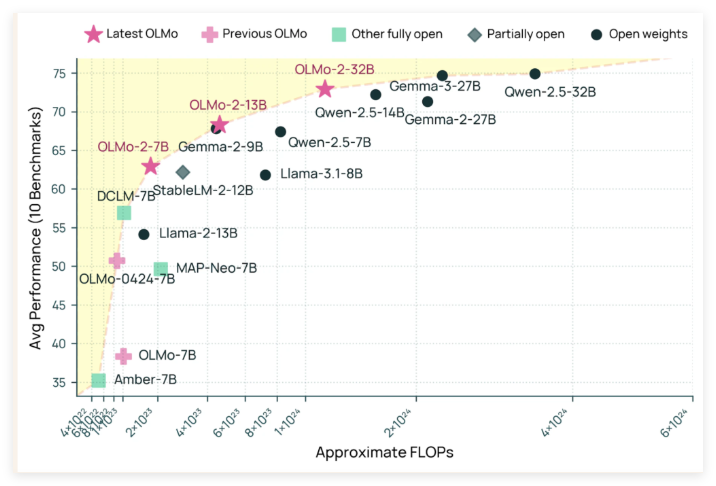

OLMO232B มีพารามิเตอร์ 32 พันล้านพารามิเตอร์ซึ่งเป็นจำนวนมากซึ่งมีขนาดเพิ่มขึ้นอย่างมากเมื่อเทียบกับรุ่นก่อนหน้า ในเกณฑ์มาตรฐานทางวิชาการที่ได้รับการยอมรับอย่างกว้างขวางรุ่นโอเพ่นซอร์สนี้มีมากกว่า GPT-3.5Turbo และ GPT-4O Mini! ไม่ต้องสงสัยเลยว่าการถ่ายภาพที่แข็งแกร่งให้กับชุมชน AI โอเพนซอร์สพิสูจน์ว่าไม่เพียง แต่สถาบันที่ "ร่ำรวย" เท่านั้นที่สามารถสร้างโมเดล AI ชั้นนำได้

เหตุผลที่ OLMO232B สามารถบรรลุผลลัพธ์ที่น่าประทับใจเช่นนี้แยกออกจากกระบวนการฝึกอบรมที่พิถีพิถัน กระบวนการฝึกอบรมทั้งหมดแบ่งออกเป็นสองขั้นตอนหลัก: การฝึกอบรมก่อนและการฝึกอบรมระยะกลาง ในช่วงก่อนการฝึกอบรมโมเดล "BITES" ชุดข้อมูลขนาดใหญ่ประมาณ 3.9 ล้านล้านโทเค็นซึ่งมีแหล่งที่มาอย่างกว้างขวางรวมถึง DCLM, DOLMA, StarCoder และ Proof Pile II มันเหมือนกับการให้แบบจำลองอ่านมากและเรียนรู้รูปแบบภาษาที่หลากหลาย

การฝึกอบรมระยะกลางนั้นมุ่งเน้นไปที่ชุดข้อมูล Dolmino ซึ่งเป็นชุดข้อมูลคุณภาพสูงที่มีโทเค็น 843 พันล้านโทซึ่งครอบคลุมการศึกษาคณิตศาสตร์และเนื้อหาทางวิชาการเพิ่มความสามารถในการทำความเข้าใจแบบจำลองในสาขาเฉพาะ วิธีการฝึกอบรมแบบแบ่งและมุ่งเน้นนี้ช่วยให้มั่นใจได้ว่า Olmo232B สามารถมีทักษะภาษาที่แข็งแกร่งและพิถีพิถัน

นอกเหนือจากประสิทธิภาพที่ยอดเยี่ยม Olmo232B ยังแสดงให้เห็นถึงความแข็งแกร่งที่น่าทึ่งในประสิทธิภาพการฝึกอบรม ได้มีการกล่าวกันว่าใช้ทรัพยากรการคำนวณประมาณหนึ่งในสามในขณะที่ถึงระดับประสิทธิภาพที่เทียบเท่ากับโมเดลน้ำหนักเปิดชั้นนำเมื่อเทียบกับรุ่นเช่น QWEN2.532B ต้องใช้กำลังการคำนวณมากขึ้น มันเหมือนกับช่างฝีมือที่มีประสิทธิภาพซึ่งทำงานได้เหมือนกันหรือดีกว่าด้วยเครื่องมือและเวลาที่น้อยลง

การเปิดตัวของ Olmo232B ไม่เพียง แต่เป็นโมเดล AI ใหม่เท่านั้น แต่ยังเป็นสัญลักษณ์ของเหตุการณ์สำคัญที่สำคัญในเส้นทางการพัฒนาของ AI ที่เปิดกว้างและเข้าถึงได้ ด้วยการจัดหาโซลูชันที่เปิดกว้างและมีความสามารถอย่างสมบูรณ์ซึ่งเปรียบได้กับหรือเกินกว่าโมเดลที่เป็นกรรมสิทธิ์บางอย่าง AI2 แสดงให้เห็นอย่างยิ่งว่าการออกแบบแบบจำลองอย่างระมัดระวังและวิธีการฝึกอบรมที่มีประสิทธิภาพสามารถนำไปสู่การพัฒนาครั้งใหญ่ การเปิดกว้างนี้จะส่งเสริมให้นักวิจัยและนักพัฒนาทั่วโลกมีส่วนร่วมอย่างแข็งขันส่งเสริมความก้าวหน้าในด้านปัญญาประดิษฐ์และในที่สุดก็เป็นประโยชน์ต่อสังคมมนุษย์ทั้งหมด

อาจคาดการณ์ได้ว่าการเกิดขึ้นของ Olmo232B จะนำอากาศบริสุทธิ์ไปสู่การวิจัย AI ไม่เพียง แต่ลดเกณฑ์การวิจัยส่งเสริมความร่วมมือที่กว้างขึ้น แต่ยังแสดงให้เราเห็นเส้นทางที่มีพลวัตและนวัตกรรมมากขึ้นในการพัฒนา AI สำหรับยักษ์ใหญ่ AI ที่ยังคงมี "สูตรลับพิเศษ" อย่างแน่นหนาพวกเขาควรพิจารณาด้วย โดยการยอมรับความเปิดกว้างเท่านั้นพวกเขาสามารถชนะอนาคตที่กว้างขึ้น

GitHub: https://github.com/allenai/olmo-core

HuggingFace: https: //huggingface.co/allenai/olmo-2-0325-32b-instruct