Официальный веб-сайт www.binance.com/zh-cn :введите официальный веб-сайт ☜☜

Приложение: ☞☞official App Download☜☜

Исследовательская группа в Калифорнийском университете, Беркли, недавно опубликовала результат прорывных исследований - модель TULIP (в направлении единого языкового изображения). Эта модель направлена на повышение производительности предварительного обучения на визуальном языке, особенно в задачах, ориентированных на зрение, требующих высокого понимания, и успешно преодолевает ограничения существующих моделей контрастного обучения (например, CLIP).

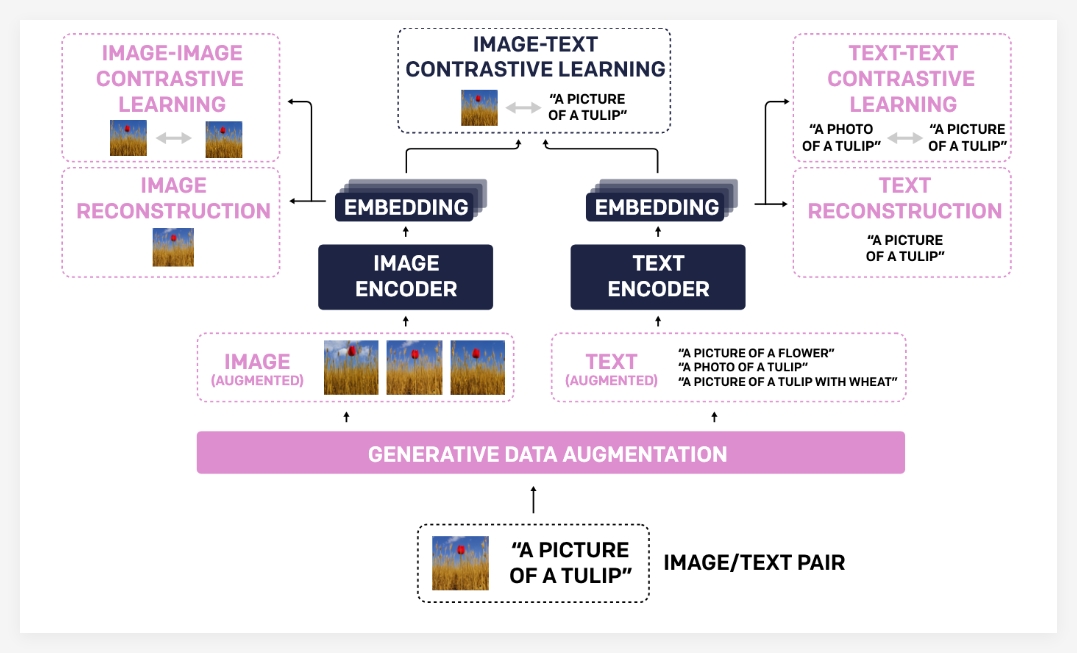

Модель тюльпана значительно улучшает согласование между зрения и языка за счет инновационных технологий, таких как интегрированное увеличение генеративных данных, улучшение контрастного обучения и регуляризацию реконструкции. Результаты эксперимента показывают, что TULIP достиг современной производительности в нескольких критериях, установив новый эталон для классификации с нулевым образцом и рассуждения о визуальном языке.

Причина, по которой модель тюльпана достигла такого значительного прогресса, в основном связана с его уникальным технологическим портфелем. Во -первых, увеличение генеративных данных использует генеративные модели для расширения данных обучения, тем самым улучшая способность модели и обобщения. Синтезируя более разнообразные пар изображений, модель может изучить более полные визуальные и лингвистические знания.

Во -вторых, улучшенное контрастное обучение отличается от традиционных методов контрастного обучения. Tulip не только фокусируется на сопоставлении между изображениями и текстами, но и вводит цели изображения и текстового текста сравнения. Этот улучшенный метод контрастного обучения может помочь моделям лучше понять визуальные сходства между различными изображениями и семантическими ассоциациями между различными описаниями текста, тем самым улучшая их понимание мелкозернистой информации.

Наконец, регуляризация реконструкции еще больше усиливает выравнивание визуальных и лингвистических особенностей. Этот метод позволяет модели реконструировать соответствующее описание текста из функций изображения или соответствующих изображений из текстовых функций, тем самым заставляя модель изучать более глубокие кросс-модальные ассоциации.

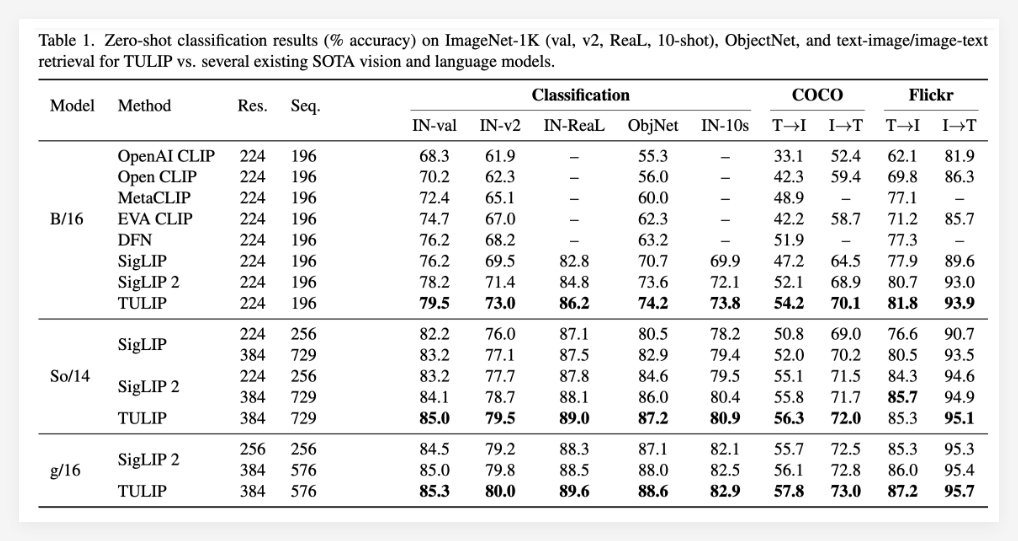

Экспериментальные результаты полностью доказывают превосходство модели тюльпана. Сообщалось, что тюльпан достиг актуальных оптимальных уровней в многочисленных важных критериях визуального и визуального языка (современный). Специфические характеристики включают в себя: значительное улучшение в классификации ImageNet-1K с нулевым образцом, улучшенные возможности распознавания мелкозернистых объектов и улучшенные многомодальные показатели вывода.

Особенно стоит упомянуть, что по сравнению с существующими методами TULIP достиг до 3 раза улучшения производительности в контрольных показателях MMVP, а также достиг 2 раза улучшения производительности в тонко настроенных визуальных задачах. Эти данные полностью демонстрируют большой потенциал тюльпана в улучшении производительности модели.

Проект: https://tulip-berkeley.github.io/