Отчет редактора Downcodes: Команда Google DeepMind недавно совершила крупный прорыв и успешно разработала инновационную технологию под названием SCoRe (Self-Correction Through Reinforcement Learning), которая может эффективно решить проблему самокоррекции больших языковых моделей (LLM). В отличие от предыдущих методов, которые основывались на нескольких моделях или внешней проверке, SCoRe может самостоятельно выявлять и исправлять ошибки, что дает новую надежду на надежность и точность моделей ИИ. Суть этой технологии заключается в уникальном двухэтапном методе обучения с подкреплением. Модель постоянно совершенствует свои возможности исправления ошибок посредством самообучения и совершенствования.

Исследовательская группа Google DeepMind недавно совершила крупный прорыв и разработала инновационную технологию под названием SCoRe (Self-Correction Through Reinforcement Learning, самокоррекция посредством обучения с подкреплением). Эта технология направлена на решение давней проблемы, заключающейся в том, что большие языковые модели (LLM) испытывают проблемы с самокоррекцией, выявлением и исправлением ошибок, не полагаясь на несколько моделей или внешние проверки.

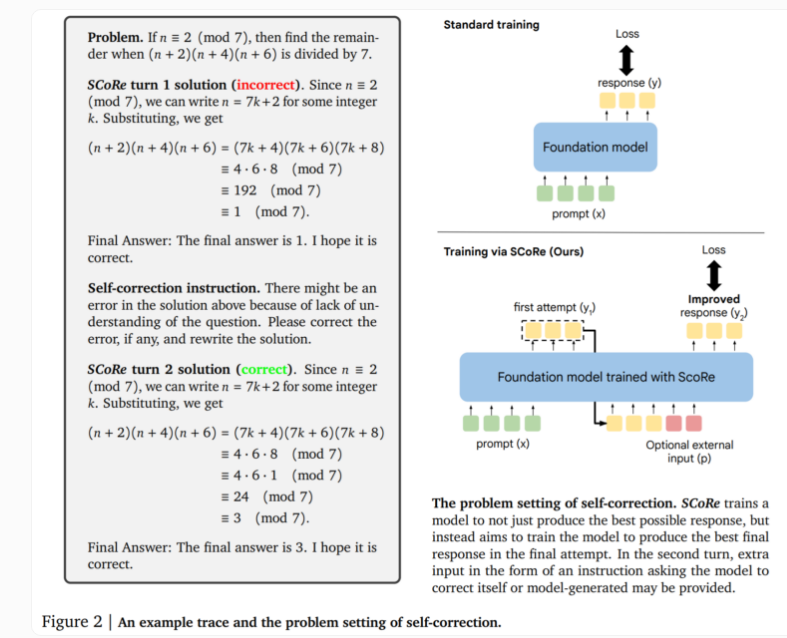

Суть технологии SCoRe заключается в ее двухэтапном подходе. На первом этапе инициализация модели оптимизируется так, чтобы она могла генерировать исправления со второй попытки, сохраняя при этом сходство первоначального ответа с базовой моделью. На втором этапе используется многоэтапное обучение с подкреплением, чтобы научить модель улучшать первый и второй ответы. Этот подход уникален тем, что он использует только самостоятельно сгенерированные данные обучения, а модель создает свои собственные примеры, решая проблему и пытаясь улучшить решение.

В реальных тестах SCoRe показал значительное улучшение производительности. Тесты с использованием моделей Google Gemini 1.0 Pro и 1.5 Flash показали улучшение самокоррекции на 15,6 процентных пункта при выполнении задачи математического рассуждения в тесте MATH. В задаче генерации кода HumanEval производительность улучшилась на 9,1 процентных пункта. Эти результаты демонстрируют, что SCoRe добилась существенного прогресса в улучшении возможностей самокоррекции моделей ИИ.

Исследователи подчеркивают, что SCoRe — это первый метод достижения значимой положительной внутренней самокоррекции, позволяющий модели улучшать свои ответы без внешней обратной связи. Однако текущая версия SCoRe выполняет только один раунд обучения самокоррекции, и будущие исследования могут изучить возможность нескольких этапов коррекции.

Исследование команды DeepMind выявило важное открытие: обучение самокорректирующимся метастратегиям требует выхода за рамки стандартных методов обучения языковой модели. Многоэтапное обучение с подкреплением открывает новые возможности в области искусственного интеллекта и, как ожидается, будет способствовать разработке более умных и надежных систем искусственного интеллекта.

Эта революционная технология не только демонстрирует потенциал самосовершенствования ИИ, но и предлагает новые идеи для решения проблем надежности и точности крупномасштабных языковых моделей, которые могут оказать глубокое влияние на разработку будущих приложений ИИ.

Появление технологии SCoRe знаменует собой важную веху в области возможностей самокоррекции в области искусственного интеллекта, закладывая прочную основу для создания более надежных и интеллектуальных систем искусственного интеллекта. Редактор Downcodes надеется на применение технологии SCoRe в большем количестве областей в будущем, что придаст новый импульс развитию искусственного интеллекта.