Этот репозиторий направлен на отслеживание прогресса в связывании сущности. Исследования о том, как подготовить представления субъекта, также перечислены, поскольку представления сущности являются обязательными при связывании организации.

Ауторегрессивный извлечение сущности

Традиционные системы связывания сущностей страдают от потребления памяти из -за предварительного кодирования сущностей в базе знаний, вычислительных затрат ресурсов из -за сравнения всех объектов в базе знаний и проблем с холодным запуском.

Вместо предыдущей архитектуры они используют последовательность к последовательности, чтобы генерировать названия сущностей в авторегрессивной моде, обусловленной контексту. Они использовали ограниченный поиск луча, вынуждая только декодировать только допустимый идентификатор сущности.

Связывание сущностей с невидимыми базами знаний с произвольными схемами

Традиционные системы связывания сущностей предполагают, что схема базы знаний, которая связывает предсказанные сущности вместе, известна. Они предложили новый метод для преобразования схемы неизвестных сущностей в BERT Enlging с использованием атрибутов и вспомогательных токенов.

В то же время они также предложили метод обучения для борьбы с неизвестными атрибутами.

В Media Res: корпус для оценки названной организации, связывающей с творческими работами [Paper] [коды]

Люк: Глубокие контекстуализированные представления сущности с самоуничтожением с учетом сущности [ссылка] [коды]

Они предложили новую предварительную задачу, основанную на Берте, в которой случайно маскированные слова и сущности предсказываются в корпусе, аннотируемом организацией из Википедии.

Также в предварительном задании они предложили расширенную версию трансформатора, которая рассматривает самоуничтожение с учетом сущности и типы токенов (слов или сущностей) при вычислении баллов внимания.

Масштабируемая сущность с нулевым выстрелом, связывающая с плотным извлечением сущности

Сущность, связывающая на 100 языках [бумага]

Cometa: корпус для медицинской организации, связывающего в социальных сетях [Paper]

Связь с нулевым выстрелом, связывающая с эффективным моделированием последовательности длинных диапазонов [Paper]

От нуля до героя: сущность человека в петле, связывающая с низкими ресурсными областями [ссылка]

Улучшение сущности, связывающегося с помощью семантических усиленных сущностей

Предварительная энциклопедия: слабо контролируемая языковая модель, представленная на знаниях (ICLR'20) [Paper]

K-адаптер: внедрение знаний в предварительно обученные модели с адаптерами [Paper]

Улучшение связывания сущности путем моделирования информации о типе скрытой организации (AAAI'20)

Организация с нулевым выстрелом, связывающая с плотной линейкой линии (10-е, ноябрь) бумагой

Аналогично [Logeswaran, et al., Acl'19] и [Gillick, et al., Conll'19]

слайды (неофициальные)

Организация, связывающая с помощью двойных и перекрестных энкодеров [arxiv]

Мелкозернистая оценка для связывания сущности (EMNLP'19)

Динамическое увеличение контекста обучения для связывания глобальной сущности (EMNLP'19)

Мелкозернистая сущность печатает для связывания независимого домена.

Исследуя знания сущности в BERT с простой нейронной сквозной сущностью, связывающим (Conll '19) [Paper]

Учебное обучение плотное представление для поиска сущности (Conll '19)

бумага, репо

Они не предложили использовать таблицу псевдонимов (которая была основана на статистике Википедии или подготовленной) и искала все объекты с помощью грубой силы/приблизительного ближайшего поиска связывания сущностей за упоминание.

Enteval: Целостный эталон оценки для представлений сущности (EMNLP '19)

Учебные предприятия для реконструкции категорий Википедии (ICLR '19)

Знание улучшает контекстуальные представления слов (EMNLP '19) [Paper]

Тенденции использования всей информации (например, тип и определение упоминания и документы, в которых упоминается, и т. Д.) Похоже, что искажают.

Хотя домен Википедии может использовать свою гиперссылку (= пары упоминания, около 7 500 000) для обучения модели связывания, в некоторых специфических для доменах ситуаций не так много пар упоминания.

Следовательно, некоторые статьи в настоящее время бросают вызов отдаленному обучению и нулевым выстрелу, связывающим сущность.

Далекое обучение

Отдаленное обучение для сущности, связывающегося с автоматическим обнаружением шума

слайды (неофициальные)

Они предложили создать проблему EL как отдаленную проблему обучения, в которой не доступны маркированные учебные данные, и модель отмены этой задачи.

Повышение уровня, связывающая производительность, используя немеченые документы

Связывание с нулевым выстрелом

Связание с нулевым выстрелом, читая описания сущностей

слайды (неофициальные)

Они предложили Zero-Shot EL, под которым не можно увидеть никаких упоминаний о тесте во время обучения. Для борьбы с Zero-Shot EL они предложили адаптивную стратегию для модели до тренировок. Кроме того, они показали, что описание упоминания о перекрестном активации имеет решающее значение для EL.

Обучение на основе Берта также появилось.

(Прокомментировано @ Nov, 19 ') В те дни исследования для улучшения самой модели , связывающей сущность, процветали.

Стиль жирный шрифт указывает на его оценку SOTA определенного набора данных.

| Базовые модели | Год | Набор данных | код | Бегать? | Кодовый адрес |

|---|---|---|---|---|---|

| Сущность, связывающая с помощью совместного кодирования типов, описаний и контекста | EMNLP2017 | Conll-Yago (82,9, ACC), ACE2004, ACE2005, Wiki ( 89,0 , F1) | Tensorflow | Загружена только модель Traind | здесь |

| ┗ (очень похоже на вышеупомянутое) совместный многоязычный надзор для перекрестной линии, связывающий | EMNLP2018 | TH-тест, MCN-тест, TAC2015 | Пирог | Проверка | здесь |

| Нейронная коллективная сущность связывания (Ncel) | CL2018 | Conll-Yago, ACE2004, Aquaite, TAC2010 ( 91.0 , MIC-P), WW | пирог | Ошибка | здесь |

| Улучшение связывания сущности путем моделирования скрытых отношений между упоминаниями | ACL2018 | Conll-Yago ( 93,07 , MIC-ACC), Aquate, ACE2004, CWEB, Wiki (84,05, F1) | пирог | Оценка сделана | здесь |

| Элден | NAACL2018 | Conll-ppd (93,0, P-Mic), TAC2010 (89,6, MIC-P) | Луа, Факел (Луа) | Ошибка | здесь |

| Глубокое совместное неоднозначение с местным нервным вниманием | EMNLP2017 | Conll-Yago (92,22, MIC-ACC), CWEB, WW, ACE2004, Aquitain, MSNBC | Луа, Факел (Луа) | Поезда бег (2019/01/15) | здесь |

| Иерархические потери и новые ресурсы для мелкообразного набора и связывания сущностей | ACL2018 | Мединг, типоль | пирог | Ошибка | здесь |

| Совместное изучение внедрения слов и сущностей для неоднозначности названной сущности (Yamada, Shindo) | Conll2016 | Conll-Yago (91,5, MIC-ACC), Conll-PPD (93.1, P-MIC), TAC2010 (85,5, MIC-ACC) | pytorch/tensorflow (оригинал), | Проверка | Базовый оригинал |

| Обучение Распределенным представлениям текстов и организаций из базы знаний (Yamada, Shindo) | ACL2017 | Conll-ppd ( 94,7 , P-Mic), TAC2010 (87,7, MIC-ACC) | pytorch/keras (оригинал) | Проверка | Факел, факел, оригинал |

Примечание. Основные наборы данных для сравнения этой задачи перечислены в репозитории Blink.

Набор данных Mewsli-9

Биомедицинский

Медицины ([Мохан и Ли, AKBC '19])

Medmentions был создан в качестве контрольного набора данных для распознавания именных объектов и связывания сущности в биомедицинской области.

Поскольку он содержит много концепций, которые слишком широки, чтобы быть полезными, ST21PV был построен путем фильтрации этих широких концепций из медицины.

Bc5cdr ([li et al., '15'])

BC5CDR - это набор данных, созданный для задачи по проведению химического вещества и заболевания.

Он состоит из 1500 статей, содержащих 15 935 химических и 12 852 упоминаний о заболеваниях.

Справочная база знаний - это сетка, и почти все упоминания имеют золотую сущность в базе справочников.

Wikimed и Pubmedds ([Shikhar et al., '20])

Wikimed включает в себя более 650 000 упоминаний, нормализованных в концепции в UML. (Цитируется)

Кроме того, они создали аннотированные корпусные Pubmedds с более чем 5 миллионами нормализованных упоминаний. Обратите внимание, что этот набор данных был создан отдаленным надзором, что приводит к созданию некоторых шумных аннотаций.

Нулевой выстрел

Наборы данных Wikia ([Logeswaran et al., '19])

Из гиперссылок Wikia и связанных с ним тем, они создали набор данных для оценки обобщения доменной задачи, связанной с объектами.

Они создали 16 наборов данных мира , которые были разделены на 8/4/4 для Train / Dev / Test и полностью независимы друг от друга.

Поскольку [Gillick et al., Conll'19], во-первых, предложенных би- (или, двойных) систем поиска энкодеров для связывания сущностей, некоторые документы также используют BERT для них. Оригинальная идея для системы поиска на основе бикодера также предлагается [Gillick et al., '18]

Поли-кодер также может применяться к связующему сущности, как показали Wu et al., 2020.

Кодер на основе трансформатора часто принимается для упоминания и кодирования сущности.

Некоторые исследования сейчас пытаются включить информацию KB с Bert.

Кеплер: унифицированная модель для встраивания знаний и предварительно обученного языка

Интеграция контекстуализированных знаний в предварительно обученные языковые модели (работа в прогрессе @ Dec, '19)

K-Bert: Включение языкового представления с графом знаний

[Petroni, et al., '19] проверили, обладает ли сам Берт фактические знания.

Bi-Encoder, основанный на организации, связывающий учебник и его реализацию. [связь]

Появилась комплексная статья о связывании сущности.

(Прокомментировано @ март 2020 г.) В настоящее время этот репозиторий включает в себя документы для обоих организаций, связанных с организацией, так и в организации LM. Первый требует представления кодировки сущности для неоднозначности, в то время как последний означает, что во время обучения во время обучения во время обучения вводится знания сущности. Таким образом, они совершенно разные, хотя некоторые работы объекта LM оценили свою модель с неоднозначным делом сущностью. Мы разделим их в этом репозитории, в ближайшем будущем.

Крестовые документы EL.

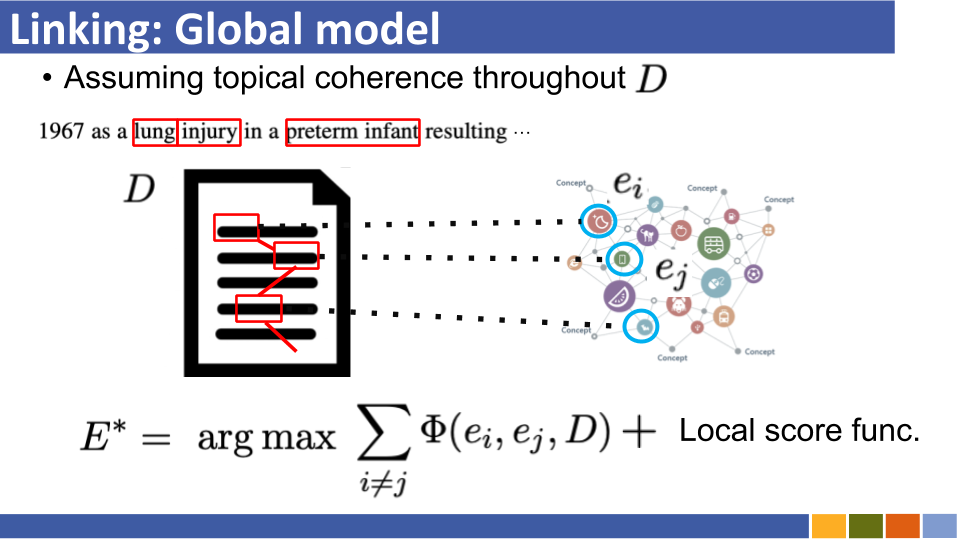

Цитируется из Gupta et al. (EMNLP '18)

Крестовая сущность, связывающая (Xel), направлена на то, чтобы назвать упоминания сущности, написанные на любом языке на английскую базу знаний (KB), такую как Википедия.

Совместный многоязычный надзор за перекрестной организацией связывания (EMNLP '18)

На пути к перекрестному сущности с нулевым ресурсом (Shuyan et al., Emnlp Workshop '19)

Сущность, ссылаясь на шумные/короткие тексты

Агрегированное семантическое сопоставление для короткого текстового объекта связывания (ACL'18) [Paper]

Эффективное использование контекста в шумной сущности (EMNLP'18) [Paper]

Мультимодальная сущность связывает

Некоторые другие документы

Список сущности, связывающий бумагу

Совместное изучение признания именных организаций и связывания объекта, связывающих бумагу