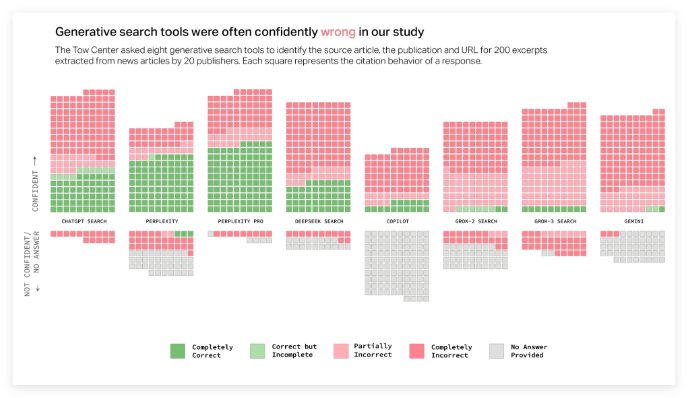

Um estudo recente sobre mecanismos de busca de IA revelou sérios problemas no processamento de informações de notícias. O Digital News Center da Columbia News Review (CJR) realizou testes detalhados em oito ferramentas de IA com recursos de pesquisa em tempo real, e os resultados foram chocantes: mais de 60% das consultas de notícias receberam respostas imprecisas. Essa descoberta atraiu atenção pública generalizada para a confiabilidade da tecnologia de IA.

Pesquisas mostram que existem diferenças significativas nas taxas de erro entre diferentes plataformas de IA. Entre eles, a taxa de erro do GROK3 é tão alta quanto 94%, enquanto a taxa de erro da pesquisa do ChatGPT também é tão alta quanto 67%. Vale ressaltar que mesmo versões pagas, como o Perplexity Pro e os serviços premium da Grok3, não evitaram respostas frequentes, mas incorretas. Os pesquisadores apontam especificamente que esses modelos de IA têm uma tendência generalizada de "com confiança", ou seja, quando há uma falta de informações confiáveis, não optam por rejeitar respostas, mas tendem a fabricar respostas erradas aparentemente razoáveis.

Além disso, a pesquisa também revela os problemas de citação dos mecanismos de busca de IA. Essas ferramentas geralmente direcionam os usuários para uma plataforma de publicação conjunta para conteúdo de notícias, em vez do site do editor original. O mais sério é que algumas ferramentas de IA fabricam links de URL inválidos, fazendo com que os usuários não possam acessar a fonte de informação. Por exemplo, mais da metade dos links de referência do GROK3 foram inválidos no teste, o que exacerbou ainda mais a dificuldade de obter informações.

Essas questões representam um sério desafio aos editores de notícias. Se os rastreadores de AI forem impedidos de rastejar o conteúdo, o conteúdo pode perder completamente sua assinatura; Embora o rastreamento possa enfrentar o dilema do conteúdo amplamente utilizado, mas não poder ser transportado de volta ao seu próprio site. O diretor de operações do Times, Mark Howard, expressou profundas preocupações sobre isso, destacando a necessidade de transparência e controle.

Os pesquisadores observaram que cerca de um quarto dos americanos agora usaram os modelos de IA como um substituto para os mecanismos de pesquisa tradicionais, e uma taxa de erro tão alta está preocupada com a confiabilidade das informações. O estudo confirma ainda um relatório semelhante divulgado em novembro passado, que também aponta para os problemas de precisão que o ChatGPT possui ao lidar com o conteúdo de notícias. Embora o OpenAI e a Microsoft tenham reconhecido o recebimento dos resultados da pesquisa, eles não responderam diretamente a perguntas específicas, o que desencadeou mais dúvidas do público sobre a transparência da tecnologia de IA.

Para resumir, as altas taxas de erro dos mecanismos de pesquisa de IA, citações confusas e baixo desempenho dos serviços pagos no processamento de informações de notícias indicam que ainda existem muitas deficiências na tecnologia atual. À medida que o papel da IA na aquisição de informações se torna cada vez mais importante, resolver esses problemas se tornou uma tarefa urgente.