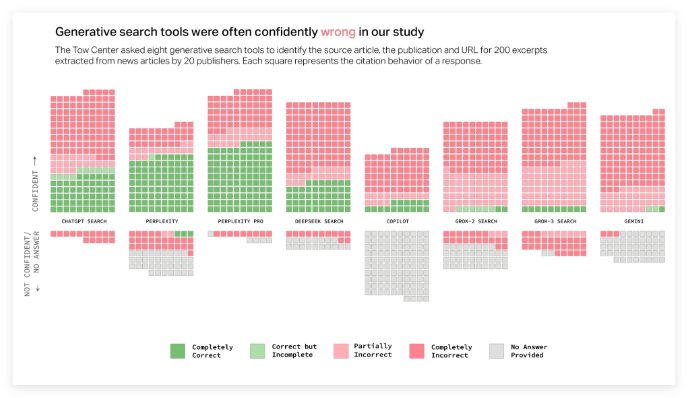

Eine kürzlich durchgeführte Studie zu KI -Suchmaschinen ergab ernsthafte Probleme bei der Verarbeitung von Nachrichteninformationen. Das digitale Nachrichtenzentrum von Columbia News Review (CJR) führte eingehende Tests an acht KI-Tools mit Echtzeit-Suchfunktionen durch, und die Ergebnisse waren schockierend: Mehr als 60% der Nachrichtenanfragen erhielten ungenaue Antworten. Diese Entdeckung hat die öffentliche Aufmerksamkeit auf die Zuverlässigkeit der KI -Technologie gelenkt.

Untersuchungen zeigen, dass es signifikante Unterschiede in der Fehlerraten zwischen verschiedenen KI -Plattformen gibt. Unter ihnen beträgt die Fehlerrate von GROK3 bis zu 94%, während die Fehlerrate der ChatGPT -Suche ebenfalls bis zu 67%beträgt. Es ist erwähnenswert, dass selbst bezahlte Versionen, wie z. Die Forscher weisen ausdrücklich darauf hin, dass diese KI -Modelle eine weit verbreitete Tendenz haben, „zuversichtlich falsch“ zu sein, dh wenn es an zuverlässigen Informationen fehlt, entscheiden sie sich nicht dafür, Antworten abzulehnen, sondern tendenziell anscheinend vernünftige falsche Antworten herzustellen.

Darüber hinaus zeigt die Forschung auch die Zitierprobleme von KI -Suchmaschinen. Diese Tools leiten Benutzer häufig auf eine gemeinsame Verlagsplattform für Nachrichteninhalte als auf die Original -Publisher -Website. Was ernsthafter ist, ist, dass einige KI -Tools sogar ungültige URL -Links herstellen, was dazu führt, dass Benutzer nicht auf die Informationsquelle zugreifen können. Beispielsweise waren im Test mehr als die Hälfte der Referenzverbindungen von GROK3 ungültig, was die Schwierigkeit, Informationen zu erhalten, weiter verschärft.

Diese Themen stellen Nachrichtenverlage eine ernsthafte Herausforderung dar. Wenn KI -Crawler daran gehindert werden, Inhalte zu kriechen, kann der Inhalt seine Signatur vollständig verlieren. Während das Crawling dem Dilemma des Inhalts ausgesetzt sein mag, der weit verbreitet ist, aber nicht in der Lage ist, auf eine eigene Website zurückgeführt zu werden. Mark Howard, Chief Operating Officer von Times, äußerte sich tiefe Bedenken darüber und hob die Notwendigkeit von Transparenz und Kontrolle hervor.

Die Forscher stellten fest, dass etwa ein Viertel der Amerikaner inzwischen AI -Modelle als Ersatz für traditionelle Suchmaschinen verwendet haben, und eine so hohe Fehlerrate ist besorgt über die Zuverlässigkeit von Informationen. Die Studie bestätigt ferner einen ähnlichen Bericht, der im November im vergangenen November veröffentlicht wurde, was auch auf die Genauigkeitsprobleme hinweist, die ChatGPT beim Umgang mit Nachrichteninhalten hat. Obwohl OpenAI und Microsoft die Erzielung von Forschungsergebnissen anerkannten, antworteten sie nicht direkt auf spezifische Fragen, was weitere öffentliche Zweifel an der Transparenz der KI -Technologie auslöste.

Zusammenfassend lässt sich sagen, dass die hohen Fehlerquoten von AI -Suchmaschinen, die verwirrenden Zitate und die schlechte Leistung von bezahlten Diensten in der Verarbeitung von Nachrichteninformationen zeigen, dass alle noch viele Mängel in der aktuellen Technologie vorhanden sind. Da die Rolle der KI beim Informationserwerb immer wichtiger wird, ist die Lösung dieser Probleme zu einer dringenden Aufgabe geworden.