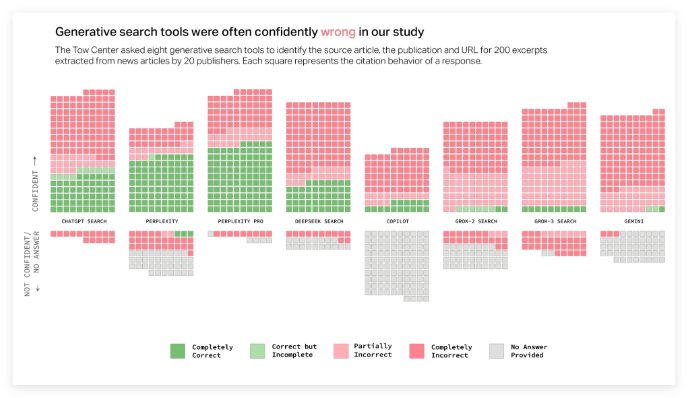

كشفت دراسة حديثة عن محركات البحث عن الذكاء الاصطناعي عن مشاكل خطيرة في معالجة معلومات الأخبار. أجرى مركز الأخبار الرقمي لـ Columbia News (CJR) اختبارات متعمقة على ثماني أدوات من الذكاء الاصطناعي مع قدرات البحث في الوقت الفعلي ، وكانت النتائج مروعة: تلقى أكثر من 60 ٪ من استفسارات الأخبار إجابات غير دقيقة. اجتذب هذا الاكتشاف اهتمامًا واسعًا على نطاق واسع بموثوقية تقنية الذكاء الاصطناعي.

تظهر الأبحاث أن هناك اختلافات كبيرة في معدلات الخطأ بين منصات الذكاء الاصطناعي المختلفة. من بينها ، معدل الخطأ Grok3 يصل إلى 94 ٪ ، في حين أن معدل الخطأ في البحث عن ChatGPT يرتفع إلى 67 ٪. تجدر الإشارة إلى أنه حتى الإصدارات المدفوعة ، مثل خدمات Proplexity Pro و Grok3 الممتازة ، فشلت في تجنب الإجابات المتكررة والثقة ولكن غير صحيحة. يشير الباحثون على وجه التحديد إلى أن نماذج الذكاء الاصطناعي هذه لها ميل واسع النطاق إلى "الخطأ بثقة" ، أي عندما يكون هناك نقص في معلومات موثوقة ، فإنهم لا يختارون رفض الإجابات ، ولكن يميلون إلى تلفيق إجابات خاطئة معقولة على ما يبدو.

بالإضافة إلى ذلك ، يكشف البحث أيضًا عن مشاكل الاقتباس في محركات بحث الذكاء الاصطناعي. غالبًا ما توجه هذه الأدوات المستخدمين إلى نظام نشر مشترك لمحتوى الأخبار بدلاً من موقع الناشر الأصلي. الأمر الأكثر جدية هو أن بعض أدوات الذكاء الاصطناعى تتصنع روابط عناوين URL غير صالحة ، مما يتسبب في عدم قدرة المستخدمين على الوصول إلى مصدر المعلومات. على سبيل المثال ، كانت أكثر من نصف الروابط المرجعية لـ Grok3 غير صالحة في الاختبار ، مما أدى إلى تفاقم صعوبة الحصول على المعلومات.

هذه القضايا تشكل تحديًا خطيرًا لناشري الأخبار. إذا تم منع زحف الذكاء الاصطناعي من الزحف ، فقد يفقد المحتوى توقيعه تمامًا ؛ على الرغم من أن الزحف قد يواجه معضلة المحتوى المستخدم على نطاق واسع ولكن لا يمكن نقله إلى موقعه على الويب. أعرب كبير مسؤولي العمليات في تايمز مارك هوارد عن مخاوف عميقة حول هذا الموضوع ، مع تسليط الضوء على الحاجة إلى الشفافية والسيطرة.

لاحظ الباحثون أن حوالي ربع الأميركيين قد استخدموا نماذج الذكاء الاصطناعى الآن كبديل لمحركات البحث التقليدية ، وأن معدل الخطأ المرتفع هذا يقلق على موثوقية المعلومات. تؤكد الدراسة كذلك تقريرًا مشابهًا تم إصداره في نوفمبر الماضي ، والذي يشير أيضًا إلى مشكلات الدقة التي لدى ChatGPT عند التعامل مع محتوى الأخبار. على الرغم من أن Openai و Microsoft أقروا بتلقي نتائج البحث ، إلا أنهما لم يردوا مباشرة على أسئلة محددة ، مما أثار المزيد من الشكوك العامة حول شفافية تكنولوجيا الذكاء الاصطناعى.

خلاصة القول ، تشير معدلات الأخطاء المرتفعة لمحركات البحث في الذكاء الاصطناعي ، والاستشهادات المربكة وضعف الأداء للخدمات المدفوعة في معالجة المعلومات الإخبارية ، إلى أنه لا يزال هناك العديد من أوجه القصور في التكنولوجيا الحالية. نظرًا لأن دور الذكاء الاصطناعي في الحصول على المعلومات يصبح مهمًا بشكل متزايد ، فقد أصبح حل هذه المشكلات مهمة ملحة.