Un estudio reciente sobre los motores de búsqueda de IA reveló serios problemas en el procesamiento de la información de noticias. El centro de noticias digitales de Columbia News Review (CJR) realizó pruebas en profundidad en ocho herramientas de IA con capacidades de búsqueda en tiempo real, y los resultados fueron impactantes: más del 60% de las consultas de noticias recibieron respuestas inexactas. Este descubrimiento ha atraído la atención pública generalizada a la confiabilidad de la tecnología de IA.

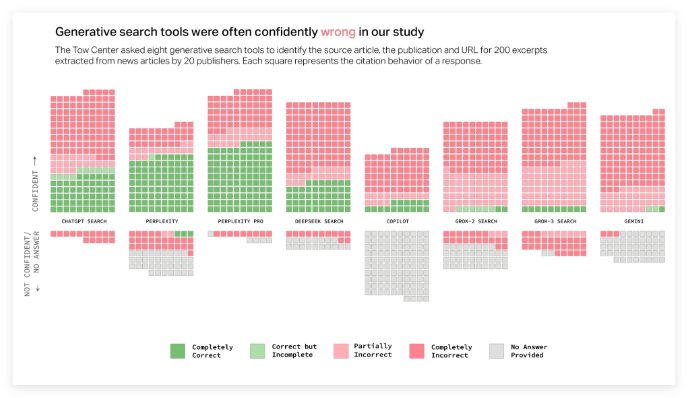

La investigación muestra que existen diferencias significativas en las tasas de error entre las diferentes plataformas de IA. Entre ellos, la tasa de error de GROK3 es tan alta como 94%, mientras que la tasa de error de la búsqueda de chatGPT también es tan alta como 67%. Vale la pena señalar que incluso las versiones pagas, como los servicios premium de Perplexity Pro y Grok3, no han podido evitar respuestas frecuentes seguras pero incorrectas. Los investigadores señalan específicamente que estos modelos de IA tienen una tendencia generalizada a "confidentemente mal", es decir, cuando hay una falta de información confiable, no eligen rechazar las respuestas, pero tienden a fabricar respuestas incorrectas aparentemente razonables.

Además, la investigación también revela los problemas de citas de los motores de búsqueda de IA. Estas herramientas a menudo dirigen a los usuarios a una plataforma de publicación conjunta para contenido de noticias en lugar del sitio web original del editor. Lo más serio es que algunas herramientas de IA incluso fabrican enlaces de URL no válidos, lo que hace que los usuarios no puedan acceder a la fuente de información. Por ejemplo, más de la mitad de los enlaces de referencia de GROK3 no fueron válidos en la prueba, lo que exacerbó aún más la dificultad de obtener información.

Estos problemas plantean un desafío serio para los editores de noticias. Si se evita que los rastreadores de IA se arrastren, el contenido puede perder su firma por completo; Si bien el gateo puede enfrentar el dilema del contenido que se usa ampliamente, pero no puede ser transportado de regreso a su propio sitio web. El director de operaciones de los tiempos, Mark Howard, expresó profundas preocupaciones sobre esto, destacando la necesidad de transparencia y control.

Los investigadores señalaron que aproximadamente una cuarta parte de los estadounidenses ahora han utilizado modelos de IA como reemplazo para los motores de búsqueda tradicionales, y una tasa de error tan alta es preocupante por la confiabilidad de la información. El estudio confirma además un informe similar publicado en noviembre pasado, que también señala los problemas de precisión que ChatGPT tiene cuando se trata de contenido de noticias. Aunque Openai y Microsoft reconocieron haber recibido resultados de investigación, no respondieron directamente a preguntas específicas, lo que desencadenó más dudas públicas sobre la transparencia de la tecnología de IA.

En resumen, las altas tasas de error de los motores de búsqueda de IA, confundiendo las citas y el bajo rendimiento de los servicios remunerados en el procesamiento de información de noticias, todos indican que todavía hay muchas deficiencias en la tecnología actual. A medida que el papel de AI en la adquisición de información se vuelve cada vez más importante, resolver estos problemas se ha convertido en una tarea urgente.