| | | | 中文文档

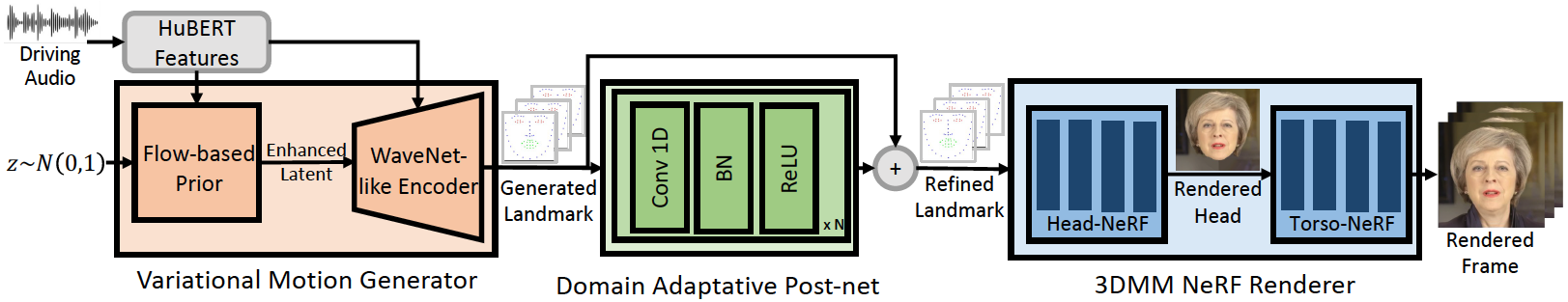

이 저장소는 ICLR-2023 용지의 공식 Pytorch 구현으로, 일반화 된 고 충실한 오디오 중심의 대화 생성에 대한 Geneface를 제안합니다. 추론 파이프 라인은 다음과 같습니다.

우리의 Geneface는 도메인 외 오디오에 대한 더 나은 립 동기화와 표현력을 달성합니다. 이전 NERF 기반 방법에 대한 명확한 립스 동기 비교를 위해이 비디오를보십시오. 자세한 내용은 프로젝트 페이지를 방문 할 수도 있습니다.

우리는 SOTA NERF 기반의 개인-특이 적 말하는 얼굴 방법 인 Mimictalk 코드 (https://github.com/yerfor/mimictalk/)를 발표했으며 더 나은 시각적 품질을 달성하고 대화 스타일 제어를 가능하게합니다.

우리는 Geneface ++ 코드 (https://github.com/yerfor/genefaceplusplus/)를 발표했으며, 이는 업그레이드 된 Geneface 버전이며 더 나은 립시 동성, 비디오 Qaulity 및 시스템 효율성을 달성합니다.

2023.3.16 우리는이 릴리스에서 큰 업데이트를 발표합니다. 비디오 데모가 여기에 있습니다. 1) RAD-NERF 기반 렌더러, 실시간으로 유추하고 10 시간 안에 교육을받을 수 있습니다. 2) Pytorch 기반 Deep3D_Reconstruction 모듈은 설치가 쉽고 이전 TF 기반 버전보다 8 배 빠릅니다. 3) 더 많은 립스 동성 랜드 마크를 생성 할 수있는 피치 인식 오디오 2motion 모듈. 4) 메모리 사용이 큰 버그를 수정하십시오. 5)이 업데이트에 대한 논문을 곧 업로드하겠습니다.2023.2.222023.2.20 우리는 inference/nerfs/lm3d_nerf_infer.py 에서 안정적인 3D 랜드 마크 사후 처리 전략을 발표하여 최종 결과의 안정성과 품질을 큰 마진으로 향상시킵니다. 우리는이 릴리스에서 미리 훈련 된 모델과 처리 된 데이터 세트를 제공하여 빠른 시작을 가능하게합니다. 다음에서는 미리 훈련 된 모델을 4 단계로 추론하는 방법을 보여줍니다. 자신의 Target Person 비디오에서 Geneface를 훈련 시키려면 다음 섹션에 연락하십시오 ( Prepare Environments , Prepare Datasets 및 Train Models ).

1 단계. docs/prepare_env/install_guide.md 의 안내서에 이어 geneface 라는 새 파이썬 env를 만듭니다.

2 단계. 릴리스에서 lrs3.zip 및 May.zip 을 다운로드하여 checkpoints 디렉토리에 압축을 풀어주십시오.

STEP3. docs/process_data/process_target_person_video.md 의 안내서에 이어 May.mp4 의 데이터 세트를 처리하십시오. 그런 다음 data/binary/videos/May/trainval_dataset.npy 라는 출력 파일을 볼 수 있습니다.

위의 단계 후에, checkpoints 및 data 디렉토리의 구조는 다음과 같아야합니다.

> checkpoints

> lrs3

> lm3d_vae_sync

> syncnet

> May

> lm3d_postnet_sync

> lm3d_radnerf

> lm3d_radnerf_torso

> data

> binary

> videos

> May

trainval_dataset.npy

bash scripts/infer_postnet.sh

bash scripts/infer_lm3d_radnerf.sh

# bash scripts/infer_radnerf_gui.sh # you can also use GUI provided by RADNeRF

infer_out/May/pred_video/zozo.mp4 라는 출력 비디오를 찾을 수 있습니다.

docs/prepare_env 의 단계를 따르십시오.

docs/process_data 의 단계를 따르십시오.

docs/train_models 의 단계를 따르십시오.

이 repo에 제공된 May.mp4 외에도 실험에 사용 된 8 개의 대상 개인 비디오도 제공합니다. 이 링크에서 다운로드 할 수 있습니다. <video_id>.mp4 라는 새 비디오를 훈련 시키려면 제공된 예제 폴더 data/raw/videos/ May에 따라 egs/datasets/videos/<video_id> 에서 새 폴더를 작성하고 구성 폴더 egs/datasets/videos/May 작성해야합니다.

자신의 비디오를 녹음하고 자신을 위해 독특한 Geneface 모델을 훈련시킬 수도 있습니다!

@article{ye2023geneface,

title={GeneFace: Generalized and High-Fidelity Audio-Driven 3D Talking Face Synthesis},

author={Ye, Zhenhui and Jiang, Ziyue and Ren, Yi and Liu, Jinglin and He, Jinzheng and Zhao, Zhou},

journal={arXiv preprint arXiv:2301.13430},

year={2023}

}

당사 코드는 다음 저장소를 기반으로합니다.