Google DeepMind は、生成 AI ツールの悪用の主な傾向を明らかにする、悪意のある AI アプリケーションに関する画期的な調査レポートを発表しました。この研究では、世界中の生成型 AI、特に巨大な利益を追求して大手テクノロジー企業が市場に投入しているツールのリスクを調査しています。研究チーム DeepMind と Jigsaw は協力して数百の不正行為事例を分析し、これらのリスクを定量化し、将来の AI セキュリティ戦略にデータ サポートを提供することを目的としています。報告書では、偽情報の拡散、特に「ディープフェイク」の生成が最も一般的な悪意のあるAIアプリケーションとなっており、世論や政治プロセスに深刻な脅威を与えていることが判明した。

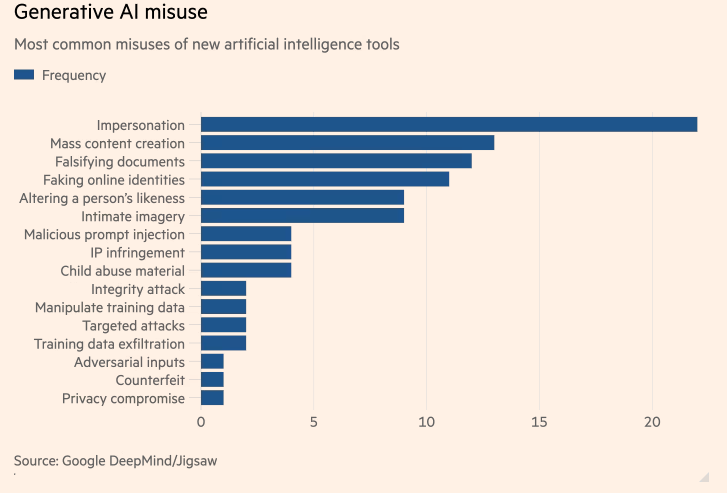

最も一般的な悪意のある AI アプリケーションに関する Google DeepMind による初の調査では、サイバー攻撃を支援するために AI を使用する試みよりも、偽の政治家や有名人を生成する人工知能 (AI) の「ディープフェイク」の方が一般的であることが示されています。この調査は、GoogleのAI部門DeepMindとGoogleの研究開発部門Jigsawの共同で行われ、世界最大手のテクノロジー企業が莫大な利益を求めて市場に投入したAIツールを生成するリスクを定量化することを目的としている。

テクノロジー関連の悪役の動機

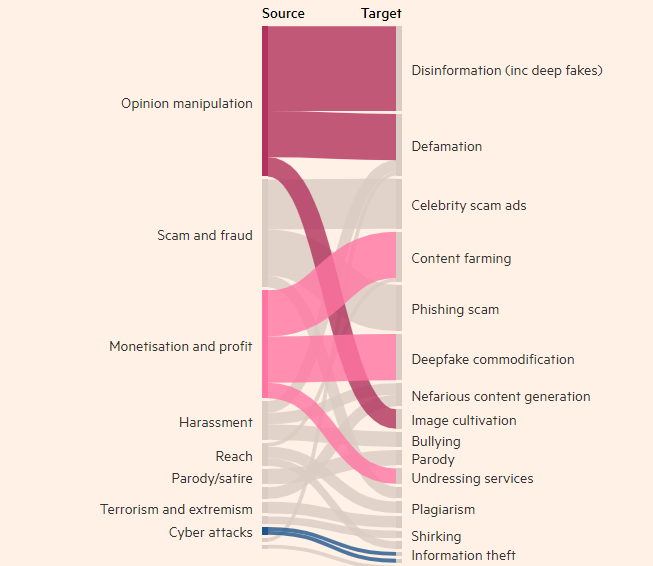

この研究では、人間の本物であるが虚偽の画像、ビデオ、音声を作成する行為が、生成型 AI ツールの最も一般的な誤用であり、次に多いチャットボットなどのテキスト ツールの使用よりもほぼ 2 倍多いことが判明しました。情報を改ざんすること。生成 AI の悪用の最も一般的な目的は世論に影響を与えることであり、ユースケースの 27% を占めており、ディープフェイクが今年の世界中の選挙にどのような影響を与えるかについての懸念が高まっています。

ここ数カ月間、英国首相リシ・スナックや他の世界的指導者のディープフェイクがTikTok、X、Instagramに登場した。英国の有権者は来週の総選挙で投票に行く予定だ。このようなコンテンツにラベルを付けたり削除したりするソーシャルメディアプラットフォームの努力にもかかわらず、人々はそれが虚偽であると認識しない可能性があり、コンテンツの拡散が投票率に影響を与える可能性があります。 DeepMindの研究者らは、ソーシャルメディアプラットフォームXやReddit、オンラインブログやメディアによる虐待報告に関わる約200件の虐待事件を分析した。

この調査によると、OpenAI の ChatGPT や Google の Gemini などの AI 生成製品を悪用する 2 番目に大きな動機は、ディープフェイクを作成するサービスを提供する場合でも、生成 AI を使用してフェイクなどの大量のコンテンツを作成する場合でも、金儲けであることが判明しました。ニュース記事。この調査では、ほとんどの悪用では「最小限の技術的専門知識を必要とする」簡単にアクセスできるツールが使用されていることが判明しました。これは、より多くの悪意のある者が生成 AI を悪用する可能性があることを意味します。

DeepMind の研究は、同社のモデルの安全性評価をどのように改善するかに影響を与えるだろうし、これが競合他社やその他の利害関係者が「危害の顕在化」をどう見るかにも影響を与えることを期待している。

ハイライト:

- DeepMind の調査では、ディープフェイクが人工知能アプリケーションの悪用の最大の問題であることが判明しました。

- 生成 AI ツールの最も一般的な悪用は世論に影響を与えることであり、使用の 27% を占めています。

- 生成された AI を悪用する 2 番目に大きな動機は金儲けであり、これには主にディープフェイク サービスの提供やフェイク ニュースの作成が含まれます。

この研究は、生成 AI によってもたらされる潜在的なリスクを理解し、それに対処するために重要です。 DeepMind の調査結果は、悪意のある行為者が AI テクノロジーを利用して有害な活動を行うことを防ぎ、公共の利益と情報セキュリティを保護するために、より効果的なセキュリティ メカニズムと規制枠組みを開発する必要性を浮き彫りにしています。 今後も同様の研究がAI技術の安全な開発を促進していくでしょう。