TutorKD

1.0.0

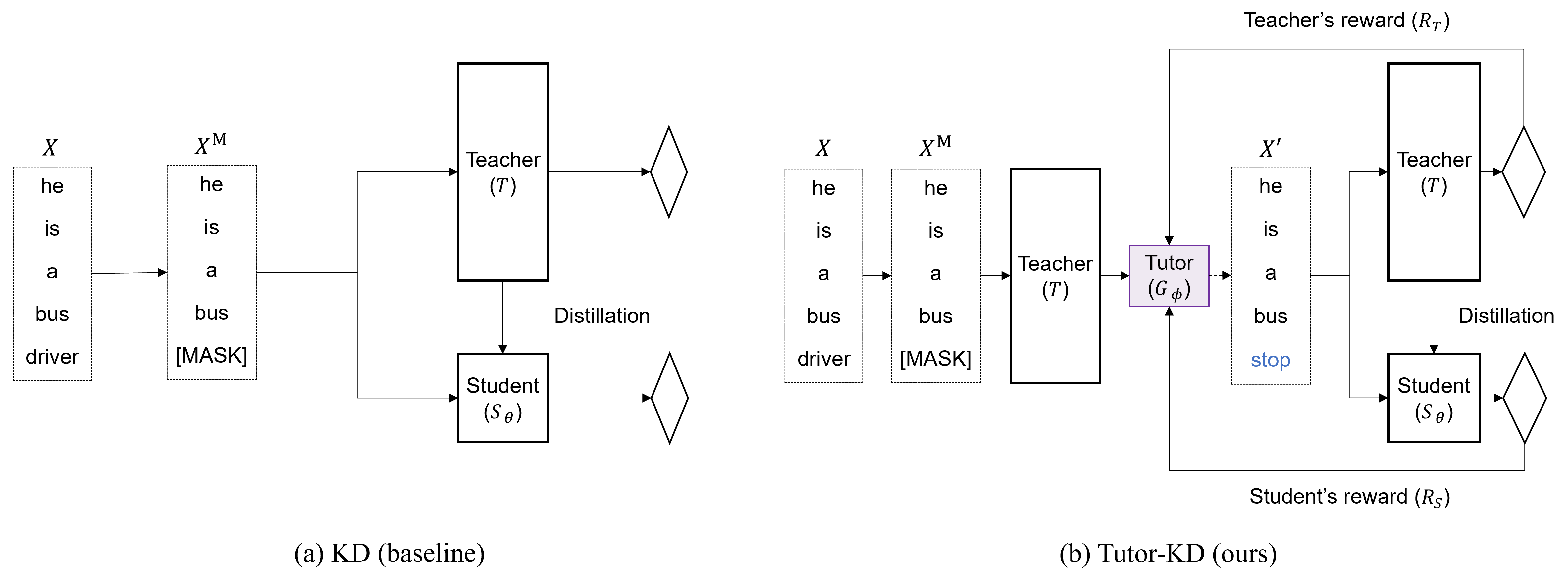

このリポジトリは、チューター-KDロングペーパーに関するものです。家庭教師は、生徒がより良く学習するのに役立ちます。EMNLP2022で公開されているチューターネットワークの知識蒸留の改善。このプロジェクトでは、学生のための誤った教師の予測と繰り返し学習を緩和できるトランジングサンプルを生成することに興味があります。

データフォルダーでトレーニング前のコーパス(WikipediaとBookCorpus)を準備します。 python preprocess.pyを使用してください。

--data_path :前処理された例を含むディレクトリ(ピックルファイル)。--raw_data_path :生のテキストの例を含むディレクトリ。 最後に、 python distillation.pyを使用して蒸留します。

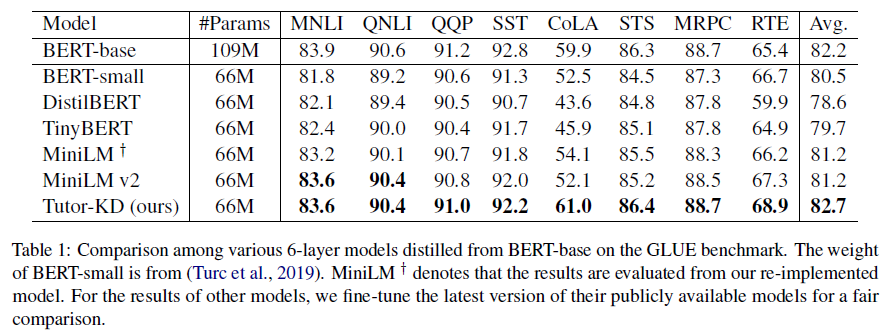

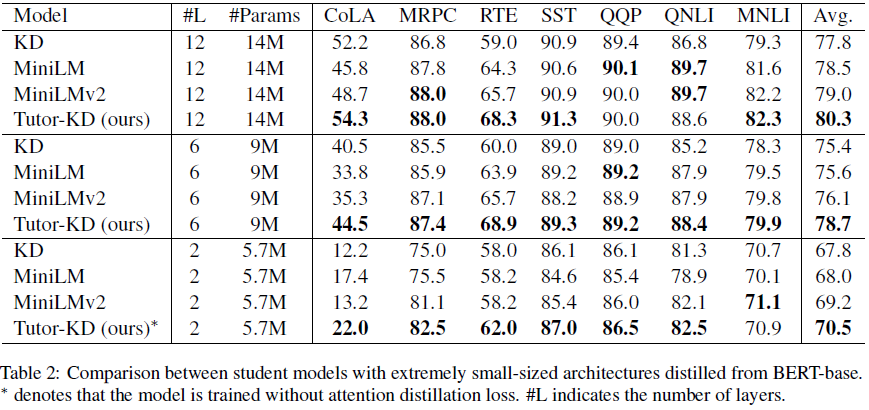

--config :学生モデルアーキテクチャ。モデルアーキテクチャを選択してください:Half、Extreme-12、Ext-6、Ext-2--lr :学習率を設定します。--epochs :エポックの数を設定します。--batch_size :一度に伝導するためにバッチサイズを設定します。--step_batch_size :各ステップごとに更新するためにバッチサイズを設定します(gpuのメモリで十分な場合は、batch_sizeとstep_batch_sizeを同じに設定します。--data_path :前処理された例を含むディレクトリ。--model_save_path :学生モデルを保存するためのディレクトリを設定しますTutor-KDを使用したヘルプまたは問題については、GitHubの問題を提出してください。

Tutor-KDに関連する個人的なコミュニケーションについては、Junho Kim <[email protected]>にお問い合わせください。