TutorKD

1.0.0

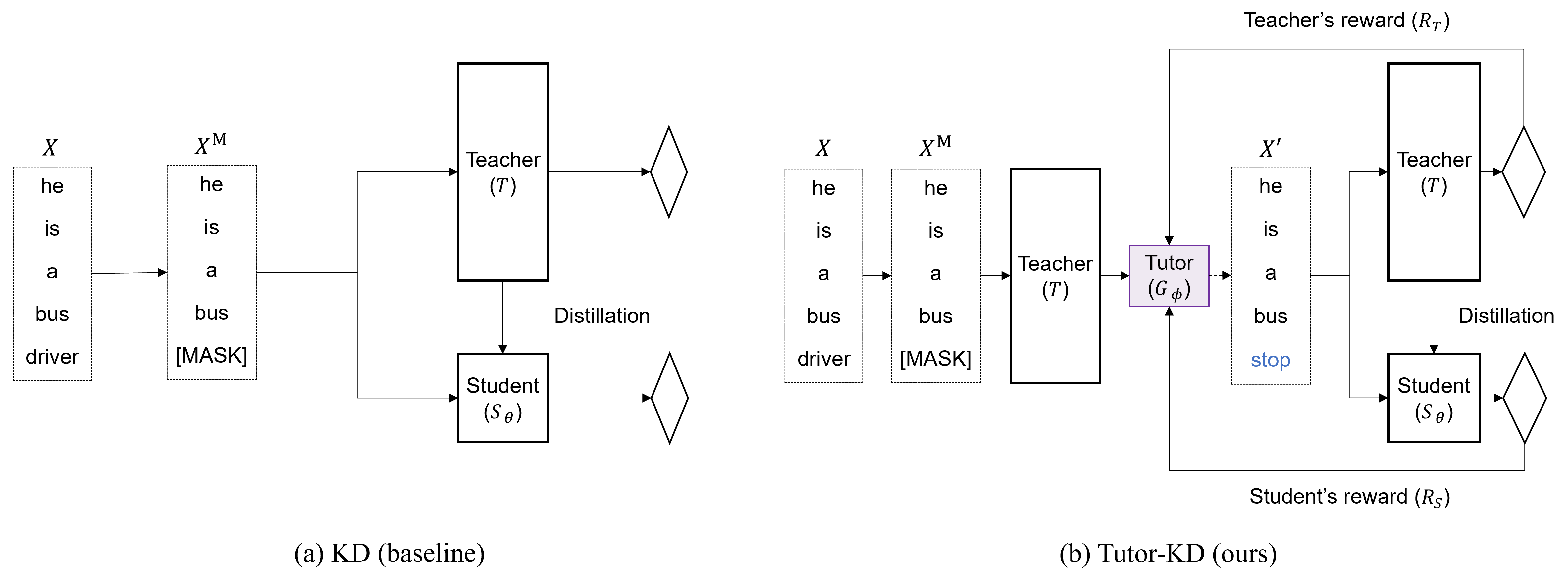

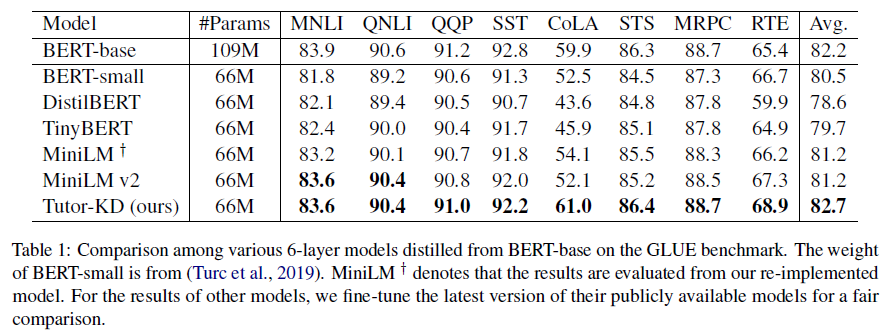

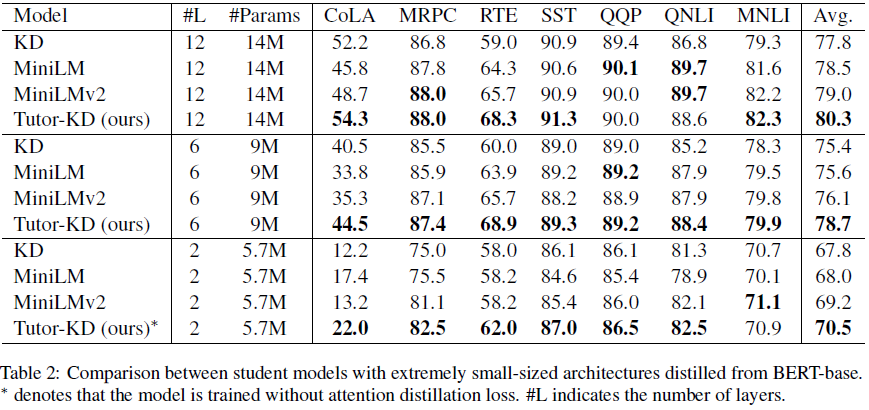

يدور هذا المستودع حول الورقة الطويلة Tusor-KD: يساعد الدروس على تعلم الطلاب بشكل أفضل: تحسين التقطير المعرفة لـ BERT مع شبكة المعلم المنشورة في EMNLP 2022. في هذا المشروع ، نحن مهتمون بإنشاء عينات traning التي يمكن أن تخفف من تنبؤات المعلم غير الصحيحة والتعلم المتكرر للطالب.

قم بإعداد شركة ما قبل التدريب (ويكيبيديا و bookcorpus) في مجلد البيانات. استخدام python preprocess.py .

--data_path : دليل يحتوي على أمثلة مسبقة (ملف المخلل).--raw_data_path : دليل يحتوي على أمثلة نصية خام. أخيرًا ، استخدم python distillation.py للتقطير.

--config : بنية نموذج الطالب. اختر بنية النموذج من: Half ، Extreme-12 ، Ext-6 ، Ext-2--lr : اضبط معدل التعلم.--epochs : اضبط عدد الحقبة.--batch_size : اضبط حجم الدُفعة للإجراء في وقت واحد.--step_batch_size : اضبط حجم الدُفعة للتحديث لكل خطوة (إذا كانت ذاكرة وحدة معالجة الرسومات كافية ، فقم بتعيين BATCH_SIZE و Step_Batch_Size نفسه.--data_path : دليل يحتوي على أمثلة مسبقة المعالجة.--model_save_path : اضبط الدليل لحفظ نموذج الطالب للحصول على مساعدة أو مشكلات باستخدام Tusor-KD ، يرجى تقديم مشكلة GitHub.

للاتصال الشخصي المتعلق بـ Tusor-KD ، يرجى الاتصال بـ Junho Kim <[email protected]> .