Kebangkitan dan potensi agen berbasis model bahasa besar: survei

Makalah yang harus dibaca untuk agen berbasis LLM.

? Segera Hadir: Tambahkan intro satu kalimat ke setiap kertas.

? Berita

- ☄️ [2024/06/07] Agen telah dirilis untuk mengembangkan dan mengembangkan agen berbasis LLM di berbagai lingkungan!

- Kertas: Agen.

- Halaman Proyek: https://agentgym.github.io/.

- Kode: Platform dan Implementasi.

- Sumber Daya Huggingface: Agentraj-L, Agenteval, Agentevol-7b.

- ? [2024/05/02] R3 (melatih model bahasa besar untuk penalaran melalui pembelajaran penguatan kurikulum terbalik) diterima oleh ICML 2024!

- ? [2024/02/08] Kertas baru R3 pada RL untuk penalaran agen LLM telah dirilis! Kertas: Melatih model bahasa besar untuk penalaran melalui pembelajaran penguatan kurikulum terbalik. Kode: LLM-Reverse-Curriculum-RL.

- ? [2023/09/20] Proyek ini telah terdaftar di Github Trendings! Itu adalah suatu kehormatan besar!

- ? [2023/09/15] Survei kami dirilis! Lihat kebangkitan dan potensi agen berbasis model bahasa besar: survei untuk kertas!

- [2023/09/14] Kami membuat repositori ini untuk memelihara daftar kertas pada agen berbasis LLM. Lebih banyak makalah akan segera hadir!

? Perkenalan

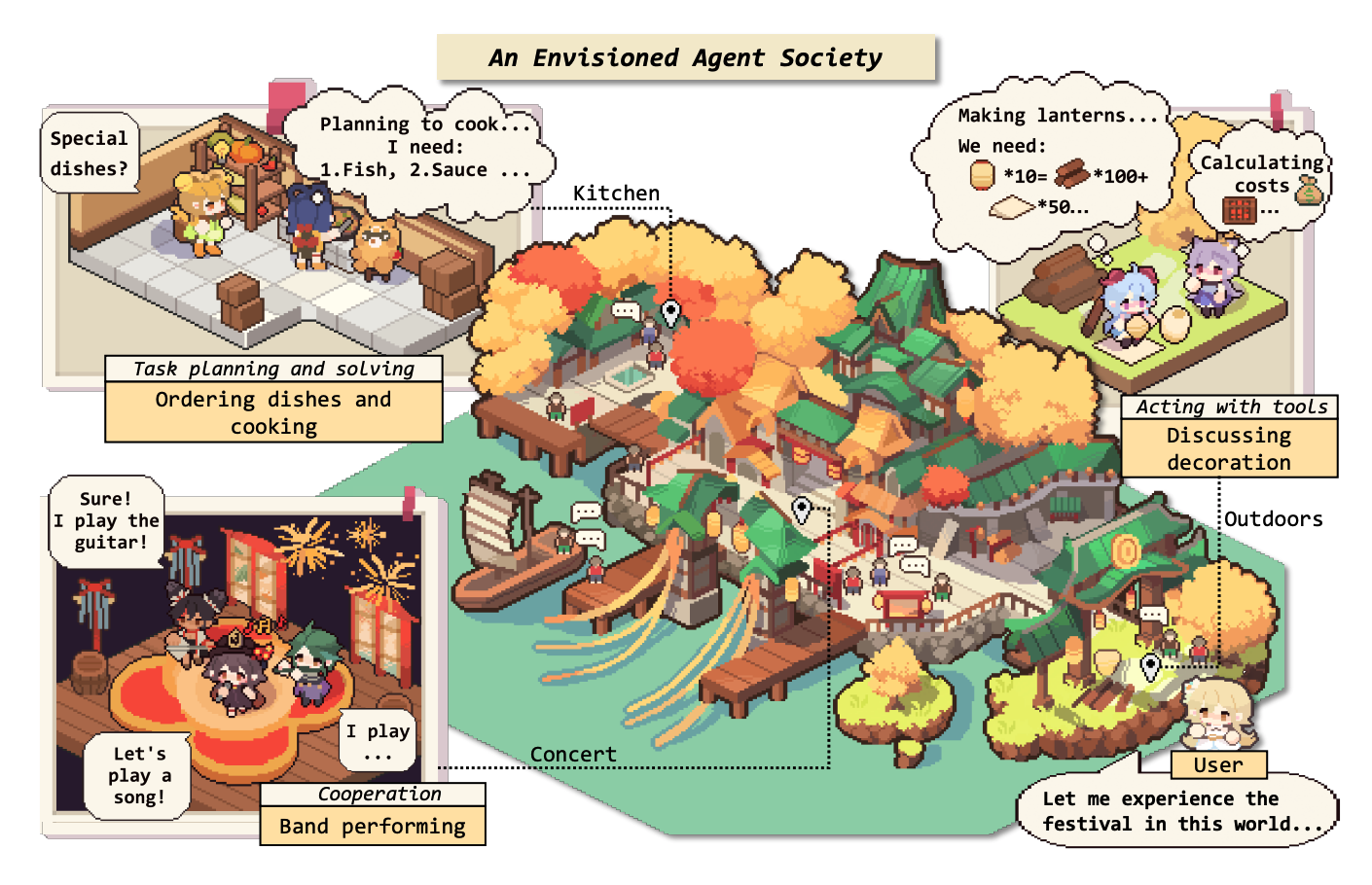

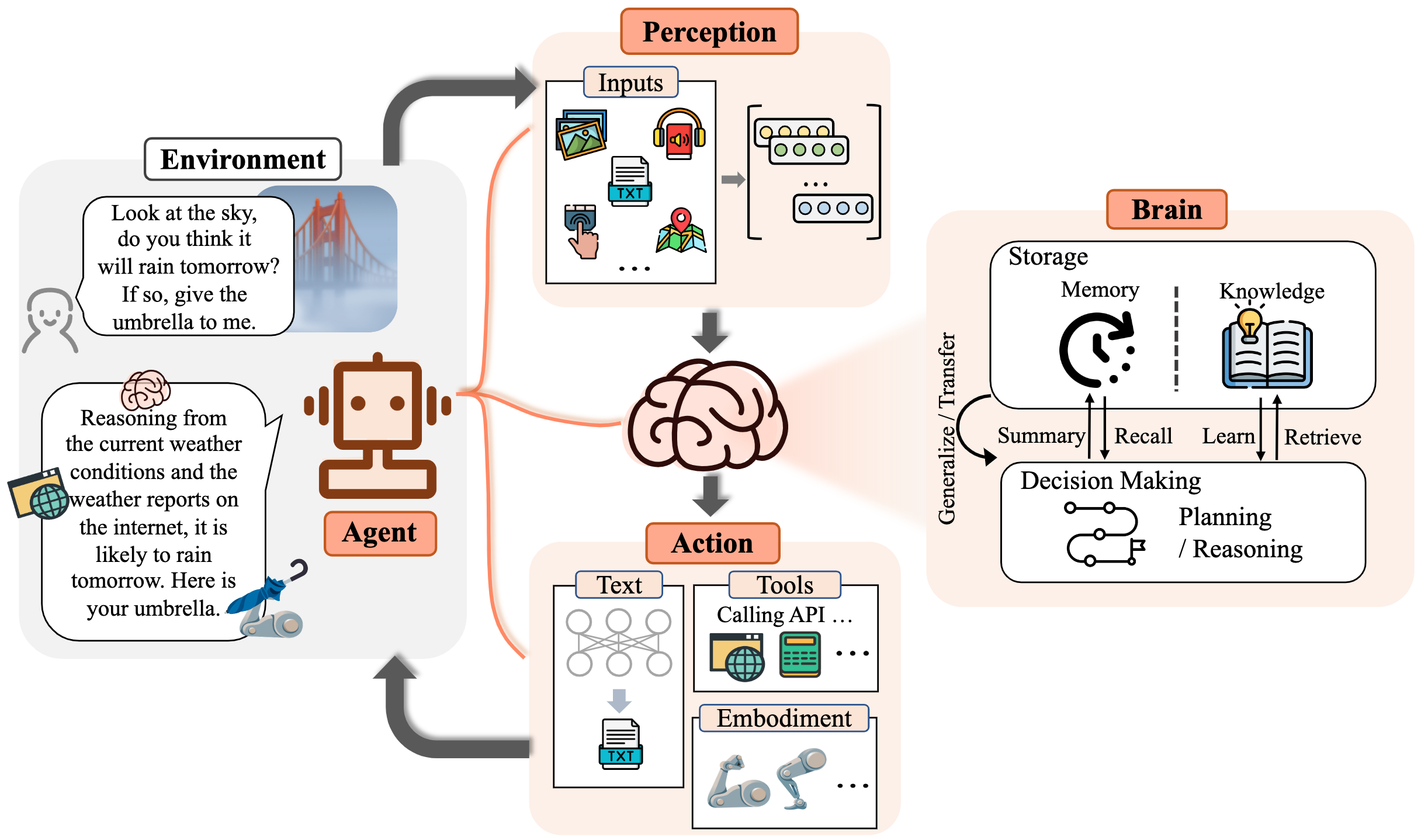

Untuk waktu yang lama, umat manusia telah mengejar kecerdasan buatan (AI) yang setara dengan atau melampaui tingkat manusia, dengan agen AI dianggap sebagai kendaraan yang menjanjikan dari pengejaran ini. Agen AI adalah entitas buatan yang merasakan lingkungan mereka, membuat keputusan, dan mengambil tindakan.

Karena kemampuan serbaguna dan luar biasa yang mereka tunjukkan, model bahasa besar (LLM) dianggap sebagai percikan potensial untuk kecerdasan umum buatan (AGI), menawarkan harapan untuk membangun agen AI umum. Banyak upaya penelitian telah memanfaatkan LLMS sebagai fondasi untuk membangun agen AI dan telah mencapai kemajuan yang signifikan.

Dalam repositori ini, kami menyediakan survei sistematis dan komprehensif tentang agen berbasis LLM, dan daftar beberapa makalah yang harus dibaca.

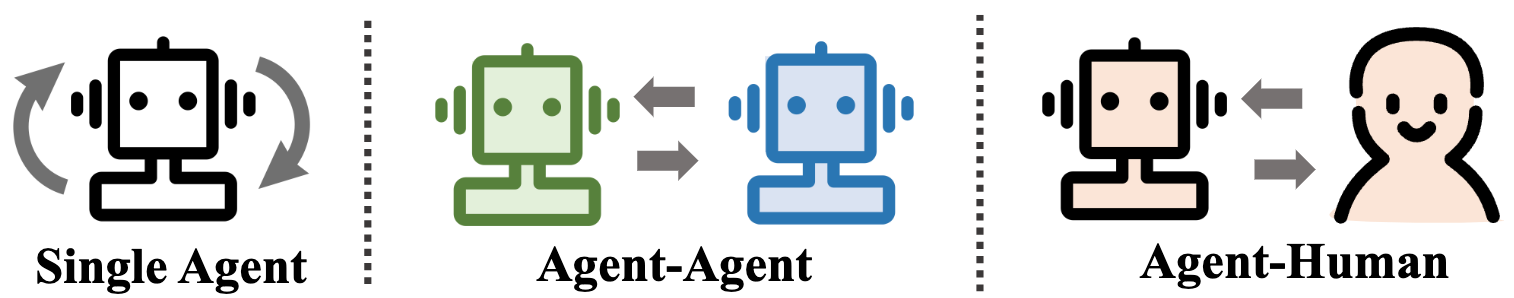

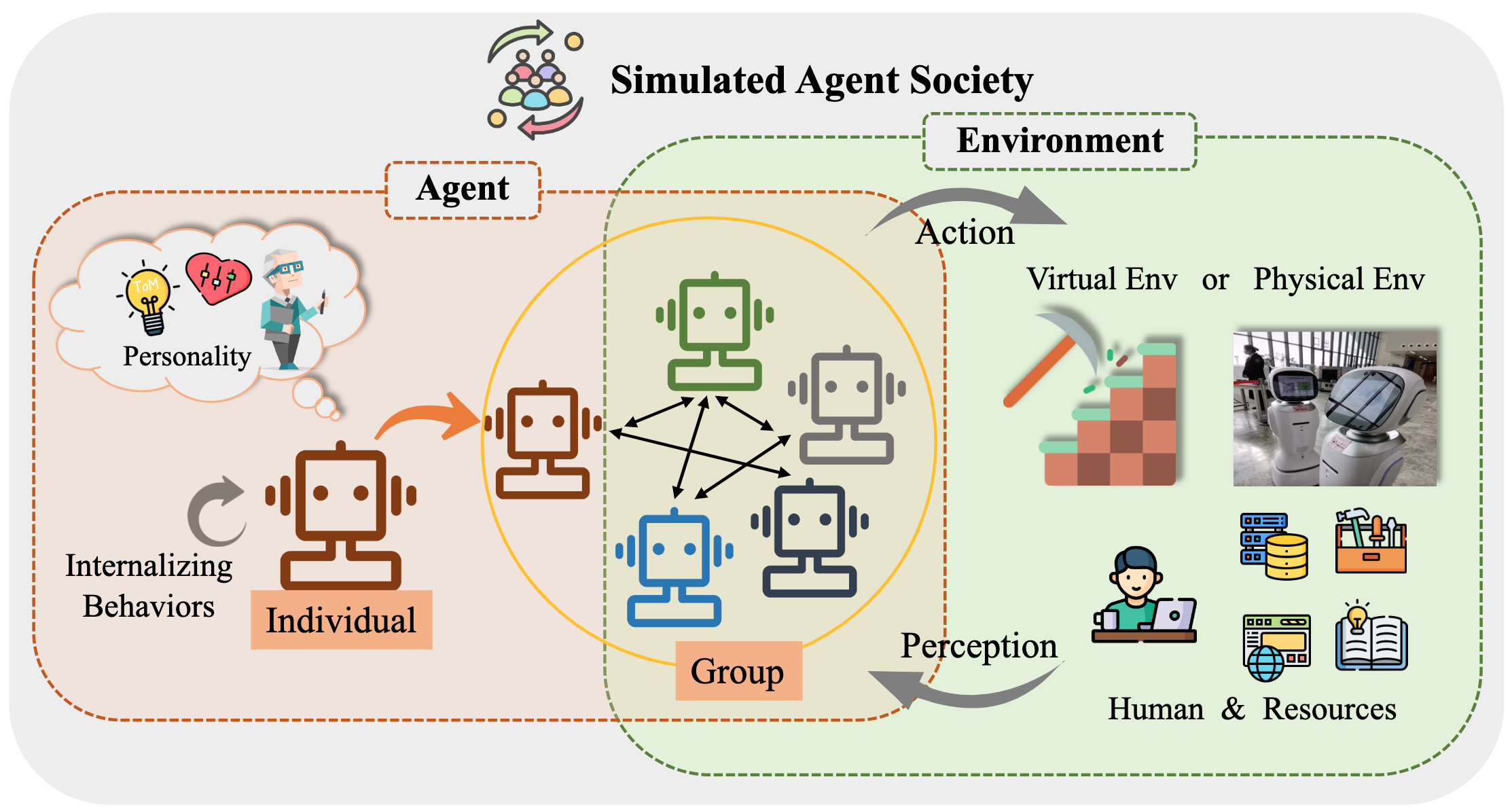

Secara khusus, kami mulai dengan kerangka kerja konseptual umum untuk agen berbasis LLM: terdiri dari tiga komponen utama: otak, persepsi, dan tindakan, dan kerangka kerja dapat disesuaikan agar sesuai dengan aplikasi yang berbeda. Selanjutnya, kami mengeksplorasi aplikasi luas agen berbasis LLM dalam tiga aspek: skenario agen tunggal, skenario multi-agen, dan kerja sama agen manusia. Setelah ini, kami mempelajari masyarakat agen, mengeksplorasi perilaku dan kepribadian agen berbasis LLM, fenomena sosial yang muncul ketika mereka membentuk masyarakat, dan wawasan yang mereka tawarkan untuk masyarakat manusia. Akhirnya, kami membahas berbagai topik utama dan masalah terbuka di dalam lapangan.

Kami sangat menghargai kontribusi apa pun melalui PRS, masalah, email, atau metode lainnya.

Tabel Konten (TOC)

- Kebangkitan dan potensi agen berbasis model bahasa besar: survei

- ? Berita

- ? Perkenalan

- Tabel Konten (TOC)

- 1. Kelahiran agen: konstruksi agen berbasis LLM

- 1.1 Otak: Terutama terdiri dari LLM

- 1.1.1 Interaksi Bahasa Alami

- Generasi berkualitas tinggi

- Pemahaman yang mendalam

- 1.1.2 Pengetahuan

- Model pretrain

- Pengetahuan Linguistik

- Pengetahuan akal sehat

- Pengetahuan yang dapat ditindaklanjuti

- Potensi masalah pengetahuan

- 1.1.3 Memori

- Kemampuan memori

- Meningkatkan batas panjang transformator

- Meringkas memori

- Memori mengompresi dengan vektor atau struktur data

- Pengambilan memori

- 1.1.4 Penalaran & Perencanaan

- Pemikiran

- Perencanaan

- Rencanakan formulasi

- Rencanakan refleksi

- 1.1.5 transferabilitas dan generalisasi

- Generalisasi tugas yang tidak terlihat

- Pembelajaran dalam konteks

- Pembelajaran berkelanjutan

- 1.2 Persepsi: Input multimodal untuk agen berbasis LLM

- 1.3 Tindakan: Perluas Ruang Tindakan Agen Berbasis LLM

- 1.3.1 menggunakan alat

- 1.3.2 Tindakan yang diwujudkan

- 2. Agen dalam Praktek: Aplikasi Agen Berbasis LLM

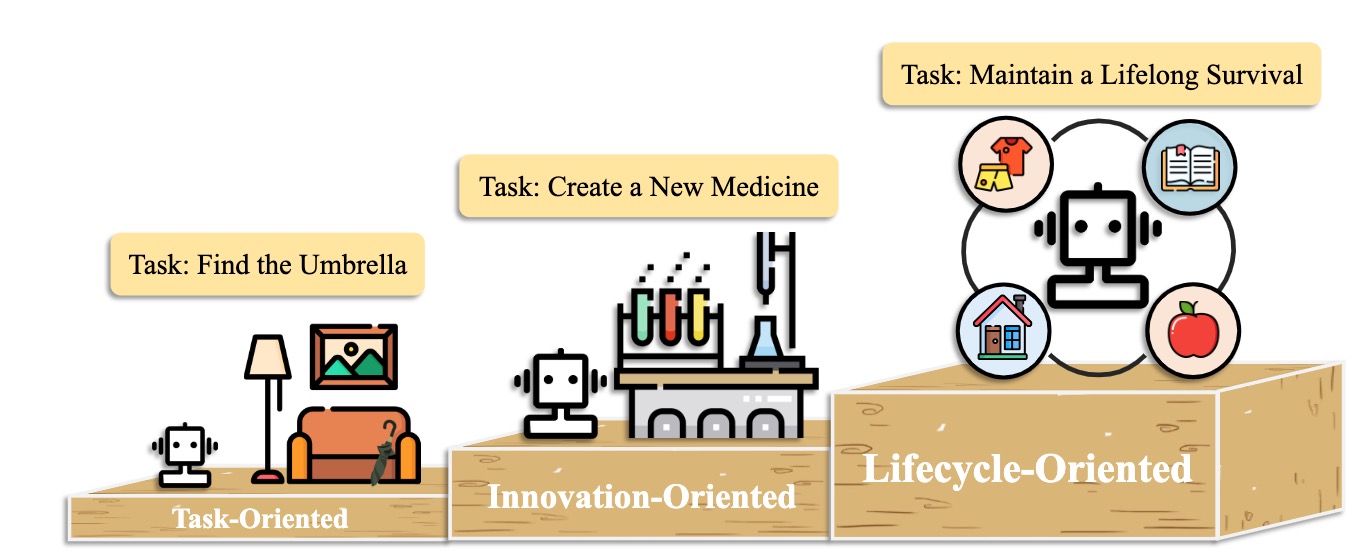

- 2.1 Kemampuan umum agen tunggal

- 2.1.1 Penempatan berorientasi tugas

- 2.1.2 Penempatan berorientasi inovasi

- 2.1.3 Penyebaran yang berorientasi pada siklus hidup

- 2.2 Mengoordinasikan potensi beberapa agen

- 2.2.1 Interaksi kooperatif untuk saling melengkapi

- 2.2.2 Interaksi permusuhan untuk kemajuan

- 2.3 Keterlibatan interaktif antara manusia dan agen

- 2.3.1 Paradigma Insetor-Eksekutor

- Pendidikan

- Kesehatan

- Aplikasi lainnya

- 2.3.2 Paradigma Kemitraan yang Setara

- Komunikator Empati

- Peserta tingkat manusia

- 3. Masyarakat Agen: Dari individualitas hingga sosialitas

- 3.1 Perilaku dan Kepribadian Agen Berbasis LLM

- 3.1.1 Perilaku Sosial

- Perilaku individu

- Perilaku kelompok

- 3.1.2 Kepribadian

- Pengartian

- Emosi

- Karakter

- 3.2 Lingkungan untuk Masyarakat Agen

- 3.2.1 Lingkungan berbasis teks

- 3.2.2 Lingkungan kotak pasir virtual

- 3.2.3 Lingkungan Fisik

- 3.3 Simulasi Masyarakat dengan Agen Berbasis LLM

- 4. Topik lainnya

- 4.1 tolok ukur untuk agen berbasis LLM

- 4.2 Pelatihan dan mengoptimalkan agen berbasis LLM

- Kutipan

- Pemelihara & Kontributor Proyek

- Kontak

- Sejarah Bintang

1. Kelahiran agen: konstruksi agen berbasis LLM

1.1 Otak: Terutama terdiri dari LLM

1.1.1 Interaksi Bahasa Alami

Generasi berkualitas tinggi

- [2023/10] Menuju pengambilan keputusan yang diwujudkan secara end-to-end melalui model bahasa besar multi-modal: Eksplorasi dengan GPT4-Vision dan di luar Liang Chen et al. arxiv. [kertas] [kode]

- Pekerjaan ini mengusulkan PCA-eval, yang tolok ukurnya mewujudkan pengambilan keputusan melalui metode ujung ke ujung berbasis MLLM dan metode penggunaan alat berbasis LLM dari tingkat persepsi, kognisi, dan aksi.

- [2023/08] Evaluasi multika, multibahasa, multiboda dari chatgpt tentang penalaran, halusinasi, dan interaktivitas. Yejin Bang et al. arxiv. [kertas]

- Pekerjaan ini mengevaluasi aspek multitask, multibahasa dan multimoda dari chatgpt menggunakan 21 set data yang mencakup 8 tugas aplikasi NLP umum yang berbeda.

- [2023/06] LLM-Eval: Evaluasi otomatis multi-dimensi terpadu untuk percakapan domain terbuka dengan model bahasa besar. Yen-Ting Lin et al. arxiv. [kertas]

- Metode LLM-Eval mengevaluasi beberapa dimensi evaluasi, seperti konten, tata bahasa, relevansi, dan kesesuaian.

- [2023/04] Apakah chatgpt sistem koreksi kesalahan tata bahasa yang sangat fasih? Evaluasi yang komprehensif. Tao Fang et al. arxiv. [kertas]

- Hasil evaluasi menunjukkan bahwa chatgpt memiliki kemampuan deteksi kesalahan yang sangat baik dan dapat dengan bebas memperbaiki kesalahan untuk membuat kalimat yang diperbaiki sangat fasih. Selain itu, kinerjanya dalam pengaturan non-Inggris dan sumber daya rendah menyoroti potensinya dalam tugas GEC multibahasa.

Pemahaman yang mendalam

- [2023/06] Hans pintar atau teori pikiran saraf? Menguji stres penalaran sosial dalam model bahasa besar. Natalie Shapira et al. arxiv. [kertas]

- LLMS menunjukkan teori kemampuan pikiran tertentu, tetapi perilaku ini jauh dari kuat.

- [2022/08] menyimpulkan hadiah dari bahasa dalam konteks. Jessy Lin et al. ACL. [kertas]

- Pekerjaan ini menyajikan model yang menyimpulkan penghargaan dari bahasa dan memprediksi tindakan optimal di lingkungan yang tidak terlihat.

- [2021/10] Teori Komunikasi Bantuan Berbasis Pikiran dalam Kerjasama Robot Manusia yang Kompleks. Moritz C. Buehler et al. arxiv. [kertas]

- Karya ini merancang sushi agen dengan pemahaman tentang manusia selama interaksi.

1.1.2 Pengetahuan

Model pretrain

- [2023/04] Pembelajaran Representasi kalimat yang didistribusikan dari data yang tidak berlabel. Felix Hill (University of Cambridge) et al. arxiv. [kertas]

- [2020/02] Berapa banyak pengetahuan yang dapat Anda kemas ke dalam parameter model bahasa? Adam Roberts (Google) et al. arxiv. [kertas]

- [2020/01] Penskalaan hukum untuk model bahasa saraf. Jared Kaplan (Universitas Johns Hopkins) et al. arxiv. [kertas]

- [2017/12] pengetahuan akal sehat dalam kecerdasan mesin. Niket Tandon (Institut Allen untuk Kecerdasan Buatan) et al. Sigmod. [kertas]

- [2011/03] Pemrosesan bahasa alami (hampir) dari awal. Ronan Collobert (Princeton) et al. arxiv. [kertas]

Pengetahuan Linguistik

- [2023/02] Evaluasi multika, multibahasa, multiboda dari chatgpt tentang penalaran, halusinasi, dan interaktivitas. Yejin Bang et al. arxiv. [kertas]

- [2021/06] Mendidik model bahasa pra-terlatih untuk atribut semantik dan nilainya. Meriem Beloucif et al. EMNLP. [kertas]

- [2020/10] Model bahasa pretrained untuk semantik leksikal. Ivan Volić et al. arxiv. [kertas]

- [2019/04] Probe struktural untuk menemukan sintaks dalam representasi kata. John Hewitt et al. ACL. [kertas]

- [2016/04] Peningkatan ekstraksi kata kunci otomatis mengingat lebih banyak pengetahuan semantik. H leung. Sistem untuk aplikasi canggih. [kertas]

Pengetahuan akal sehat

- [2022/10] Model bahasa kode adalah beberapa pelajar akal sehat. Aman Madaan et al.arxiv. [kertas]

- [2021/04] Representasi pengetahuan dunia relasional dalam model bahasa kontekstual: ulasan. Tara Safavi et al. arxiv. [kertas]

- [2019/11] Bagaimana kita bisa mengetahui model bahasa apa yang tahu? Zhengbao Jiang et al.arxiv. [kertas]

Pengetahuan yang dapat ditindaklanjuti

- [2023/07] Model bahasa besar dalam kedokteran. Arun James Thirunavukarasu et al. alam. [kertas]

- [2023/06] DS-1000: tolok ukur alami dan andal untuk pembuatan kode sains data. Yuhang Lai et al. ICML. [kertas]

- [2022/10] Model bahasa kode adalah beberapa pelajar akal sehat. Aman Madaan et al. arxiv. [kertas]

- [2022/02] Evaluasi sistematis model kode bahasa besar. Frank F. Xu et al.arxiv. [kertas]

- [2021/10] Pelatihan verifikasi untuk menyelesaikan masalah kata matematika. Karl Cobbe et al. arxiv. [kertas]

Potensi masalah pengetahuan

- [2023/10] Freshllms: menyegarkan model bahasa besar dengan augmentasi mesin pencari. Tu Vu (Google) et al. arxiv [kertas] [kode]

- [2023/05] Mengedit Model Bahasa Besar: Masalah, Metode, dan Peluang. Yunzhi Yao et al. arxiv. [kertas]

- [2023/05] Pemeriksa diri: Modul plug-and-play untuk memeriksa fakta dengan model bahasa besar. Miaoran Li et al. arxiv. [kertas]

- [2023/05] Kritik: Model bahasa besar dapat mengoreksi diri dengan kritik interaktif alat. Zhibin Gou et al. arxiv. [kertas]

- [2023/04] Pembelajaran alat dengan model dasar. Yujia Qin et al. arxiv. [kertas]

- [2023/03] SelfCheckGPPT: Deteksi halusinasi kotak hitam nol-resource untuk model bahasa besar generatif. Potsawee Manakul et al. arxiv. [kertas]

- [2022/06] Pengeditan model berbasis memori pada skala. Eric Mitchell et al. arxiv. [kertas]

- [2022/04] Ulasan tentang model bahasa sebagai basis pengetahuan. Badr Alkhamissi et al.arxiv. [kertas]

- [2021/04] Mengedit pengetahuan faktual dalam model bahasa. Nicola de Cao et al.arxiv. [kertas]

- [2017/08] Mengukur lupa bencana dalam jaringan saraf. Ronald Kemker et al.arxiv. [kertas]

1.1.3 Memori

Kemampuan memori

Meningkatkan batas panjang transformator

- [2023/10] MEMGPT: Menuju LLMS sebagai sistem operasi. Charles Packer (UC Berkeley) et al. arxiv. [kertas] [halaman proyek] [kode] [dataset]

- [2023/05] Pengkodean posisi acak meningkatkan generalisasi panjang transformator. Anian Ruoss (DeepMind) et al. arxiv. [kertas] [kode]

- [2023-03] COLT5: Transformator jarak jauh lebih cepat dengan perhitungan bersyarat. Joshua Ainslie (Google Research) et al. arxiv. [kertas]

- [2022/03] Klasifikasi dokumen panjang yang efisien menggunakan transformator. Hyunji Hayley Park (Universitas Illinois) et al. arxiv. [kertas] [kode]

- [2021/12] Longt5: Transformator teks-ke-teks yang efisien untuk urutan panjang. Mandy Guo (Google Research) et al. arxiv. [kertas] [kode]

- [2019/10] BART: Denoising Sequence-to-Sequence Pra-Pelatihan untuk Generasi Bahasa Alami, Terjemahan, dan Pemahaman. Michael Lewis (Facebook AI) et al. arxiv. [kertas] [kode]

Meringkas memori

- [2023/10] Berjalan menyusuri labirin memori: di luar batas konteks melalui membaca interaktif Howard Chen (Princeton University) et al. arxiv. [kertas]

- [2023/09] Memberdayakan Bimbingan Pribadi dengan merantai model bahasa besar Yulin Chen (Tsinghua University) et al. arxiv. [kertas]

- [2023/08] Expel: Agen LLM adalah pelajar pengalaman. Andrew Zhao (Universitas Tsinghua) et al. arxiv. [kertas] [kode]

- [2023/08] Chateval: Menuju evaluator berbasis LLM yang lebih baik melalui debat multi-agen. Chi-Min Chan (Universitas Tsinghua) et al. arxiv. [kertas] [kode]

- [2023/05] MemoryBank: Meningkatkan model bahasa besar dengan memori jangka panjang. Wanjun Zhong (Institut Teknologi Harbin) et al. arxiv. [kertas] [kode]

- [2023/04] Agen generatif: simulacra interaktif perilaku manusia. Joon Sung Park (Universitas Stanford) et al. arxiv. [kertas] [kode]

- [2023/04] Melepaskan kapasitas input panjang tak terbatas untuk model bahasa skala besar dengan sistem memori yang dikendalikan sendiri. Xinnian Liang (Universitas Beihang) et al. arxiv. [kertas] [kode]

- [2023/03] Refleksi: Agen bahasa dengan pembelajaran penguatan verbal. Nuh Shinn (Universitas Northeastern) et al. arxiv. [kertas] [kode]

- [2023/05] RecurrentGpt: Generasi interaktif (sewenang -wenang) teks panjang. Wangchunshu Zhou (Aiwaves) et al. arxiv. [kertas] [kode]

Memori mengompresi dengan vektor atau struktur data

- [2023/07] Agen komunikatif untuk pengembangan perangkat lunak. Chen Qian (Universitas Tsinghua) et al. arxiv. [kertas] [kode]

- [2023/06] CHATDB: Menambah llms dengan database sebagai memori simbolik mereka. Chenxu Hu (Universitas Tsinghua) et al. arxiv. [kertas] [kode]

- [2023/05] Ghost in the Minecraft: Agen yang umumnya mampu untuk lingkungan dunia terbuka melalui model bahasa besar dengan pengetahuan dan memori berbasis teks. Xizhou Zhu (Universitas Tsinghua) et al. arxiv. [kertas] [kode]

- [2023/05] RET-LLM: Menuju memori baca-write umum untuk model bahasa besar. Ali Modarressi (LMU Munich) et al. arxiv. [kertas] [kode]

- [2023/05] RecurrentGpt: Generasi interaktif (sewenang -wenang) teks panjang. Wangchunshu Zhou (Aiwaves) et al. arxiv. [kertas] [kode]

Pengambilan memori

- [2023/08] Memori Sandbox: Manajemen memori transparan dan interaktif untuk agen percakapan. Ziheng Huang (University of California - San Diego) et al. arxiv. [kertas]

- [2023/08] AgentSims: Kotak pasir sumber terbuka untuk evaluasi model bahasa besar. Jiaju Lin (PTA Studio) et al. arxiv. [kertas] [halaman proyek] [kode]

- [2023/06] CHATDB: Menambah llms dengan database sebagai memori simbolik mereka. Chenxu Hu (Universitas Tsinghua) et al. arxiv. [kertas] [kode]

- [2023/05] MemoryBank: Meningkatkan model bahasa besar dengan memori jangka panjang. Wanjun Zhong (Institut Teknologi Harbin) et al. arxiv. [kertas] [kode]

- [2023/04] Agen generatif: simulacra interaktif perilaku manusia. Joon Sung Park (Stanford) et al. arxiv. [kertas] [kode]

- [2023/05] RecurrentGpt: Generasi interaktif (sewenang -wenang) teks panjang. Wangchunshu Zhou (Aiwaves) et al. arxiv. [kertas] [kode]

1.1.4 Penalaran & Perencanaan

Pemikiran

[2024/02] Melatih model bahasa besar untuk penalaran melalui pembelajaran penguatan kurikulum terbalik. Zhiheng XI (Universitas Fudan) et al. arxiv. [kertas] [kode]

[2023/09] Rekonsiliasi: Konferensi meja bundar meningkatkan penalaran melalui konsensus di antara LLM yang beragam. Justin Chih-Yao Chen (Universitas North Carolina di Chapel Hill) et al. arxiv. [kertas] [kode]

[2023/05] Pemolesan diri: Tingkatkan penalaran dalam model bahasa besar melalui penyempurnaan masalah. Zhiheng XI (Universitas Fudan) et al. arxiv. [kertas] [kode]

[2023-03] Model bahasa besar adalah alasan nol-shot. Takeshi Kojima (Universitas Tokyo) et al. arxiv. [kertas] [kode]

[2023/03] Mandiri: Penyempurnaan iteratif dengan feedback sendiri. Aman Madaan (Universitas Carnegie Mellon) et al. arxiv. [kertas] [kode]

[2022/05] Pemilihan-Inferensi: Mengeksploitasi model bahasa besar untuk penalaran logis yang dapat ditafsirkan. Antonia Creswell (DeepMind) et al. arxiv. [kertas]

[2022/03] Konsistensi diri meningkatkan penalaran rantai pemikiran dalam model bahasa. Xuezhi Wang (Google Research) et al. arxiv. [kertas] [kode]

[2023/02] Penalaran rantai multimodal dalam model bahasa. Zhuosheng Zhang (Universitas Shanghai Jiao Tong) et al. arxiv. [kertas] [kode]

[2022/01] Rantai yang mendorong memunculkan penalaran dalam model bahasa besar. Jason Wei (Google Research) et al. arxiv. [kertas]

Perencanaan

Rencanakan formulasi

- [2023/11] Jarvis-1: agen multi-tugas-dunia terbuka dengan model bahasa multimodal yang beraugentasikan memori. Zihao Wang (Universitas Peking) et al. arxiv. [kertas] [kode]

- [2023/10] Pencarian pohon agen bahasa menyatukan penalaran akting dan perencanaan dalam model bahasa. Andy Zhou (University of Illinois Urbana-Champaign) et al. arxiv. [kertas] [halaman proyek] [kode]

- [2023/05] Pohon Pikiran: Pemecahan masalah yang disengaja dengan model bahasa besar. Shunyu Yao (Universitas Princeton) et al. arxiv. [kertas] [kode]

- [2023/05] Rencanakan, menghilangkan, dan melacak - model bahasa adalah guru yang baik untuk agen yang diwujudkan. Yue Wu (Universitas Carnegie Mellon) et al. arxiv. [kertas]

- [2023/05] Penalaran dengan model bahasa berencana dengan model dunia. Shibo Hao (UC San Diego) et al. arxiv. [kertas] [kode]

- [2023/05] SwiftSage: Agen generatif dengan pemikiran cepat dan lambat untuk tugas interaktif yang kompleks. Bill Yuchen Lin (Institut Allen untuk Kecerdasan Buatan) et al. arxiv. [kertas] [kode]

- [2023/04] LLM+P: Memberdayakan model bahasa besar dengan kemahiran perencanaan yang optimal. Bo Liu (Universitas Texas di Austin) et al. arxiv. [kertas] [kode]

- [2023/03] HUGGINGGPT: Memecahkan tugas AI dengan chatgpt dan teman -temannya di wajah pelukan. Yongliang Shen (Microsoft Research Asia) et al. arxiv. [kertas] [kode]

- [2023/02] Jelaskan, jelaskan, rencanakan, dan pilih: Perencanaan interaktif dengan model bahasa besar memungkinkan agen multi-tugas dunia terbuka. Zihao Wang (Universitas Peking) et al. arxiv. [kertas] [kode]

- [2022/05] Permintaan paling tidak paling penting memungkinkan penalaran kompleks dalam model bahasa besar. Denny Zhou (Google Research) et al. arxiv. [kertas]

- [2022/05] Sistem MRKL: Arsitektur modular, simbolik simbolik yang menggabungkan model bahasa besar, sumber pengetahuan eksternal, dan penalaran diskrit. Ehud Karpas (AI21 Labs) et al. arxiv. [kertas]

- [2022/04] lakukan semampu saya, bukan seperti yang saya katakan: bahasa landasan dalam biaya robot. Michael Ahn (Robotika di Google) et al. arxiv. [kertas]

- [2023/05] Agen: Kerangka kerja open-source untuk agen bahasa otonom. Wangchunshu Zhou (Aiwaves) et al. arxiv. [kertas] [kode]

- [2022/12] Jangan menghasilkan, membedakan: proposal untuk model bahasa grounding ke lingkungan dunia nyata. Yu Gu (Universitas Negeri Ohio) et al. ACL. [kertas] [kode]

Rencanakan refleksi

- [2024/02] Agen-Pro: Belajar berevolusi melalui refleksi tingkat kebijakan dan optimasi Wenqi Zhang (Universitas Zhejiang) et al. arxiv. [kertas] [kode]

- [2024/01] Kontras diri: Refleksi yang lebih baik melalui perspektif pemecahan yang tidak konsisten Wenqi Zhang (Universitas Zhejiang) et al. arxiv. [kertas]

- [2023/11] Jarvis-1: agen multi-tugas-dunia terbuka dengan model bahasa multimodal yang beraugentasikan memori. Zihao Wang (Universitas Peking) et al. arxiv. [kertas] [kode]

- [2023/10] Verifikasi rantai mengurangi halusinasi dalam model bahasa besar. Shehzaad Dhuliawala (Meta Ai & Eth Zu ̈rich) et al. arxiv. [kertas]

- [2023/10] FireAct: Menuju fine-tuning agen bahasa. Baian Chen (System2 Research) et al. arxiv. [kertas] [halaman proyek] [kode] [dataset]

- [2023/08] Selfcheck: Menggunakan LLMS untuk Zero-shot memeriksa penalaran langkah demi langkah mereka sendiri. Ning Miao (University of Oxford) et al. arxiv. [kertas] [kode]

- [2023/05] CHATCOT: Penalaran rantai-augmmented rantai-pemikiran pada model bahasa besar berbasis obrolan. Zhipeng Chen (Renmin University of China) et al. arxiv. [kertas] [kode]

- [2023/05] Voyager: Agen terwujud terbuka dengan model bahasa besar. Guanzhi Wang (Nvidia) et al. arxiv. [kertas] [halaman proyek] [kode]

- [2023/03] Obrolan dengan lingkungan: Persepsi multimodal interaktif menggunakan model bahasa besar. Xufeng Zhao (University Hamburg) et al. arxiv. [kertas] [kode]

- [2022/12] LLM-Planner: beberapa perencanaan ground untuk agen yang diwujudkan dengan model bahasa besar. Lagu Chan Hee (The Ohio State University) et al. arxiv. [kertas] [kode]

- [2022/10] Bereaksi: Sinergis penalaran dan akting dalam model bahasa. Shunyu Yao (Universitas Princeton) et al. arxiv. [kertas] [kode]

- [2022/07] Monolog dalam: Penalaran yang diwujudkan melalui perencanaan dengan model bahasa. Wenlong Huang (Robotika di Google) et al. arxiv. [kertas] [kode]

- [2021/10] Rantai AI: Interaksi manusia-AI yang transparan dan dapat dikendalikan dengan merantai model bahasa besar. Tongshuang Wu (University of Washington) et al. arxiv. [kertas]

1.1.5 transferabilitas dan generalisasi

Generalisasi tugas yang tidak terlihat

- [2024/06] Agen: Mengembangkan agen berbasis model bahasa besar di berbagai lingkungan. Zhiheng XI (Universitas Fudan) et al. arxiv. [Kertas] [Halaman Proyek] [Kode dan Platform] [Dataset] [Benchmark] [Model].

- [2023/10] AgenTuning: Mengaktifkan kemampuan agen umum untuk LLMS. Aohan Zeng (Universitas Tsinghua) et al. arxiv. [kertas] [halaman proyek] [kode] [dataset]

- [2023/10] Lemur: Menyelaraskan bahasa alami dan kode untuk agen bahasa Yiheng Xu (University of Hong Kong) et al. arxiv. [kertas] [kode]

- [2023/05] Model bahasa pelatihan untuk mengikuti instruksi dengan umpan balik manusia. Long Ouyang et al. Neurips. [kertas]

- Instruktur: Menyelaraskan model bahasa dengan niat pengguna pada berbagai tugas dengan menyempurnakan dengan umpan balik manusia.

- [2023/01] Multitask memicu pelatihan memungkinkan generalisasi tugas zero-shot. Victor Sanh et al. Iclr. [kertas] [kode]

- T0: T0 adalah model encoder-decoder yang mengkonsumsi input tekstual dan menghasilkan respons target. Ini dilatih pada campuran multitask dari kumpulan data NLP yang dipartisi ke dalam tugas yang berbeda.

- [2022/10] Penskalaan Model Bahasa Instruksi-Finetuned. Hyung memenangkan Chung et al. arxiv. [kertas] [kode]

- Pekerjaan ini mengeksplorasi instruksi finetuning dengan fokus khusus pada penskalaan jumlah tugas dan ukuran model, yang meningkatkan kinerja pada berbagai kelas model, mendorong pengaturan, dan tolok ukur evaluasi.

- [2022/08] Model bahasa finetuned adalah pelajar zero-shot. Jason Wei et al. Iclr. [kertas]

- FLAN: Penyetelan instruksi secara substansial meningkatkan kinerja nol-shot pada tugas yang tidak terlihat.

Pembelajaran dalam konteks

- [2023/08] Gambar berbicara dalam gambar: pelukis generalis untuk pembelajaran visual dalam konteks. Xinlong Wang et al. IEEE. [kertas] [kode]

- Painter: Karya ini menyajikan model generalis untuk pembelajaran visual dalam konteks dengan solusi "gambar" -Sentrik.

- [2023/08] Model bahasa codec saraf adalah teks nol-shot untuk synthesizer ucapan. Chengyi Wang et al. arxiv. [kertas] [kode]

- Vall-E: Pekerjaan ini melatih model bahasa Codec saraf, yang muncul dalam kemampuan pembelajaran dalam konteks.

- [2023/07] Survei untuk pembelajaran dalam konteks. Qingxiu Dong et al. arxiv. [kertas]

- Survei ini merangkum kemajuan dan tantangan pembelajaran dalam konteks (ICL).

- [2023/05] Model bahasa adalah pelajar beberapa shot. Tom B. Brown (Openai) et al. Neurips. [kertas]

- GPT-3: Meningkatkan model bahasa sangat meningkatkan kinerja tugas-agnostik, beberapa shot, kadang-kadang bahkan menjadi kompetitif dengan pendekatan penyesuaian canggih sebelumnya.

Pembelajaran berkelanjutan

- [2023/11] Jarvis-1: agen multi-tugas-dunia terbuka dengan model bahasa multimodal yang beraugentasikan memori. Zihao Wang (Universitas Peking) et al. arxiv. [kertas] [kode]

- [2023/07] Prompt progresif: Pembelajaran berkelanjutan untuk model bahasa. RAZDaibiedina et al. arxiv. [kertas]

- Karya ini memperkenalkan prompt progresif, yang memungkinkan transfer ke depan dan menolak lupa bencana, tanpa mengandalkan pemutaran ulang data atau sejumlah besar parameter khusus tugas.

- [2023/05] Voyager: Agen terwujud terbuka dengan model bahasa besar. Guanzhi Wang (Nvidia) et al. arxiv. [kertas] [halaman proyek] [kode]

- Voyager: Ini adalah contoh dari agen pembelajaran seumur hidup yang diwujudkan LLM di Minecraft yang terus mengeksplorasi dunia, memperoleh beragam keterampilan, dan membuat penemuan baru tanpa intervensi manusia.

- [2023/01] Survei komprehensif pembelajaran berkelanjutan: teori, metode dan aplikasi. Liyuan Wang et al. arxiv. [kertas]

- Survei ini menyajikan survei komprehensif tentang pembelajaran berkelanjutan, berusaha menjembatani pengaturan dasar, yayasan teoritis, metode representatif, dan aplikasi praktis.

- [2022/11] Pembelajaran berkelanjutan dari tugas pemrosesan bahasa alami: survei. Zixuan Ke et al. arxiv. [kertas]

- Survei ini menyajikan tinjauan komprehensif dan analisis kemajuan CL baru -baru ini di NLP.

1.2 Persepsi: Input multimodal untuk agen berbasis LLM

1.2.1 Visual

- [2024/01] Agen AI: Survei cakrawala interaksi multimodal. Zane Durante et al. arxiv. [kertas]

- [2023/10] Menuju pengambilan keputusan yang diwujudkan secara end-to-end melalui model bahasa besar multi-modal: Eksplorasi dengan GPT4-Vision dan di luar Liang Chen et al. arxiv. [kertas] [kode]

- [2023/05] Bahasa tidak semua yang Anda butuhkan: Menyelaraskan persepsi dengan model bahasa. Shaohan Huang et al. arxiv. [kertas]

- [2023/05] Instruktur: Menuju Model Bahasa Visi General-Purpose dengan penyetelan instruksi. Wenliang Dai et al. arxiv. [kertas]

- [2023/05] Multimodal-GPT: Model visi dan bahasa untuk dialog dengan manusia. Tao Gong et al. arxiv. [kertas]

- [2023/05] Pandagpt: Satu model untuk mengikuti instruksi-ikuti semuanya. Yixuan Su et al. arxiv. [kertas]

- [2023/04] Tuning Instruksi Visual. Haotian Liu et al. arxiv. [kertas]

- [2023/04] MINIGPT-4: Meningkatkan pemahaman bahasa penglihatan dengan model bahasa besar canggih. Deyao zhu. arxiv. [kertas]

- [2023/01] BLIP-2: Bootstrapping-Image-Image Pre-Training dengan encoder gambar beku dan model bahasa besar. Junnan Li et al. arxiv. [kertas]

- [2022/04] Flamingo: Model Bahasa Visual untuk Pembelajaran Beberapa-Shot. Jean-Baptiste Alayrac et al. arxiv. [kertas]

- [2021/10] MobileVit: Light-Weight, General-Purpose, dan Mobile-Friendly Vision Transformer. Sachin Mehta et al.arxiv. [kertas]

- [2021/05] MLP-Mixer: Arsitektur All-MLP untuk Visi. Ilya Tolstikhin et al.arxiv. [kertas]

- [2020/10] Suatu gambar bernilai 16x16 kata: Transformers untuk pengenalan gambar pada skala. Alexey Dosovitskiy et al. arxiv. [kertas]

- [2017/11] Pembelajaran representasi diskrit saraf. Aaron Van Den Oord et al. arxiv. [kertas]

1.2.2 Audio

- [2023/06] Video-llama: Model bahasa audio-visual yang disesuaikan dengan instruksi untuk pemahaman video. Hang Zhang et al. arxiv. [kertas]

- [2023/05] X-LLM: Bootstrap Model Bahasa Besar Lanjutan dengan memperlakukan multi-modalitas sebagai bahasa asing. Feilong Chen et al. arxiv. [kertas]

- [2023/05] InternGPT: Memecahkan tugas visi-sentris dengan berinteraksi dengan chatgpt di luar bahasa. Zhaoyang Liu et al. arxiv. [kertas]

- [2023/04] Audiogpt: Memahami dan Menghasilkan Pidato, Musik, Suara, dan Kepala Talking. Rongjie Huang et al. arxiv. [kertas]

- [2023/03] HUGGINGGPT: Memecahkan tugas AI dengan chatgpt dan teman -temannya di wajah pelukan. Yongliang Shen et al. arxiv. [kertas]

- [2021/06] Hubert: Pembelajaran representasi pidato swadaya dengan prediksi bertopeng unit tersembunyi. Wei-Ning Hsu et al. arxiv. [kertas]

- [2021/04] AST: transformator spektrogram audio. Yuan Gong et al. arxiv. [kertas]

1.3 Tindakan: Perluas Ruang Tindakan Agen Berbasis LLM

1.3.1 menggunakan alat

- [2024/02] Menuju agen bahasa yang tidak pasti-sadar. Jiuzhou Han (Universitas Monash) et al. arxiv. [kertas] [halaman proyek] [kode]

- [2023/10] OpenAgents: Platform terbuka untuk agen bahasa di alam liar. Xlang Lab (University of Hong Kong) Arxiv. [kertas] [halaman proyek] [kode] [demo]

- [2023/10] Lemur: Menyelaraskan bahasa alami dan kode untuk agen bahasa Yiheng Xu (University of Hong Kong) et al. arxiv. [kertas] [kode]

- [2023/10] Menuju pengambilan keputusan yang diwujudkan secara end-to-end melalui model bahasa multi-modal: Eksplorasi dengan GPT4-Vision dan di luar Liang Chen (Universitas Peking) et al. arxiv. [kertas] [kode]

- Holmes adalah kerangka kerja kerja sama multi-agen yang memungkinkan LLM untuk memanfaatkan MLLM dan API untuk mengumpulkan informasi multimodal untuk pengambilan keputusan yang diinformasikan.

- [2023/07] TOOLLLM: Memfasilitasi model bahasa besar untuk menguasai 16000+ API dunia nyata. Yujia Qin (Universitas Tsinghua) et al. arxiv. [kertas] [kode] [dataset]

- TOOLLLM adalah kerangka kerja penggunaan alat umum yang mencakup konstruksi data, pelatihan model dan evaluasi.

- [2023/05] Model bahasa besar sebagai pembuat alat. Tianle Cai (Universitas Princeton) et al. arxiv. [kertas] [kode]

- LATM adalah kerangka kerja loop tertutup yang mengambil langkah awal untuk menghilangkan ketergantungan pada ketersediaan alat yang ada.

- [2023/05] Pencipta: Disentangling Alasan abstrak dan konkret dari model bahasa besar melalui pembuatan alat. Cheng Qian (Universitas Tsinghua) et al. arxiv. [kertas]

- Pencipta adalah kerangka kerja baru yang memberdayakan LLMS untuk membuat alat mereka sendiri melalui dokumentasi dan realisasi kode.

- [2023/04] Pembelajaran alat dengan model dasar. Yujia Qin (Universitas Tsinghua) et al. arxiv. [kertas] [kode]

- Survei ini terutama memperkenalkan paradigma baru yang disebut "pembelajaran alat berdasarkan model dasar", yang menggabungkan keunggulan alat khusus dan model dasar, mencapai presisi, efisiensi, dan otomatisasi yang lebih tinggi dalam pemecahan masalah.

- [2023/04] Chemcrow: Menambah model bahasa besar dengan alat kimia. Andres M Bran (Laboratorium Kecerdasan Kimia Buatan, ISIC, EPFL) et al. arxiv. [kertas] [kode]

- ChemCrow adalah agen kimia LLM yang mengintegrasikan 13 alat yang dirancang oleh ahli dan menambah kinerja LLM dalam kimia dan muncul kemampuan baru.

- [2023/04] Genegpt: Menambah model bahasa besar dengan alat domain untuk meningkatkan akses ke informasi biomedis. Qiao Jin (Institut Kesehatan Nasional), Yifan Yang, Qingyu Chen, Zhiyong Lu. arxiv. [kertas] [kode]

- Genegpt adalah model yang menjawab pertanyaan genomik. Ini memperkenalkan metode baru untuk menangani tantangan dengan halusinasi dengan mengajar LLM untuk menggunakan API Web.

- [2023/04] Openagi: Ketika LLM bertemu dengan para ahli domain. Yingqiang GE (Universitas Rutgers) et al. arxiv. [kertas] [kode]

- Openagi adalah platform penelitian AGI open-source. Ini memperkenalkan paradigma LLMS yang mengoperasikan berbagai model ahli untuk pemecahan tugas yang kompleks dan mengusulkan mekanisme RLTF untuk meningkatkan kemampuan penyelesaian tugas LLM.

- [2023/03] HUGGINGGPT: Memecahkan tugas AI dengan chatgpt dan teman -temannya di wajah pelukan. Yongliang Shen (Universitas Zhejiang) et al. arxiv. [kertas] [kode]

- HuggingGpt adalah sistem yang memanfaatkan LLM untuk menghubungkan berbagai model AI multimodal di komunitas pembelajaran mesin untuk menyelesaikan tugas AI.

- [2023/03] Visual Chatgpt: Berbicara, Menggambar dan Mengedit dengan Model Foundation Visual. Chenfei Wu (Microsoft Research Asia) et al. arxiv. [kertas] [kode]

- Visual ChatGPT adalah sistem yang membuka pintu untuk menyelidiki peran visual chatgpt dengan bantuan model visual foundation.

- [2023/02] Augmented Bahasa Model: Survei. Grégoire Mialon (Meta AI) et al. Tmlr. [kertas]

- Ulasan survei ini berfungsi di mana LMS ditambah dengan kemampuan menggunakan alat. Augmented LMS dapat menggunakan modul eksternal untuk memperluas kemampuan pemrosesan konteksnya.

- [2023/02] ToolFormer: Model bahasa dapat mengajar diri mereka sendiri untuk menggunakan alat. Timo Schick (Meta AI) et al. arxiv. [kertas]

- ToolFormer menunjukkan bahwa LLMS dapat mengajar diri mereka sendiri untuk menggunakan alat eksternal dengan beberapa demonstrasi untuk setiap API.

- [2022/05] TALM: Alat Augmented Bahasa Model. Aaron Parisi (Google) et al. arxiv. [kertas]

- Talm memperkenalkan metode yang menggabungkan alat yang tidak dapat dibedakan dengan LMS, memungkinkan model untuk mengakses data waktu nyata atau pribadi.

- [2022/05] Sistem MRKL: Arsitektur modular, simbolik simbolik yang menggabungkan model bahasa besar, sumber pengetahuan eksternal, dan penalaran diskrit. Ehud Karpas (AI21 Labs) et al. arxiv. [kertas]

- Sistem MRKL menambah LLM dengan serangkaian pengetahuan eksternal dan modul penalaran yang mudah diperluas.

- [2022/04] lakukan semampu saya, bukan seperti yang saya katakan: bahasa landasan dalam biaya robot. Michael Ahn (Google) et al. Corl. [kertas]

- Saycan menerapkan LMS dalam tugas robot dunia nyata dengan menggabungkan pengetahuan semantik canggih dari LLMS dengan fungsi nilai keterampilan pra-terlatih.

- [2021/12] WebGPT: Permintaan yang dibantu oleh browser dengan umpan balik manusia. Reiichiro Nakano (Openai) et al. arxiv. [kertas]

- Webgpt menjawab pertanyaan menggunakan lingkungan webbrowsing. Ini menggunakan pembelajaran imitasi selama pelatihan dan kemudian mengoptimalkan kualitas jawaban melalui umpan balik manusia.

- [2021/07] Mengevaluasi model bahasa besar yang dilatih pada kode. Mark Chen (Openai) et al. arxiv. [kertas] [kode]

- Codex dapat mensintesis program dari Docstrings, yaitu membuat alat berdasarkan dokumentasi.

1.3.2 Tindakan yang diwujudkan

- [2023/12] Menuju belajar model generalis untuk navigasi yang diwujudkan. Duo Zheng (Universitas Cina Hong Kong) et al. arxiv. [kertas] [kode]

- [2023/11] Agen generalis yang diwujudkan di dunia 3d. Jiangyong Huang (Bigai & Peking University) et al. arxiv. [Kertas] [Halaman Proyek]

- [2023/11] Jarvis-1: agen multi-tugas-dunia terbuka dengan model bahasa multimodal yang beraugentasikan memori. Zihao Wang (Universitas Peking) et al. arxiv. [kertas] [kode]

- [2023/10] Lemur: Menyelaraskan bahasa alami dan kode untuk agen bahasa Yiheng Xu (University of Hong Kong) et al. arxiv. [kertas] [kode]

- [2023/10] Menuju pengambilan keputusan yang diwujudkan secara end-to-end melalui model bahasa besar multi-modal: Eksplorasi dengan GPT4-Vision dan di luar Liang Chen et al. arxiv. [kertas] [kode]

- [2023/07] Bahasa interaktif: Berbicara dengan robot secara real time. Corey Lynch et al. IEEE (RAL) [kertas]

- [2023/05] Voyager: Agen terwujud terbuka dengan model bahasa besar. Guanzhi Wang (Nvidia) et al. arxiv. [kertas] [halaman proyek] [kode]

- [2023/05] Avlen: navigasi yang diwujudkan oleh bahasa-visual di lingkungan 3D. Sudipta Paul et al. Neurips. [kertas]

- [2023/05] Diwujudkan: pra-pelatihan-penglihatan melalui rantai pemikiran yang diwujudkan. Yao Mu et al. Arxiv [kertas] [kode]

- [2023/05] NAVGPT: Penalaran eksplisit dalam navigasi penglihatan dan bahasa dengan model bahasa besar. Jengze Zhou et al. Arxiv [kertas]

- [2023/05] Alphablock: Finetuning yang diwujudkan untuk penalaran bahasa penglihatan dalam manipulasi robot. Chuhao Jin et al. Arxiv [kertas]

- [2023/03] Palm-E: Model bahasa multimodal yang diwujudkan. Danny Driess et al. Arxiv. [kertas]

- [2023/03] Refleksi: Agen bahasa dengan pembelajaran penguatan verbal. Nuh Shinn et al. Arxiv [paper] [code]

- [2023/02] Collaborating with language models for embodied reasoning. Ishita Dasgupta et al. Arxiv. [kertas]

- [2023/02] Code as Policies: Language Model Programs for Embodied Control. Jacky Liang et al. IEEE (ICRA). [kertas]

- [2022/10] ReAct: Synergizing Reasoning and Acting in Language Models. Shunyu Yao et al. Arxiv [paper] [code]

- [2022/10] Instruction-Following Agents with Multimodal Transformer. Hao Liu et al. CVPR [paper] [code]

- [2022/07] Inner Monologue: Embodied Reasoning through Planning with Language Models. Wenlong Huang et al. Arxiv. [kertas]

- [2022/07] LM-Nav: Robotic Navigation with Large Pre-Trained Models of Language, Vision, and Action. Dhruv Shahet al. CoRL [paper] [code]

- [2022/04] Do As I Can, Not As I Say: Grounding Language in Robotic Affordances. Michael Ahn et al. Arxiv. [kertas]

- [2022/01] A Survey of Embodied AI: From Simulators to Research Tasks. Jiafei Duan et al. IEEE (TETCI). [kertas]

- [2022/01] Language Models as Zero-Shot Planners: Extracting Actionable Knowledge for Embodied Agents. Wenlong Huang et al. Arxiv. [kertas] [kode]

- [2020/04] Experience Grounds Language. Yonatan Bisk et al. EMNLP [paper]

- [2019/03] Review of Deep Reinforcement Learning for Robot Manipulation. Hai Nguyen et al. IEEE (IRC). [kertas]

- [2005/01] The Development of Embodied Cognition: Six Lessons from Babies. Linda Smith et al. Artificial Life. [kertas]

2. Agents in Practice: Applications of LLM-based Agents

2.1 General Ability of Single Agent

2.1.1 Task-oriented Deployment

In web scenarios

- [2023/10] OpenAgents: An Open Platform for Language Agents in the Wild. XLang Lab (The University of Hong Kong) arXiv. [paper] [project page] [code] [demo]

- [2023/07] WebArena: A Realistic Web Environment for Building Autonomous Agents. Shuyan Zhou (CMU) et al. arXiv. [kertas] [kode]

- [2023/07] A Real-World WebAgent with Planning, Long Context Understanding, and Program Synthesis. Izzeddin Gur (DeepMind) et al. arXiv. [kertas]

- [2023/06] SYNAPSE: Leveraging Few-Shot Exemplars for Human-Level Computer Control. Longtao Zheng (Nanyang Technological University) et al. arXiv. [kertas] [kode]

- [2023/06] Mind2Web: Towards a Generalist Agent for the Web. Xiang Deng (The Ohio State University) et al. arXiv. [kertas] [kode]

- [2023/05] Multimodal Web Navigation with Instruction-Finetuned Foundation Models. Hiroki Furuta (The University of Tokyo) et al. arXiv. [kertas]

- [2023/03] Language Models can Solve Computer Tasks. Geunwoo Kim (University of California) et al. arXiv. [kertas] [kode]

- [2022/07] WebShop: Towards Scalable Real-World Web Interaction with Grounded Language Agents. Shunyu Yao (Princeton University) et al. arXiv. [kertas] [kode]

- [2021/12] WebGPT: Browser-assisted question-answering with human feedback. Reiichiro Nakano (OpenAI) et al. arXiv. [kertas]

- [2023/05] Agents: An Open-source Framework for Autonomous Language Agents. Wangchunshu Zhou (AIWaves) et al. arXiv. [kertas] [kode]

- [2024/04] OSWorld: Benchmarking Multimodal Agents for Open-Ended Tasks in Real Computer Environments. XLang Lab (The University of Hong Kong) arXiv. [paper] [project page] [code] [data viewer]

In life scenarios

- [2023/10] OpenAgents: An Open Platform for Language Agents in the Wild. XLang Lab (The University of Hong Kong) arXiv. [paper] [project page] [code] [demo]

- [2023/08] InterAct: Exploring the Potentials of ChatGPT as a Cooperative Agent. Po-Lin Chen et al. arXiv. [kertas]

- [2023/05] Plan, Eliminate, and Track -- Language Models are Good Teachers for Embodied Agents. Yue Wu (CMU) et al. arXiv. [kertas]

- [2023/05] Augmenting Autotelic Agents with Large Language Models. Cédric Colas (MIT) et al. arXiv. [kertas]

- [2023/03] Planning with Large Language Models via Corrective Re-prompting. Shreyas Sundara Raman (Brown University) et al. arXiv. [kertas]

- [2022/10] Generating Executable Action Plans with Environmentally-Aware Language Models. Maitrey Gramopadhye (University of North Carolina at Chapel Hill) et al. arXiv. [kertas] [kode]

- [2022/01] Language Models as Zero-Shot Planners: Extracting Actionable Knowledge for Embodied Agents. Wenlong Huang (UC Berkeley) et al. arXiv. [kertas] [kode]

2.1.2 Innovation-oriented Deployment

- [2023/10] OpenAgents: An Open Platform for Language Agents in the Wild. XLang Lab (The University of Hong Kong) arXiv. [paper] [project page] [code] [demo]

- [2023/08] The Hitchhiker's Guide to Program Analysis: A Journey with Large Language Models. Haonan Li (UC Riverside) et al. arXiv. [kertas]

- [2023/08] ChatMOF: An Autonomous AI System for Predicting and Generating Metal-Organic Frameworks. Yeonghun Kang (Korea Advanced Institute of Science and Technology) et al. arXiv. [kertas]

- [2023/07] Math Agents: Computational Infrastructure, Mathematical Embedding, and Genomics. Melanie Swan (University College London) et al. arXiv. [kertas]

- [2023/06] Towards Autonomous Testing Agents via Conversational Large Language Models. Robert Feldt (Chalmers University of Technology) et al. arXiv. [kertas]

- [2023/04] Emergent autonomous scientific research capabilities of large language models. Daniil A. Boiko (CMU) et al. arXiv. [kertas]

- [2023/04] ChemCrow: Augmenting large-language models with chemistry tools. Andres M Bran (Laboratory of Artificial Chemical Intelligence, ISIC, EPFL) et al. arXiv. [kertas] [kode]

- [2022/03] ScienceWorld: Is your Agent Smarter than a 5th Grader? Ruoyao Wang (University of Arizona) et al. arXiv. [kertas] [kode]

2.1.3 Lifecycle-oriented Deployment

- [2023/05] Voyager: An Open-Ended Embodied Agent with Large Language Models. Guanzhi Wang (NVIDIA) et al. arXiv. [paper] [project page] [code]

- [2023/05] Ghost in the Minecraft: Generally Capable Agents for Open-World Environments via Large Language Models with Text-based Knowledge and Memory. Xizhou Zhu (Tsinghua University) et al. arXiv. [kertas] [kode]

- [2023/03] Plan4MC: Skill Reinforcement Learning and Planning for Open-World Minecraft Tasks. Haoqi Yuan (PKU) et al. arXiv. [paper] [project page]

- [2023/02] Describe, Explain, Plan and Select: Interactive Planning with Large Language Models Enables Open-World Multi-Task Agents. Zihao Wang (PKU) et al. arXiv. [kertas] [kode]

- [2023/01] Do Embodied Agents Dream of Pixelated Sheep: Embodied Decision Making using Language Guided World Modelling. Kolby Nottingham (University of California Irvine, Irvine) et al. arXiv. [kertas] [kode]

2.2 Coordinating Potential of Multiple Agents

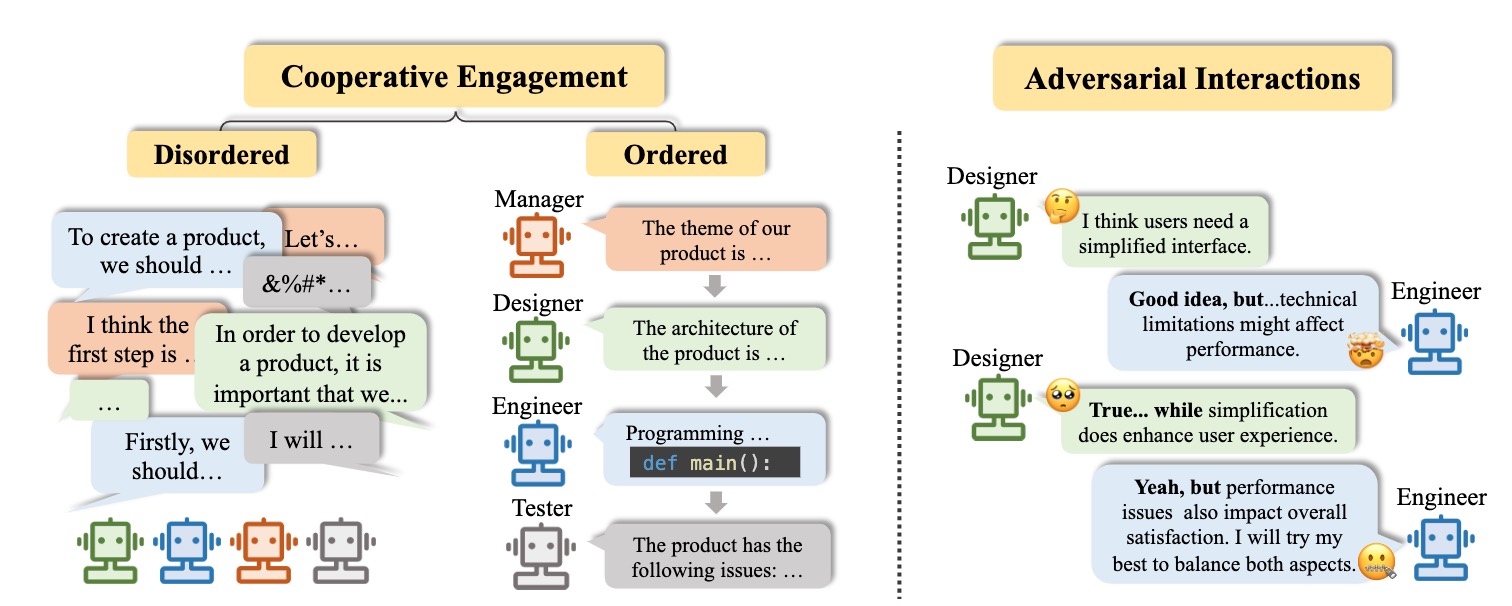

2.2.1 Cooperative Interaction for Complementarity

Disordered cooperation

- [2023/07] Unleashing Cognitive Synergy in Large Language Models: A Task-Solving Agent through Multi-Persona Self-Collaboration. Zhenhailong Wang (University of Illinois Urbana-Champaign) et al. arXiv. [kertas] [kode]

- [2023/07] RoCo: Dialectic Multi-Robot Collaboration with Large Language Models. Zhao Mandi, Shreeya Jain, Shuran Song (Columbia University) et al. arXiv. [kertas] [kode]

- [2023/04] ChatLLM Network: More brains, More intelligence. Rui Hao (Beijing University of Posts and Telecommunications) et al. arXiv. [kertas]

- [2023/01] Blind Judgement: Agent-Based Supreme Court Modelling With GPT. Sil Hamilton (McGill University). arXiv. [kertas]

- [2023/05] Agents: An Open-source Framework for Autonomous Language Agents. Wangchunshu Zhou (AIWaves) et al. arXiv. [kertas] [kode]

Ordered cooperation

- [2023/10] AutoAgents: A Framework for Automatic Agent Generation. Guangyao Chen (Peking University) et al. arXiv. [kertas] [kode]

- [2023/09] MindAgent: Emerging Gaming Interaction. Ran Gong (UCLA) et al. arXiv. [kertas] [kode]

- [2023/08] CGMI: Configurable General Multi-Agent Interaction Framework. Shi Jinxin (East China Normal University) et al. arXiv. [kertas]

- [2023/08] ProAgent: Building Proactive Cooperative AI with Large Language Models. Ceyao Zhang (The Chinese University of Hong Kong, Shenzhen) et al. arXiv. [kertas] [kode]

- [2023/08] AgentVerse: Facilitating Multi-Agent Collaboration and Exploring Emergent Behaviors in Agents. Weize Chen (Tsinghua University) et al. arXiv. [kertas] [kode]

- [2023/08] AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation Framework. Qingyun Wu (Pennsylvania State University ) et al. arXiv. [kertas] [kode]

- [2023/08] MetaGPT: Meta Programming for Multi-Agent Collaborative Framework. Sirui Hong (DeepWisdom) et al. arXiv. [kertas] [kode]

- [2023/07] Communicative Agents for Software Development. Chen Qian (Tsinghua University) et al. arXiv. [kertas] [kode]

- [2023/06] Multi-Agent Collaboration: Harnessing the Power of Intelligent LLM Agents. Yashar Talebira (University of Alberta) et al. arXiv. [kertas]

- [2023/05] Training Socially Aligned Language Models in Simulated Human Society. Ruibo Liu (Dartmouth College) et al. arXiv. [kertas] [kode]

- [2023/05] SwiftSage: A Generative Agent with Fast and Slow Thinking for Complex Interactive Tasks. Bill Yuchen Lin (Allen Institute for Artificial Intelligence) et al. arXiv. [kertas] [kode]

- [2023/05] ChatGPT as your Personal Data Scientist. Md Mahadi Hassan (Auburn University) et al. arXiv. [kertas]

- [2023/03] CAMEL: Communicative Agents for "Mind" Exploration of Large Scale Language Model Society. Guohao Li (King Abdullah University of Science and Technology) et al. arXiv. [kertas] [kode]

- [2023/03] DERA: Enhancing Large Language Model Completions with Dialog-Enabled Resolving Agents. Varun Nair (Curai Health) et al. arXiv. [kertas] [kode]

- [2023/04] Self-collaboration Code Generation via ChatGPT. Yihong Dong (Peking University) et al. arXiv. [kertas]

2.2.2 Adversarial Interaction for Advancement

- [2023/08] ChatEval: Towards Better LLM-based Evaluators through Multi-Agent Debate. Chi-Min Chan (Tsinghua University) et al. arXiv. [kertas] [kode]

- [2023/05] Improving Factuality and Reasoning in Language Models through Multiagent Debate. Yilun Du (MIT CSAIL) et al. arXiv. [kertas] [kode]

- [2023/05] Improving Language Model Negotiation with Self-Play and In-Context Learning from AI Feedback. Yao Fu (University of Edinburgh) et al. arXiv. [kertas] [kode]

- [2023/05] Examining the Inter-Consistency of Large Language Models: An In-depth Analysis via Debate. Kai Xiong (Harbin Institute of Technology) et al. arXiv. [kertas]

- [2023/05] Encouraging Divergent Thinking in Large Language Models through Multi-Agent Debate. Tian Liang (Tsinghua University) et al. arXiv. [kertas] [kode]

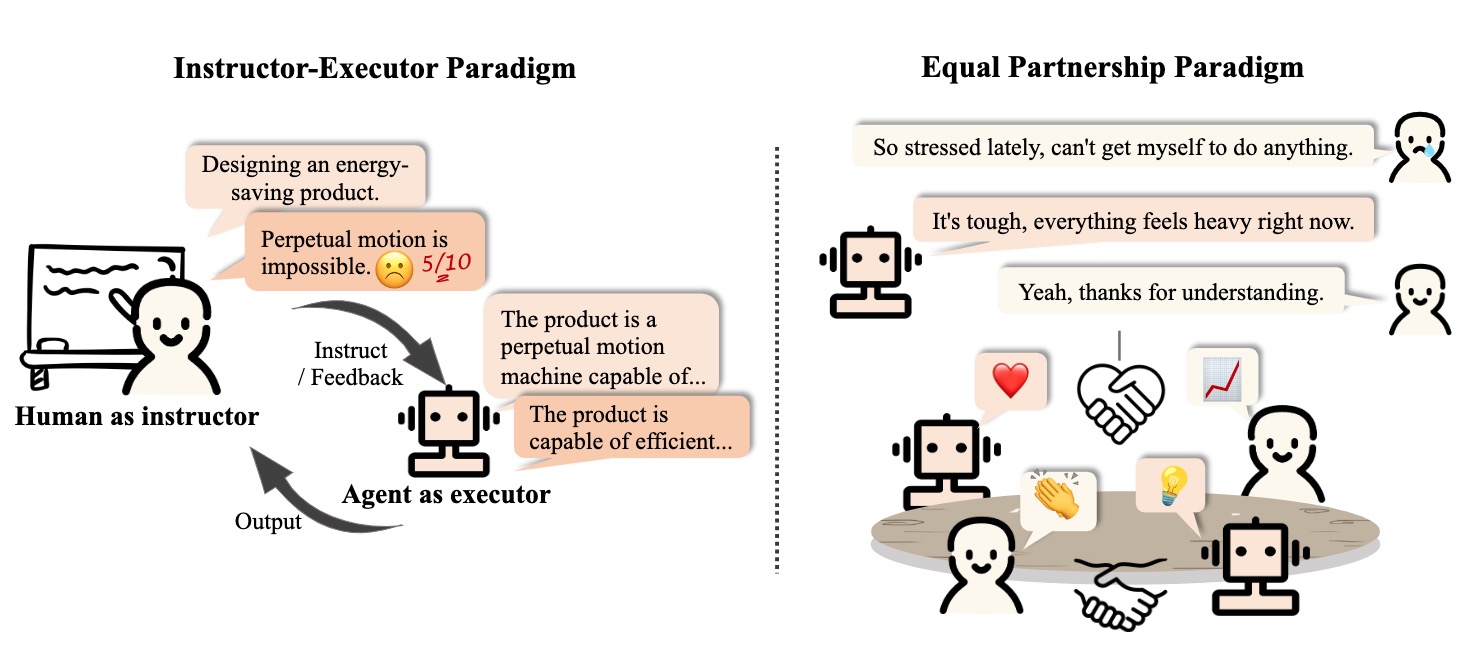

2.3 Interactive Engagement between Human and Agent

2.3.1 Instructor-Executor Paradigm

Pendidikan

- [2023/07] Math Agents: Computational Infrastructure, Mathematical Embedding, and Genomics. Melanie Swan (UCL) et al. arXiv. [kertas]

- Communicate with humans to help them understand and use mathematics.

- [2023/03] Hey Dona! Can you help me with student course registration? Vishesh Kalvakurthi (MSU) et al. arXiv. [kertas]

- This is a developed application called Dona that offers virtual voice assistance in student course registration, where humans provide instructions.

Kesehatan

- [2023/08] Zhongjing: Enhancing the Chinese Medical Capabilities of Large Language Model through Expert Feedback and Real-world Multi-turn Dialogue. Songhua Yang (ZZU) et al. arXiv. [kertas] [kode]

- [2023/05] HuatuoGPT, towards Taming Language Model to Be a Doctor. Hongbo Zhang (CUHK-SZ) et al. arXiv. [paper] [code] [demo]

- [2023/05] Helping the Helper: Supporting Peer Counselors via AI-Empowered Practice and Feedback. Shang-Ling Hsu (Gatech) et al. arXiv. [kertas]

- [2020/10] A Virtual Conversational Agent for Teens with Autism Spectrum Disorder: Experimental Results and Design Lessons. Mohammad Rafayet Ali (U of R) et al. IVA '20. [kertas]

Other Application

- [2023/08] RecMind: Large Language Model Powered Agent For Recommendation. Yancheng Wang (ASU, Amazon) et al. arXiv. [kertas]

- [2023/08] Multi-Turn Dialogue Agent as Sales' Assistant in Telemarketing. Wanting Gao (JNU) et al. IEEE. [kertas]

- [2023/07] PEER: A Collaborative Language Model. Timo Schick (Meta AI) et al. arXiv. [kertas]

- [2023/07] DIALGEN: Collaborative Human-LM Generated Dialogues for Improved Understanding of Human-Human Conversations. Bo-Ru Lu (UW) et al. arXiv. [kertas]

- [2023/08] LLM As DBA [vision]. Xuanhe Zhou (Tsinghua) et al. arXiv. [kertas]

- [2023/06] AssistGPT: A General Multi-modal Assistant that can Plan, Execute, Inspect, and Learn. Difei Gao (NUS) et al. arXiv. [kertas]

- [2023/05] Agents: An Open-source Framework for Autonomous Language Agents. Wangchunshu Zhou (AIWaves) et al. arXiv. [kertas] [kode]

- [2023/12] D-Bot: Database Diagnosis System using Large Language Models. Xuanhe Zhou (Tsinghua) et al. arXiv. [kertas] [kode]

2.3.2 Equal Partnership Paradigm

Empathetic Communicator

- [2023/08] SAPIEN: Affective Virtual Agents Powered by Large Language Models. Masum Hasan et al. arXiv. [paper] [project page]

- [2023/05] Helping the Helper: Supporting Peer Counselors via AI-Empowered Practice and Feedback. Shang-Ling Hsu (Gatech) et al. arXiv. [kertas]

- [2022/07] Artificial empathy in marketing interactions: Bridging the human-AI gap in affective and social customer experience. Yuping Liu‑Thompkins et al. [kertas]

Human-Level Participant

- [2023/08] Quantifying the Impact of Large Language Models on Collective Opinion Dynamics. Chao Li et al. CoRR. [kertas]

- [2023/06] Mastering the Game of No-Press Diplomacy via Human-Regularized Reinforcement Learning and Planning. Anton Bakhtin et al. ICLR. [kertas]

- [2023/06] Decision-Oriented Dialogue for Human-AI Collaboration. Jessy Lin et al. CoRR. [kertas]

- [2022/11] Human-level play in the game of Diplomacy by combining language models with strategic reasoning. FAIR et al. Sains. [kertas]

3. Agent Society: From Individuality to Sociality

3.1 Behavior and Personality of LLM-based Agents

3.1.1 Social Behavior

Individual behaviors

- [2023/10] Lyfe Agents: Generative agents for low-cost real-time social interactions. Zhao Kaiya (MIT) et al. arXiv. [kertas]

- [2023/05] Voyager: An Open-Ended Embodied Agent with Large Language Models. Guanzhi Wang (NVIDIA) et al. arXiv. [paper] [code] [project page]

- [2023/04] LLM+P: Empowering Large Language Models with Optimal Planning Proficiency. Bo Liu (University of Texas) et al. arXiv. [kertas] [kode]

- [2023/03] Reflexion: Language Agents with Verbal Reinforcement Learning. Noah Shinn (Northeastern University) et al. arXiv. [kertas] [kode]

- [2023/03] PaLM-E: An Embodied Multimodal Language Model. Danny Driess (Google) et al. ICML. [paper] [project page]

- [2023/03] ReAct: Synergizing Reasoning and Acting in Language Models. Shunyu Yao (Princeton University) et al. ICLR. [paper] [project page]

- [2022/01] Chain-of-thought prompting elicits reasoning in large language models. Jason Wei (Google) et al. NeurIPS. [kertas]

Group behaviors

[2023/10] Exploring Collaboration Mechanisms for LLM Agents: A Social Psychology View. Jintian Zhang (Zhejiang University) et al. arXiv. [kertas] [kode]

[2023/09] MindAgent: Emerging Gaming Interaction. Ran Gong (UCLA) et al. arXiv. [kertas] [kode]

[2023/09] Exploring Large Language Models for Communication Games: An Empirical Study on Werewolf. Yuzhuang Xu (Tsinghua University) et al. arXiv. [kertas]

[2023/09] Suspicion Agent: Playing Imperfect Information Games with Theory of Mind Aware GPT-4 Jiaxian Gu oet al. arXiv. [kertas]

[2023/08] AgentVerse: Facilitating Multi-Agent Collaboration and Exploring Emergent Behaviors in Agents. Weize Chen (Tsinghua University) et al. arXiv. [kertas] [kode]

[2023/08] AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation Framework. Qingyun Wu (Pennsylvania State University) et al. arXiv. [kertas] [kode]

[2023/08] ChatEval: Towards Better LLM-based Evaluators through Multi-Agent Debate. Chi-Min Chan (Tsinghua University) et al. arXiv. [kertas] [kode]

[2023/07] Communicative Agents for Software Development. Chen Qian (Tsinghua University) et al. arXiv. [kertas] [kode]

[2023/07] RoCo: Dialectic Multi-Robot Collaboration with Large Language Models. Zhao Mandi, Shreeya Jain, Shuran Song (Columbia University) et al. arXiv. [kertas] [kode]

[2023/08] ProAgent: Building Proactive Cooperative AI with Large Language Models. Ceyao Zhang (The Chinese University of Hong Kong, Shenzhen) et al. arXiv. [kertas] [kode]

[2023/06] Homophily in An Artificial Social Network of Agents Powered By Large Language Models. James K. He (University of Cambridge) et al. PsyArXiv. [kertas]

3.1.2 Personality

Pengartian

- [2023/09] Suspicion Agent: Playing Imperfect Information Games with Theory of Mind Aware GPT-4 Jiaxian Gu oet al. arXiv. [kertas]

- [2023/03] Machine Psychology: Investigating Emergent Capabilities and Behavior in Large Language Models Using Psychological Methods. Thilo Hagendorff (University of Stuttgart) et al. arXiv. [kertas]

- [2023/03] Mind meets machine: Unravelling GPT-4's cognitive psychology. Sifatkaur Dhingra (Nowrosjee Wadia College) et al. arXiv. [kertas]

- [2022/07] Language models show human-like content effects on reasoning. Ishita Dasgupta (DeepMind) et al. arXiv. [kertas]

- [2022/06] Using cognitive psychology to understand GPT-3. Marcel Binz et al. arXiv. [kertas]

Emosi

- [2023/07] Emotional Intelligence of Large Language Models. Xuena Wang (Tsinghua University) et al. arXiv. [kertas]

- [2023/05] ChatGPT outperforms humans in emotional awareness evaluations. Zohar Elyoseph et al. Frontiers in Psychology. [kertas]

- [2023/02] Empathetic AI for Empowering Resilience in Games. Reza Habibi (University of California) et al. arXiv. [kertas]

- [2022/12] Computer says “No”: The Case Against Empathetic Conversational AI. Alba Curry (University of Leeds) et al. ACL. [kertas]

Karakter

- [2024/05] TimeChara: Evaluating Point-in-Time Character Hallucination of Role-Playing Large Language Models. Jaewoo Ahn (Seoul National University) et al. arXiv. [kertas] [kode]

- [2023/10] Character-LLM: A Trainable Agent for Role-Playing. Yunfan Shao (Fudan University) et al. arXiv. [kertas] [kode]

- [2023/07] Do LLMs Possess a Personality? Making the MBTI Test an Amazing Evaluation for Large Language Models. Keyu Pan (ByteDance) et al. arXiv. [kertas] [kode]

- [2023/07] Personality Traits in Large Language Models. Mustafa Safdari (DeepMind) et al. arXiv. [kertas] [kode]

- [2022/12] Does GPT-3 Demonstrate Psychopathy? Evaluating Large Language Models from a Psychological Perspective. Xingxuan Li (Alibaba) et al. arXiv. [kertas]

- [2022/12] Identifying and Manipulating the Personality Traits of Language Models. Graham Caron et al. arXiv. [kertas]

3.2 Environment for Agent Society

3.2.1 Text-based Environment

- [2023/08] Hoodwinked: Deception and Cooperation in a Text-Based Game for Language Models. Aidan O'Gara (University of Southern California) et al. arXiv. [kertas] [kode]

- [2023/03] CAMEL: Communicative Agents for "Mind" Exploration of Large Scale Language Model Society. Guohao Li (King Abdullah University of Science and Technology) et al. arXiv. [kertas] [kode]

- [2020/12] Playing Text-Based Games with Common Sense. Sahith Dambekodi (Georgia Institute of Technology) et al. arXiv. [kertas]

- [2019/09] Interactive Fiction Games: A Colossal Adventure. Matthew Hausknecht (Microsoft Research) et al. AAAI. [kertas] [kode]

- [2019/03] Learning to Speak and Act in a Fantasy Text Adventure Game. Jack Urbanek (Facebook) et al. ACL. [kertas] [kode]

- [2018/06] TextWorld: A Learning Environment for Text-based Games. Marc-Alexandre Côté (Microsoft Research) et al. IJCAI. [kertas] [kode]

3.2.2 Virtual Sandbox Environment

- [2023/11] JARVIS-1: Open-world Multi-task Agents with Memory-Augmented Multimodal Language Models. ZiHao Wang (Peking University) et al. arXiv. [kertas] [kode]

- [2023/10] Humanoid Agents: Platform for Simulating Human-like Generative Agents. Zhilin Wang (University of Washington and NVIDIA) et al. arXiv. [paper] [code] [demo]

- [2023/08] AgentSims: An Open-Source Sandbox for Large Language Model Evaluation. Jiaju Lin (PTA Studio) et al. arXiv. [paper] [project page] [code]

- [2023/05] Training Socially Aligned Language Models in Simulated Human Society. Ruibo Liu (Dartmouth College) et al. arXiv. [kertas] [kode]

- [2023/05] Voyager: An Open-Ended Embodied Agent with Large Language Models. Guanzhi Wang (NVIDIA) et al. arXiv. [paper] [project page] [code]

- [2023/04] Generative Agents: Interactive Simulacra of Human Behavior. Joon Sung Park (Stanford University) et al. arXiv. [kertas] [kode]

- [2023/03] Plan4MC: Skill Reinforcement Learning and Planning for Open-World Minecraft Tasks. Haoqi Yuan (PKU) et al. arXiv. [paper] [project page]

- [2022/06] MineDojo: Building Open-Ended Embodied Agents with Internet-Scale Knowledge. Linxi Fan (NVIDIA) et al. NeurIPS. [paper] [project page]

3.2.3 Physical Environment

- [2023/11] An Embodied Generalist Agent in 3D World. Jiangyong Huang (BIGAI & Peking University) et al. arXiv. [paper] [project page]

- [2023/09] RoboAgent: Generalization and Efficiency in Robot Manipulation via Semantic Augmentations and Action Chunking. Homanga Bharadhwaj (Carnegie Mellon University) et al. arXiv. [paper] [project page]

- [2023/05] AVLEN: Audio-Visual-Language Embodied Navigation in 3D Environments. Sudipta Paul et al. NeurIPS. [kertas]

- [2023/03] PaLM-E: An Embodied Multimodal Language Model. Danny Driess (Google) et al. ICML. [paper] [project page]

- [2022/10] Interactive Language: Talking to Robots in Real Time. Corey Lynch (Google) et al. arXiv. [kertas] [kode]

3.3 Society Simulation with LLM-based Agents

- [2024/03] Emergence of Social Norms in Large Language Model-based Agent Societies. Siyue Ren et al. arXiv. [kertas] [kode]

- [2023/08] AgentSims: An Open-Source Sandbox for Large Language Model Evaluation. Jiaju Lin (PTA Studio) et al. arXiv. [paper] [project page] [code]

- [2023/07] S 3 : Social-network Simulation System with Large Language Model-Empowered Agents. Chen Gao (Tsinghua University) et al. arXiv. [kertas]

- [2023/07] Epidemic Modeling with Generative Agents. Ross Williams (Virginia Tech) et al. arXiv. [kertas] [kode]

- [2023/06] RecAgent: A Novel Simulation Paradigm for Recommender Systems. Lei Wang (Renmin University of China) et al. arXiv. [kertas]

- [2023/05] Training Socially Aligned Language Models in Simulated Human Society. Ruibo Liu (Dartmouth College) et al. arXiv. [kertas] [kode]

- [2023/04] Generative Agents: Interactive Simulacra of Human Behavior. Joon Sung Park (Stanford University) et al. arXiv. [kertas] [kode]

- [2022/08] Social Simulacra: Creating Populated Prototypes for Social Computing Systems. Joon Sung Park (Stanford University) et al. UIST. [kertas]

4. Other Topics

4.1 Benchmarks for LLM-based Agents

- [2023/11] "MAgIC: Investigation of Large Language Model Powered Multi-Agent in Cognition, Adaptability, Rationality and Collaboration." Lin Xu et al. (NUS, ByteDance, Stanford & UC Berkeley) arXiv. [paper] [Project Page] [Code]

- The work presents a benchmarking framework for evaluating LLMs in multi-agent settings, showing a 50% average improvement using Probabilistic Graphical Modeling.

- [2023/10] "Benchmarking Large Language Models As AI Research Agents." Qian Huang (Stanford) et al. arXiv. [kertas] [kode]

- [2023/08] "AgentBench: Evaluating LLMs as Agents." Xiao Liu (THU) et al. arXiv. [paper] [code] [project page]

- AGENTBENCH, a benchmark for assessing LLMs as agents, shows a performance gap between top commercial and open-source models.

- [2023/10] "SmartPlay : A Benchmark for LLMs as Intelligent Agents." Yue Wu (CMU & Microsoft) et al. arXiv. [kertas] [kode]

- SmartPlay is a benchmark and methodology for evaluating LLMs as intelligent agents, featuring six diverse games to assess key capabilities, providing a roadmap for identifying gaps in current methodologie

- [2024/04] "OSWorld: Benchmarking Multimodal Agents for Open-Ended Tasks in Real Computer Environments." XLang Lab (The University of Hong Kong) arXiv. [paper] [project page] [code] [data viewer]

- OSWorld is a unified, real computer environment for multimodal agents to benchmark open-ended computer tasks with arbitrary apps and interfaces on Ubuntu, Windows, & macOS.

4.2 Training and Optimizing LLM-based Agents

- [2024/06] AgentGym: Evolving Large Language Model-based Agents across Diverse Environments. Zhiheng Xi (Fudan University) et al. arXiv. [paper] [project page] [codes and platform] [dataset] [benchmark] [model].

- [2023/10] FireAct: Toward Language Agent Fine-tuning. Baian Chen (System2 Research) et al. arXiv. [paper] [project page] [code] [dataset]

- [2023/10] AgentTuning: Enabling Generalized Agent Abilities for LLMs. Aohan Zeng (Tsinghua University) et al. arXiv. [paper] [project page] [code] [dataset]

- [2023/10] Lemur: Harmonizing Natural Language and Code for Language Agents Yiheng Xu (University of Hong Kong) et al. arXiv. [kertas] [kode]

Kutipan

If you find this repository useful, please cite our paper:

@misc{xi2023rise,

title={The Rise and Potential of Large Language Model Based Agents: A Survey},

author={Zhiheng Xi and Wenxiang Chen and Xin Guo and Wei He and Yiwen Ding and Boyang Hong and Ming Zhang and Junzhe Wang and Senjie Jin and Enyu Zhou and Rui Zheng and Xiaoran Fan and Xiao Wang and Limao Xiong and Yuhao Zhou and Weiran Wang and Changhao Jiang and Yicheng Zou and Xiangyang Liu and Zhangyue Yin and Shihan Dou and Rongxiang Weng and Wensen Cheng and Qi Zhang and Wenjuan Qin and Yongyan Zheng and Xipeng Qiu and Xuanjing Huang and Tao Gui},

year={2023},

eprint={2309.07864},

archivePrefix={arXiv},

primaryClass={cs.AI}

}

Project Maintainers & Contributors

- Zhiheng Xi (奚志恒, @WooooDyy)

- Wenxiang Chen (陈文翔, @chenwxOggai)

- Xin Guo (郭昕, @XinGuo2002)

- Wei He(何为, @hewei2001)

- Yiwen Ding (丁怡文, @Yiwen-Ding)

- Boyang Hong(洪博杨, @HongBoYang)

- Ming Zhang (张明, @KongLongGeFDU)

- Junzhe Wang(王浚哲, @zsxmwjz)

- Senjie Jin(金森杰, @Leonnnnnn929)

Kontak

Sejarah Bintang