في الآونة الأخيرة ، جلب الإطلاق الناجح لمشروع VLM-R1 فجرًا جديدًا إلى مجال نماذج اللغة البصرية. هذا المشروع هو الترحيل الناجح لطريقة R1 لفريق Deepseek في نموذج اللغة المرئية ، مما يمثل أن فهم AI للمحتوى المرئي سيدخل مرحلة جديدة تمامًا. إن إطلاق VLM-R1 لا يوضح الاختراقات التكنولوجية فحسب ، بل يفتح أيضًا اتجاهات جديدة للبحث عن الذكاء الاصطناعي متعدد الوسائط.

استلهم VLM-R1 من طريقة R1 التي فتحها فريق Deepseek المصدر العام الماضي. تتبنى هذه الطريقة تقنية التعلم المعززة GRPO (تم إنشاؤها المولد مع معالجة المكافآت) ، وقد حققت نتائج رائعة في مجال معالجة النص العادي. اليوم ، قام فريق VLM-R1 بتطبيق هذه الطريقة بنجاح على نماذج اللغة البصرية ، مما يزيد من توسيع نطاق التطبيق. يوفر هذا الابتكار أفكارًا جديدة للبحث عن الذكاء الاصطناعي متعدد الوسائط ويضع أساسًا متينًا للتنمية التكنولوجية المستقبلية.

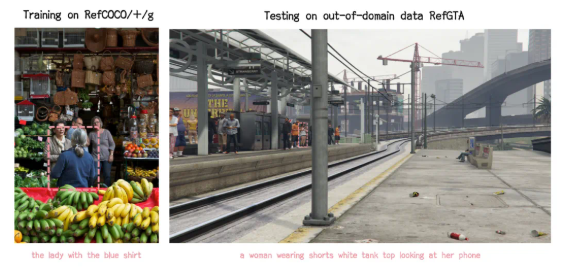

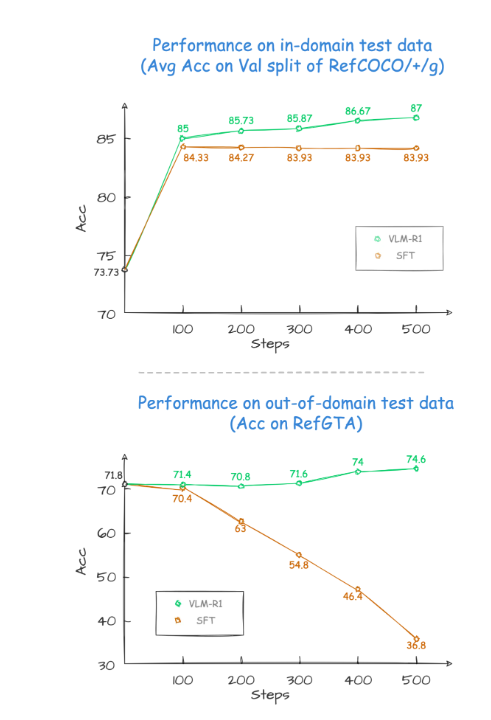

أثناء عملية التحقق من المشروع ، كان أداء VLM-R1 مذهلاً. بادئ ذي بدء ، تُظهر طريقة R1 ثباتًا كبيرًا للغاية في السيناريوهات المعقدة ، وهو أمر مهم بشكل خاص في التطبيقات العملية. ثانياً ، يؤدي النموذج بشكل ممتاز في قدرات التعميم. بالمقارنة ، ينخفض أداء نموذج SFT التقليدي (الضبط الخاضع للإشراف) تدريجياً مع الزيادة في عدد خطوات التدريب في بيانات الاختبار خارج الحقل ، في حين أن نموذج R1 يمكن أن يستمر في التحسن أثناء التدريب. يوضح هذا أن طريقة R1 تسمح للنموذج بإتقان القدرة على فهم المحتوى المرئي بدلاً من الاعتماد فقط على الذاكرة.

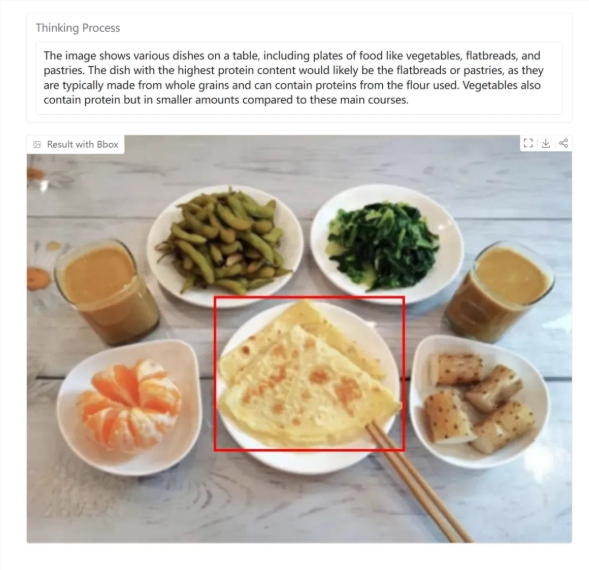

بالإضافة إلى ذلك ، من الصعب للغاية البدء في مشروع VLM-R1 ، ويوفر الفريق للمطورين عملية تدريب وتقييم كاملة ، بحيث يمكن للمطورين البدء بسرعة. في حالة عملية ، طُلب من النموذج العثور على الطعام الذي يحتوي على أعلى محتوى للبروتين في صورة طعام شهية. لم تكن النتيجة فقط الإجابة كانت دقيقة ، ولكن تم اختيار كعكة البيض أيضًا مع أعلى محتوى للبروتين في الصندوق بدقة. توضح هذه الحالة تمامًا الأداء المتميز لـ VLM-R1 في القدرات البصرية وقدرات التفكير.

لا يثبت الإطلاق الناجح لـ VLM-R1 تعدد استخدامات طريقة R1 فحسب ، بل يوفر أيضًا أفكارًا جديدة لتدريب النماذج متعددة الوسائط ، مما يشير إلى وصول اتجاه جديد للتدريب على نموذج اللغة البصرية. الأمر الأكثر إثارة هو أن المشروع مفتوح المصدر تمامًا ويمكن للمطورين المهتمين العثور على المعلومات ذات الصلة عن GitHub. سيؤدي هذا المقياس مفتوح المصدر إلى جذب المزيد من المطورين للمشاركة والترويج بشكل مشترك مع تقدم تقنية الذكاء الاصطناعى متعدد الوسائط.

باختصار ، حقن ظهور VLM-R1 حيوية جديدة في البحث عن نماذج اللغة البصرية. إنه لا يوضح الاختراقات التكنولوجية فحسب ، بل يوفر أيضًا اتجاهات جديدة للبحث في المستقبل. نتطلع إلى المزيد من المطورين المشاركين فيه ، والترويج للتقدم المستمر في تقنية الذكاء الاصطناعى المتعدد الوسائط ، وجلب المزيد من الابتكارات والاختراق إلى مجال الذكاء الاصطناعي.