نموذج | لوحة المتصدرين | المنهجية | التقييم | تحليل المتانة | تقييد | الاقتباس | Outlook |

Ethan Chern*، Haoyang Zou*، Xuefeng Li*، Jiewen Hu*، Kehua Feng ، Junlong Li ، Pengfei Liu+

[2023/12/12] أصدرنا ABEL-7B-002 ، مما أدى إلى أقوى (تحسن 35 ٪ على GSM8K ، تحسن 126 ٪ على الرياضيات) وأكثر تعميمًا ، تحقيق أفضل أداء بين جميع طرز 7B (80.44 على GSM8K ، 29.46 ON MATH)

| اسم النموذج | نقاط التفتيش HF | GSM8K | الرياضيات | رخصة |

|---|---|---|---|---|

| ABEL-7B-002 | ؟ 7 ب | 80.44 | 29.46 | ترخيص Apache 2.0 |

| ABEL-7B-001 | ؟ 7 ب | 59.74 | 13.00 | لاما 2 |

| ABEL-13B-001 | ؟ 13 ب | 66.41 | 17.34 | لاما 2 |

| ABEL-70B-001 | ؟ 70 ب | 83.62 | 28.26 | لاما 2 |

| نموذج | GSM8K | الرياضيات | Mathqa | سفامب | SCQ5K-en | قوس | arc-c | Hellaswag | mmlu |

|---|---|---|---|---|---|---|---|---|---|

| ABEL-7B-002 | 80.44 | 29.46 | 69.78 | 77.67 | 55.95 | 77.67 | 55.05 | 77.72 | 61.19 |

| ABEL-7B-001 | 59.74 | 13 | 1.21 | 57.67 | 9.3 | 53.32 | 38.97 | 63.51 | 40.59 |

| Metamath-Mistral-7b | 77.7 | 28.2 | 33.94 | 79.33 | 37.6 | 78.48 | 51.93 | 76.44 | 61.93 |

| Qwen-7b | 47.84 | 9.34 | 27.44 | 53 | 40.05 | 74.97 | 53.05 | 86.85 | 57.98 |

| MISTRAL-7B | 37.83 | 9.06 | 25.73 | 63 | 39.6 | 76.83 | 53.22 | 76.31 | 64.05 |

| yi-6b | 32.6 | 5.78 | 26.98 | 55.67 | 35.5 | 73.66 | 49.53 | 68.97 | 64.02 |

| لاما 2-7 ب | 12.96 | 2.78 | 11.52 | 44 | 28.24 | 71.12 | 46.61 | 71.32 | 46.7 |

يمكن العثور على ما يلي:

تفاصيل التقييم:

تم إنشاء Abel كإشادة بـ Niels Henrik Abel لعمله الرائد في الجبر والتحليل ، حيث يكون نموذجنا أفضل نسبيًا أيضًا. لا يزال هناك طريق طويل بالنسبة لنا للذهاب ، على الرغم من؟ ؟ ♀ ؟؟ ؟ ♀.

نظهر ذلك:

لقد أنشأنا أداءً جديدًا جديدًا عبر LLMs مفتوحة المصدر (لا تستخدم أدوات خارجية) على معايير GSM8K ( 83.62 ) والرياضيات ( 28.26 ). خاصة:

GAIRMath-Abel 3 مناصب في المراكز العشرة الأولى ويقف باعتباره المشروع الوحيد الذي تقوده الجامعة في القائمة (أخرى هي إما الشركات الناشئة أو شركات التكنولوجيا الكبيرة).نوضح ذلك:

? يمثل نموذج مفتوح المصدر? يقترح أن التطوير النموذجي يقوده الجامعة الأكاديمية (بدلاً من الشركات)| تصنيف | نموذج | بارام. | منظمة رائدة | GSM8K | الرياضيات |

|---|---|---|---|---|---|

| 1 | GPT-4 | مجهول | Openai | 92.0 | 42.5 |

| 2 | كلود -2 | مجهول | الإنسان | 88.0 | - |

| 3 | نخيل 2-فلان | مجهول | جوجل | 84.7 | 33.2 |

| ؟ 4 | Gairmath- أبيل | 70 ب | ؟ مختبر جير في جامعة شنغهاي جياوتونج | 83.6 | 28.3 |

| ؟ 5 | WizardMath | 70 ب | Microsoft | 81.6 | 22.7 |

| 6 | كلود مثبتة | مجهول | الإنسان | 80.9 | - |

| 7 | chatgpt | مجهول | Openai | 80.8 | 34.1 |

| ؟ 4 | Abel -002 | 7 ب | ؟ مختبر جير في جامعة شنغهاي جياوتونج | 80.4 | 29.5 |

| 8 | chatgpt-0301 | مجهول | Openai | 74.9 | - |

| ؟ 9 | Gairmath- أبيل | 13 ب | ؟ مختبر جير في جامعة شنغهاي جياوتونج | 66.4 | 17.3 |

| ؟ 10 | Gairmath- أبيل | 7 ب | ؟ مختبر جير في جامعة شنغهاي جياوتونج | 59.7 | 13.0 |

| 11 | مينيرفا | 540B | جوجل | 58.8 | 33.6 |

| 12 | نخل | 540B | جوجل | 56.9 | 8.8 |

| ؟ 13 | لاما 2 | 70 ب | ميتا | 56.8 | 13.5 |

| ؟ 14 | RFT | 33 ب | OFA | 56.5 | 7.4 |

| ؟ 15 | Baichuan2-13b | 13 ب | بايتشوان | 52.8 | 10.1 |

| 16 | مينيرفا | 62 ب | جوجل | 52.4 | 27.6 |

| 17 | نخل | 64 ب | جوجل | 52.4 | 4.4 |

| ؟ 18 | RFT | 13 ب | OFA | 52.1 | 5.1 |

| ؟ 19 | لاما | 65 ب | ميتا | 50.9 | 10.6 |

| ؟ 20 | Qwen | 7 ب | علي بابا | 44.9 | 8.5 |

| 21 | شينشيلا | 70 ب | DeepMind | 43.7 | - |

| ؟ 22 | لاما 2 | 34 ب | ميتا | 42.2 | 6.24 |

| 23 | جالاكتيكا | 30 ب | ميتا | 41.7 | 12.7 |

| ؟ 24 | ChatGlm2 | 12 ب | zhipu | 40.9 | - |

| 25 | نص davinci-002 | 175 ب | Openai | 40.7 | 19.1 |

| ؟ 26 | لاما | 33 ب | ميتا | 35.6 | 7.1 |

| 27 | GPT-3 | 175 ب | Openai | 34 | 5.2 |

| ؟ 28 | Internlm | 7 ب | مختبر شنغهاي منظمة العفو الدولية | 31.2 | - |

| ؟ 29 | لاما 2 | 13 ب | ميتا | 28.7 | 3.9 |

| ؟ 30 | Vicuna v1.3 | 13 ب | lmsys | 27.6 | - |

| ؟ 31 | فالكون | 40 ب | معهد الابتكار التكنولوجي | 19.6 | 2.5 |

| ؟ 32 | لاما | 13 ب | ميتا | 17.8 | 3.9 |

| ؟ 33 | MPT | 30 ب | Mosaicml | 15.2 | 3.1 |

| 34 | جالاكتيكا | 6.7b | ميتا | 10.2 | 2.2 |

نقترح الإشراف الوالدي ، استراتيجية مجالسة الأطفال للضبط الخاضع للإشراف ،

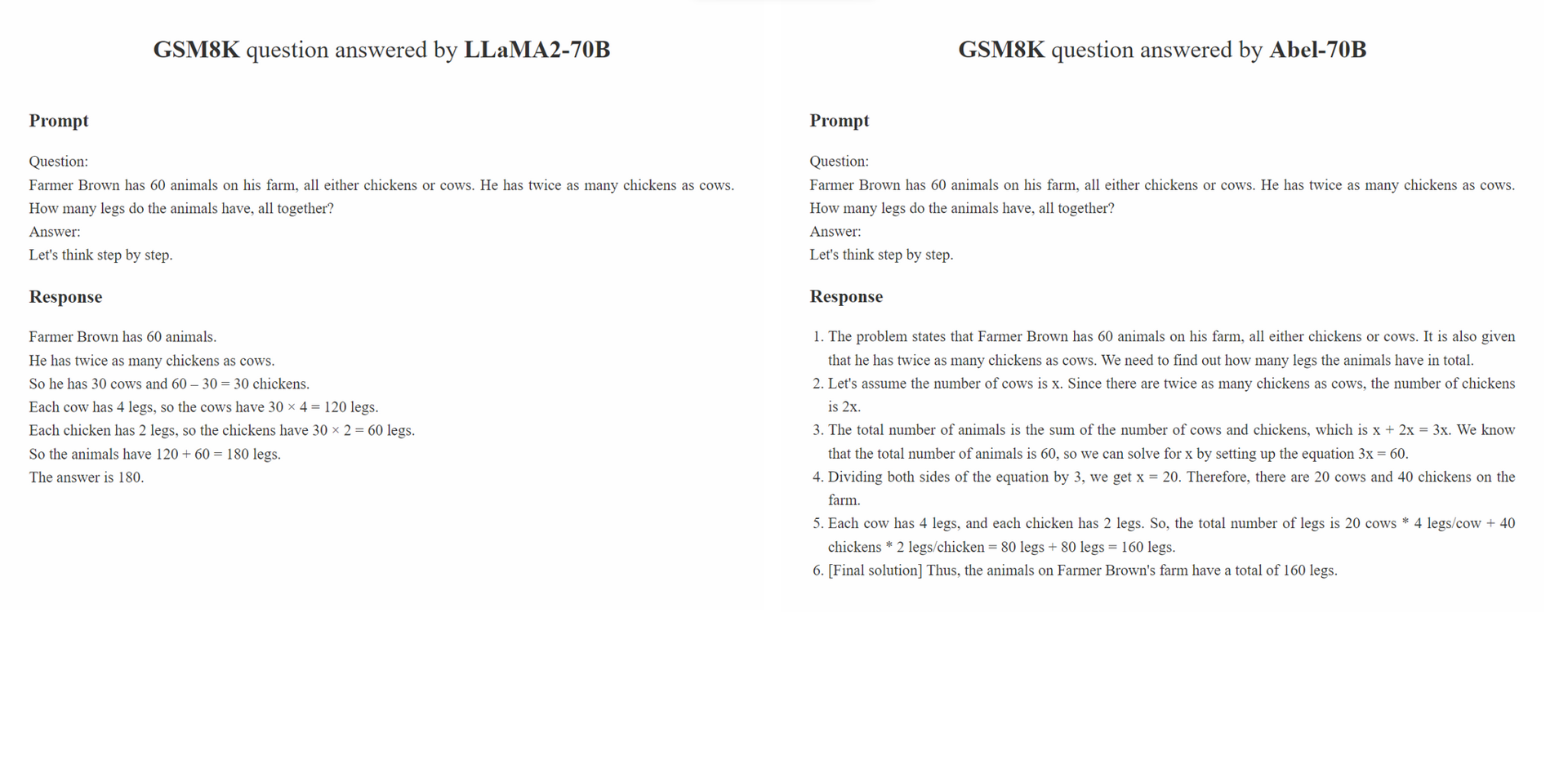

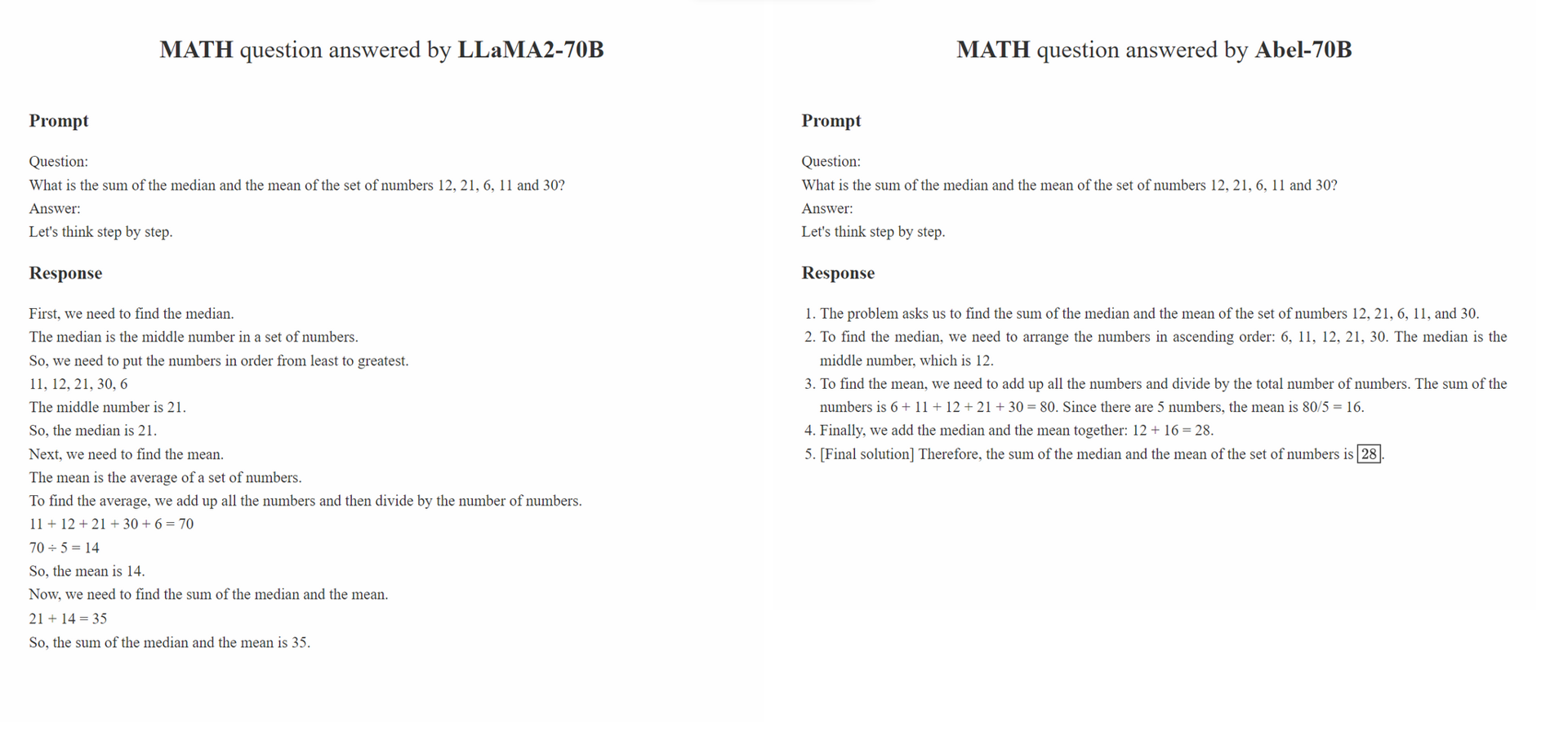

لا تقتصر Parental Oversight على أي طريقة محددة لمعالجة البيانات. بدلاً من ذلك ، فإنه يحدد فلسفة معالجة البيانات التي يجب أن توجه الضبط الخاضع للإشراف في عصر الذكاء الاصطناعي (GAI). نعتقد أنه في عصر GAI ، ظهرت هندسة بنية البيانات كنموذج جديد. ضمن هذا النموذج ، تؤثر الطريقة التي تتم بها معالجة بيانات الضبط بشكل كبير على أداء GAI المدربة. نتوقع أن يركز عدد متزايد من الدراسات في المجتمع على فلسفة معالجة البيانات هذه.

يؤكد مبدأ Parental Oversight معاملة الضبط الخاضع للإشراف بعناية وحذر. هذا مماثل للطريقة التي يتم بها تشجيع الآباء على تثقيف أطفالهم. يمكن تشبيه أنواع مختلفة من البيانات ، جنبًا إلى جنب مع تنسيقات العرض التقديمي (على سبيل المثال ، المنطق خطوة بخطوة ، وصقل تكراري) ، على أساليب تعليمية متنوعة. مثلما يختار الآباء بحذر النهج الأكثر فاعلية لتوجيه أطفالهم ، يجب على ممارسي GAI اختيار أساليب معالجة البيانات الأكثر فعالية لتوجيه LLMs الخاصة بهم بشكل أفضل.

علاوة على ذلك ، فإن الفلسفة "الأكثر بيانات ، كلما كانت" أفضل "لا تصدق دائمًا. جودة وأهمية العينات المشروحة يمكن أن تفوق في كثير من الأحيان كمية. لا ينبغي أن تقدم عينات التدريب المستخدمة في SFT الإجابة الصحيحة فقط ، ولكن أيضًا توجيه النموذج حول كيفية اشتقاق الإجابة الصحيحة بناءً على معرفة LLM. بالإضافة إلى ذلك ، إذا لم تكن معرفة LLM كافية للإجابة على سؤال ، فيجب أن تتدخل Parental Oversight لمعالجة فجوات المعرفة على الفور.

conda create -n abel python=3.10conda activate abelpip install -r requirements.txt .bash evaluation/eval.sh يتم تعديل جزء من البرنامج النصي للتقييم من Minerva../outputs . يتكون تحليلنا المتانة من جزأين: تقييم الخصومة على مجموعة بيانات GSM8K_ROBUST ويشرفون على التعلم النقل على مجموعة بيانات TAL-SCQ5K-EN . نقوم بإجراء تحليل أولي لفهم (1) ما إذا كان ABEL يفرط في مجموعة بيانات التدريب ، وبالتالي فهو هائل إلى عينات اختبار التوزيع خارج التوزيع و (2) ما إذا كان نهج SFT لدينا يمكن أن ينقل بسرعة إلى مجموعات البيانات من توزيعات مختلفة.

مجموعة بيانات GSM8K_Robust هي مجموعة بيانات أنشأناها بناءً على مجموعة بيانات GSM8K. قمنا بتعديل الأرقام بشكل عشوائي ضمن أسئلة مجموعة بيانات GSM8K ، دون تغيير أي معلومات أخرى في الأسئلة ، باستخدام GPT-4. طلبنا أيضًا GPT-4 إنشاء "الإجابات الذهبية" للأسئلة المعدلة. بعد مراجعة مجموعة فرعية من هذه العينات يدويًا ، وجدنا أن جميع الإجابات التي تم إنشاؤها للأسئلة التي تم تغييرها كانت دقيقة. لقد استخدمنا مجموعة بيانات GSM8K_Robust لتقييم ما إذا كانت النماذج تتغلب على بيانات التدريب ، مما يجعل النماذج عرضة لعينات اختبار التوزيع. يشير تحليلنا إلى أن ABEL أكثر قوة لعينات اختبار التوزيع خارج النماذج الأخرى.

| نموذج | GSM8K | GSM8K_ROBUST | دلتا |

|---|---|---|---|

| Abel-7b | 59.74 | 58.23 | -1.51 |

| ABEL-13B | 66.41 | 66.57 | +0.16 |

| Abel-70b | 83.62 | 81.80 | -1.82 |

| WizardMath-70b | 81.60 | 74.91 | -6.70 |

| WizardMath-13B | 63.90 | 59.51 | -4.39 |

| RFT-7B | 41.7 | 37.98 | -3.72 |

نوضح أن ABEL-70B لا يحقق SOTA فقط على مجموعات بيانات GSM8K و MATH ، ولكن أيضًا يعتمد بشكل جيد على TAL-SCQ5K-EN 2K ، وهي مجموعة بيانات تم إصدارها حديثًا من قبل Math LLM Provider TAL (好未來). يشير تحليلنا إلى أن نهج SFT الخاص بنا يمكنه تعميم Abel بنجاح إلى مجموعات البيانات من توزيعات مختلفة. سنقوم بإجراء مزيد من التحليلات والتجارب لاستكشاف إمكانيات تعميم Abel وتحسينها.

| نموذج | اختبار اختبار TAL-SCQ5K-EN 2K |

|---|---|

| Abel-70b | 59.7 |

| Mathgpt | 59.0 |

| GPT-4 | 51.0 |

| لاما 70 ب | 43.8 |

لقد أنشأنا قائمة من القضايا للحفاظ على هذه القيود والحلول المحتملة. آرائك وتعليقاتك هي دائما موضع ترحيب.

يرجى الاستشهاد بالريزو إذا كان النموذج/الرمز/الاستنتاج في هذا الريبو مفيدًا لك.

@misc{abel,

author = {Chern, Ethan and Zou, Haoyang and Li, Xuefeng and Hu, Jiewen and Feng, Kehua and Li, Junlong and Liu, Pengfei},

title = {Generative AI for Math: Abel},

year = {2023},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {url{https://github.com/GAIR-NLP/abel}},

}

نحن نؤكد باستمرار نماذجنا وسنطلق التحديثات. ابقوا متابعين!