multi task cs lm

1.0.0

使用語法意識多任務學習(語言代碼轉換中的計算方法中的第三個研討會,ACL 2018)的論文實施代碼轉換語言建模。該代碼使用Pytorch用Python編寫。

可以在此處找到補充材料(包括火車,開發和測試的分佈)。

如果您使用此工具包中包含的任何源代碼或數據集,請引用以下論文。 Bibtex在下面列出:

@inproceedings {W18-3207,

作者=“ Winata,Genta Indra

和Madotto,Andrea

和吳,奇恩

和芬格,帕斯卡爾”,

title =使用語法意識多任務學習的“代碼轉換語言建模”,

BookTitle =“關於語言代碼轉換計算方法的第三次研討會論文集”,

年=“ 2018”,

發布者=“計算語言學協會”,

頁=“ 62---67”,

位置=“澳大利亞墨爾本”,

url =“ http://aclweb.org/anthology/w18-3207”

}

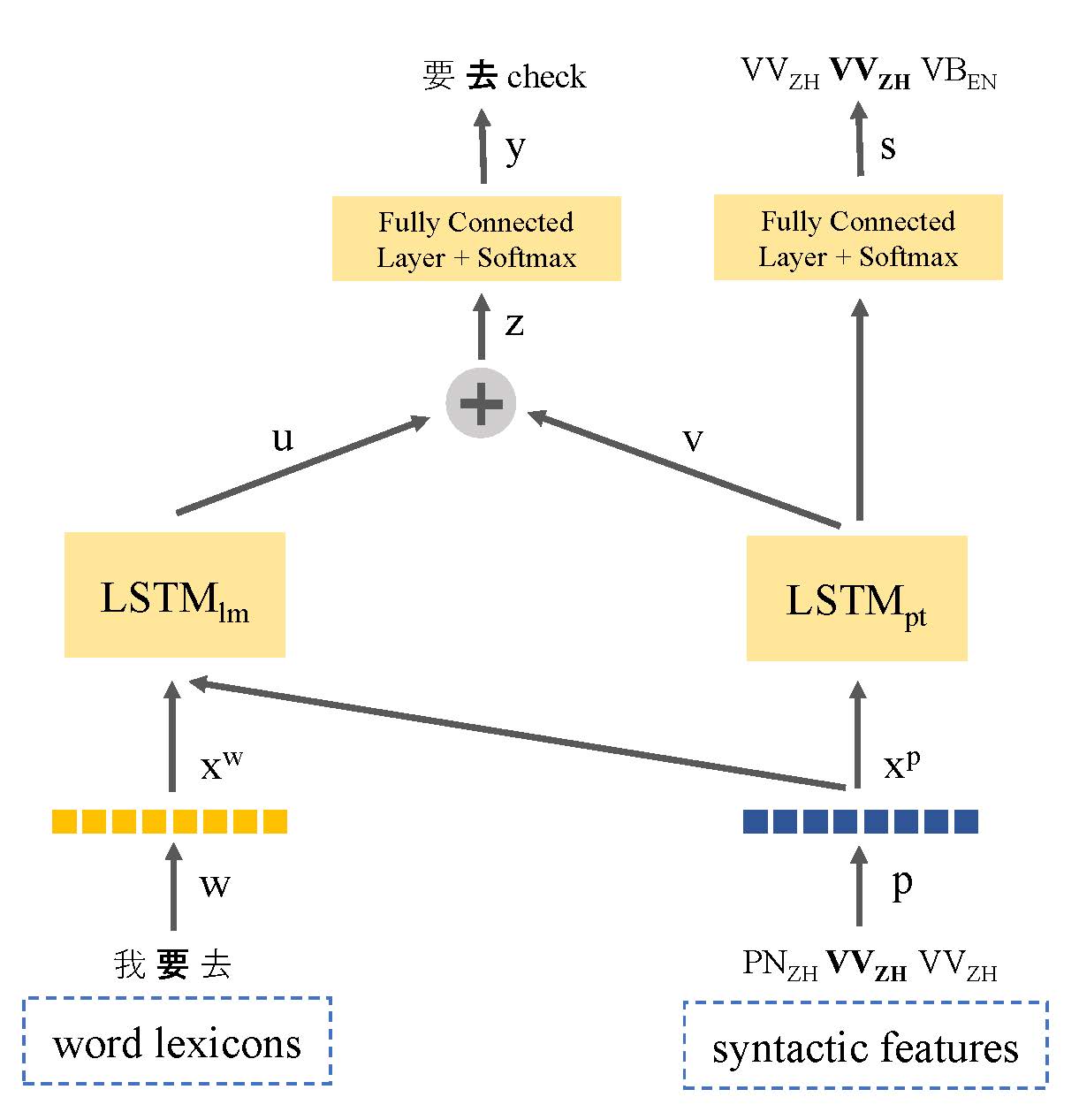

缺乏文本數據一直是代碼轉換語言建模的主要問題。在本文中,我們介紹了基於多任務學習的語言模型,該模型共享語言的語法表示,以利用語言信息並解決低資源數據問題。我們的模型共同學習了語言建模和言論的一部分標記,這是在代碼切換的話語上。通過這種方式,該模型能夠識別代碼轉換點的位置,並改善下一個單詞的預測。我們的方法表現優於基於標準LSTM的語言模型,在接縫I期和II期數據集上的困惑分別提高了9.7%和7.4%。

LDC的Seame語料庫:東南亞的普通話 - 英語密碼開關

多任務

❱❱❱ python main_multi_task.py --tied --clip=0.25 --dropout=0.4 --postagdropout=0.4 --p=0.25 --nhid=500 --postagnhid=500 --emsize=500 --postagemsize=500 --cuda --data=../data/seame_phase2