圖像來源:MK Pavan Kumar

圖像來源:松果

該項目利用開源模型使用檢索增強發電技術為NEPSE尼泊爾證券交易所有限公司構建聊天機器人。 NEPSE小冊子PDF用於提問。該項目利用以下開源模型:

Intel/neural-Chat-7b-v3-1:使用Intel開發並由TheBloke量化的開源LLM。具體而言,由於內存有限,使用了8位GPTQ量化版本。

All-Mpnet-base-V2:一個稱為All-Mpnet-Base-V2的開源句子變壓器用於生成高質量的嵌入。

AAI/bge reranker-large:一種稱為bge-reranker-large的開放源代碼重新播放型號用於從矢量商店重新將已檢索的文檔列入。

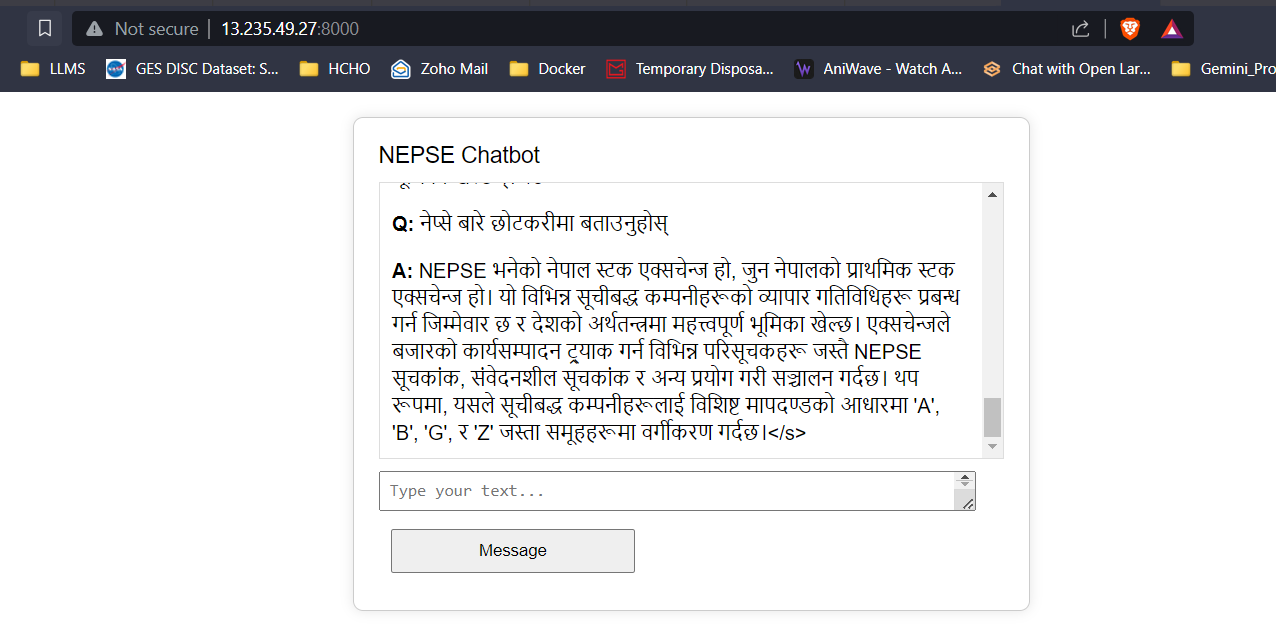

Google Translate API:免費的Google Translate API用於執行尼泊爾和英語內容之間的翻譯。

NEPSE手冊中的文本數據被清洗,分為塊,並使用句子變壓器開發嵌入,這些句子被添加到FAISS矢量數據庫中。當用戶輸入一個問題時,會開發輸入中的嵌入,並使用嵌入的問題來執行矢量搜索以檢索頂級K文檔。 TOP-K檢索的文檔已轉移到重新計算模型,以提高檢索的質量和相關性。最後,最高的K級文檔作為上下文將其傳遞給LLM,並通過適當的及時工程為用戶提供答案。

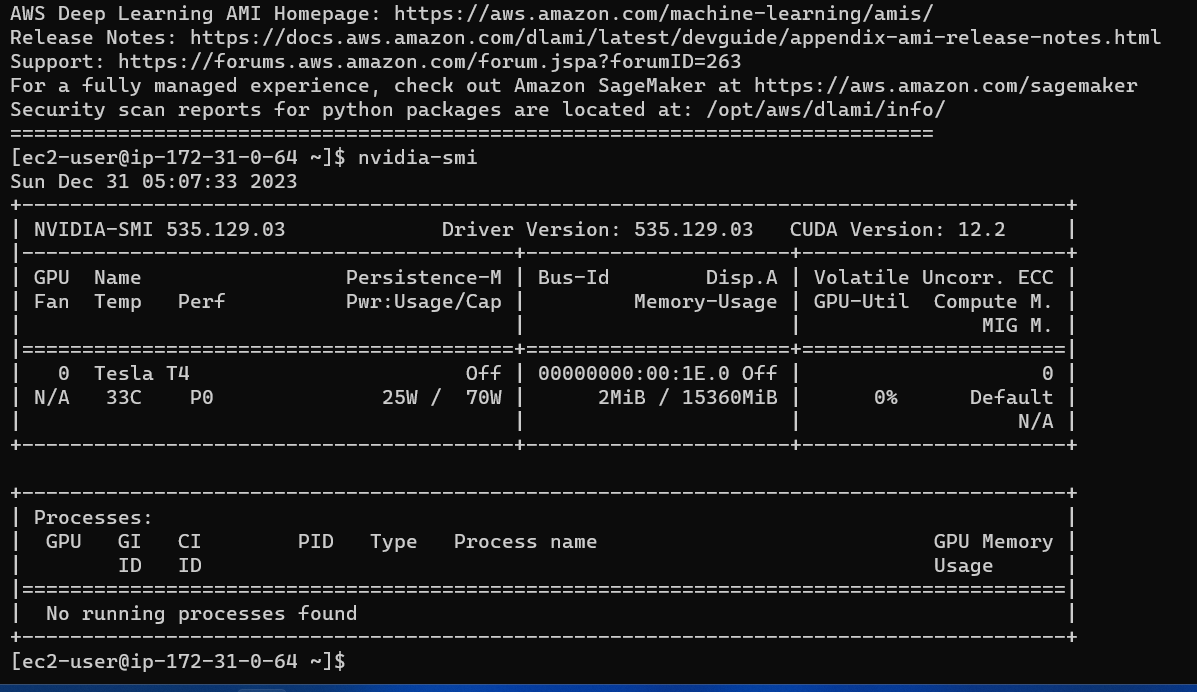

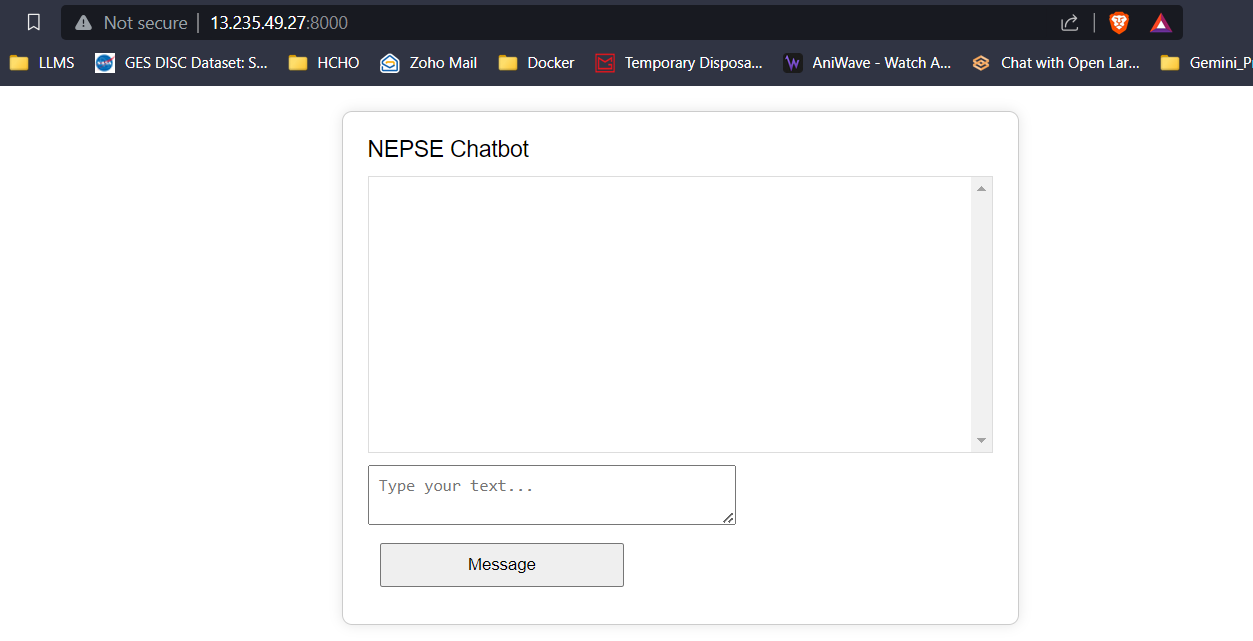

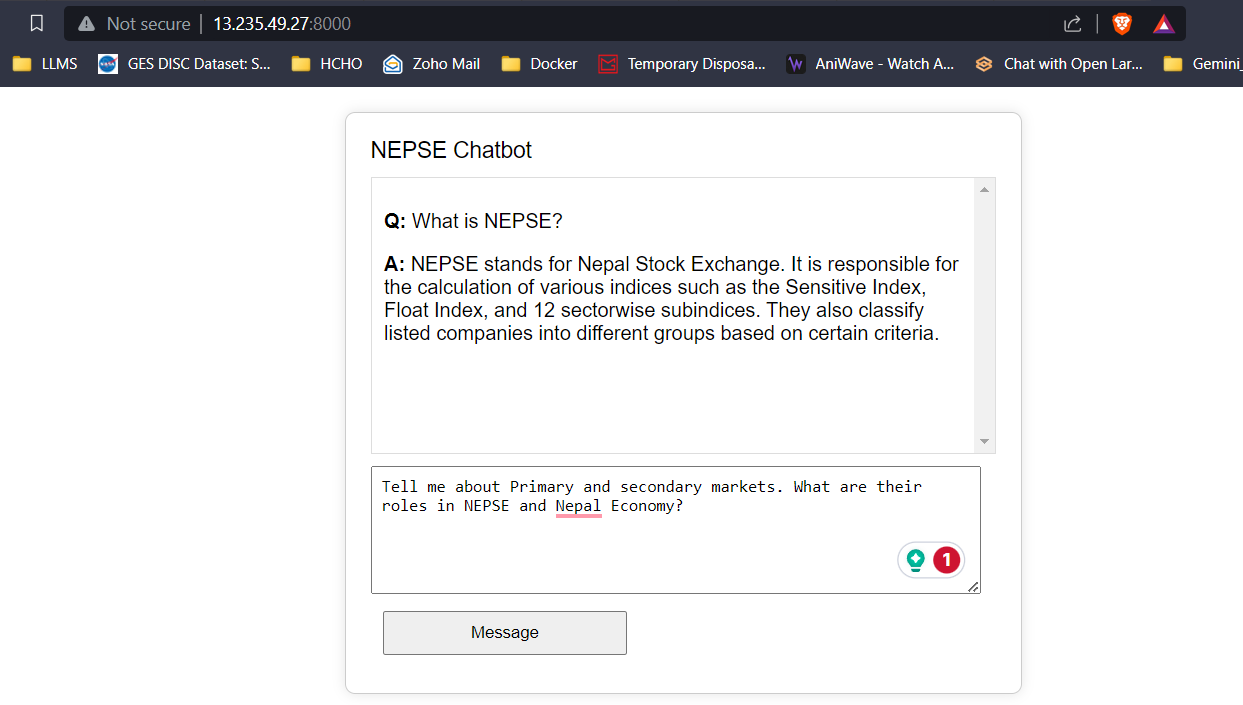

已經開發了使用HTML,CSS和JavaScript以及使用燒瓶的後端的簡單前端。 LLM的響應/預測令牌可實時流到前端,以減少用戶延遲並增強用戶體驗。該應用程序已部署在G4DN.xlarge AWS EC2實例上,以實時推理。

有了16 GB的VRAM,所有三個型號都將很容易擬合而沒有任何問題。下面的屏幕截圖和剪輯展示了部署在AWS上的NEPSE聊天機器人的實時提問功能。

LLM響應流媒體(如chatgpt)

單擊下面的鏈接觀看/下載完整視頻。

觀看視頻