图像来源:MK Pavan Kumar

图像来源:松果

该项目利用开源模型使用检索增强发电技术为NEPSE尼泊尔证券交易所有限公司构建聊天机器人。 NEPSE小册子PDF用于提问。该项目利用以下开源模型:

Intel/neural-Chat-7b-v3-1:使用Intel开发并由TheBloke量化的开源LLM。具体而言,由于内存有限,使用了8位GPTQ量化版本。

All-Mpnet-base-V2:一个称为All-Mpnet-Base-V2的开源句子变压器用于生成高质量的嵌入。

AAI/bge reranker-large:一种称为bge-reranker-large的开放源代码重新播放型号用于从矢量商店重新将已检索的文档列入。

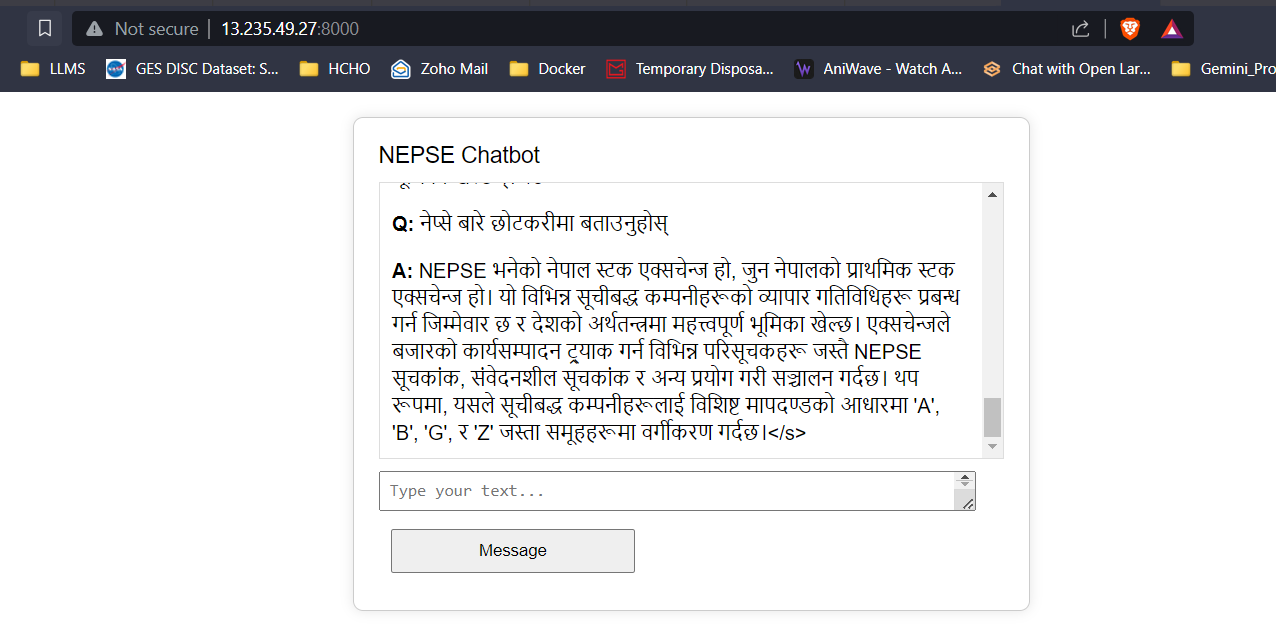

Google Translate API:免费的Google Translate API用于执行尼泊尔和英语内容之间的翻译。

NEPSE手册中的文本数据被清洗,分为块,并使用句子变压器开发嵌入,这些句子被添加到FAISS矢量数据库中。当用户输入一个问题时,会开发输入中的嵌入,并使用嵌入的问题来执行矢量搜索以检索顶级K文档。 TOP-K检索的文档已转移到重新计算模型,以提高检索的质量和相关性。最后,最高的K级文档作为上下文将其传递给LLM,并通过适当的及时工程为用户提供答案。

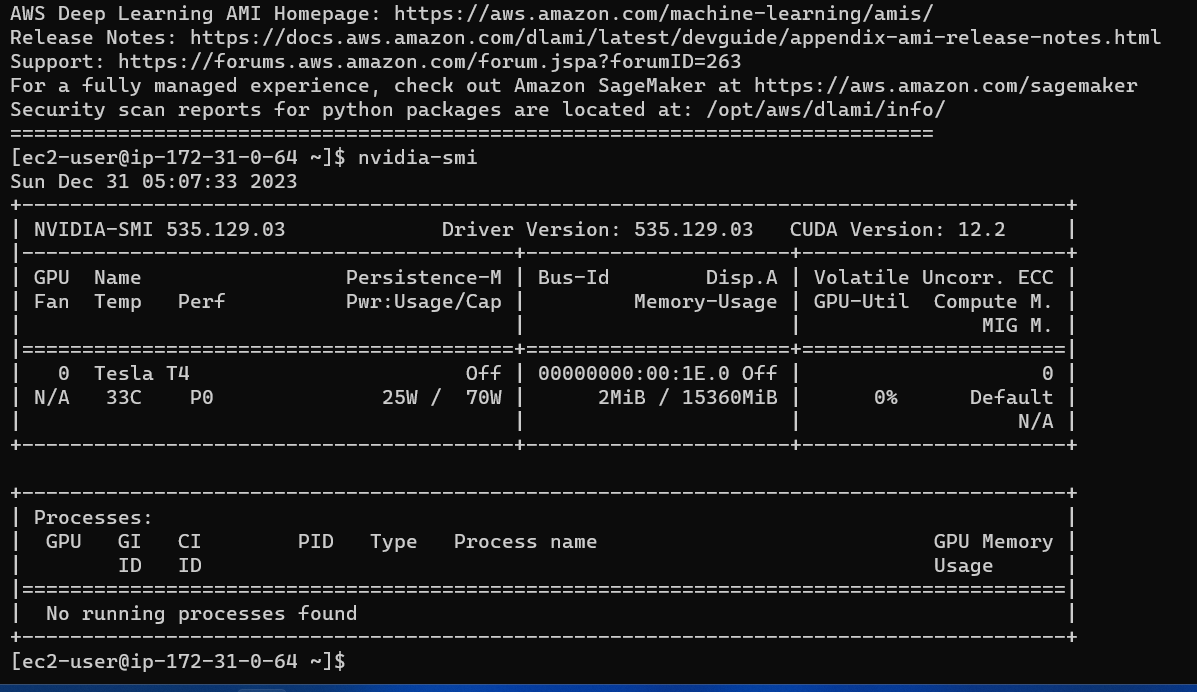

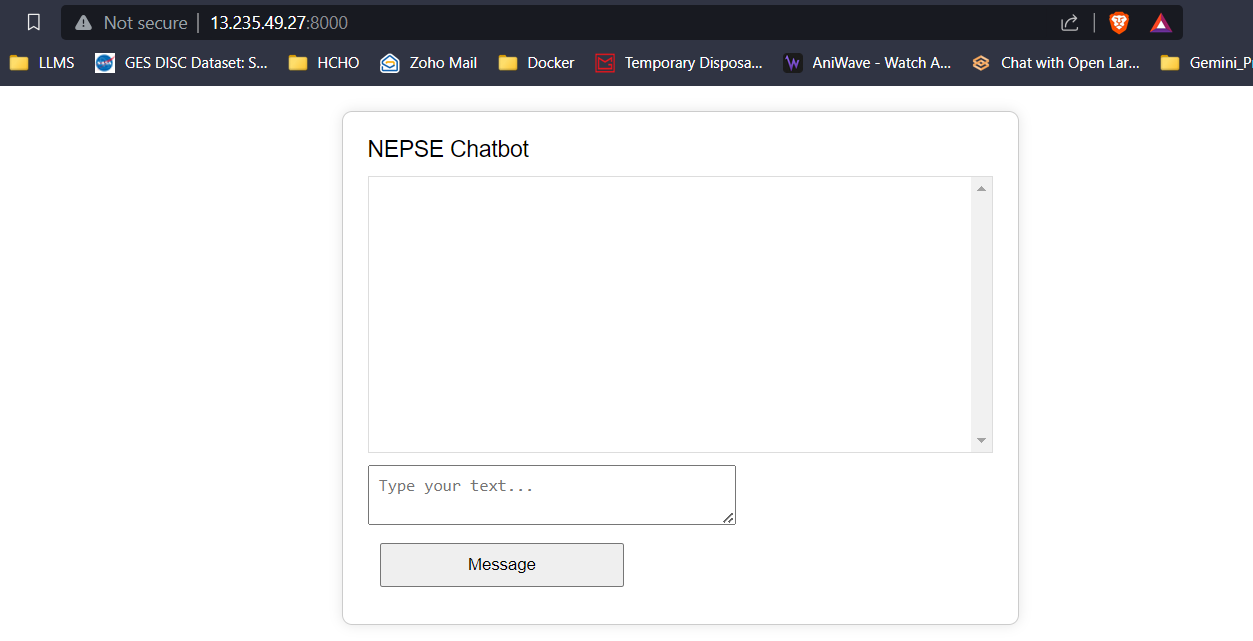

已经开发了使用HTML,CSS和JavaScript以及使用烧瓶的后端的简单前端。 LLM的响应/预测令牌可实时流到前端,以减少用户延迟并增强用户体验。该应用程序已部署在G4DN.xlarge AWS EC2实例上,以实时推理。

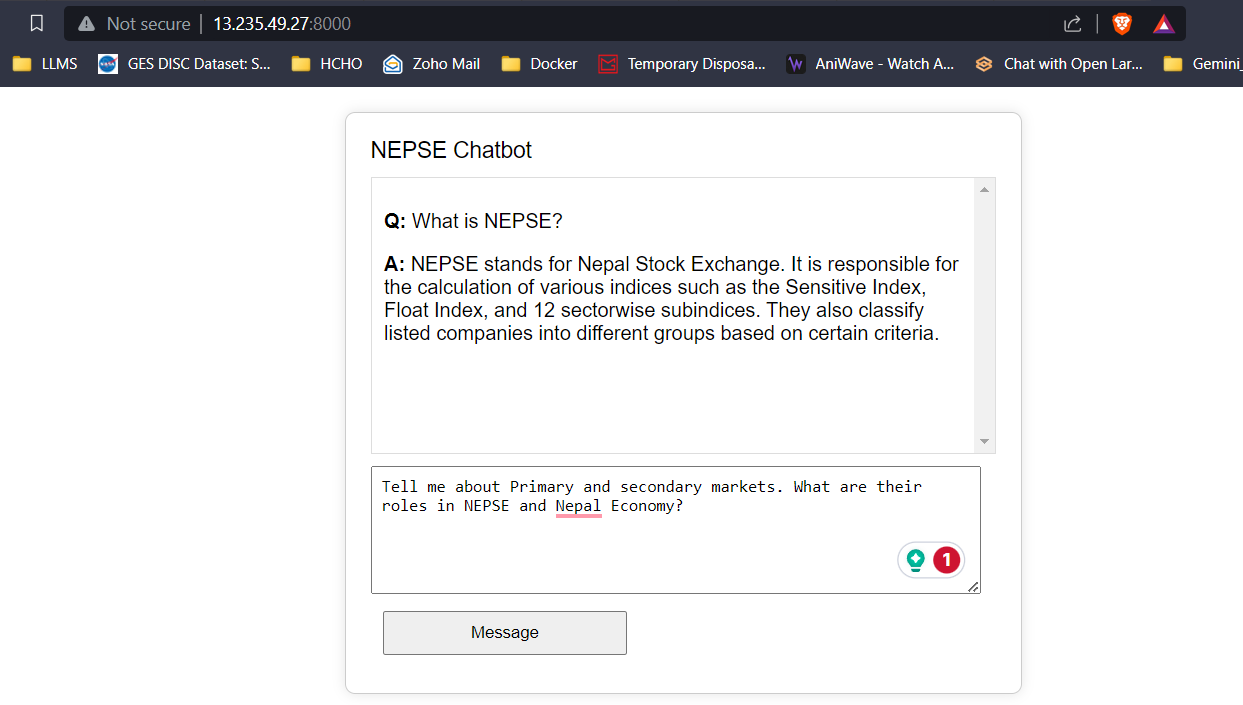

有了16 GB的VRAM,所有三个型号都将很容易拟合而没有任何问题。下面的屏幕截图和剪辑展示了部署在AWS上的NEPSE聊天机器人的实时提问功能。

LLM响应流媒体(如chatgpt)

单击下面的链接观看/下载完整视频。

观看视频