画像ソース:MK Pavan Kumar

画像ソース:Pinecone

このプロジェクトは、オープンソースモデルを活用して、検索拡張生成技術を使用して、ネパール証券取引所LtdのNEPSEのチャットボットを構築します。 Nepse Booklet PDFは、質問を回答するために利用されています。このプロジェクトは、次のオープンソースモデルを利用しています。

Intel/Neural-Chat-7B-V3-1:もともとIntelによって開発され、ブロークによって量子化されたオープンソースLLMが使用されます。具体的には、メモリが制限されているため、8ビットGPTQ量子化バージョンが採用されています。

All-MPNet-Base-V2: All-MPNet-Base-V2と呼ばれるハグの顔からのオープンソース文の変圧器は、高品質の埋め込みを生成するために使用されます。

AAI/BGE-RERANKER-LARGE: BGE-Reranker-Largeと呼ばれる顔の抱きしめられた顔からのオープンソースの再ランキングモデルは、Vectorストアから検索されたドキュメントを再ランクするために使用されます。

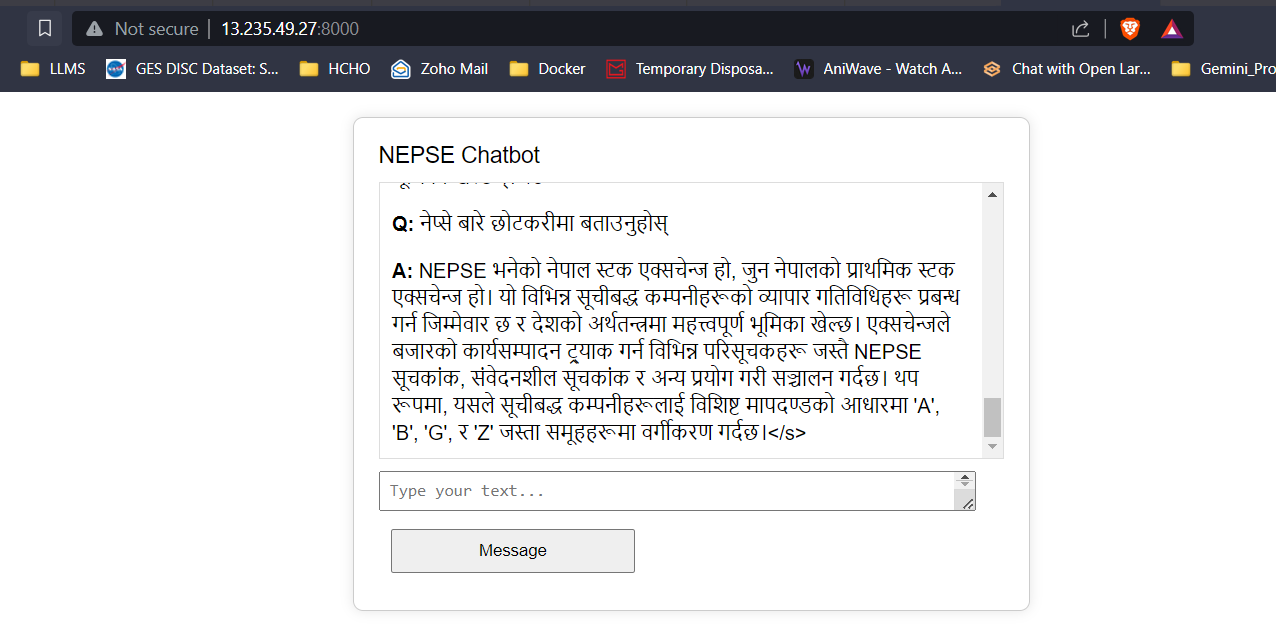

Google Translate API:無料のGoogle Translate APIは、ネパールと英語のコンテンツ間の翻訳を実行するために使用されます。

Nepseの小冊子からのテキストデータはクリーニングされ、チャンクに分割され、埋め込みはFAISSベクターデータベースに追加された文を使用して開発されます。ユーザーが質問を入力すると、入力からの埋め込みが開発され、埋め込みはベクトル検索を実行して上部Kドキュメントを取得するために使用されます。 TOP-K取得ドキュメントは、再ランキングモデルに渡され、検索の品質と関連性を高めます。最後に、ユーザーに回答を提供するための適切な迅速なエンジニアリングを使用して、LLMのコンテキストとして渡されます。

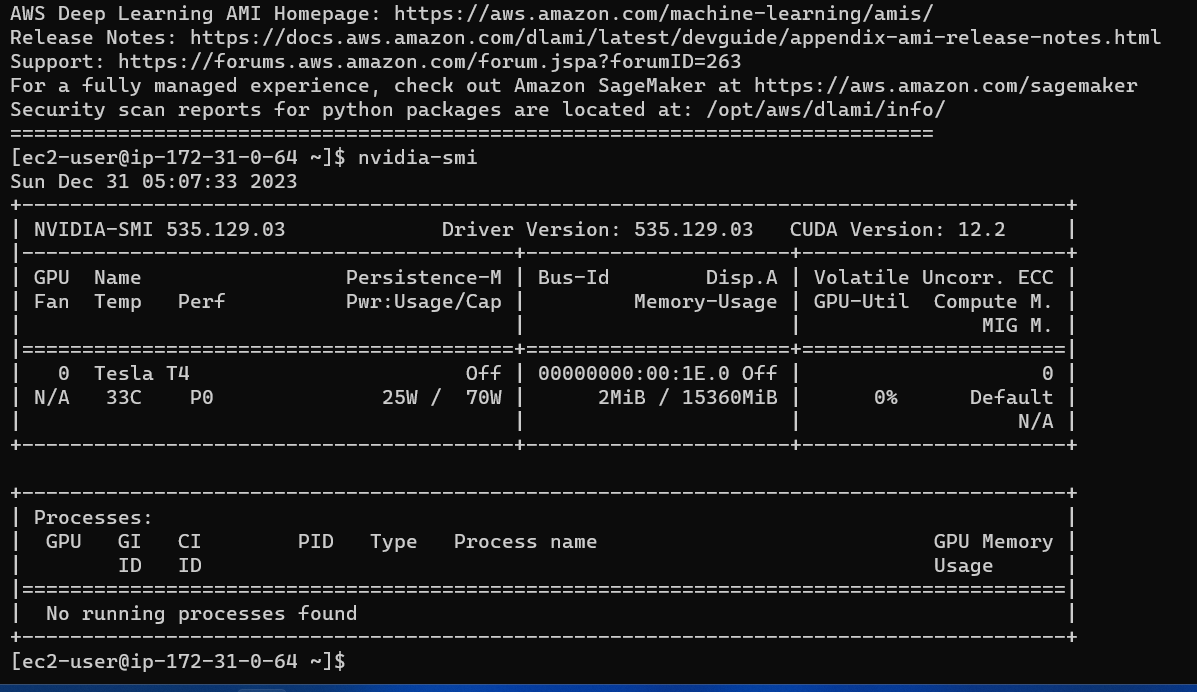

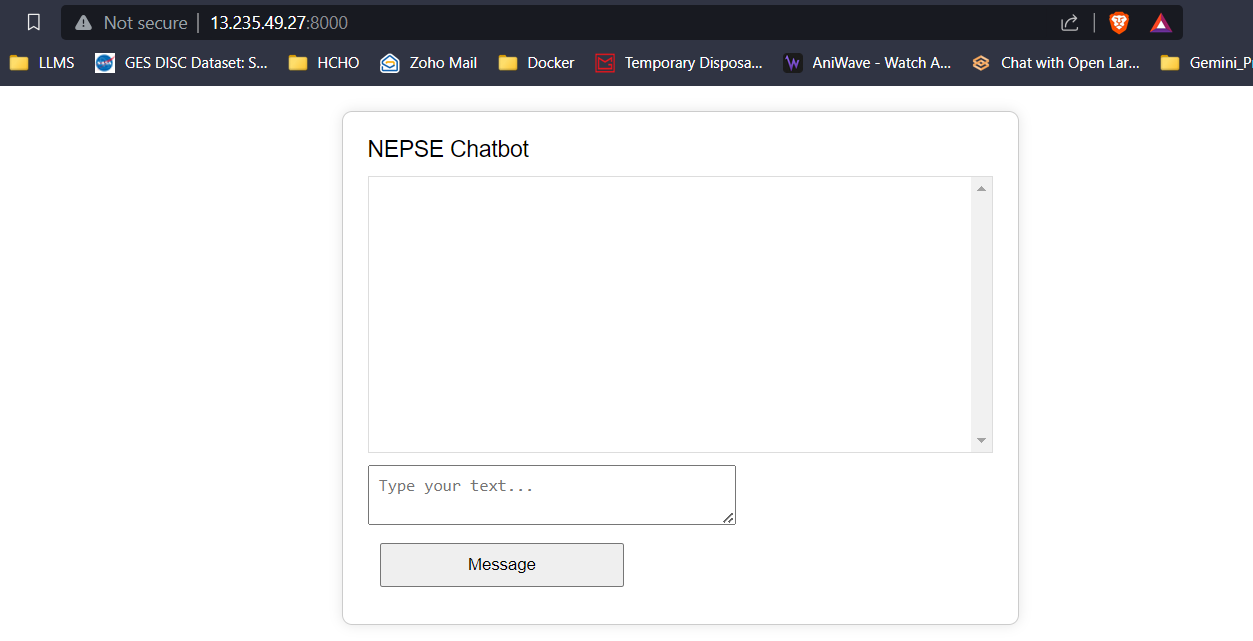

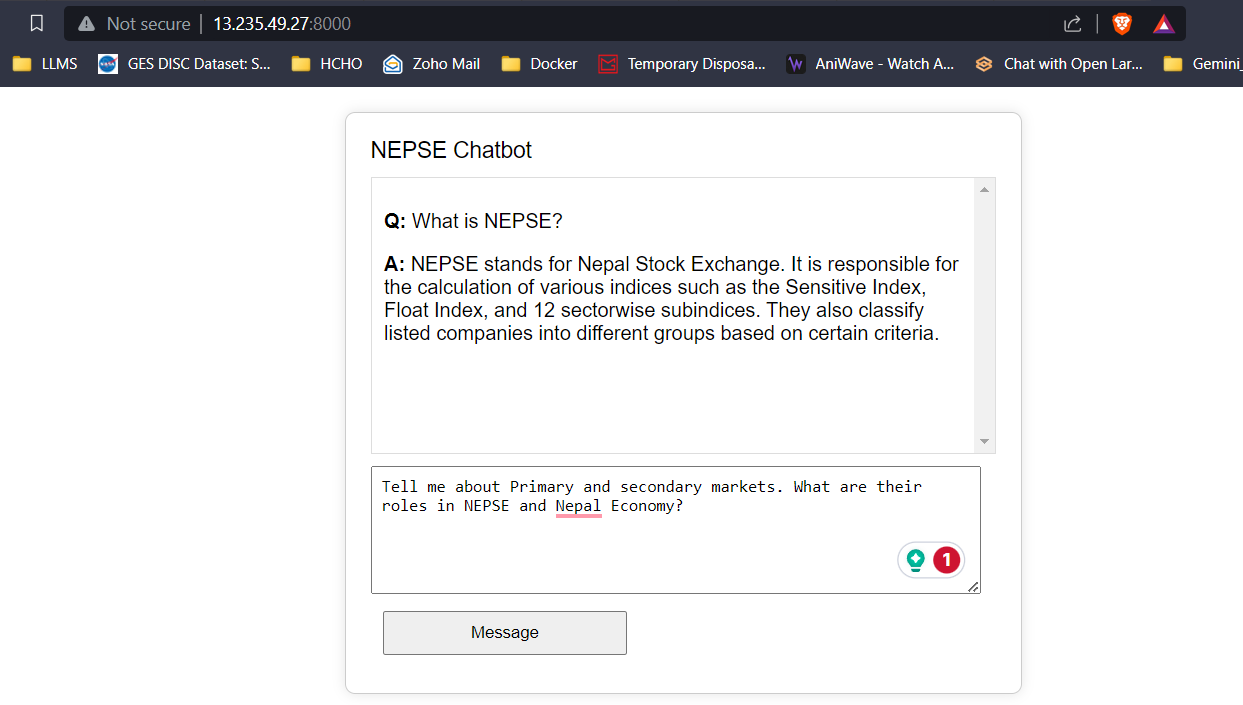

HTML、CSS、およびJavaScriptを使用したシンプルなフロントエンド、およびフラスコを使用したバックエンドが開発されました。 LLMからの応答/予測トークンは、ユーザーの遅延を減らし、ユーザーエクスペリエンスを向上させるために、リアルタイムでフロントエンドにストリーミングされます。アプリケーションは、リアルタイム推論のためにG4DN.XLARGE AWS EC2インスタンスに展開されます。

16 GBのVRAMを使用すると、3つのモデルすべてが問題なく簡単に適合します。以下のスクリーンショットとクリップには、AWSに展開されているNepse Chatbotのリアルタイムの質問回答機能が紹介されています。

LLM応答ストリーミング(chatgptなど)

下のリンクをクリックして、ビデオ全体を視聴/ダウンロードしてください。

ビデオを見る