想获得预算有限的更好模型吗?你在正确的地方

pip install text-denoising

r-denoiser(μ= 3,r = 0.15,n)∪(μ= 8,r = 0.15,n)

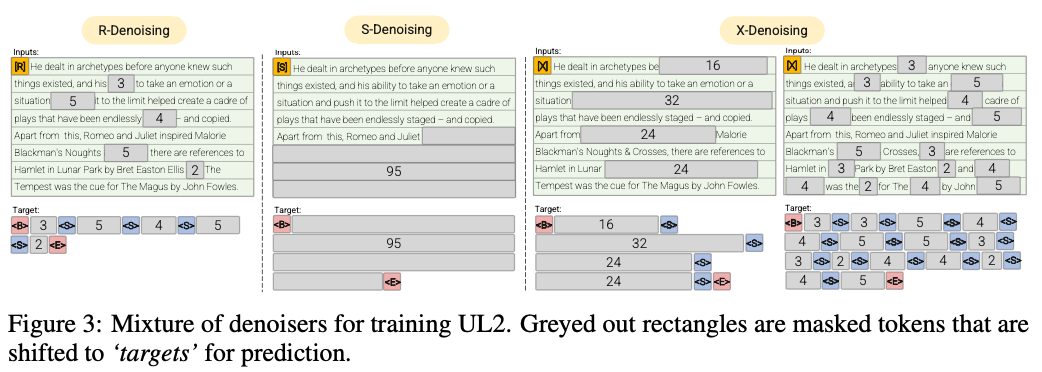

常规的降级是Raffel等人引入的标准跨度腐败。 (2019年),使用2到5个令牌作为跨度长度,掩盖了约15%的输入令牌

s-denoiser(μ= l/4,r = 0.25,1)

在构架输入到目标任务时,我们会观察到严格的顺序顺序的特定案例,即

X-denoiser(μ= 3,r = 0.5,n)∪(μ= 8,r = 0.5,n)∪(μ= 64,r = 0.15,n)∪(μ= 64,r = 0.5,n)

deNoising的极端版本必须在其中恢复输入的大部分部分,鉴于其中一个小到中等的部分。这模拟了一个情况,即模型需要从内存中产生长期目标的情况,并具有相对有限的信息。为此,我们选择包括具有侵略性denoising的示例,其中大约50%的输入序列被掩盖了

2022论文:超越规律,具有0.1%的额外计算

我们显示大约2倍的计算储蓄率

定期降级,从而将噪声采样为跨度,用哨兵代币取代。这也是Raffel等人使用的标准跨度腐败任务。 (2019)。跨度通常以平均3的平均值和15%的腐败率进行均匀采样。

极端的denoising在很大一部分原始文本或本质上很长的噪声增加到相对“极端”的数量。跨度通常以平均长度为32或高达50%的腐败率均匀地采样。

顺序的denoising,从文本的开头到文本中随机采样点,噪声总是被采样。这也称为前缀目标(不要与架构混淆)。

此存储库将仅仅是为了陪同这项任务,UL2对我的喜好来说太复杂了

50%的前缀,长达25%(极端)跨度腐败,25%的常规跨度腐败非常简单有效

在pythia json.zst文件上运行3090的MT5编码器

pip install text-denoising

python examples/pretrain_example.py

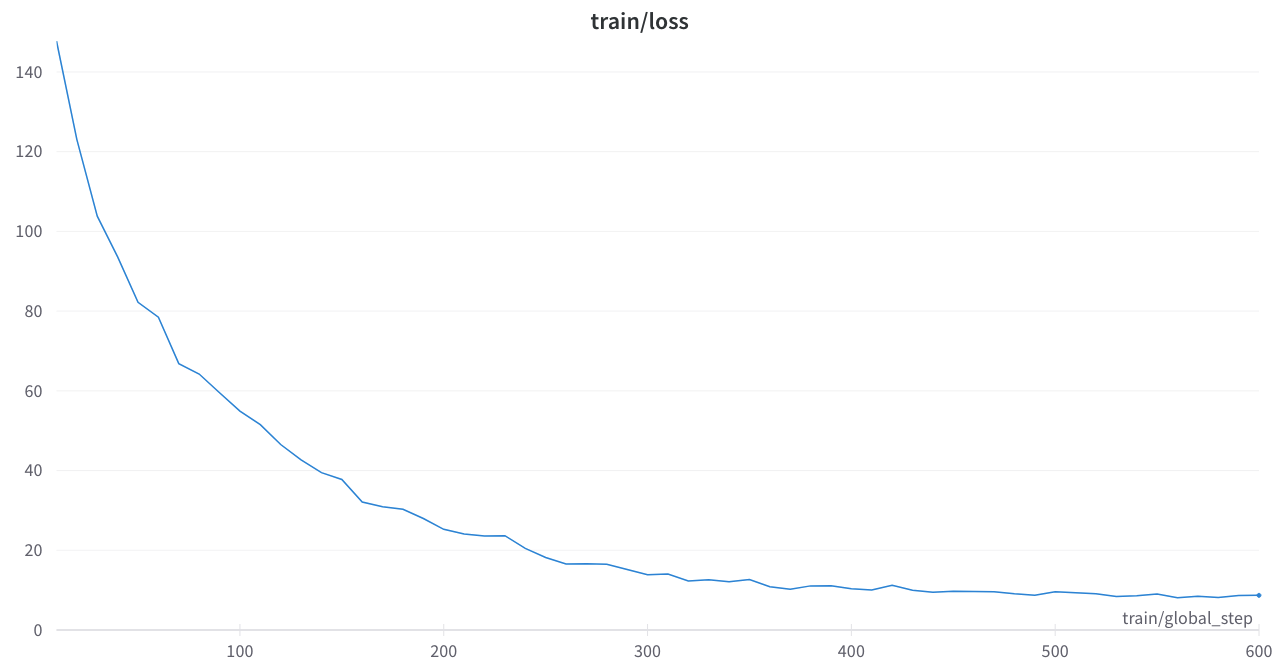

训练损失是稳定的,没有奇怪的尖峰

核心论文

超越缩放定律具有0.1%的额外计算

统一语言学习范式

在拥抱面变压器或python代码中的T5噪声掩蔽的工具

奥斯陆:被低估的,一些整洁和文档,这将是一个非常有用的工具

t5_pretraining.py

本节的启发很大

亚马逊科学:Python的标签意识鉴定

FairSeq:Span_mask_tokens_dataset.py