visual question answering finetuning

1.0.0

该存储库使用生成AI(Genai)来实现机器学习培训和推理团,以基于提供的图像来回答问题。存在预训练的模型以实现此类任务,但是它们是a)无法适应特定领域的方案 - 因此,为什么我们需要微调和b)不显示将部署到生产环境中的能力。

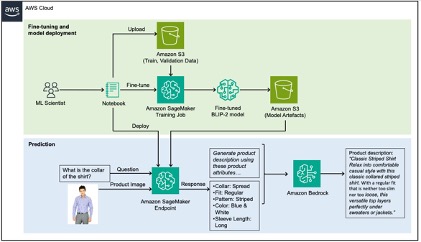

为了解决这个问题,这篇文章通过对使用Amazon SageMaker的时尚数据集上的VLM(视觉语言模型)微调VLM(视觉语言模型),展示了如何从产品图像中提取特定域的产品属性,然后使用Amazon Bedrock使用提取的属性作为输入来生成产品描述。

有关此存储库的详细演练,请参阅我们的博客文章。

该存储库中使用的数据取自Kaggle时尚图像数据集,我们尝试求解的用户酶正在为电子商务网站生成这些时尚产品的字幕,这一任务在历史上一直很耗时。高质量的产品描述通过搜索引擎优化(SEO)提高可搜索性,并通过允许他们做出明智的决策来提高客户满意度。

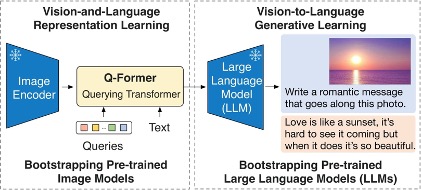

该存储库中的模型列出是Blip-2模型,更具体地说,是使用Flan-T5-XL的变体。

下图说明了Blip-2的概述:

该解决方案可以分为两个部分,在下面的成就中被标记为绿色和蓝色:a)绿色和b)蓝色推断。

有关更多信息,请参见贡献。

该图书馆已获得MIT-0许可证的许可。请参阅许可证文件。