Este repositorio implementa un regimiento de capacitación e inferencia de aprendizaje automático, utilizando IA generativa (Genai) para responder preguntas basadas en imágenes proporcionadas. Existen modelos previamente capacitados para lograr tales tareas, sin embargo, son A) incapaces de adaptarse a escenarios específicos del dominio, por lo que necesitamos ajustar y b) no mostrar la capacidad que se implementará en entornos de producción.

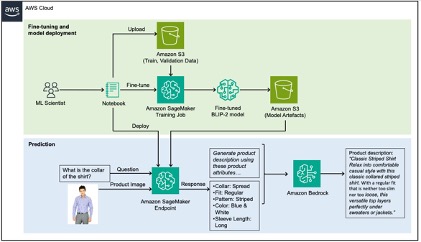

Para resolver este problema, esta publicación muestra cómo extraer atributos de productos específicos de dominio de las imágenes del producto al ajustar un VLM (modelo de lenguaje de visión) en un conjunto de datos de moda utilizando Amazon SageMaker, y luego use la roca madre de Amazon para generar descripciones de productos utilizando los atributos extraídos como entrada.

Para obtener un tutorial detallado de este repositorio, consulte nuestra publicación de blog.

Los datos utilizados en este repositorio están tomados del conjunto de datos de imágenes de moda de Kaggle y la USECase que intentamos resolver es generar subtítulos para estos productos de moda para un sitio web de comercio electrónico, una tarea que históricamente ha pasado mucho tiempo. Las descripciones de productos de alta calidad mejoran la capacidad de búsqueda a través de la optimización de motores de búsqueda (SEO), así como aumentan la satisfacción del cliente al permitirles tomar decisiones informadas.

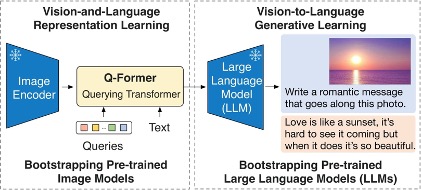

El modelo Finetuned en este repositorio es el modelo Blip-2 y, más específicamente, una variante que usa Flan-T5-XL.

El siguiente diagrama ilustra la descripción general de Blip-2:

La solución se puede dividir en dos secciones, marcadas de color verde y azul en la Achitecture a continuación: a) ajuste fino en verde yb) inferencia en azul.

Ver contribuyendo para más información.

Esta biblioteca tiene licencia bajo la licencia MIT-0. Ver el archivo de licencia.