이 저장소는 생성 AI (Genai)를 사용하여 제공된 이미지를 기반으로 질문에 대답하는 기계 학습 교육 및 추론 연대를 구현합니다. 미리 훈련 된 모델은 그러한 작업을 달성하기 위해 존재하지만 a) 도메인 별 시나리오에 적응할 수 없으므로 미세 조정 해야하는 이유와 b) 생산 환경에 배포 할 수있는 기능을 표시하지 않습니다.

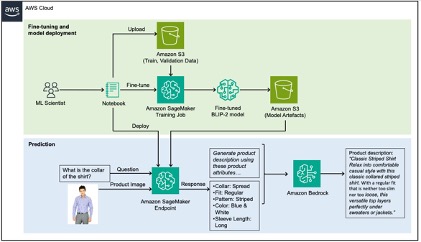

이 문제를 해결하기 위해이 게시물은 Amazon Sagemaker를 사용하여 패션 데이터 세트에서 VLM (Vision-Language Model)을 미세 조정하여 제품 이미지에서 도메인 별 제품 속성을 추출한 다음 Amazon Bedrock을 사용하여 추출 된 속성을 입력하여 제품 설명을 생성하는 방법을 보여줍니다.

이 저장소의 자세한 연습은 블로그 포스트를 참조하십시오.

이 저장소에 사용 된 데이터는 Kaggle Fashion Images DataSet에서 가져 왔으며 우리가 해결하려는 usecase는 역사적으로 시간이 많이 걸린 과제 인 전자 상거래 웹 사이트를위한 패션 제품에 대한 캡션을 생성하는 것입니다. 고품질 제품 설명은 검색 엔진 최적화 (SEO)를 통한 검색 가능성을 향상시킬뿐만 아니라 정보에 입각 한 결정을 내릴 수있게하여 고객 만족도를 높입니다.

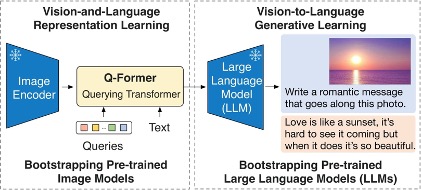

이 저장소에서 미세한 모델은 BLIP-2 모델이며보다 구체적으로는 FLAN-T5-XL을 사용하는 변형입니다.

다음 다이어그램은 Blip-2의 개요를 보여줍니다.

솔루션은 아래의 성취에서 녹색과 파란색으로 표시된 두 섹션으로 나눌 수 있습니다. a) 녹색의 미세 조정 및 b) 파란색의 추론.

자세한 내용은 기여를 참조하십시오.

이 라이브러리는 MIT-0 라이센스에 따라 라이센스가 부여됩니다. 라이센스 파일을 참조하십시오.