Gollama是用于管理Ollama型号的MacOS / Linux工具。

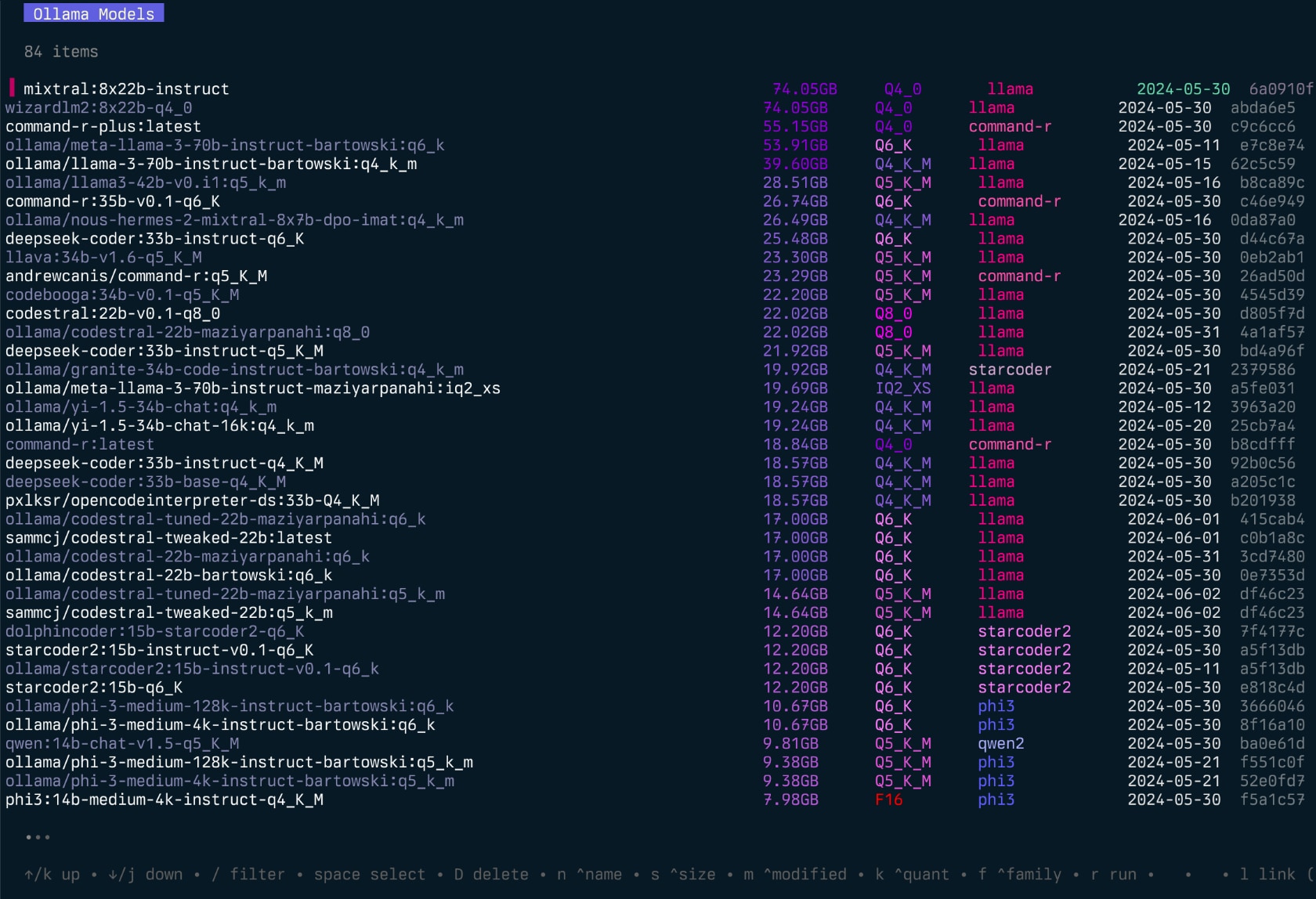

它提供了一个用于列表,检查,删除,复制和推动Ollama模型的TUI(文本用户界面),并将其链接到LM Studio*。

该应用程序允许用户使用Hotkeys进行交互选择模型,分类,过滤,编辑,运行,卸载和执行操作。

该项目始于重写我的Llamalink项目,但我决定将其扩展到包含更多功能并使其更加用户友好。

它正在积极开发中,因此有一些错误和缺少的功能,但是我发现它每天都对管理我的模型有用,尤其是清理旧型号。

另请参阅 - 摄入的目录/代码的回购量将其传递给LLMS的格式。

Gollama Intro(“播客”情节):

go install github.com/sammcj/gollama@HEAD我不建议使用此方法,因为它不太容易更新,但是您可以使用以下命令:

curl -sL https://raw.githubusercontent.com/sammcj/gollama/refs/heads/main/scripts/install.sh | bash从“发行版”页面下载最新版本,然后将二进制文件提取到路径中的目录。

例如zip -d gollama*.zip -d gollama && mv gollama /usr/local/bin

要运行gollama应用程序,请使用以下命令:

gollama提示:我喜欢别名Gollama到g以快速访问:

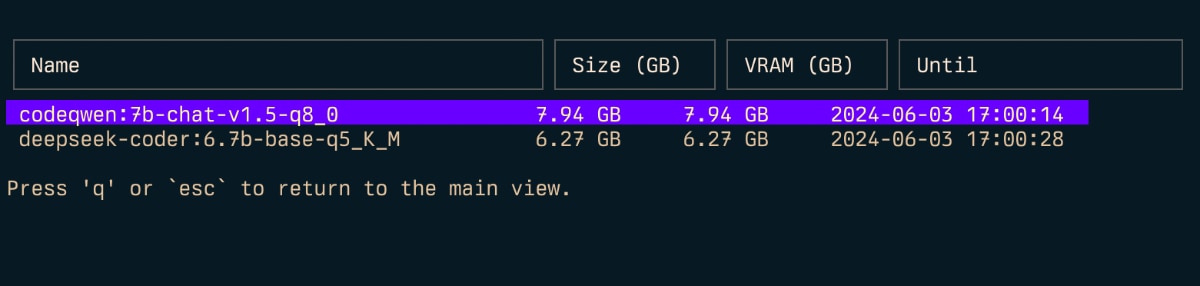

echo " alias g=gollama " >> ~ /.zshrcSpace :选择Enter :运行模型(Ollama Run)i :检查模型t :顶部(显示跑步模型)D :删除模型e :编辑模型新c :复制模型U :卸载所有型号p :将现有型号提取新g :拉(获取)新型号新P :推动模型n :按名称排序s :按大小排序m :通过修改k :按定量排序f :家人排序l :LM工作室的链接模型L :将所有型号链接到LM Studior :重命名模型(正在进行的工作)q :退出顶( t )

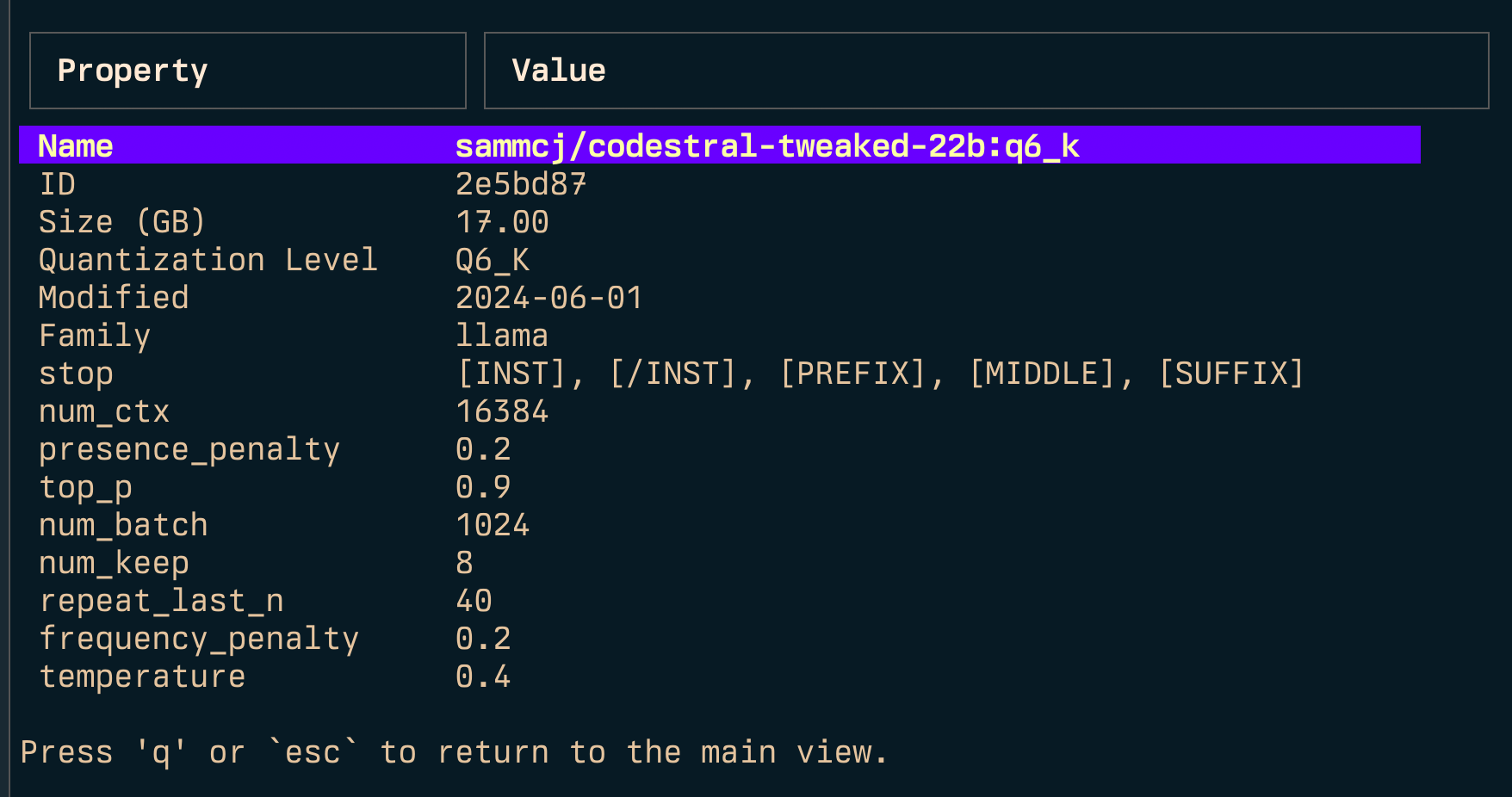

检查( i )

链接( l )和链接全( L )

注意:如果您正在运行Windows,则需要管理特权。

-l :列出所有可用的Ollama型号和退出-L :将所有可用的Ollama车型链接到LM Studio和退出-s <search term> :按名称搜索模型'term1|term2' )返回匹配任一术的模型'term1&term2' )返回与两个术语匹配的模型-e <model> :编辑模型-ollama-dir :自定义Ollama模型目录-lm-dir :自定义LM Studio Models目录-cleanup :删除所有链接模型和空目录和退出-no-cleanup :不要清理断裂的符号链接-u :卸载所有运行模型-v :打印版本和退出-h或--host :为Ollama API指定主机-H : -h http://localhost:11434 (连接到本地Ollama API)的快捷方式--vram :估计模型的VRAM使用情况。接受:llama3.1:8b-instruct-q6_K , qwen2:14b-q4_0 )NousResearch/Hermes-2-Theta-Llama-3-8B )--fits :GB中的可用内存用于上下文计算(例如6GB的6 )--vram-to-nth或--context :要分析的最大上下文长度(例如32k或128k )--quant :覆盖定量级别(例如Q4_0 , Q5_K_M ) Gollama也可以与-l一起调用,以列出没有TUI的模型。

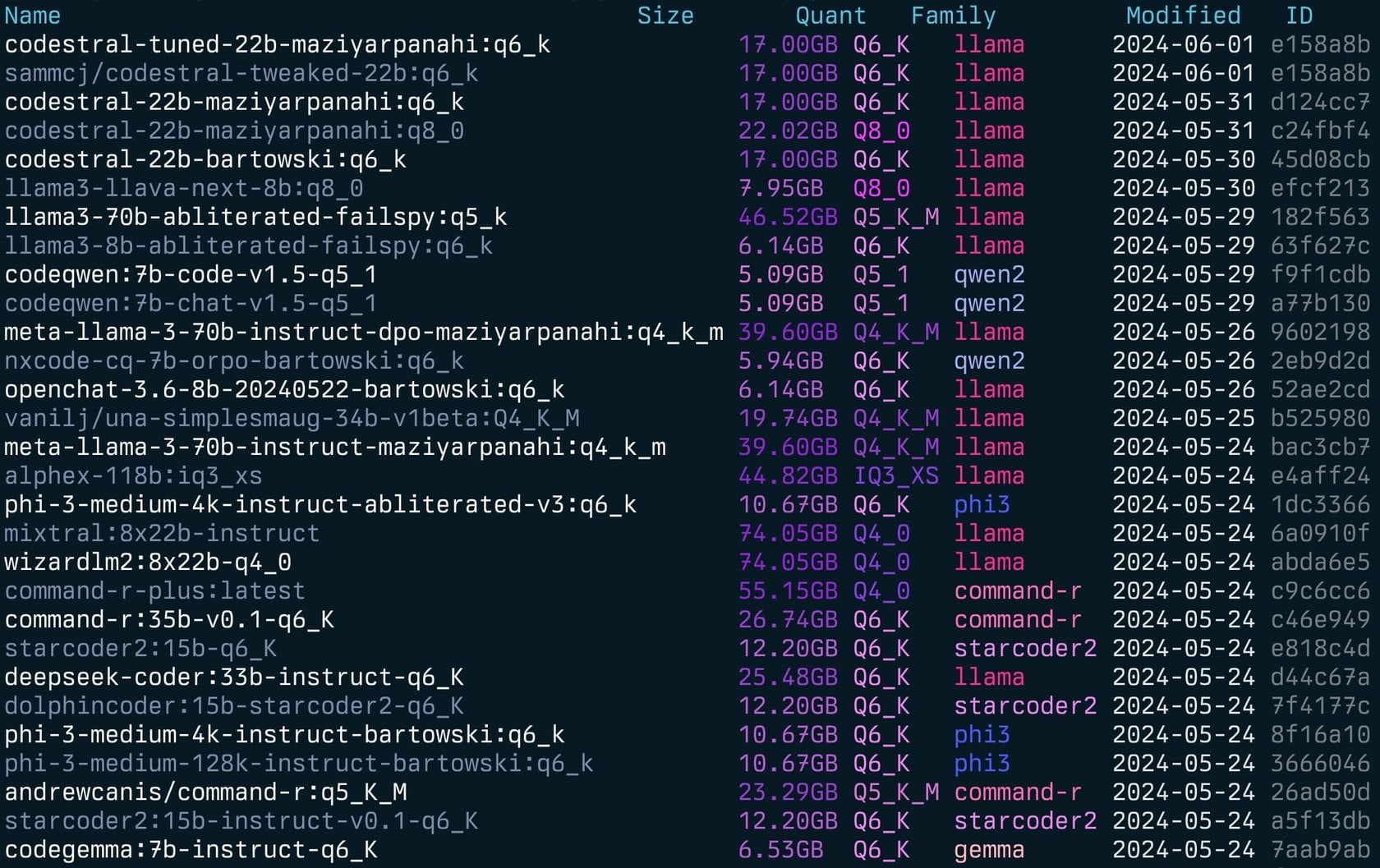

gollama -l列表( gollama -l ):

Gollama可以与-e一起调用以编辑模型的寄生器。

gollama -e my-modelGollama可以与-s一起调用,以搜索模型。

gollama -s my-model # returns models that contain 'my-model'

gollama -s ' my-model|my-other-model ' # returns models that contain either 'my-model' or 'my-other-model'

gollama -s ' my-model&instruct ' # returns models that contain both 'my-model' and 'instruct' Gollama包括全面的VRAM估计功能:

my-model:mytag )或HuggingFace模型ID(例如author/name )的VRAM使用情况

估计(v)RAM使用:

gollama --vram llama3.1:8b-instruct-q6_K

VRAM Estimation for Model: llama3.1:8b-instruct-q6_K

| QUANT | CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| ------- | ---- | --- | --- | --------------- | --------------- | --------------- | --------------- |

| IQ1_S | 1.56 | 2.2 | 2.8 | 3.7(3.7,3.7) | 5.5(5.5,5.5) | 7.3(7.3,7.3) | 9.1(9.1,9.1) |

| IQ2_XXS | 2.06 | 2.6 | 3.3 | 4.3(4.3,4.3) | 6.1(6.1,6.1) | 7.9(7.9,7.9) | 9.8(9.8,9.8) |

| IQ2_XS | 2.31 | 2.9 | 3.6 | 4.5(4.5,4.5) | 6.4(6.4,6.4) | 8.2(8.2,8.2) | 10.1(10.1,10.1) |

| IQ2_S | 2.50 | 3.1 | 3.8 | 4.7(4.7,4.7) | 6.6(6.6,6.6) | 8.5(8.5,8.5) | 10.4(10.4,10.4) |

| IQ2_M | 2.70 | 3.2 | 4.0 | 4.9(4.9,4.9) | 6.8(6.8,6.8) | 8.7(8.7,8.7) | 10.6(10.6,10.6) |

| IQ3_XXS | 3.06 | 3.6 | 4.3 | 5.3(5.3,5.3) | 7.2(7.2,7.2) | 9.2(9.2,9.2) | 11.1(11.1,11.1) |

| IQ3_XS | 3.30 | 3.8 | 4.5 | 5.5(5.5,5.5) | 7.5(7.5,7.5) | 9.5(9.5,9.5) | 11.4(11.4,11.4) |

| Q2_K | 3.35 | 3.9 | 4.6 | 5.6(5.6,5.6) | 7.6(7.6,7.6) | 9.5(9.5,9.5) | 11.5(11.5,11.5) |

| Q3_K_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_M | 3.70 | 4.2 | 5.0 | 6.0(6.0,6.0) | 8.0(8.0,8.0) | 9.9(9.9,9.9) | 12.0(12.0,12.0) |

| Q3_K_M | 3.91 | 4.4 | 5.2 | 6.2(6.2,6.2) | 8.2(8.2,8.2) | 10.2(10.2,10.2) | 12.2(12.2,12.2) |

| IQ4_XS | 4.25 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.6(10.6,10.6) | 12.7(12.7,12.7) |

| Q3_K_L | 4.27 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.7(10.7,10.7) | 12.7(12.7,12.7) |

| IQ4_NL | 4.50 | 5.0 | 5.7 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 10.9(10.9,10.9) | 13.0(13.0,13.0) |

| Q4_0 | 4.55 | 5.0 | 5.8 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_S | 4.58 | 5.0 | 5.8 | 6.9(6.9,6.9) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_M | 4.85 | 5.3 | 6.1 | 7.1(7.1,7.1) | 9.2(9.2,9.2) | 11.4(11.4,11.4) | 13.5(13.5,13.5) |

| Q4_K_L | 4.90 | 5.3 | 6.1 | 7.2(7.2,7.2) | 9.3(9.3,9.3) | 11.4(11.4,11.4) | 13.6(13.6,13.6) |

| Q5_K_S | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_0 | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_K_M | 5.69 | 6.1 | 6.9 | 8.0(8.0,8.0) | 10.2(10.2,10.2) | 12.4(12.4,12.4) | 14.6(14.6,14.6) |

| Q5_K_L | 5.75 | 6.1 | 7.0 | 8.1(8.1,8.1) | 10.3(10.3,10.3) | 12.5(12.5,12.5) | 14.7(14.7,14.7) |

| Q6_K | 6.59 | 7.0 | 8.0 | 9.4(9.4,9.4) | 12.2(12.2,12.2) | 15.0(15.0,15.0) | 17.8(17.8,17.8) |

| Q8_0 | 8.50 | 8.8 | 9.9 | 11.4(11.4,11.4) | 14.4(14.4,14.4) | 17.4(17.4,17.4) | 20.3(20.3,20.3) |要找到适用于给定内存约束(例如6GB)的最佳定量类型,您可以提供--fits <number of GB> :

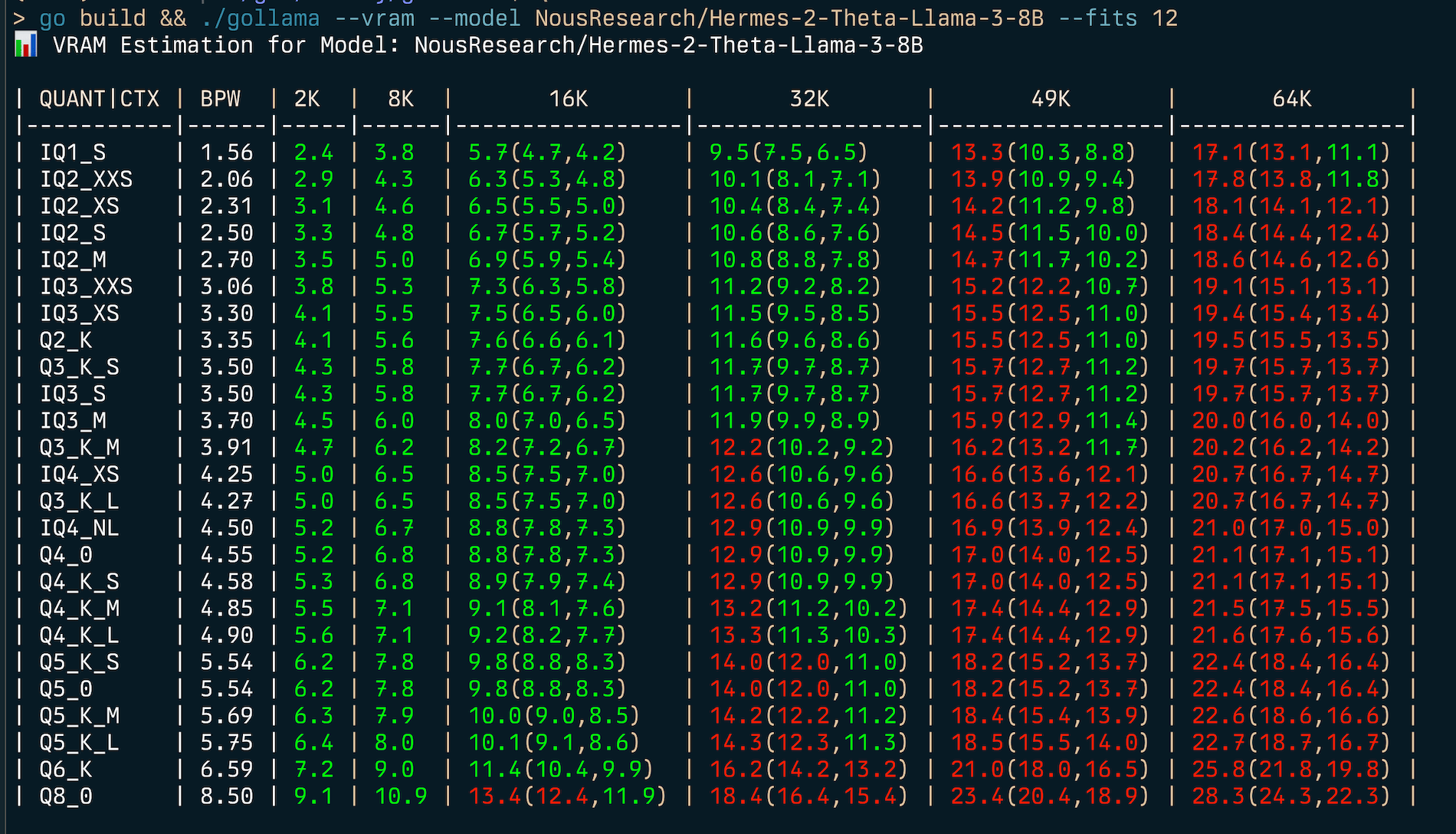

gollama --vram NousResearch/Hermes-2-Theta-Llama-3-8B --fits 6

VRAM Estimation for Model: NousResearch/Hermes-2-Theta-Llama-3-8B

| QUANT/CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| --------- | ---- | --- | --- | ------------ | ------------- | -------------- | --------------- |

| IQ1_S | 1.56 | 2.4 | 3.8 | 5.7(4.7,4.2) | 9.5(7.5,6.5) | 13.3(10.3,8.8) | 17.1(13.1,11.1) |

| IQ2_XXS | 2.06 | 2.9 | 4.3 | 6.3(5.3,4.8) | 10.1(8.1,7.1) | 13.9(10.9,9.4) | 17.8(13.8,11.8) |

...这将显示一个表,显示各种定量类型和上下文大小的VRAM使用情况。

VRAM估计器的工作原理:

注意:估算器将尝试使用CUDA VRAM(如果有),否则它将落回系统RAM进行计算。

Gollama使用位于~/.config/gollama/config.json JSON配置文件。配置文件包括用于排序,列,API键,日志级别等的选项...

示例配置:

{

"default_sort" : " modified " ,

"columns" : [

" Name " ,

" Size " ,

" Quant " ,

" Family " ,

" Modified " ,

" ID "

],

"ollama_api_key" : " " ,

"ollama_api_url" : " http://localhost:11434 " ,

"lm_studio_file_paths" : " " ,

"log_level" : " info " ,

"log_file_path" : " /Users/username/.config/gollama/gollama.log " ,

"sort_order" : " Size " ,

"strip_string" : " my-private-registry.internal/ " ,

"editor" : " " ,

"docker_container" : " "

}strip_string可用于从模型名称中删除前缀,因为它们在TUI中显示。如果您有一个常见的前缀,例如出于显示目的,这将很有用。docker_container实验- 如果设置,Gollama将尝试执行指定容器内的任何运行操作。editor -实验- 如果设置,Gollama将使用此编辑器打开寄生器进行编辑。 克隆存储库:

git clone https://github.com/sammcj/gollama.git

cd gollama建造:

go get

make build跑步:

./gollama可以在$HOME/.config/gollama/gollama.log中存储在gollama.log中的日志。可以在配置文件中设置日志级别。

欢迎捐款!请分配存储库,并在更改中创建拉动请求。

山姆 | 何塞·阿尔马拉兹(Jose Almaraz) | 何塞·罗伯托·阿尔马拉兹(Jose Roberto Almaraz) | Oleksii Filonenko | 绍斯沃尔夫 | anrgct |

感谢Matt Williams,Fahd Mirza和AI Code King等人提供的镜头并提供反馈。

版权所有©2024 Sam McLeod

该项目已根据MIT许可获得许可。有关详细信息,请参见许可证文件。

<script src =“ http://api.html5media.info/1.1.8/html5media.min.js”> </script>