Gollama هي أداة MacOS / Linux لإدارة نماذج Ollama.

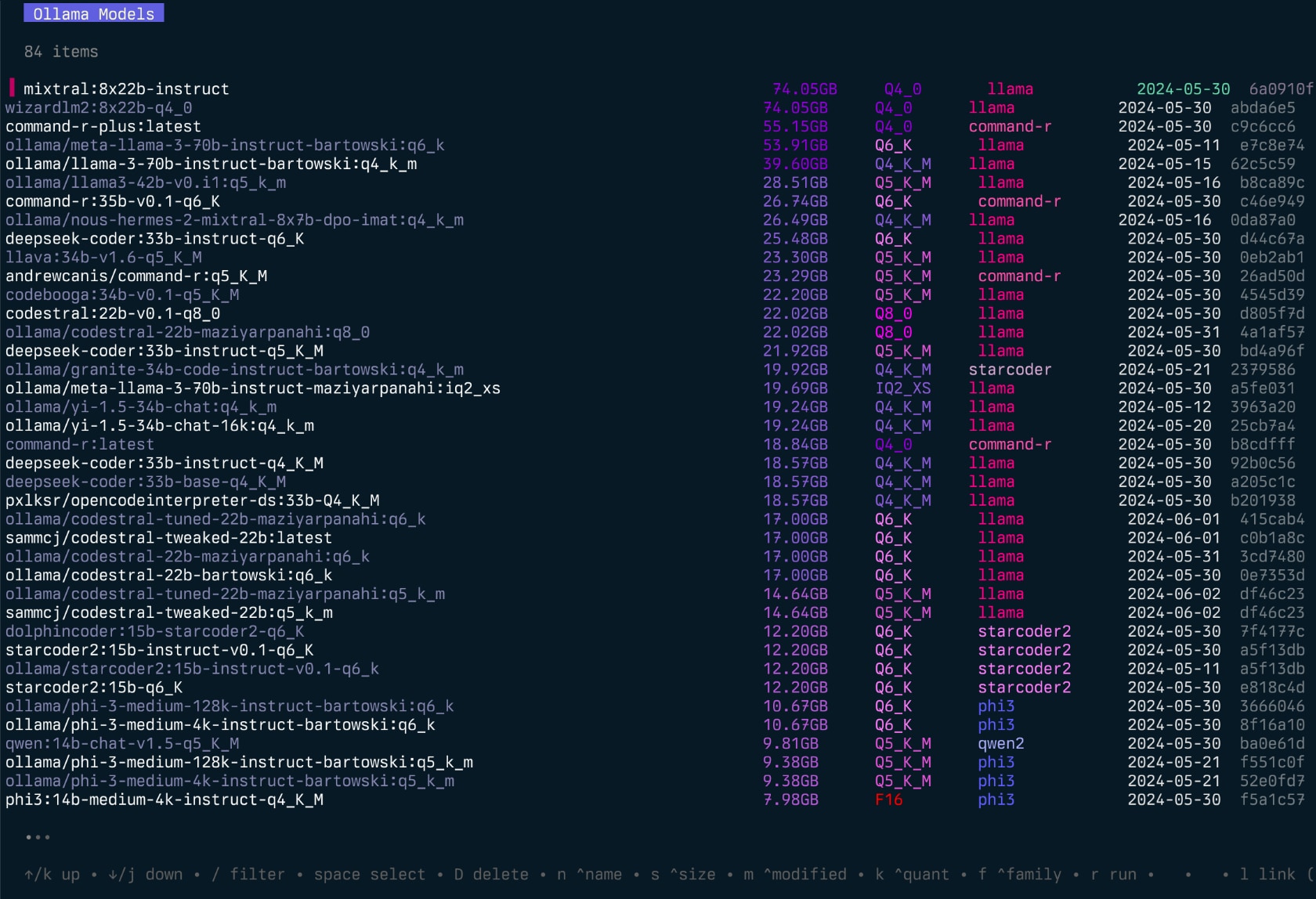

يوفر TUI (واجهة مستخدم نص) لإدراج نماذج Ollama ، تفتيش ، حذف ، نسخ ، ودفع نماذج Ollama وكذلك ربطها اختياريًا بـ LM Studio*.

يتيح التطبيق للمستخدمين تحديد النماذج والفرز والتصفية وتحريرها وتشغيلها وتفريغها وتنفيذها باستخدام مفاتيح hotkeys.

بدأ المشروع بمثابة إعادة كتابة لمشروع Llamalink الخاص بي ، لكنني قررت توسيعه لتضمين المزيد من الميزات وجعله أكثر سهولة في الاستخدام.

إنه في التطوير النشط ، لذلك هناك بعض الأخطاء والميزات المفقودة ، ومع ذلك أجدها مفيدة لإدارة الطرز الخاصة بي كل يوم ، خاصة لتنظيف النماذج القديمة.

انظر أيضًا - الاستيعاب لتمرير الدلائل/إعادة تدوين الكود لتنسيق Meddown for LLMS.

مقدمة Gollama (حلقة "Podcast"):

go install github.com/sammcj/gollama@HEADلا أوصي بهذه الطريقة لأنه ليس من السهل التحديث ، ولكن يمكنك استخدام الأمر التالي:

curl -sL https://raw.githubusercontent.com/sammcj/gollama/refs/heads/main/scripts/install.sh | bashقم بتنزيل أحدث إصدار من صفحة الإصدارات واستخرج الثنائي إلى دليل في طريقك.

على سبيل المثال zip -d gollama*.zip -d gollama && mv gollama /usr/local/bin

لتشغيل تطبيق gollama ، استخدم الأمر التالي:

gollama نصيحة : أحب الاسم المستعار Gollama إلى g للوصول السريع:

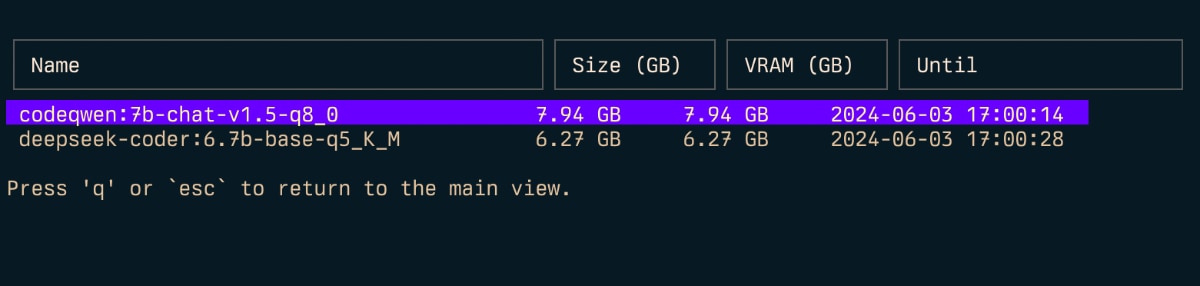

echo " alias g=gollama " >> ~ /.zshrcSpace : حددEnter : Run Model (Ollama Run)i : فحص النموذجt : TOP (عرض نماذج الجري)D : حذف النموذجe : تحرير نموذج جديدc : نموذج نموذجU : تفريغ جميع النماذجp : اسحب نموذجًا جديدًا جديدًاg : سحب (الحصول) نموذج جديد جديدP : نموذج الدفعn : الفرز بالاسمs : الفرز حسب الحجمm : الفرز حسب التعديلk : الفرز حسب الكميةf : فرز حسب الأسرةl : طراز Link to LM StudioL : ربط جميع النماذج إلى استوديو LMr : إعادة تسمية النموذج (العمل قيد التقدم)q : استقال أعلى ( t )

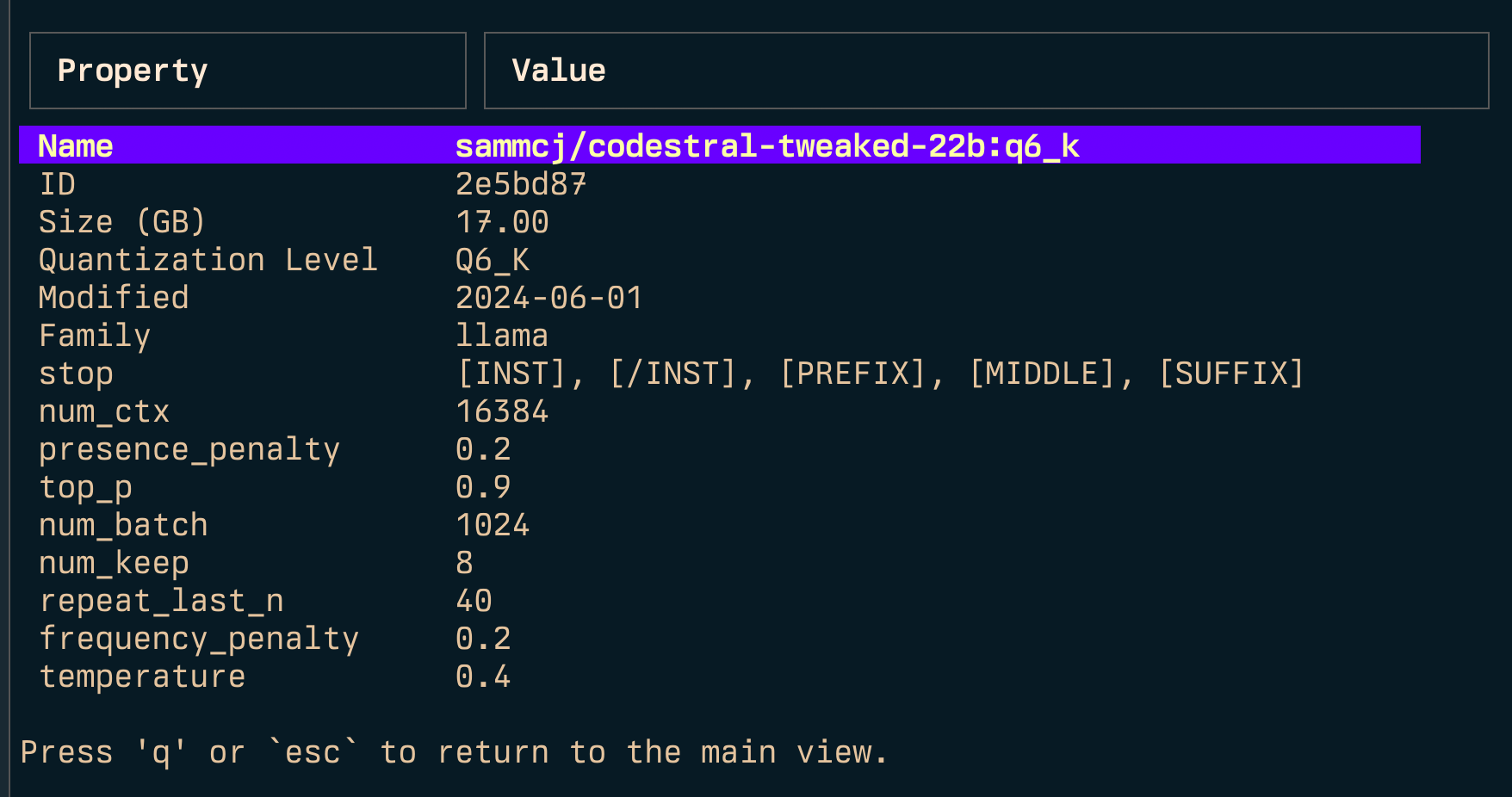

فحص ( i )

الرابط ( l ) وربط جميع ( L )

ملاحظة: يتطلب امتيازات المسؤول إذا كنت تقوم بتشغيل Windows.

-l : قائمة جميع نماذج Ollama المتاحة والخروج-L : اربط جميع طرز Ollama المتاحة إلى LM Studio والخروج-s <search term>'term1|term2' ) بإرجاع النماذج التي تتطابق مع أي مصطلح'term1&term2' ) بإرجاع النماذج التي تتطابق مع كلا المصطلحين-e <model> : تحرير modelfile لنموذج-ollama-dir : دليل نماذج Ollama المخصص-lm-dir : دليل نماذج الاستوديو المخصص LM-cleanup : قم بإزالة جميع النماذج المتماثلة والأدلة الفارغة والخروج-no-cleanup : لا تنظيف الارتباطات المكسورة-u : تفريغ جميع نماذج التشغيل-v : اطبع الإصدار والخروج-h ، أو --host : حدد المضيف لـ Ollama API-H : اختصار -h http://localhost:11434 (الاتصال بـ Ollama API المحلي) جديد--vram : تقدير استخدام VRAM لنموذج. يقبل:llama3.1:8b-instruct-q6_K ، qwen2:14b-q4_0 )NousResearch/Hermes-2-Theta-Llama-3-8B )--fits : الذاكرة المتاحة في GB لحساب السياق (على سبيل المثال 6 جيجا بايت)--vram-to-nth أو --context : الحد الأقصى لطول السياق للتحليل (على سبيل المثال 32k أو 128k )--quant : تجاوز مستوى الكمية (على سبيل المثال Q4_0 ، Q5_K_M ) يمكن أيضًا استدعاء Gollama مع -l لسرد النماذج بدون TUI.

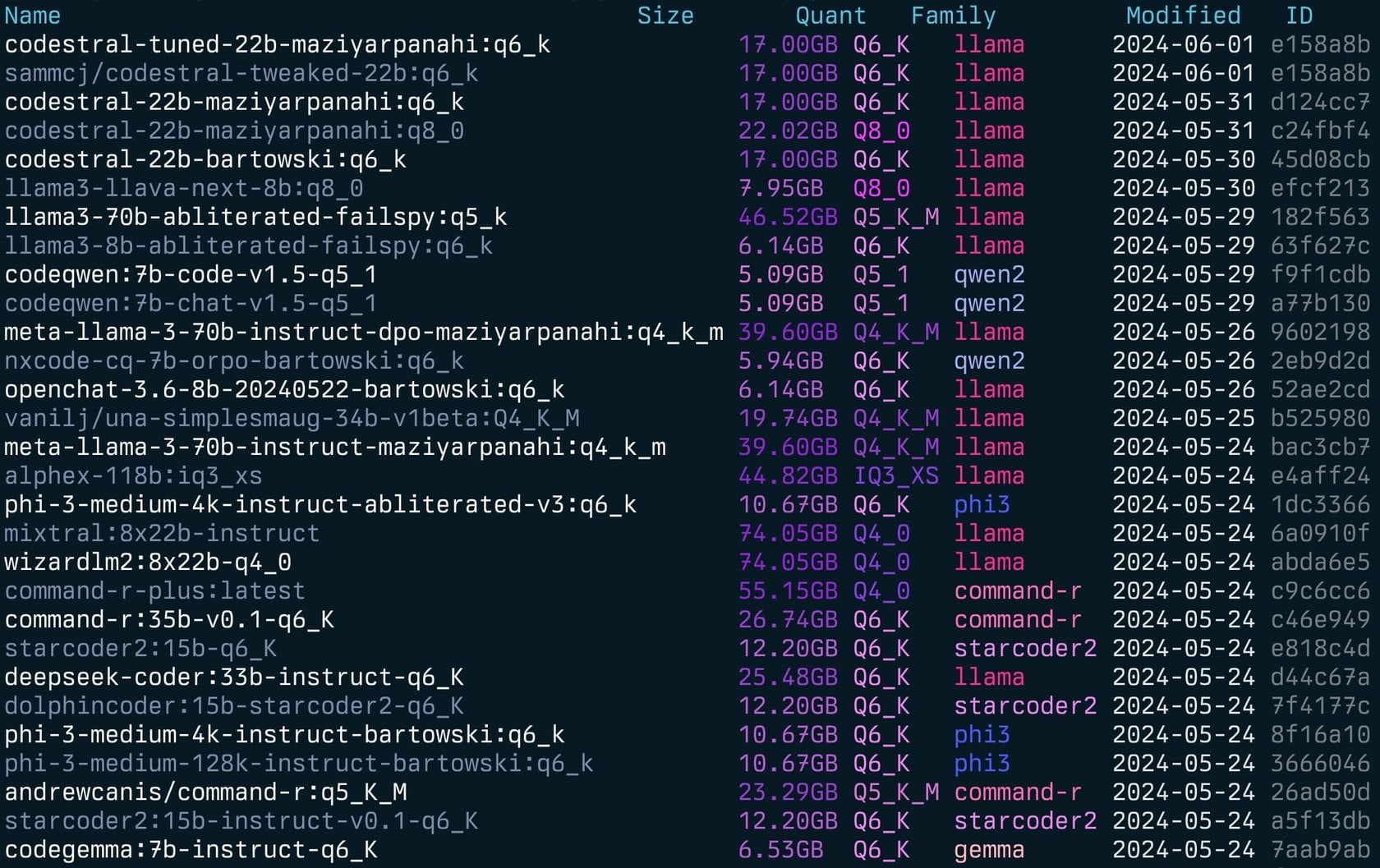

gollama -l قائمة ( gollama -l ):

يمكن استدعاء Gollama مع -e لتحرير modelfile لنموذج.

gollama -e my-model يمكن استدعاء Gollama مع -s للبحث عن النماذج بالاسم.

gollama -s my-model # returns models that contain 'my-model'

gollama -s ' my-model|my-other-model ' # returns models that contain either 'my-model' or 'my-other-model'

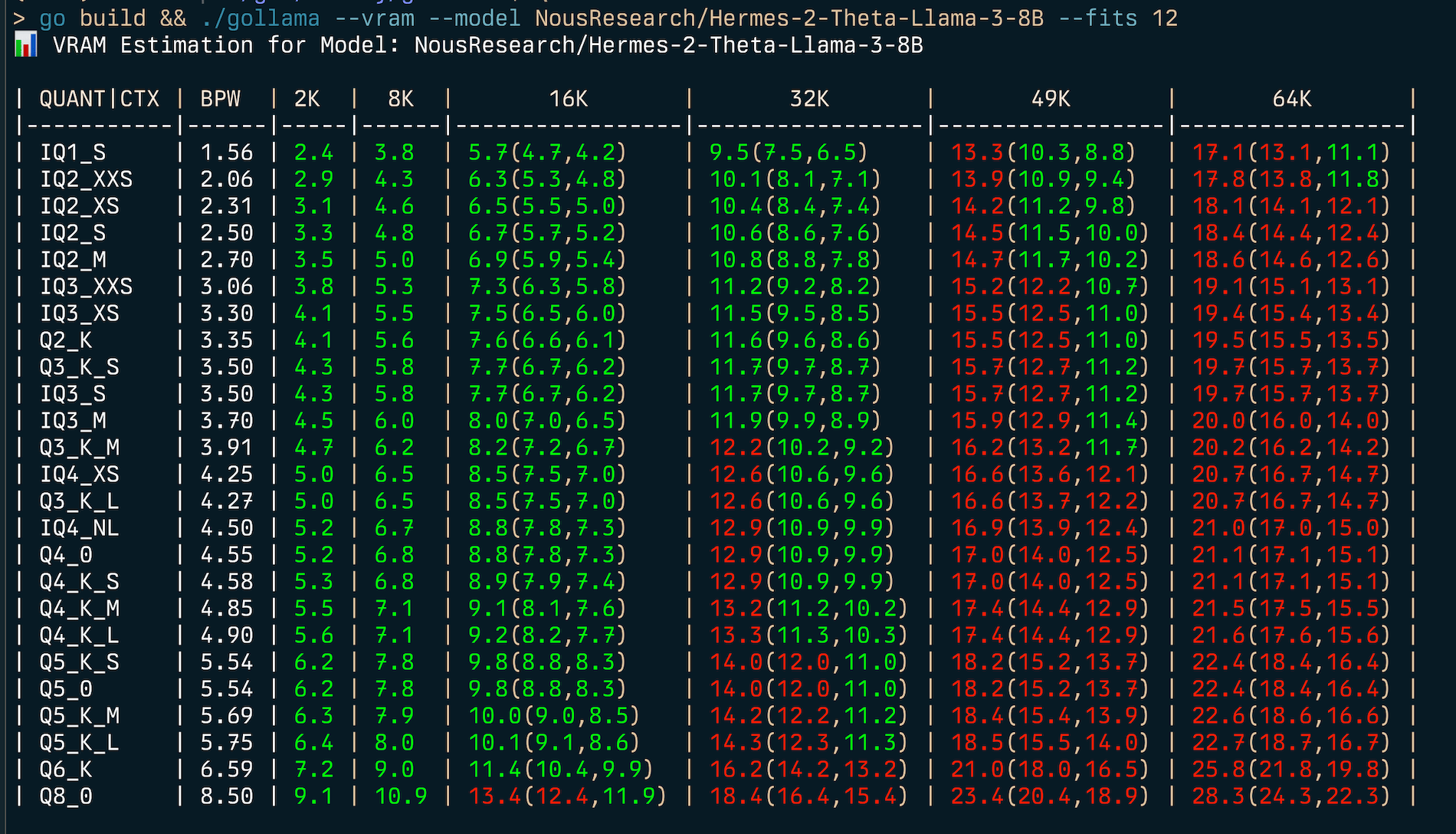

gollama -s ' my-model&instruct ' # returns models that contain both 'my-model' and 'instruct' يتضمن Gollama ميزة تقدير VRAM شاملة:

my-model:mytag ) ، أو معرف نموذج المعانقة (مثل author/name )

لتقدير (5) استخدام RAM:

gollama --vram llama3.1:8b-instruct-q6_K

VRAM Estimation for Model: llama3.1:8b-instruct-q6_K

| QUANT | CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| ------- | ---- | --- | --- | --------------- | --------------- | --------------- | --------------- |

| IQ1_S | 1.56 | 2.2 | 2.8 | 3.7(3.7,3.7) | 5.5(5.5,5.5) | 7.3(7.3,7.3) | 9.1(9.1,9.1) |

| IQ2_XXS | 2.06 | 2.6 | 3.3 | 4.3(4.3,4.3) | 6.1(6.1,6.1) | 7.9(7.9,7.9) | 9.8(9.8,9.8) |

| IQ2_XS | 2.31 | 2.9 | 3.6 | 4.5(4.5,4.5) | 6.4(6.4,6.4) | 8.2(8.2,8.2) | 10.1(10.1,10.1) |

| IQ2_S | 2.50 | 3.1 | 3.8 | 4.7(4.7,4.7) | 6.6(6.6,6.6) | 8.5(8.5,8.5) | 10.4(10.4,10.4) |

| IQ2_M | 2.70 | 3.2 | 4.0 | 4.9(4.9,4.9) | 6.8(6.8,6.8) | 8.7(8.7,8.7) | 10.6(10.6,10.6) |

| IQ3_XXS | 3.06 | 3.6 | 4.3 | 5.3(5.3,5.3) | 7.2(7.2,7.2) | 9.2(9.2,9.2) | 11.1(11.1,11.1) |

| IQ3_XS | 3.30 | 3.8 | 4.5 | 5.5(5.5,5.5) | 7.5(7.5,7.5) | 9.5(9.5,9.5) | 11.4(11.4,11.4) |

| Q2_K | 3.35 | 3.9 | 4.6 | 5.6(5.6,5.6) | 7.6(7.6,7.6) | 9.5(9.5,9.5) | 11.5(11.5,11.5) |

| Q3_K_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_M | 3.70 | 4.2 | 5.0 | 6.0(6.0,6.0) | 8.0(8.0,8.0) | 9.9(9.9,9.9) | 12.0(12.0,12.0) |

| Q3_K_M | 3.91 | 4.4 | 5.2 | 6.2(6.2,6.2) | 8.2(8.2,8.2) | 10.2(10.2,10.2) | 12.2(12.2,12.2) |

| IQ4_XS | 4.25 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.6(10.6,10.6) | 12.7(12.7,12.7) |

| Q3_K_L | 4.27 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.7(10.7,10.7) | 12.7(12.7,12.7) |

| IQ4_NL | 4.50 | 5.0 | 5.7 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 10.9(10.9,10.9) | 13.0(13.0,13.0) |

| Q4_0 | 4.55 | 5.0 | 5.8 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_S | 4.58 | 5.0 | 5.8 | 6.9(6.9,6.9) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_M | 4.85 | 5.3 | 6.1 | 7.1(7.1,7.1) | 9.2(9.2,9.2) | 11.4(11.4,11.4) | 13.5(13.5,13.5) |

| Q4_K_L | 4.90 | 5.3 | 6.1 | 7.2(7.2,7.2) | 9.3(9.3,9.3) | 11.4(11.4,11.4) | 13.6(13.6,13.6) |

| Q5_K_S | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_0 | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_K_M | 5.69 | 6.1 | 6.9 | 8.0(8.0,8.0) | 10.2(10.2,10.2) | 12.4(12.4,12.4) | 14.6(14.6,14.6) |

| Q5_K_L | 5.75 | 6.1 | 7.0 | 8.1(8.1,8.1) | 10.3(10.3,10.3) | 12.5(12.5,12.5) | 14.7(14.7,14.7) |

| Q6_K | 6.59 | 7.0 | 8.0 | 9.4(9.4,9.4) | 12.2(12.2,12.2) | 15.0(15.0,15.0) | 17.8(17.8,17.8) |

| Q8_0 | 8.50 | 8.8 | 9.9 | 11.4(11.4,11.4) | 14.4(14.4,14.4) | 17.4(17.4,17.4) | 20.3(20.3,20.3) | للعثور على أفضل نوع الكميات لقيود ذاكرة معينة (مثل 6 جيجابايت) يمكنك توفيرها --fits <number of GB> :

gollama --vram NousResearch/Hermes-2-Theta-Llama-3-8B --fits 6

VRAM Estimation for Model: NousResearch/Hermes-2-Theta-Llama-3-8B

| QUANT/CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| --------- | ---- | --- | --- | ------------ | ------------- | -------------- | --------------- |

| IQ1_S | 1.56 | 2.4 | 3.8 | 5.7(4.7,4.2) | 9.5(7.5,6.5) | 13.3(10.3,8.8) | 17.1(13.1,11.1) |

| IQ2_XXS | 2.06 | 2.9 | 4.3 | 6.3(5.3,4.8) | 10.1(8.1,7.1) | 13.9(10.9,9.4) | 17.8(13.8,11.8) |

...سيعرض هذا جدولًا يوضح استخدام VRAM لأنواع الكمية المختلفة وأحجام السياق.

مقدر VRAM يعمل بواسطة:

ملاحظة: سيحاول المقدر استخدام CUDA VRAM إذا كان ذلك متاحًا ، وإلا فإنه سيعود إلى ذاكرة الوصول العشوائي للنظام للحسابات.

يستخدم Gollama ملف تكوين JSON الموجود في ~/.config/gollama/config.json . يتضمن ملف التكوين خيارات للفرز والأعمدة ومفاتيح API ومستويات السجل وما إلى ذلك ...

مثال التكوين:

{

"default_sort" : " modified " ,

"columns" : [

" Name " ,

" Size " ,

" Quant " ,

" Family " ,

" Modified " ,

" ID "

],

"ollama_api_key" : " " ,

"ollama_api_url" : " http://localhost:11434 " ,

"lm_studio_file_paths" : " " ,

"log_level" : " info " ,

"log_file_path" : " /Users/username/.config/gollama/gollama.log " ,

"sort_order" : " Size " ,

"strip_string" : " my-private-registry.internal/ " ,

"editor" : " " ,

"docker_container" : " "

}strip_string لإزالة بادئة من أسماء النماذج عند عرضها في TUI. يمكن أن يكون هذا مفيدًا إذا كان لديك بادئة مشتركة مثل السجل الخاص الذي تريد إزالته لأغراض العرض.docker_container - تجريبي - إذا تم تعيينه ، فسوف يحاول Gollama إجراء أي عمليات تشغيل داخل الحاوية المحددة.editor - تجريبي - إذا تم تعيينه ، فسيستخدم Gollama هذا المحرر لفتح Modelfile للتحرير. استنساخ المستودع:

git clone https://github.com/sammcj/gollama.git

cd gollamaيبني:

go get

make buildيجري:

./gollama يمكن العثور على سجلات في gollama.log التي يتم تخزينها في $HOME/.config/gollama/gollama.log بشكل افتراضي. يمكن تعيين مستوى السجل في ملف التكوين.

المساهمات مرحب بها! يرجى تورك المستودع وإنشاء طلب سحب مع تغييراتك.

سام | خوسيه الملاز | خوسيه روبرتو الملاز | Oleksii Filonenko | ساوث وولف | anrgct |

شكرًا لك على الأشخاص مثل Matt Williams و Fahd Mirza و AI Code King لإعطاء هذه اللقطة وتقديم ملاحظات.

حقوق الطبع والنشر © 2024 Sam McLeod

هذا المشروع مرخص بموجب ترخيص معهد ماساتشوستس للتكنولوجيا. انظر ملف الترخيص للحصول على التفاصيل.

<script src = "http://api.html5media.info/1.1.8/html5media.min.js"> </script>