Gollama - это инструмент MacOS / Linux для управления моделями Ollama.

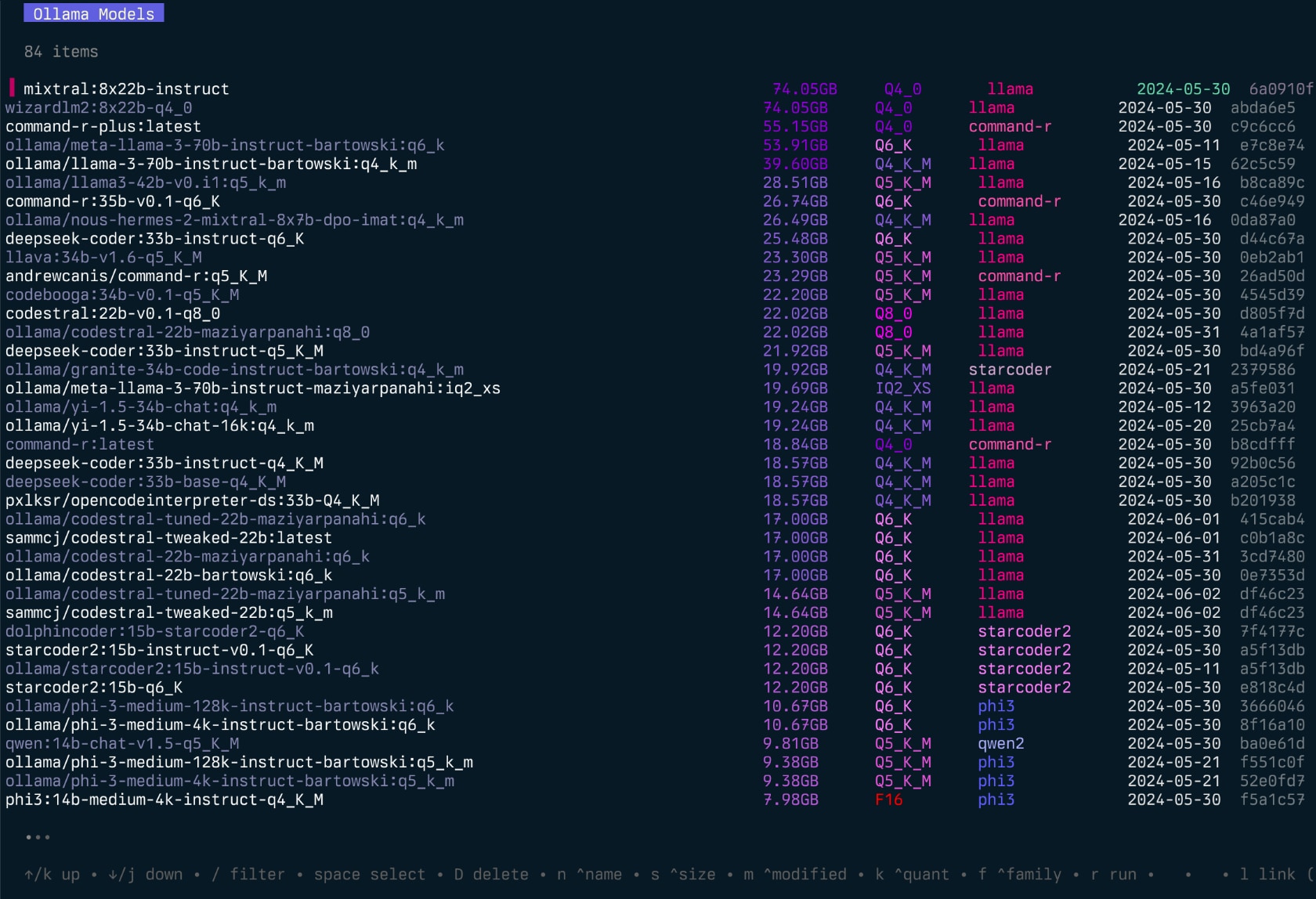

Он предоставляет TUI (текстовый пользовательский интерфейс) для листинга, осмотра, удаления, копирования и толкания моделей Ollama, а также, а также, а также для привязки их с LM Studio*.

Приложение позволяет пользователям интерактивно выбирать модели, сортировать, фильтровать, редактировать, запускать, разгружать и выполнять действия на них с помощью Hotkeys.

Проект начинался как переписывание моего проекта Llamalink, но я решил расширить его, чтобы включить больше функций и сделать его более удобным для пользователя.

Он находится в активной разработке, поэтому есть некоторые ошибки и отсутствующие функции, однако я нахожу это полезным для управления моими моделями каждый день, особенно для очистки старых моделей.

См. Также - Переход для прохождения каталогов/репо от кода на Markdown, отформатированные для LLMS.

Gollama Intro (эпизод «подкаст»):

go install github.com/sammcj/gollama@HEADЯ не рекомендую этот метод, так как обновление не так просто, но вы можете использовать следующую команду:

curl -sL https://raw.githubusercontent.com/sammcj/gollama/refs/heads/main/scripts/install.sh | bashЗагрузите самый последний релиз со страницы релизов и извлеките двоичный файл в каталог на вашем пути.

например, zip -d gollama*.zip -d gollama && mv gollama /usr/local/bin

Чтобы запустить приложение gollama , используйте следующую команду:

gollama Совет : мне нравится псевдоним g для быстрого доступа:

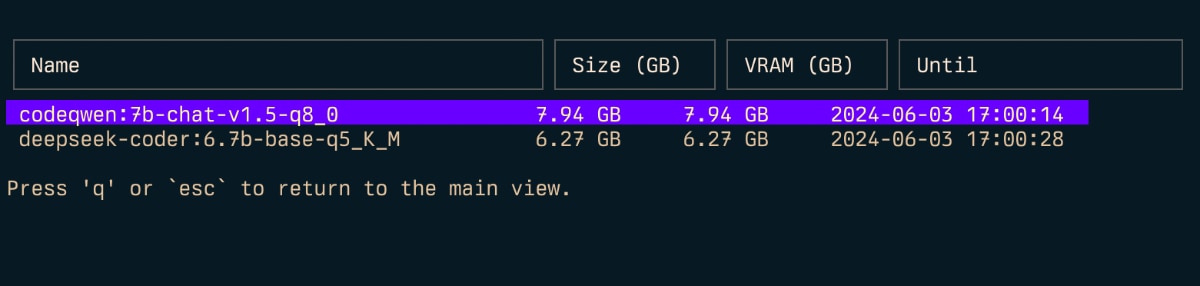

echo " alias g=gollama " >> ~ /.zshrcSpace : выберитеEnter : запустить модель (ollama run)i : Просмотрите модельt : Top (показывать модели бега)D : Удалить модельe : Редактировать модель новойc : Модель копииU : разгрузить все моделиp : Потяните существующую модель новуюg : Pull (Get) Новая модель новаяP : Push Modeln : сортировать по имениs : Сортировать по размеруm : Сортировать по модифицированномуk : Сортировать квантизациейf : сортировать от семьиl : модель ссылки на LM StudioL : Свяжите все модели с LM Studior : переименовать модель (работа в процессе)q : уйти Верх ( t )

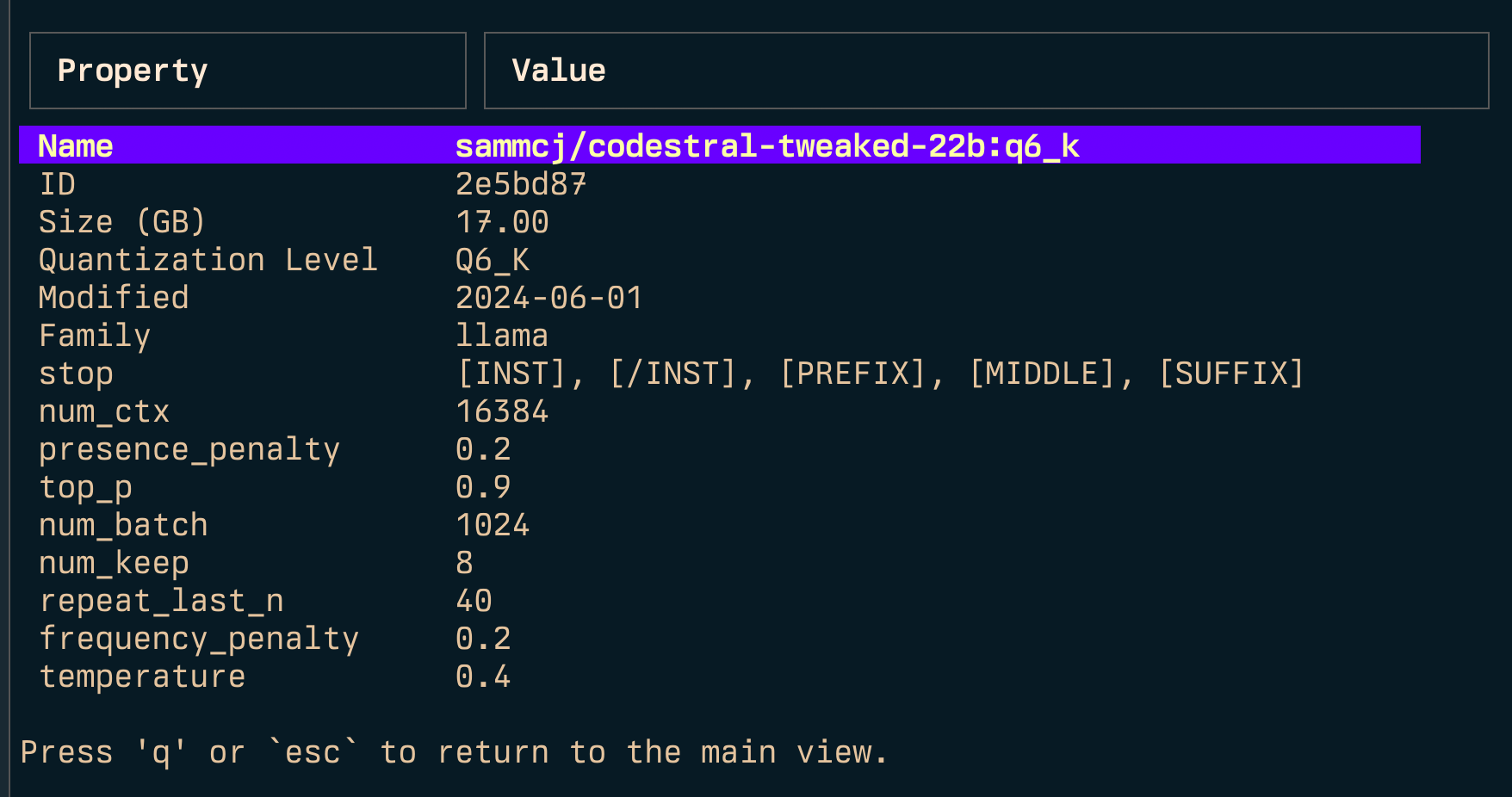

Просмотрите ( i )

Ссылка ( l ) и ссылка All ( L )

Примечание. Требуются привилегии администратора, если вы запускаете Windows.

-l : Перечислите все доступные модели Ollama и выход-L : ссылка все доступные модели Ollama с LM Studio и выходом-s <search term> : Поиск моделей по имени'term1|term2' ) возвращает модели, которые соответствуют любому термину'term1&term2' ) возвращает модели, которые соответствуют оба термина-e <model> : отредактируйте Modelfile для модели-ollama-dir : Custom Ollama Models Directory-lm-dir : Custom LM Studio Models Directory-cleanup : удалите все сочувствующие модели и пустые каталоги и выходят-no-cleanup : не очищайте сломанные символики-u : разгрузить все запущенные модели-v : распечатать версию и выйти-h , или --host : укажите хост для API Ollama API-H : ярлык для -h http://localhost:11434 (подключиться к местному API Ollama) Новый--vram : Оцените использование VRAM для модели. Принимает:llama3.1:8b-instruct-q6_K , qwen2:14b-q4_0 )NousResearch/Hermes-2-Theta-Llama-3-8B )--fits : доступная память в ГБ для расчета контекста (например, 6 для 6 ГБ)--vram-to-nth OR --context : максимальная длина контекста для анализа (например, 32k или 128k )--quant : переопределить уровень квантования (например, Q4_0 , Q5_K_M ) Gollama также можно вызвать с -l для перечисления моделей без TUI.

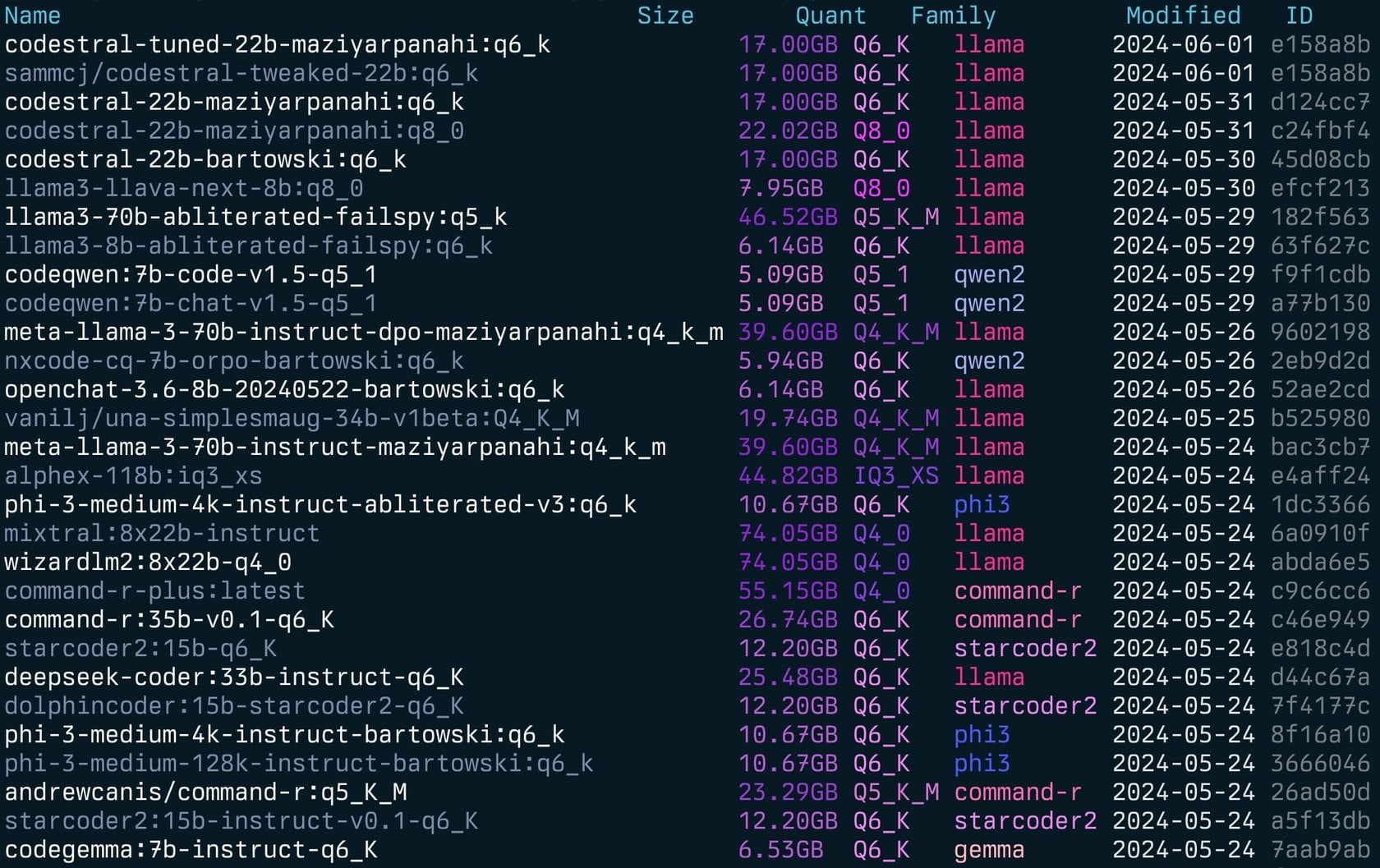

gollama -l Список ( gollama -l ):

Gollama можно вызвать с -e , чтобы редактировать Modelfile для модели.

gollama -e my-model Gollama можно вызвать с -s для поиска моделей по имени.

gollama -s my-model # returns models that contain 'my-model'

gollama -s ' my-model|my-other-model ' # returns models that contain either 'my-model' or 'my-other-model'

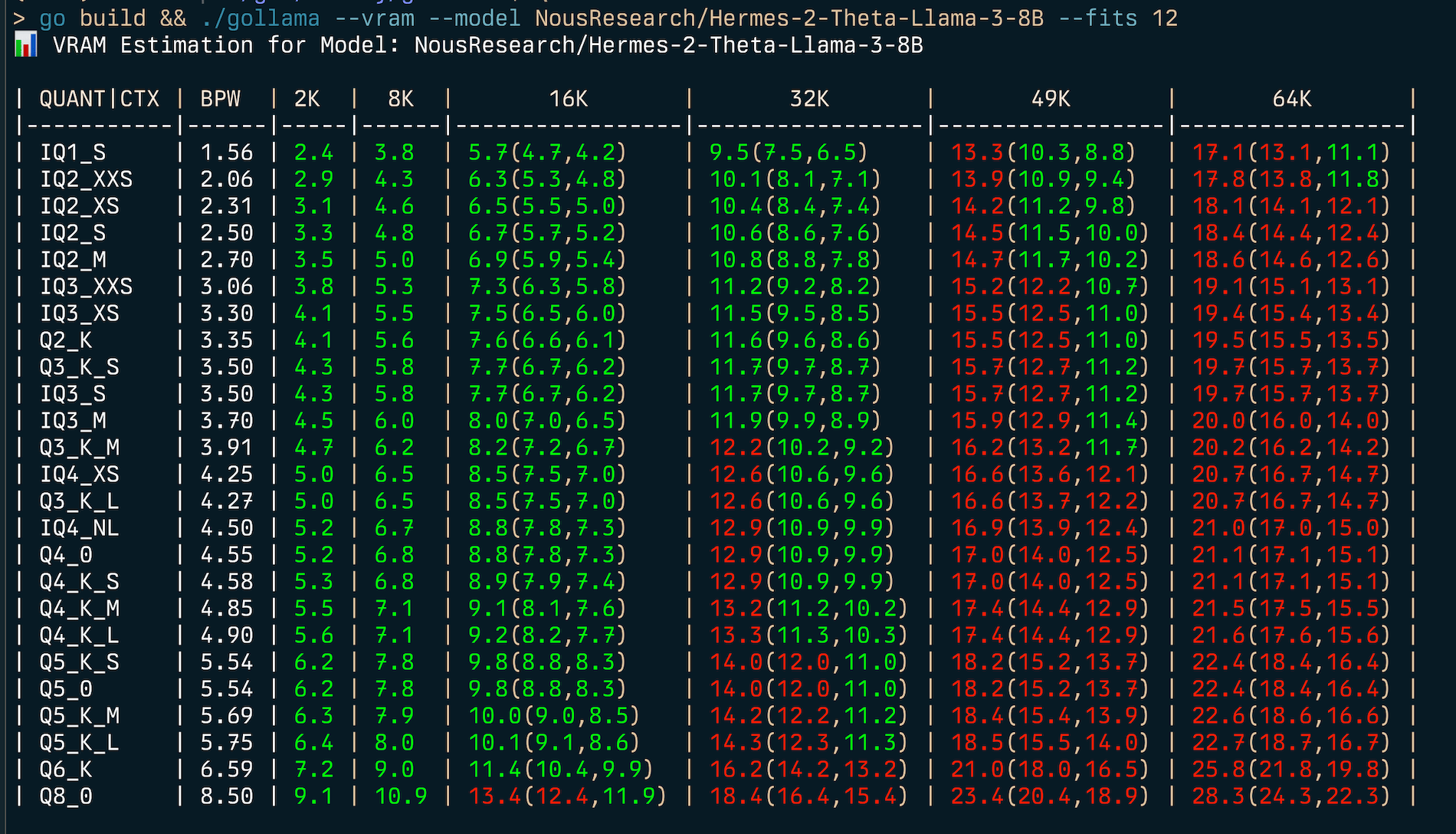

gollama -s ' my-model&instruct ' # returns models that contain both 'my-model' and 'instruct' Голлама включает в себя комплексную функцию оценки VRAM:

my-model:mytag ) или идентификатор модели HuggingFace (например, author/name )

Чтобы оценить (v) использование RAM:

gollama --vram llama3.1:8b-instruct-q6_K

VRAM Estimation for Model: llama3.1:8b-instruct-q6_K

| QUANT | CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| ------- | ---- | --- | --- | --------------- | --------------- | --------------- | --------------- |

| IQ1_S | 1.56 | 2.2 | 2.8 | 3.7(3.7,3.7) | 5.5(5.5,5.5) | 7.3(7.3,7.3) | 9.1(9.1,9.1) |

| IQ2_XXS | 2.06 | 2.6 | 3.3 | 4.3(4.3,4.3) | 6.1(6.1,6.1) | 7.9(7.9,7.9) | 9.8(9.8,9.8) |

| IQ2_XS | 2.31 | 2.9 | 3.6 | 4.5(4.5,4.5) | 6.4(6.4,6.4) | 8.2(8.2,8.2) | 10.1(10.1,10.1) |

| IQ2_S | 2.50 | 3.1 | 3.8 | 4.7(4.7,4.7) | 6.6(6.6,6.6) | 8.5(8.5,8.5) | 10.4(10.4,10.4) |

| IQ2_M | 2.70 | 3.2 | 4.0 | 4.9(4.9,4.9) | 6.8(6.8,6.8) | 8.7(8.7,8.7) | 10.6(10.6,10.6) |

| IQ3_XXS | 3.06 | 3.6 | 4.3 | 5.3(5.3,5.3) | 7.2(7.2,7.2) | 9.2(9.2,9.2) | 11.1(11.1,11.1) |

| IQ3_XS | 3.30 | 3.8 | 4.5 | 5.5(5.5,5.5) | 7.5(7.5,7.5) | 9.5(9.5,9.5) | 11.4(11.4,11.4) |

| Q2_K | 3.35 | 3.9 | 4.6 | 5.6(5.6,5.6) | 7.6(7.6,7.6) | 9.5(9.5,9.5) | 11.5(11.5,11.5) |

| Q3_K_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_M | 3.70 | 4.2 | 5.0 | 6.0(6.0,6.0) | 8.0(8.0,8.0) | 9.9(9.9,9.9) | 12.0(12.0,12.0) |

| Q3_K_M | 3.91 | 4.4 | 5.2 | 6.2(6.2,6.2) | 8.2(8.2,8.2) | 10.2(10.2,10.2) | 12.2(12.2,12.2) |

| IQ4_XS | 4.25 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.6(10.6,10.6) | 12.7(12.7,12.7) |

| Q3_K_L | 4.27 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.7(10.7,10.7) | 12.7(12.7,12.7) |

| IQ4_NL | 4.50 | 5.0 | 5.7 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 10.9(10.9,10.9) | 13.0(13.0,13.0) |

| Q4_0 | 4.55 | 5.0 | 5.8 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_S | 4.58 | 5.0 | 5.8 | 6.9(6.9,6.9) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_M | 4.85 | 5.3 | 6.1 | 7.1(7.1,7.1) | 9.2(9.2,9.2) | 11.4(11.4,11.4) | 13.5(13.5,13.5) |

| Q4_K_L | 4.90 | 5.3 | 6.1 | 7.2(7.2,7.2) | 9.3(9.3,9.3) | 11.4(11.4,11.4) | 13.6(13.6,13.6) |

| Q5_K_S | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_0 | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_K_M | 5.69 | 6.1 | 6.9 | 8.0(8.0,8.0) | 10.2(10.2,10.2) | 12.4(12.4,12.4) | 14.6(14.6,14.6) |

| Q5_K_L | 5.75 | 6.1 | 7.0 | 8.1(8.1,8.1) | 10.3(10.3,10.3) | 12.5(12.5,12.5) | 14.7(14.7,14.7) |

| Q6_K | 6.59 | 7.0 | 8.0 | 9.4(9.4,9.4) | 12.2(12.2,12.2) | 15.0(15.0,15.0) | 17.8(17.8,17.8) |

| Q8_0 | 8.50 | 8.8 | 9.9 | 11.4(11.4,11.4) | 14.4(14.4,14.4) | 17.4(17.4,17.4) | 20.3(20.3,20.3) | Чтобы найти наилучший тип квантования для данного ограничения памяти (например, 6 ГБ), вы можете предоставить --fits <number of GB> :

gollama --vram NousResearch/Hermes-2-Theta-Llama-3-8B --fits 6

VRAM Estimation for Model: NousResearch/Hermes-2-Theta-Llama-3-8B

| QUANT/CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| --------- | ---- | --- | --- | ------------ | ------------- | -------------- | --------------- |

| IQ1_S | 1.56 | 2.4 | 3.8 | 5.7(4.7,4.2) | 9.5(7.5,6.5) | 13.3(10.3,8.8) | 17.1(13.1,11.1) |

| IQ2_XXS | 2.06 | 2.9 | 4.3 | 6.3(5.3,4.8) | 10.1(8.1,7.1) | 13.9(10.9,9.4) | 17.8(13.8,11.8) |

...Это отобразит таблицу, показывающая использование VRAM для различных типов количественных типов и размеров контекста.

Оценка VRAM работает по:

ПРИМЕЧАНИЕ. Оценка попытается использовать Cuda VRAM, если она будет доступна, в противном случае он вернется к системной оперативной памяти для расчетов.

Gollama использует файл конфигурации JSON, расположенный по адресу ~/.config/gollama/config.json . Файл конфигурации включает в себя параметры для сортировки, столбцов, клавиш API, уровней журнала и т. Д.

Пример конфигурации:

{

"default_sort" : " modified " ,

"columns" : [

" Name " ,

" Size " ,

" Quant " ,

" Family " ,

" Modified " ,

" ID "

],

"ollama_api_key" : " " ,

"ollama_api_url" : " http://localhost:11434 " ,

"lm_studio_file_paths" : " " ,

"log_level" : " info " ,

"log_file_path" : " /Users/username/.config/gollama/gollama.log " ,

"sort_order" : " Size " ,

"strip_string" : " my-private-registry.internal/ " ,

"editor" : " " ,

"docker_container" : " "

}strip_string может использоваться для удаления префикса из имен моделей, как они отображаются в TUI. Это может быть полезно, если у вас есть общий префикс, такой как частный реестр, который вы хотите удалить в целях отображения.docker_container - Experimental - Если установлено, Голлама попытается выполнить любые операции прогона внутри указанного контейнера.editor - Экспериментальный - если установлен, Голлама будет использовать этот редактор, чтобы открыть Modelfile для редактирования. Клонировать репозиторий:

git clone https://github.com/sammcj/gollama.git

cd gollamaСтроить:

go get

make buildБегать:

./gollama Журналы можно найти в gollama.log , который хранится в $HOME/.config/gollama/gollama.log по умолчанию. Уровень журнала может быть установлен в файле конфигурации.

Взносы приветствуются! Пожалуйста, распадайте репозиторий и создайте запрос на привлечение с вашими изменениями.

Сэм | Хосе Альмарас | Хосе Роберто Альмарас | Oleksii Филоненко | Саугвольф | anrgct |

Спасибо таким людям, как Мэтт Уильямс, Фахд Мирза и Кодекс ИИ -Кодекса за то, что они дали это и предоставили обратную связь.

Copyright © 2024 Sam McLeod

Этот проект лицензирован по лицензии MIT. Смотрите файл лицензии для получения подробной информации.

<script src = "http://api.html5media.info/1.1.8/html5media.min.js"> </script>