Gollamaは、Ollamaモデルを管理するためのMacOS / Linuxツールです。

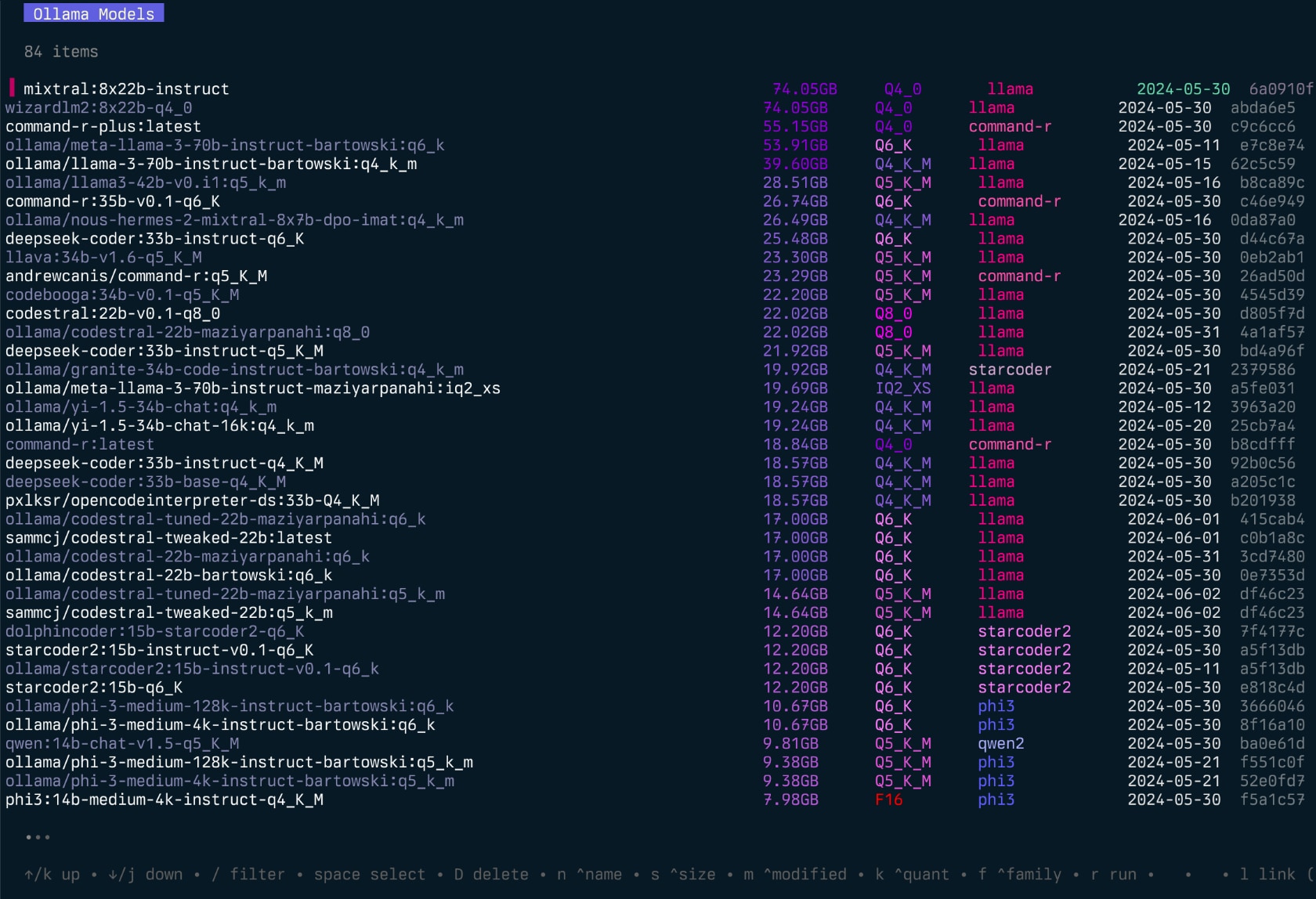

Ollamaモデルのリスト、検査、削除、コピー、プッシュのためのTUI(テキストユーザーインターフェイス)を提供し、オプションでLM Studio*にリンクします。

このアプリケーションを使用すると、ユーザーはモデルをインタラクティブに選択し、ソート、フィルター、編集、実行、アンロード、およびホットキーを使用してアクションを実行できます。

このプロジェクトは、Llamalinkプロジェクトの書き直しとして始まりましたが、より多くの機能を含めてユーザーフレンドリーにするように拡張することにしました。

アクティブな開発中であるため、いくつかのバグや機能が不足していることがありますが、特に古いモデルのクリーンアップには、毎日モデルを管理するのに役立ちます。

参照 - LLMS用にフォーマットされたマークダウンのコードのディレクトリ/レポスを渡すための摂取。

Gollama Intro(「ポッドキャスト」エピソード):

go install github.com/sammcj/gollama@HEAD更新するのは簡単ではないので、この方法はお勧めしませんが、次のコマンドを使用できます。

curl -sL https://raw.githubusercontent.com/sammcj/gollama/refs/heads/main/scripts/install.sh | bashリリースページから最新のリリースをダウンロードし、パス内のディレクトリにバイナリを抽出します。

Eg zip -d gollama*.zip -d gollama && mv gollama /usr/local/bin

gollamaアプリケーションを実行するには、次のコマンドを使用します。

gollamaヒント:Quick AccessのためにGollamaからgにエイリアスするのが好きです:

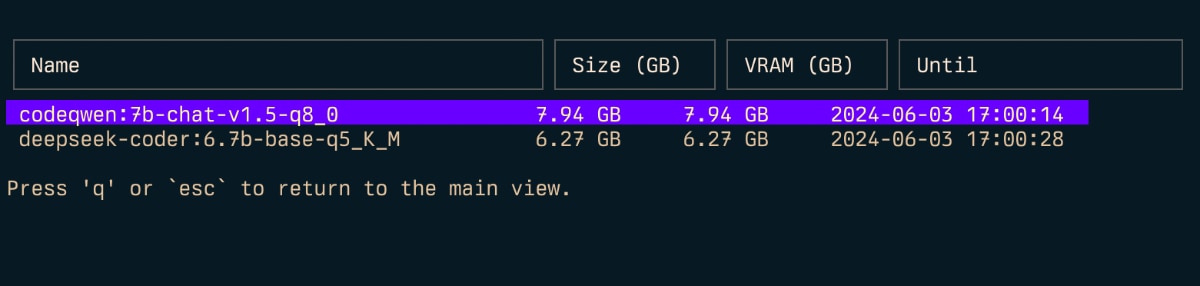

echo " alias g=gollama " >> ~ /.zshrcSpace :選択Enter :Run Model(Ollama Run)i :モデルを検査しますt :トップ(実行中のモデルを表示)D :モデルを削除しますe :モデル編集新しい編集c :モデルをコピーしますU :すべてのモデルをアンロードしますp :既存のモデルを新しく引いてくださいg :新しいモデルをプル(取得)新しいモデルP :プッシュモデルn :名前でソートしますs :サイズごとにソートしますm :変更されたソートk :量子化によるソートf :家族ごとに並べ替えますl :LMスタジオへのリンクモデルL :すべてのモデルをLMスタジオにリンクしますr :モデルを変更する(進行中の作業)q :終了しますトップ( t )

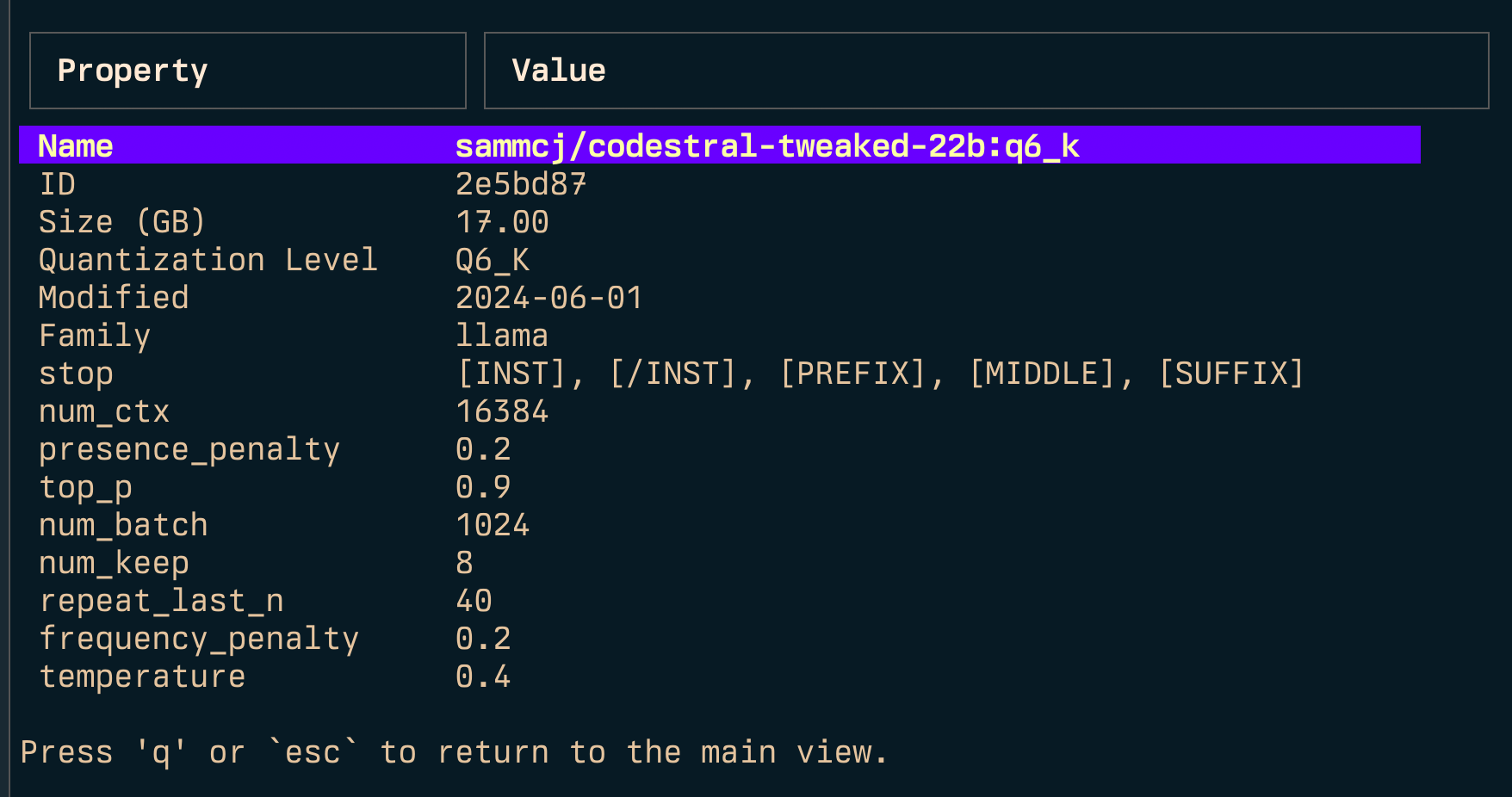

検査( i )

リンク( l )とリンクすべて( L )

注:Windowsを実行している場合は、管理権が必要です。

-l :利用可能なすべてのオラマモデルをリストし、終了します-L :利用可能なすべてのオラマモデルをLMスタジオにリンクして出口-s <search term> :名前でモデルを検索します'term1|term2' )は、いずれかの用語に一致するモデルを返します'term1&term2' )は、両方の用語に一致するモデルを返します-e <model> :モデルのModelfileを編集します-ollama-dir :カスタムオラマモデルディレクトリ-lm-dir :カスタムLM Studio Modelsディレクトリ-cleanup :すべてのシンプルリンクされたモデルと空のディレクトリを削除して終了します-no-cleanup :壊れたシンリンクをクリーンアップしないでください-u :すべての実行モデルをアンロードします-v :バージョンを印刷して終了します-h 、または--host :ollama apiのホストを指定します-H : -h http://localhost:11434のショートカット(ローカルオラマAPIに接続) new--vram :モデルのVRAM使用量を推定します。受け入れる:llama3.1:8b-instruct-q6_K 、 qwen2:14b-q4_0 )NousResearch/Hermes-2-Theta-Llama-3-8B )--fits :コンテキスト計算のためにGBで利用可能なメモリ(6GBの場合は6 )--vram-to-nthまたは--context :分析する最大コンテキストの長さ(例: 32kまたは128k )--quant :量子化レベルをオーバーライドする( Q4_0 、 Q5_K_Mなど) ゴラマは、TUIなしでモデルをリストするために-lで呼び出すこともできます。

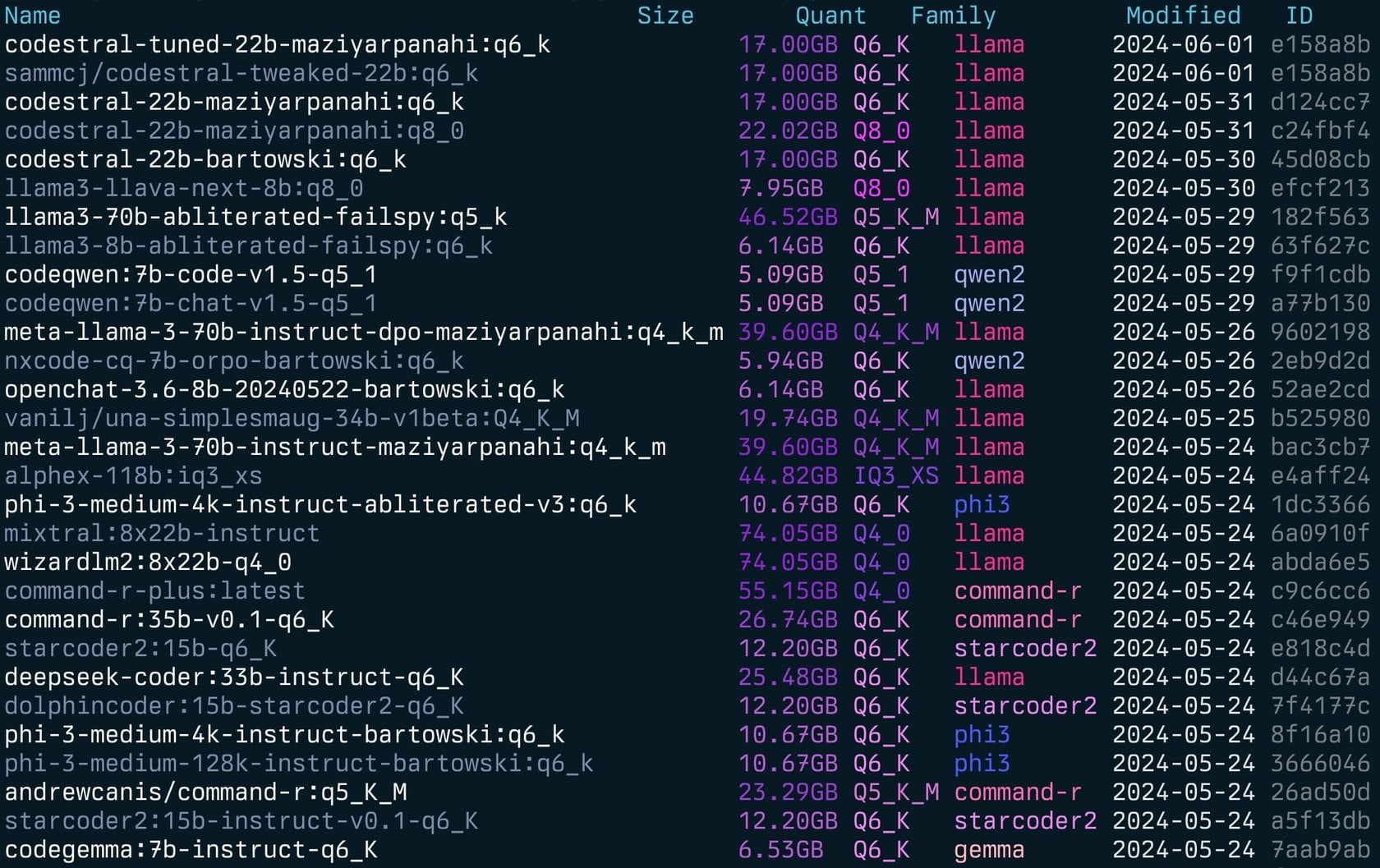

gollama -lリスト( gollama -l ):

Gollamaを-eで呼び出して、モデルのModelfileを編集できます。

gollama -e my-modelGollamaは-sで呼び出して、名前でモデルを検索できます。

gollama -s my-model # returns models that contain 'my-model'

gollama -s ' my-model|my-other-model ' # returns models that contain either 'my-model' or 'my-other-model'

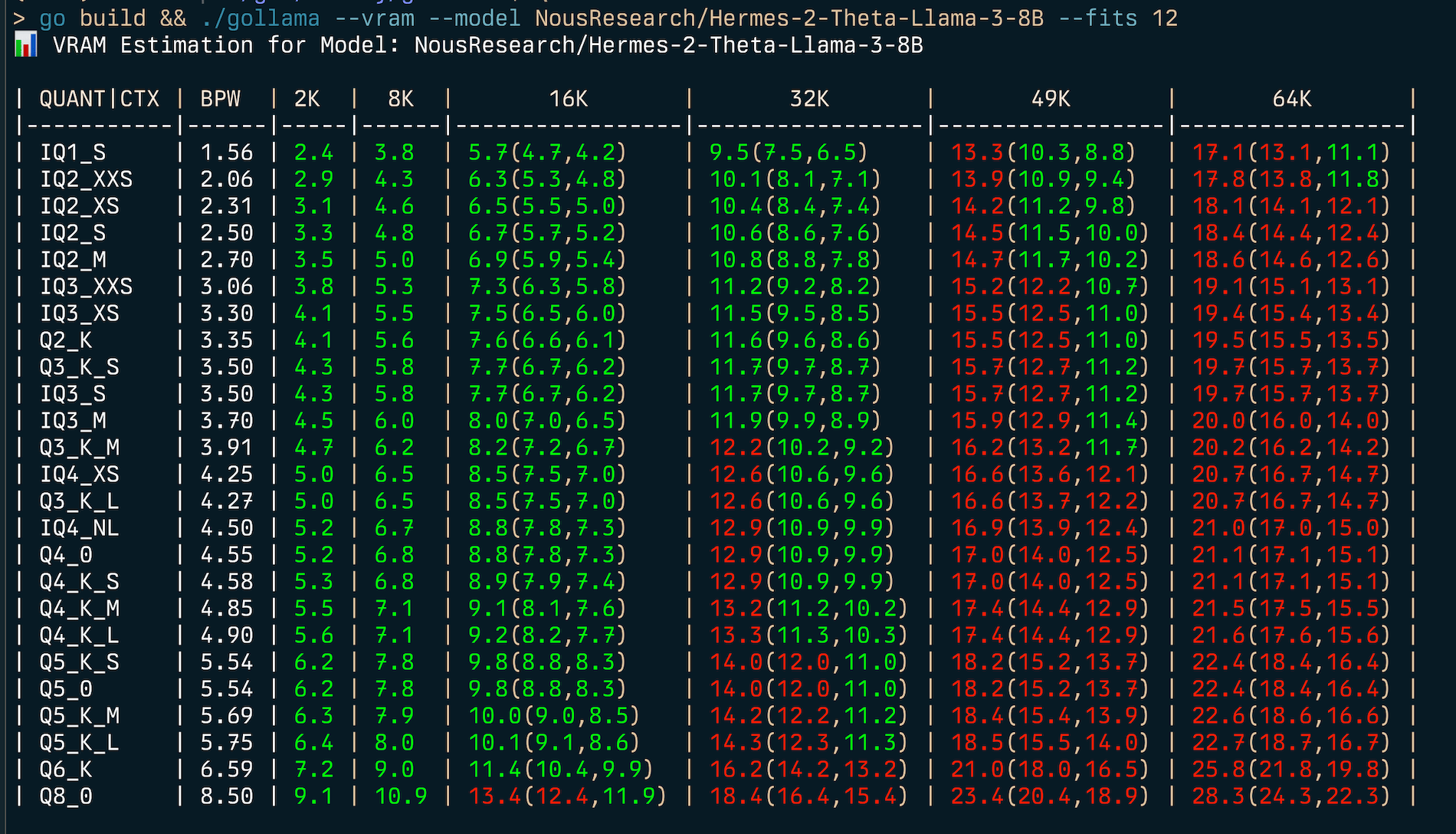

gollama -s ' my-model&instruct ' # returns models that contain both 'my-model' and 'instruct' ゴラマには、包括的なVRAM推定機能が含まれています。

my-model:mytagなど)のVRAM使用量を計算するか、HuggingfaceモデルID( author/nameなど)

(v)RAMの使用を推定するには:

gollama --vram llama3.1:8b-instruct-q6_K

VRAM Estimation for Model: llama3.1:8b-instruct-q6_K

| QUANT | CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| ------- | ---- | --- | --- | --------------- | --------------- | --------------- | --------------- |

| IQ1_S | 1.56 | 2.2 | 2.8 | 3.7(3.7,3.7) | 5.5(5.5,5.5) | 7.3(7.3,7.3) | 9.1(9.1,9.1) |

| IQ2_XXS | 2.06 | 2.6 | 3.3 | 4.3(4.3,4.3) | 6.1(6.1,6.1) | 7.9(7.9,7.9) | 9.8(9.8,9.8) |

| IQ2_XS | 2.31 | 2.9 | 3.6 | 4.5(4.5,4.5) | 6.4(6.4,6.4) | 8.2(8.2,8.2) | 10.1(10.1,10.1) |

| IQ2_S | 2.50 | 3.1 | 3.8 | 4.7(4.7,4.7) | 6.6(6.6,6.6) | 8.5(8.5,8.5) | 10.4(10.4,10.4) |

| IQ2_M | 2.70 | 3.2 | 4.0 | 4.9(4.9,4.9) | 6.8(6.8,6.8) | 8.7(8.7,8.7) | 10.6(10.6,10.6) |

| IQ3_XXS | 3.06 | 3.6 | 4.3 | 5.3(5.3,5.3) | 7.2(7.2,7.2) | 9.2(9.2,9.2) | 11.1(11.1,11.1) |

| IQ3_XS | 3.30 | 3.8 | 4.5 | 5.5(5.5,5.5) | 7.5(7.5,7.5) | 9.5(9.5,9.5) | 11.4(11.4,11.4) |

| Q2_K | 3.35 | 3.9 | 4.6 | 5.6(5.6,5.6) | 7.6(7.6,7.6) | 9.5(9.5,9.5) | 11.5(11.5,11.5) |

| Q3_K_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_S | 3.50 | 4.0 | 4.8 | 5.7(5.7,5.7) | 7.7(7.7,7.7) | 9.7(9.7,9.7) | 11.7(11.7,11.7) |

| IQ3_M | 3.70 | 4.2 | 5.0 | 6.0(6.0,6.0) | 8.0(8.0,8.0) | 9.9(9.9,9.9) | 12.0(12.0,12.0) |

| Q3_K_M | 3.91 | 4.4 | 5.2 | 6.2(6.2,6.2) | 8.2(8.2,8.2) | 10.2(10.2,10.2) | 12.2(12.2,12.2) |

| IQ4_XS | 4.25 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.6(10.6,10.6) | 12.7(12.7,12.7) |

| Q3_K_L | 4.27 | 4.7 | 5.5 | 6.5(6.5,6.5) | 8.6(8.6,8.6) | 10.7(10.7,10.7) | 12.7(12.7,12.7) |

| IQ4_NL | 4.50 | 5.0 | 5.7 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 10.9(10.9,10.9) | 13.0(13.0,13.0) |

| Q4_0 | 4.55 | 5.0 | 5.8 | 6.8(6.8,6.8) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_S | 4.58 | 5.0 | 5.8 | 6.9(6.9,6.9) | 8.9(8.9,8.9) | 11.0(11.0,11.0) | 13.1(13.1,13.1) |

| Q4_K_M | 4.85 | 5.3 | 6.1 | 7.1(7.1,7.1) | 9.2(9.2,9.2) | 11.4(11.4,11.4) | 13.5(13.5,13.5) |

| Q4_K_L | 4.90 | 5.3 | 6.1 | 7.2(7.2,7.2) | 9.3(9.3,9.3) | 11.4(11.4,11.4) | 13.6(13.6,13.6) |

| Q5_K_S | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_0 | 5.54 | 5.9 | 6.8 | 7.8(7.8,7.8) | 10.0(10.0,10.0) | 12.2(12.2,12.2) | 14.4(14.4,14.4) |

| Q5_K_M | 5.69 | 6.1 | 6.9 | 8.0(8.0,8.0) | 10.2(10.2,10.2) | 12.4(12.4,12.4) | 14.6(14.6,14.6) |

| Q5_K_L | 5.75 | 6.1 | 7.0 | 8.1(8.1,8.1) | 10.3(10.3,10.3) | 12.5(12.5,12.5) | 14.7(14.7,14.7) |

| Q6_K | 6.59 | 7.0 | 8.0 | 9.4(9.4,9.4) | 12.2(12.2,12.2) | 15.0(15.0,15.0) | 17.8(17.8,17.8) |

| Q8_0 | 8.50 | 8.8 | 9.9 | 11.4(11.4,11.4) | 14.4(14.4,14.4) | 17.4(17.4,17.4) | 20.3(20.3,20.3) |特定のメモリの制約に最適な量子化タイプ(6GBなど)を見つけるには--fits <number of GB>を提供できます。

gollama --vram NousResearch/Hermes-2-Theta-Llama-3-8B --fits 6

VRAM Estimation for Model: NousResearch/Hermes-2-Theta-Llama-3-8B

| QUANT/CTX | BPW | 2K | 8K | 16K | 32K | 49K | 64K |

| --------- | ---- | --- | --- | ------------ | ------------- | -------------- | --------------- |

| IQ1_S | 1.56 | 2.4 | 3.8 | 5.7(4.7,4.2) | 9.5(7.5,6.5) | 13.3(10.3,8.8) | 17.1(13.1,11.1) |

| IQ2_XXS | 2.06 | 2.9 | 4.3 | 6.3(5.3,4.8) | 10.1(8.1,7.1) | 13.9(10.9,9.4) | 17.8(13.8,11.8) |

...これにより、さまざまな量子化タイプとコンテキストサイズのVRAM使用法を示すテーブルが表示されます。

VRAM推定器は次のように機能します。

注:推定器は、利用可能な場合はCUDA VRAMを使用しようとします。そうしないと、計算のためにシステムRAMに戻ります。

Gollamaは~/.config/gollama/config.jsonにあるJSON構成ファイルを使用しています。構成ファイルには、ソート、列、APIキー、ログレベルなどのオプションが含まれています...

構成の例:

{

"default_sort" : " modified " ,

"columns" : [

" Name " ,

" Size " ,

" Quant " ,

" Family " ,

" Modified " ,

" ID "

],

"ollama_api_key" : " " ,

"ollama_api_url" : " http://localhost:11434 " ,

"lm_studio_file_paths" : " " ,

"log_level" : " info " ,

"log_file_path" : " /Users/username/.config/gollama/gollama.log " ,

"sort_order" : " Size " ,

"strip_string" : " my-private-registry.internal/ " ,

"editor" : " " ,

"docker_container" : " "

}strip_string使用して、TUIに表示されるモデル名からプレフィックスを削除できます。これは、表示目的で削除するプライベートレジストリなどの一般的なプレフィックスがある場合に役立ちます。docker_container実験- セットの場合、ゴラマは指定されたコンテナ内で実行操作を実行しようとします。editor -実験- セットの場合、Gollamaはこのエディターを使用して編集のためにModelfileを開きます。 リポジトリをクローンします:

git clone https://github.com/sammcj/gollama.git

cd gollama建てる:

go get

make build走る:

./gollamaログは$HOME/.config/gollama/gollama.logに保存されているgollama.logにあります。ログレベルは、構成ファイルで設定できます。

貢献は大歓迎です!リポジトリをフォークして、変更を使用してプルリクエストを作成してください。

サム | ホセ・アルマラズ | ホセ・ロベルト・アルマラズ | Oleksii Filonenko | サウスウルフ | anrgct |

マット・ウィリアムズ、ファフ・ミルザ、AIコード・キングなどの人々に、これをショットとフィードバックを提供してくれてありがとう。

Copyright©2024 Sam McLeod

このプロジェクトは、MITライセンスの下でライセンスされています。詳細については、ライセンスファイルを参照してください。

<スクリプトsrc = "http://api.html5media.info/1.8/html5media.min.js"> </script>