เมื่อวันที่ 21 กุมภาพันธ์ 2568 ทีมงานสากลของอาลีบาบาได้ประกาศอย่างเป็นทางการว่าเป็นแหล่งโอเพ่นซอร์สของซีรี่ส์ Ovis2 รุ่นใหญ่หลายรูปแบบล่าสุด การเคลื่อนไหวครั้งสำคัญนี้นับเป็นความก้าวหน้าของอาลีบาบาในด้านปัญญาประดิษฐ์และยังให้เครื่องมือทางเทคนิคที่ทรงพลังแก่นักพัฒนาทั่วโลกเพื่อส่งเสริมการพัฒนาและการประยุกต์ใช้โมเดลขนาดใหญ่หลายรูปแบบ

Ovis2 เป็นรุ่นล่าสุดของรุ่น OVIS Series ของทีมงานนานาชาติของอาลีบาบา ไม่เพียง แต่ช่วยเพิ่มความหนาแน่นของความสามารถของแบบจำลองขนาดเล็กเท่านั้น แต่ยังช่วยเพิ่มความสามารถในการใช้เหตุผลในการคิด (COT) อย่างมากผ่านการเรียนการสอนการปรับแต่งและการเรียนรู้การตั้งค่า นอกจากนี้ OVIS2 ได้เพิ่มฟังก์ชั่นการประมวลผลวิดีโอและหลายภาพและมีความคืบหน้าอย่างมีนัยสำคัญในความสามารถในการพูดได้หลายภาษาและความสามารถของ OCR ในสถานการณ์ที่ซับซ้อนเพื่อปรับปรุงความสามารถในการปฏิบัติจริงและความสามารถทั่วไปของแบบจำลอง

ซีรีย์โอเพนซอร์ส Ovis2 ในเวลานี้มีหกเวอร์ชัน: 1B, 2B, 4B, 8B, 16B และ 34B แต่ละรุ่นถึงระดับ SOTA (สถานะของศิลปะ) ขนาดเดียวกัน ในหมู่พวกเขา OVIS2-34B ทำงานได้ดีโดยเฉพาะอย่างยิ่งในรายการการประเมินที่เชื่อถือได้ openCompass ในรายการความสามารถทั่วไปหลายรูปแบบ OVIS2-34B อยู่ในอันดับที่สองในทุกรุ่นโอเพนซอร์สซึ่งมีมากกว่ารุ่นโอเพนซอร์ส 70B หลายรุ่นที่มีขนาดพารามิเตอร์น้อยกว่าครึ่งหนึ่ง ในรายการการใช้เหตุผลทางคณิตศาสตร์หลายรูปแบบ OVIS2-34B อยู่ในอันดับแรกและรุ่นขนาดอื่น ๆ ก็แสดงทักษะการใช้เหตุผลที่ยอดเยี่ยม ความสำเร็จเหล่านี้ไม่เพียง แต่ตรวจสอบประสิทธิภาพของสถาปัตยกรรม OVIS แต่ยังแสดงให้เห็นถึงศักยภาพที่ยิ่งใหญ่ของชุมชนโอเพนซอร์สในการส่งเสริมการพัฒนาแบบจำลองขนาดใหญ่หลายรูปแบบ

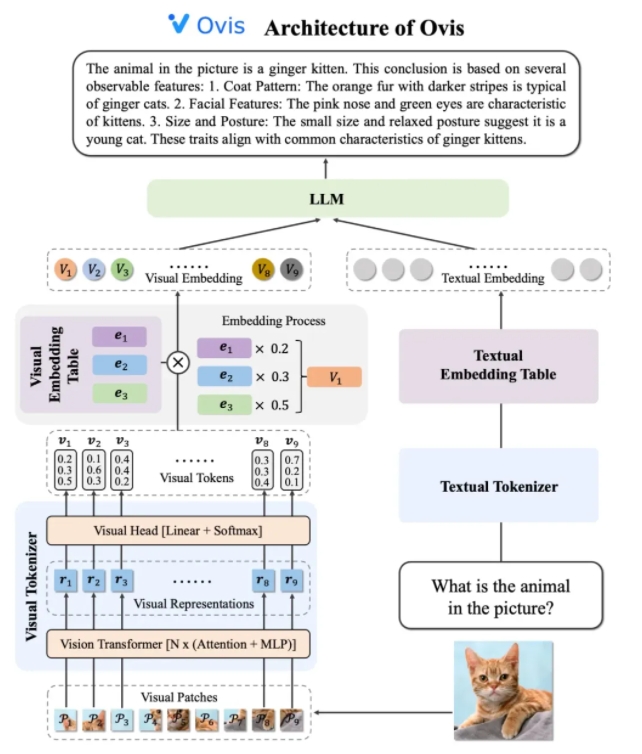

การออกแบบสถาปัตยกรรมของ Ovis2 แก้ข้อ จำกัด ของความแตกต่างในกลยุทธ์การฝังอย่างชาญฉลาดระหว่าง Modals ประกอบด้วยองค์ประกอบหลักสามประการ: Tokenizer Visual, ตารางการฝังภาพและ LLM (แบบจำลองภาษาขนาดใหญ่) Tokenizer Visual แบ่งภาพอินพุตออกเป็นหลายบล็อกภาพใช้หม้อแปลงภาพเพื่อแยกคุณสมบัติและจับคู่คุณสมบัติกับ "คำศัพท์" ผ่านเลเยอร์หัวภาพเพื่อสร้างโทเค็นภาพความน่าจะเป็น ตารางการฝังภาพจะเก็บเวกเตอร์การฝังที่สอดคล้องกับคำภาพแต่ละคำในขณะที่ LLM splices เวกเตอร์ฝังภาพและเวกเตอร์ฝังข้อความสำหรับการประมวลผลและในที่สุดก็สร้างเอาต์พุตข้อความเพื่อให้งานหลายรูปแบบ

ในแง่ของกลยุทธ์การฝึกอบรม OVIS2 ใช้วิธีการฝึกอบรมสี่ขั้นตอนเพื่อกระตุ้นความสามารถในการทำความเข้าใจหลายรูปแบบ ขั้นตอนแรกหยุดพารามิเตอร์ LLM และ VIT (Visual Transformer) ส่วนใหญ่โดยมุ่งเน้นไปที่โมดูลการมองเห็นการฝึกอบรมการเรียนรู้คุณสมบัติด้านภาพเพื่อฝังการเปลี่ยนแปลง ขั้นตอนที่สองจะช่วยเพิ่มความสามารถในการสกัดคุณลักษณะของโมดูลภาพและเพิ่มความสามารถในการทำความเข้าใจภาพความละเอียดสูงความสามารถในการพูดได้หลายภาษาและ OCR ขั้นตอนที่สามจัดรูปแบบการสนทนาของการฝังภาพด้วย LLM ผ่านข้อมูลคำบรรยายภาพในรูปแบบของบทสนทนา ขั้นตอนที่สี่คือการดำเนินการฝึกอบรมการเรียนการสอนแบบหลายรูปแบบและการเรียนรู้การตั้งค่าเพื่อปรับปรุงความสามารถของโมเดลในการปฏิบัติตามคำแนะนำของผู้ใช้และคุณภาพเอาต์พุตภายใต้หลายโหมด

เพื่อปรับปรุงความสามารถในการเข้าใจวิดีโอ OVIS2 ได้พัฒนาอัลกอริทึมการเลือกคีย์เฟรมที่เป็นนวัตกรรม อัลกอริทึมเลือกเฟรมวิดีโอที่มีประโยชน์มากที่สุดตามความสัมพันธ์ระหว่างเฟรมและข้อความความหลากหลายของการรวมกันระหว่างเฟรมและลำดับของเฟรม ผ่านการคำนวณความคล้ายคลึงกันตามเงื่อนไขมิติสูงกระบวนการกำหนดจุด (DPP) และกระบวนการตัดสินใจของมาร์คอฟ (MDP) อัลกอริทึมสามารถเลือก keyframes ได้อย่างมีประสิทธิภาพในบริบทการมองเห็นที่ จำกัด ซึ่งจะช่วยปรับปรุงประสิทธิภาพของความเข้าใจวิดีโออย่างมีนัยสำคัญ

โมเดล OVIS2 Series ทำงานได้ดีโดยเฉพาะในรายการการประเมินผลหลายรูปแบบ openCompass แบบจำลองขนาดที่แตกต่างกันได้รับผลลัพธ์ SOTA ในการวัดจำนวนหลายอย่าง ตัวอย่างเช่น OVIS2-34B อยู่ในอันดับที่สองและครั้งแรกในความสามารถทั่วไปทั่วไปและรายการเหตุผลทางคณิตศาสตร์ตามลำดับแสดงประสิทธิภาพที่ทรงพลัง นอกจากนี้ OVIS2 ยังได้รับผลลัพธ์ชั้นนำในรายการความเข้าใจวิดีโอซึ่งพิสูจน์ได้ว่าข้อดีในงานหลายรูปแบบ

ทีมงานสากลของอาลีบาบากล่าวว่าโอเพ่นซอร์สเป็นกำลังสำคัญในการส่งเสริมความคืบหน้าของเทคโนโลยี AI ด้วยการแบ่งปันผลการวิจัยของ Ovis2 อย่างเปิดเผยทีมต่างรอคอยที่จะสำรวจโมเดลขนาดใหญ่หลายรูปแบบที่ทันสมัยกับนักพัฒนาทั่วโลกและสร้างแรงบันดาลใจให้กับแอพพลิเคชั่นที่เป็นนวัตกรรมมากขึ้น ปัจจุบันรหัสของ Ovis2 ได้รับการเปิดให้กับ GitHub และสามารถรับโมเดลบนแพลตฟอร์ม Hugging Face และ Models -Cope และการสาธิตออนไลน์ได้รับสำหรับประสบการณ์ผู้ใช้ เอกสารการวิจัยที่เกี่ยวข้องยังได้รับการตีพิมพ์ใน ARXIV สำหรับการอ้างอิงโดยนักพัฒนาและนักวิจัย

รหัส: https://github.com/aidc-ai/ovis

โมเดล (huggingface): https://huggingface.co/aidc-ai/ovis2-34b

รุ่น: https://modelscope.cn/collections/ovis2-1e2840cb4f7d45

การสาธิต: https://huggingface.co/spaces/aidc-ai/ovis2-16b

arxiv: https: //arxiv.org/abs/2405.20797