บรรณาธิการของ Downcodes ได้เรียนรู้ว่าทีมวิจัยจาก Shanghai Jiao Tong University และ Harvard University ได้เปิดตัววิธีการปรับแต่งโมเดลใหม่ที่เรียกว่า LoRA-Dash วิธีการนี้ยังคงสามารถบรรลุผลการปรับแต่งแบบละเอียดเช่นเดียวกับวิธี LoRA ที่มีอยู่ แม้ว่าจำนวนพารามิเตอร์จะลดลง 8 ถึง 16 เท่า ซึ่งนำความก้าวหน้าที่ก้าวล้ำมาสู่งานการปรับแต่งอย่างละเอียดด้วยทรัพยากรการประมวลผลที่จำกัด แกนหลักของ LoRA-Dash อยู่ที่คำจำกัดความที่เข้มงวดและการใช้ประโยชน์ของ "ทิศทางเฉพาะของงาน" (TSD) ผ่านสองขั้นตอนของ "ก่อนการเปิดตัว" และ "การวิ่ง" TSD จะได้รับการระบุและนำไปใช้อย่างมีประสิทธิภาพเพื่อการปรับโมเดลให้เหมาะสม สิ่งนี้จะช่วยปรับปรุงประสิทธิภาพของการปรับแต่งแบบจำลองได้อย่างมากอย่างไม่ต้องสงสัย และให้การสนับสนุนอย่างมากสำหรับการวิจัยที่เกี่ยวข้อง

เมื่อเร็วๆ นี้ ทีมวิจัยจากมหาวิทยาลัย Shanghai Jiao Tong และมหาวิทยาลัยฮาร์วาร์ด ได้เปิดตัว LoRA-Dash ซึ่งเป็นวิธีการปรับแต่งโมเดลใหม่ วิธีการใหม่นี้อ้างว่ามีประสิทธิภาพมากกว่าวิธี LoRA ที่มีอยู่ โดยเฉพาะอย่างยิ่งในการปรับแต่งอย่างละเอียดสำหรับงานเฉพาะเจาะจง โดยสามารถบรรลุผลเช่นเดียวกันในขณะที่ลดจำนวนพารามิเตอร์ลง 8 ถึง 16 เท่า ไม่ต้องสงสัยเลยว่านี่คือความก้าวหน้าครั้งสำคัญสำหรับการปรับแต่งงานที่ต้องใช้ทรัพยากรการประมวลผลจำนวนมาก

ในบริบทของการพัฒนาอย่างรวดเร็วของแบบจำลองภาษาขนาดใหญ่ มีความจำเป็นเพิ่มขึ้นในการปรับแต่งงานเฉพาะเจาะจง อย่างไรก็ตาม การปรับแต่งอย่างละเอียดมักจะใช้ทรัพยากรการประมวลผลจำนวนมาก เพื่อที่จะแก้ไขปัญหานี้ ทีมวิจัยได้แนะนำกลยุทธ์การปรับพารามิเตอร์ที่มีประสิทธิภาพ (PEFT) และ LoRA ก็เป็นตัวอย่างทั่วไป จากการทดลองพบว่า LoRA บรรลุผลการปรับแต่งอย่างละเอียดเป็นหลักโดยการรวบรวมคุณลักษณะบางอย่างที่ได้เรียนรู้ในการฝึกอบรมล่วงหน้าและขยายผล

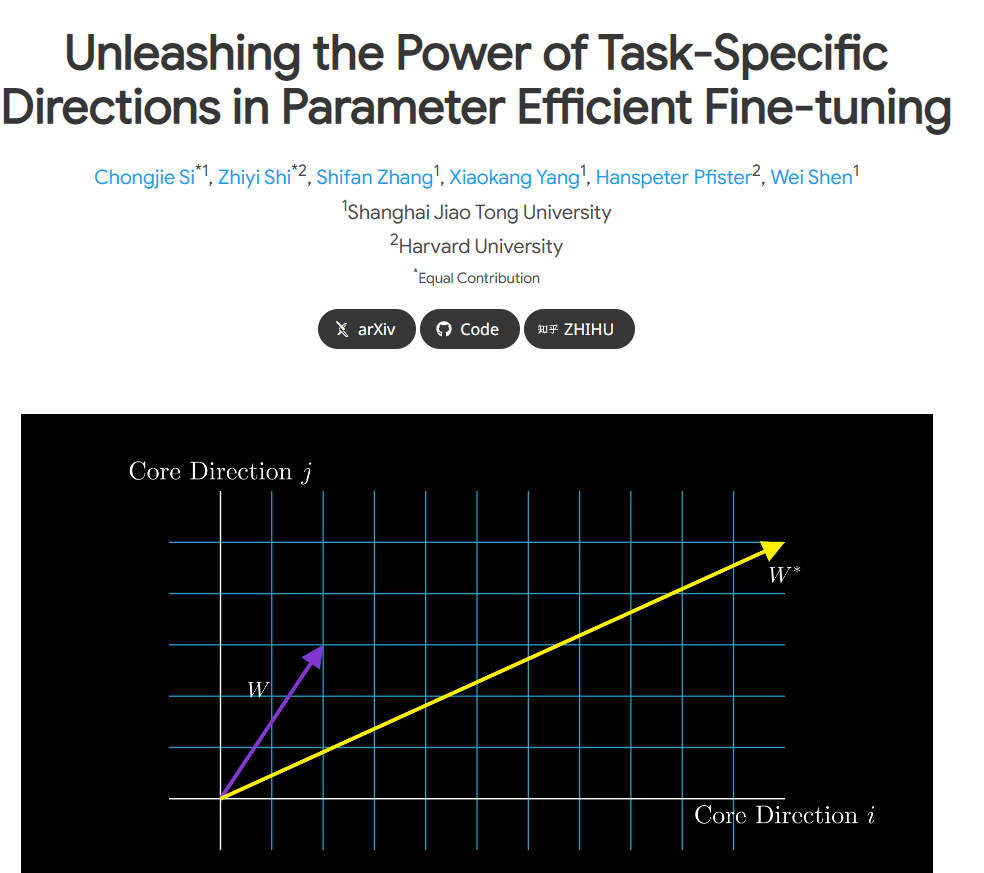

อย่างไรก็ตาม เอกสาร LoRA ต้นฉบับมีความคลุมเครือบางประการในคำจำกัดความของ "ทิศทางเฉพาะงาน" (TSD) ทีมวิจัยได้ทำการวิเคราะห์เชิงลึก กำหนด TSD อย่างเข้มงวดเป็นครั้งแรก และชี้แจงลักษณะของมัน TSD แสดงถึงทิศทางหลักของการเปลี่ยนแปลงที่สำคัญในพารามิเตอร์โมเดลระหว่างการปรับแต่งแบบละเอียด

เพื่อปลดปล่อยศักยภาพของ TSD ในการใช้งานจริง นักวิจัยได้เสนอ LoRA-Dash ซึ่งเป็นวิธีการที่ประกอบด้วยสองขั้นตอนสำคัญ ขั้นแรกคือ "ระยะก่อนเริ่มต้น" เมื่อจำเป็นต้องระบุทิศทางเฉพาะของงาน ขั้นตอนที่สองคือ "ระยะวิ่ง" ซึ่งจะใช้ทิศทางที่ระบุไว้ก่อนหน้านี้เพื่อปรับให้เหมาะสมและปรับแบบจำลองให้เหมาะสมยิ่งขึ้น เพื่องานเฉพาะ

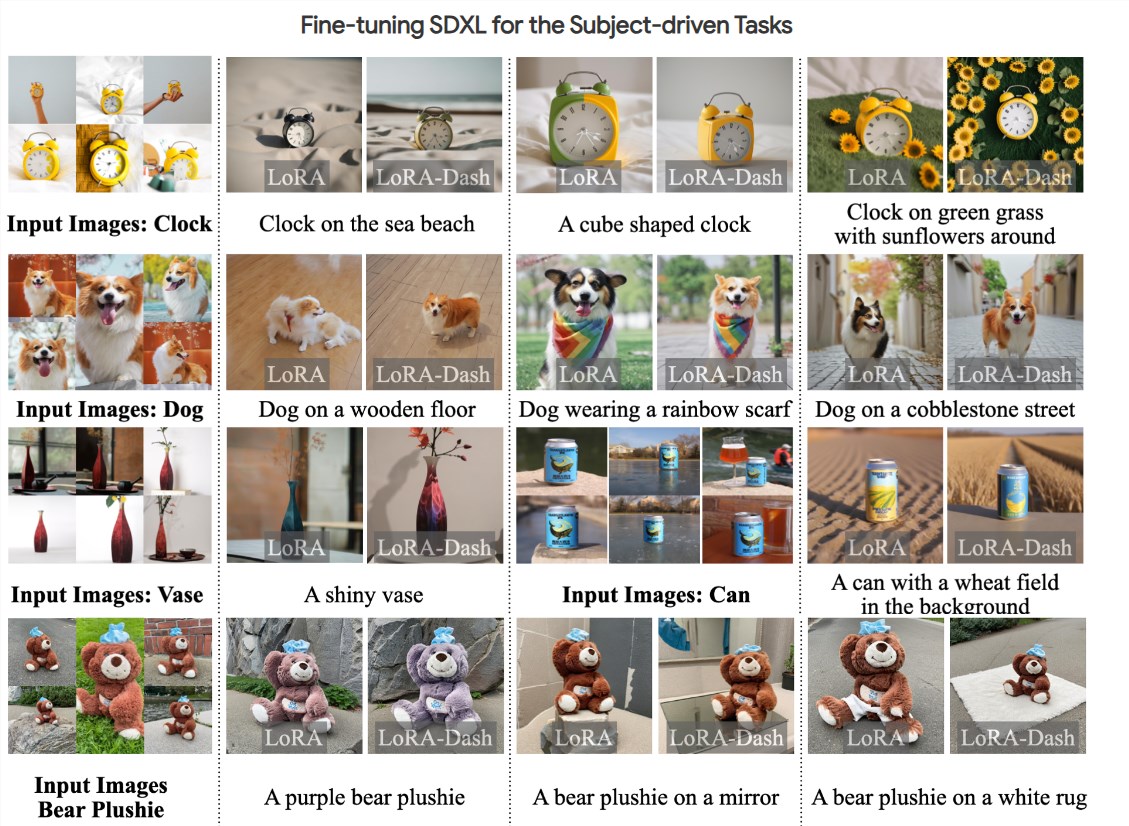

การทดลองแสดงให้เห็นว่า LoRA-Dash เหนือกว่าประสิทธิภาพของ LoRA ในงานหลายอย่าง เช่น การบรรลุการปรับปรุงประสิทธิภาพที่สำคัญในงานต่างๆ เช่น การใช้เหตุผลสามัญสำนึก ความเข้าใจภาษาธรรมชาติ และการสร้างที่ขับเคลื่อนด้วยตัวแทน ผลลัพธ์นี้แสดงให้เห็นถึงประสิทธิภาพของ TSD ในงานดาวน์สตรีม และปลดปล่อยศักยภาพของการปรับแต่งอย่างละเอียดอย่างมีประสิทธิภาพ

ปัจจุบันมีการเปิดเผยงานวิจัยที่เกี่ยวข้องและโค้ดดังกล่าวเป็นโอเพ่นซอร์ส ทีมวิจัยหวังว่าจะให้การสนับสนุนนักวิจัยและนักพัฒนามากขึ้น เพื่อให้ทุกคนมีประสิทธิภาพมากขึ้นในกระบวนการปรับแต่งโมเดลอย่างละเอียด

ทางเข้าโครงการ: https://chongjiesi.site/project/2024-lora-dash.html

** จุดเด่น: **

**เปิดตัววิธีการ LoRA-Dash:** วิธีการปรับแต่งแบบใหม่ที่เรียกว่า LoRA-Dash เกิดขึ้นแล้ว เมื่อเปรียบเทียบกับ LoRA วิธีนี้มีประสิทธิภาพมากกว่าและต้องใช้พลังการประมวลผลน้อยกว่ามาก

** ชี้แจงทิศทางเฉพาะงาน:** ทีมวิจัยกำหนด "ทิศทางเฉพาะงาน" (TSD) อย่างเคร่งครัด และชี้แจงความสำคัญในกระบวนการปรับแต่งอย่างละเอียด

** ผลการทดลองที่โดดเด่น: ** การทดลองแสดงให้เห็นว่า LoRA-Dash มีประสิทธิภาพเหนือกว่า LoRA ในด้านการให้เหตุผลสามัญสำนึก ความเข้าใจภาษาธรรมชาติ และงานอื่นๆ ซึ่งแสดงให้เห็นถึงศักยภาพมหาศาลของการปรับแต่งอย่างละเอียดอย่างมีประสิทธิภาพ

การเกิดขึ้นของ LoRA-Dash ได้นำความหวังใหม่มาสู่การปรับแต่งโมเดลอย่างละเอียด ประสิทธิภาพสูงและการเข้าใจทิศทางงานเฉพาะอย่างแม่นยำ คาดว่าจะช่วยส่งเสริมการพัฒนาโมเดลการฝึกอบรม AI ในทิศทางที่มีประสิทธิภาพมากขึ้นและต้นทุนต่ำลง เราหวังเป็นอย่างยิ่งว่า LoRA-Dash จะสามารถแสดงให้เห็นถึงประสิทธิภาพที่เหนือกว่าในการใช้งานจริงมากขึ้นในอนาคต และมีส่วนร่วมในความก้าวหน้าของเทคโนโลยีปัญญาประดิษฐ์