Editor Downcodes mengetahui bahwa tim peneliti dari Universitas Shanghai Jiao Tong dan Universitas Harvard baru-baru ini meluncurkan metode penyesuaian model baru yang disebut LoRA-Dash. Metode ini masih dapat mencapai efek penyempurnaan yang sama seperti metode LoRA yang ada meskipun jumlah parameternya dikurangi 8 hingga 16 kali lipat, sehingga membawa kemajuan terobosan dalam menyempurnakan tugas-tugas dengan sumber daya komputasi yang terbatas. Inti dari LoRA-Dash terletak pada definisi ketat dan pemanfaatan "Arah Khusus Tugas" (TSD). Melalui dua tahap "pra-peluncuran" dan "sprint", TSD diidentifikasi dan digunakan secara efisien untuk pengoptimalan model. Hal ini tidak diragukan lagi akan sangat meningkatkan efisiensi penyesuaian model dan memberikan dukungan kuat untuk penelitian terkait.

Baru-baru ini, tim peneliti dari Universitas Shanghai Jiao Tong dan Universitas Harvard meluncurkan metode penyesuaian model baru-LoRA-Dash. Metode baru ini diklaim lebih efisien dibandingkan metode LoRA yang sudah ada, terutama dalam menyempurnakan tugas-tugas tertentu. Metode ini dapat mencapai efek yang sama sekaligus mengurangi jumlah parameter sebanyak 8 hingga 16 kali lipat. Tidak diragukan lagi, ini merupakan terobosan besar untuk menyempurnakan tugas-tugas yang memerlukan sumber daya komputasi dalam jumlah besar.

Dalam konteks pesatnya perkembangan model bahasa berskala besar, terdapat peningkatan kebutuhan untuk menyempurnakan tugas-tugas tertentu. Namun, penyesuaian sering kali menghabiskan banyak sumber daya komputasi. Untuk mengatasi masalah ini, tim peneliti memperkenalkan strategi penyesuaian parameter efisien (PEFT), dan LoRA adalah contohnya. Melalui eksperimen, ditemukan bahwa LoRA pada dasarnya mencapai efek penyesuaian dengan menangkap beberapa fitur yang telah dipelajari dalam pra-pelatihan dan memperkuatnya.

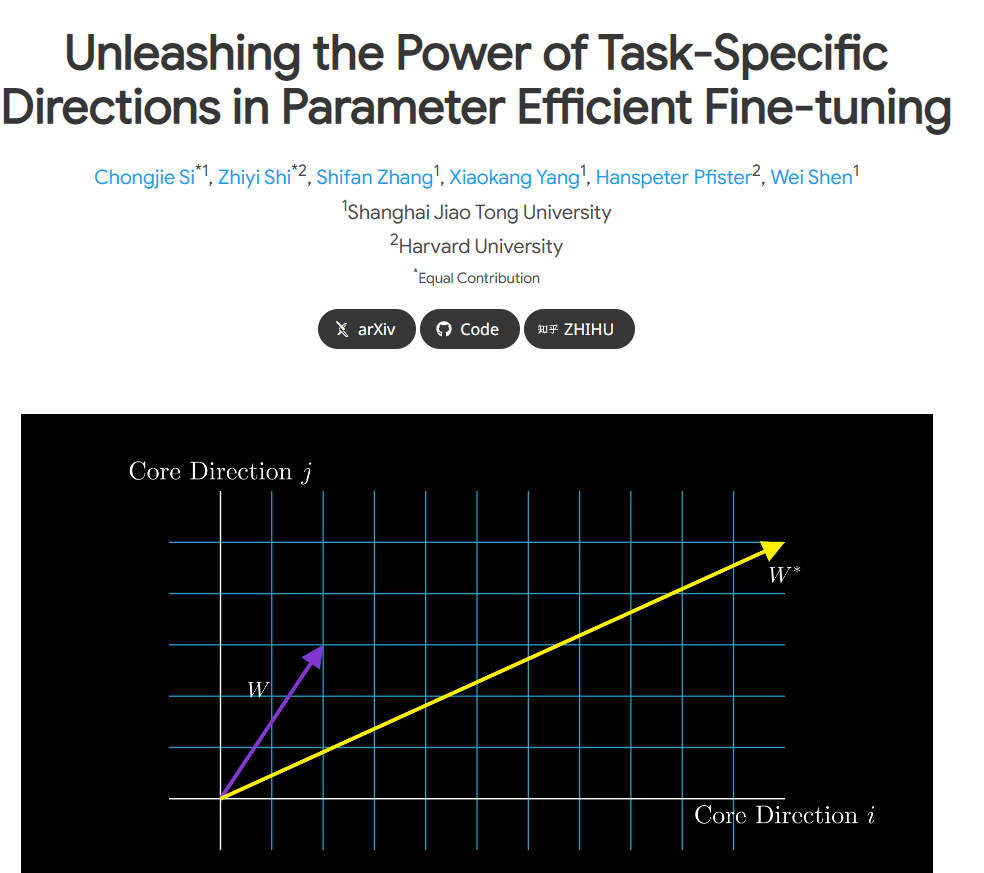

Namun, makalah asli LoRA memiliki beberapa ambiguitas dalam definisi "arahan tugas tertentu" (TSD). Tim peneliti melakukan analisis mendalam, mendefinisikan TSD secara ketat untuk pertama kalinya, dan mengklarifikasi sifatnya. TSD mewakili arah inti dari perubahan signifikan dalam parameter model selama penyesuaian.

Untuk mengeluarkan potensi TSD dalam aplikasi praktis, peneliti mengusulkan LoRA-Dash, sebuah metode yang terdiri dari dua tahap utama. Tahap pertama adalah "tahap pra-mulai", ketika arah spesifik tugas perlu diidentifikasi; tahap kedua adalah "tahap sprint", di mana arah yang telah diidentifikasi sebelumnya digunakan untuk mengoptimalkan dan menyesuaikan model agar dapat beradaptasi dengan lebih baik untuk tugas tertentu.

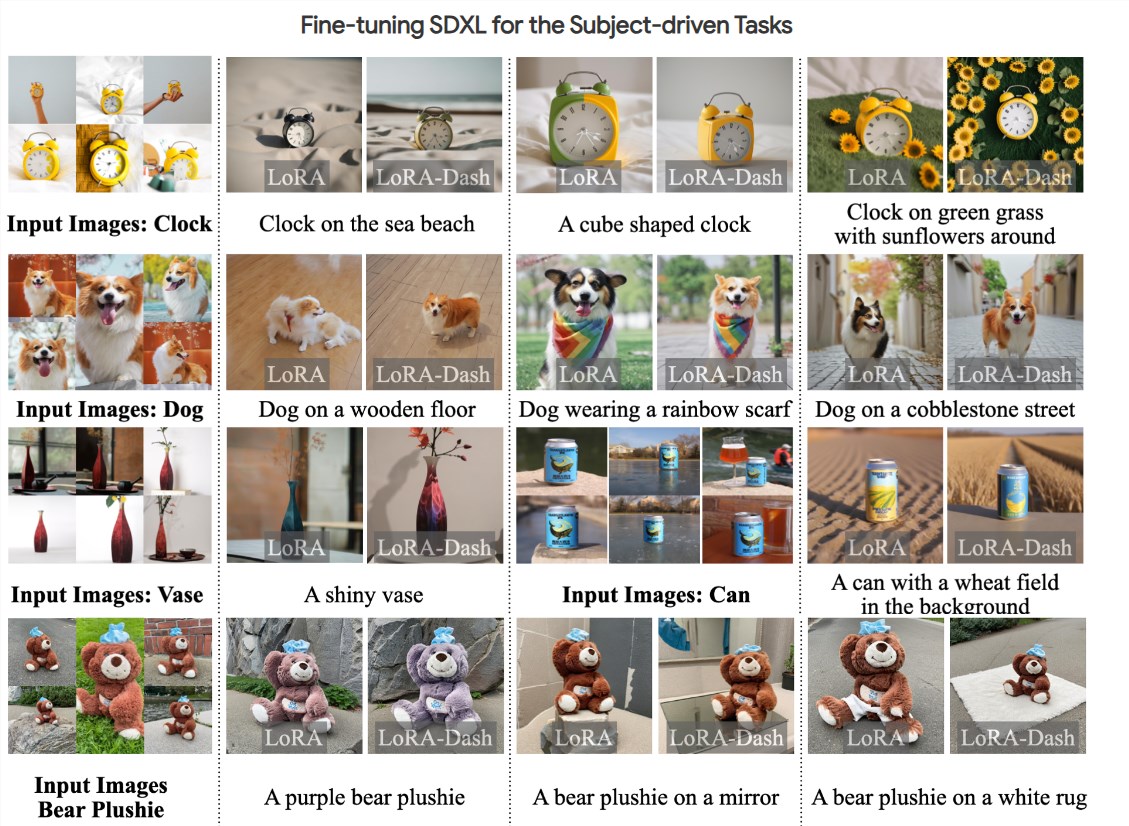

Eksperimen menunjukkan bahwa LoRA-Dash melampaui kinerja LoRA dalam berbagai tugas, seperti mencapai peningkatan kinerja yang signifikan dalam tugas-tugas seperti penalaran akal sehat, pemahaman bahasa alami, dan pembuatan berbasis agen. Hasil ini menunjukkan efektivitas TSD dalam tugas-tugas hilir dan sepenuhnya mengeluarkan potensi penyesuaian yang efisien.

Saat ini, makalah penelitian yang relevan telah dipublikasikan dan kodenya telah bersifat open source. Tim peneliti berharap dapat memberikan dukungan kepada lebih banyak peneliti dan pengembang sehingga semua orang dapat lebih efisien dalam proses penyempurnaan model.

Pintu masuk proyek: https://chongjiesi.site/project/2024-lora-dash.html

** Sorotan: **

**Metode LoRA-Dash diluncurkan:** Metode penyempurnaan model baru, LoRA-Dash, telah hadir. Dibandingkan dengan LoRA, metode ini lebih efisien dan memerlukan daya komputasi yang jauh lebih sedikit.

** Memperjelas arahan spesifik tugas:** Tim peneliti secara ketat mendefinisikan "arahan spesifik tugas" (TSD) dan mengklarifikasi pentingnya arah tersebut dalam proses penyesuaian.

** Hasil eksperimen yang penting: ** Eksperimen menunjukkan bahwa LoRA-Dash mengungguli LoRA dalam penalaran akal sehat, pemahaman bahasa alami, dan tugas lainnya, yang menunjukkan potensi besar dari penyesuaian yang efisien.

Kemunculan LoRA-Dash telah membawa harapan baru dalam bidang penyempurnaan model. Efisiensinya yang tinggi dan pemahaman yang tepat terhadap arah tugas tertentu diharapkan dapat mendorong pengembangan pelatihan model AI ke arah yang lebih efisien dan berbiaya rendah. Kami berharap LoRA-Dash dapat menunjukkan kinerja unggulnya dalam aplikasi yang lebih praktis di masa depan dan berkontribusi terhadap kemajuan teknologi kecerdasan buatan.