? ? Теперь Yolov5 был обновлен до версии 6.0, но его метод обучения такой же, как этот репо. Вам нужно только установить соответствующую среду Python в соответствии с соответствующей версией. Конструкция его набора данных, модификация файлов конфигурации, метод обучения и т. Д. Совершенно согласуется с этим репо!

? ? Мы предоставляем вызовы Yolov5 Tensorrt и квантованный C ++ и код Python Int8 (метод ускорения Tensorrt отличается от вызовов Tensorrt, предоставленных этим репо). Большие парни в «Нужных парнях» могут оставить сообщение в выпусках!

Сюй Цзин

Из-за корректировки основы и некоторых параметров официальной новой версии Yolo V5, многие друзья загрузили последнюю официальную предварительно обученную модель и недоступны. Здесь мы предоставляем адрес загрузки облачного диска Baidu оригинальной предварительно обученной модели Yolo V5.

Ссылка: https://pan.baidu.com/s/1sdwp6i_mnrlk45qdb3-ynw код извлечения: 423J

Yolov4 еще не утих, Yolov5 был выпущен!

9 июня UltraLytics открыла источник Yolov5, менее чем через 50 дней после выпуска последнего Yolov4. И на этот раз Yolov5 полностью реализован на основе Pytorch!

Основным участником YOLO V5 является автор улучшения данных мозаики, выделенного в Yolo V4

Этот проект описывает, как обучать YOLO V5 на основе вашего собственного набора данных

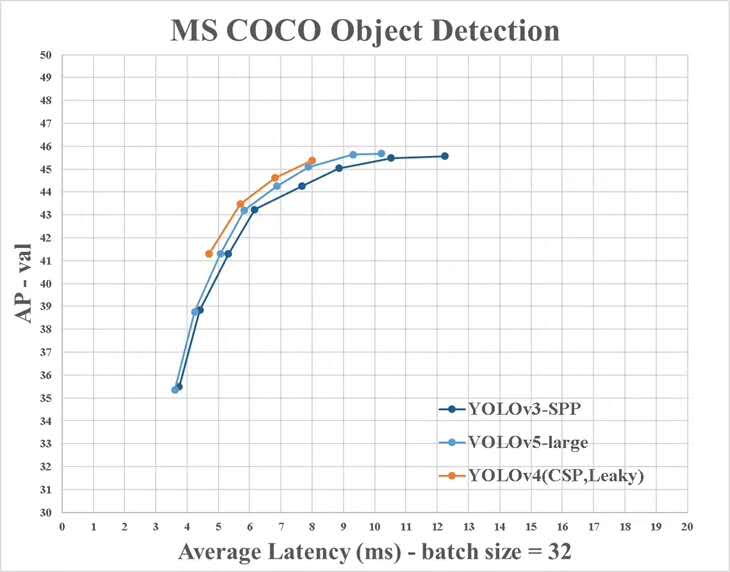

Тем не менее, есть некоторые различия между информацией, предоставленной Yolo V4 и официальными:

Установите необходимый пакет Python и настройте связанные среды

# python3.6

# torch==1.3.0

# torchvision==0.4.1

# git clone yolo v5 repo

git clone https://github.com/ultralytics/yolov5 # clone repo

# 下载官方的样例数据(这一步可以省略)

python3 -c "from yolov5.utils.google_utils import gdrive_download; gdrive_download('1n_oKgR81BJtqk75b00eAjdv03qVCQn2f','coco128.zip')" # download dataset

cd yolov5

# 安装必要的package

pip3 install -U -r requirements.txt

dataset.yaml файла конфигурации. YAML набора данных Data/Coco128.yaml происходит от первых 128 тренировочных изображений набора данных Coco Train2017. Вы можете изменить файл yaml вашего собственного набора данных на основе этого yaml

# train and val datasets (image directory or *.txt file with image paths)

train: ./datasets/score/images/train/

val: ./datasets/score/images/val/

# number of classes

nc: 3

# class names

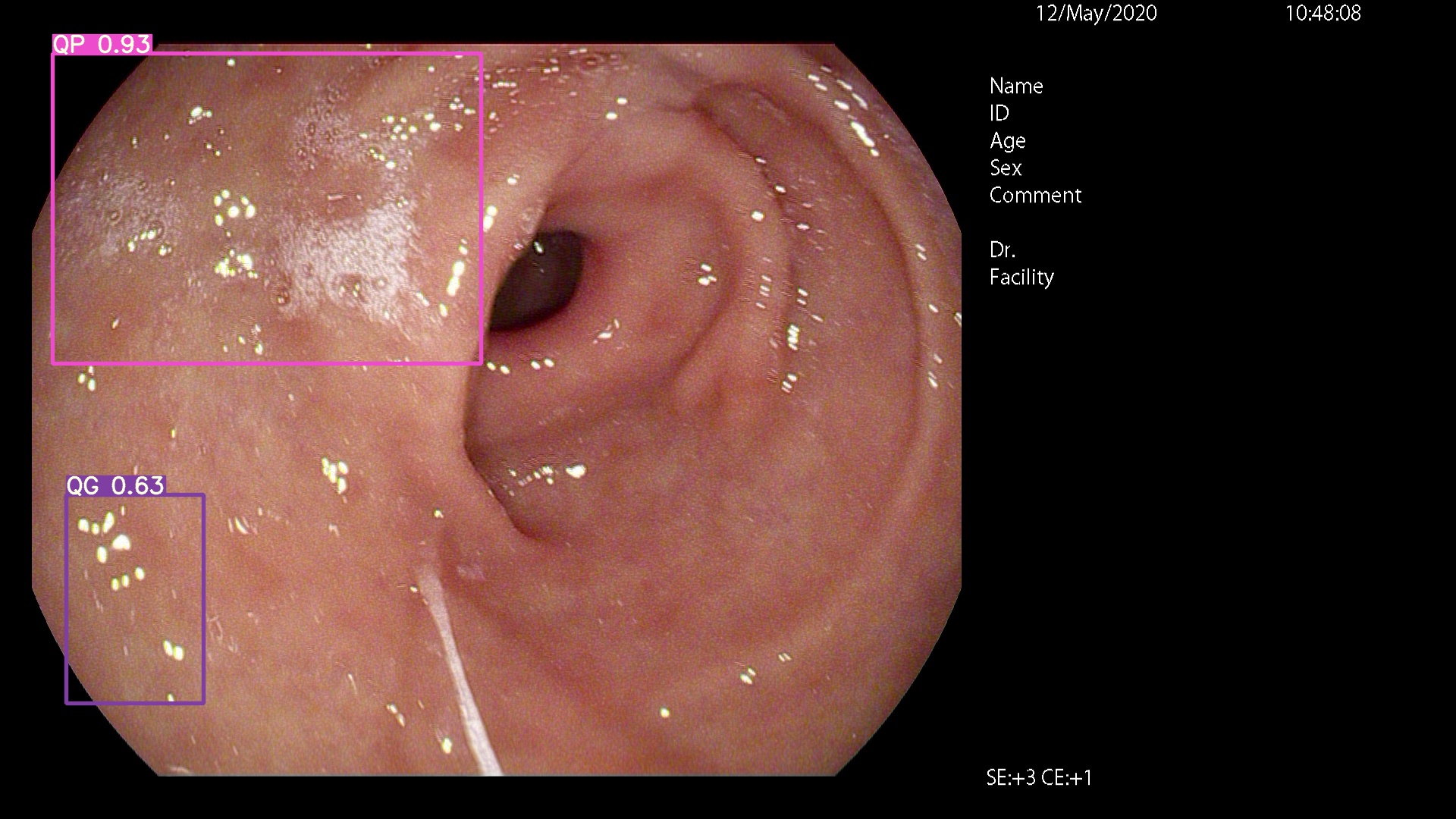

names: ['QP', 'NY', 'QG']

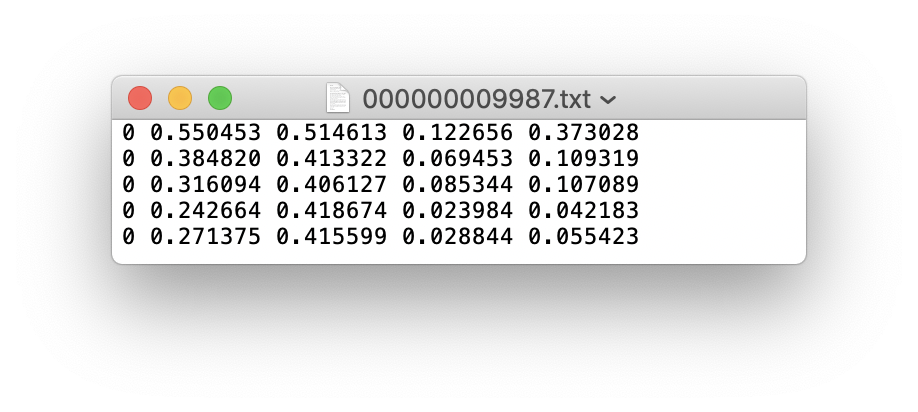

Вы можете использовать Labelimg, Labme, Labelbox и CVAT для маркировки данных. Для обнаружения цели вам нужно пометить ограничивающую коробку. Затем вам необходимо преобразовать аннотацию в ту же форму аннотации, что и формат Darknet , и каждое изображение генерирует файл аннотации *.txt (если изображение не имеет цели аннотации, вам не нужно создавать файл *.txt ). Созданный файл *.txt следуется следующим правилам:

class x_center y_center width height def convert ( size , box ):

'''

将标注的xml文件标注转换为darknet形的坐标

'''

dw = 1. / ( size [ 0 ])

dh = 1. / ( size [ 1 ])

x = ( box [ 0 ] + box [ 1 ]) / 2.0 - 1

y = ( box [ 2 ] + box [ 3 ]) / 2.0 - 1

w = box [ 1 ] - box [ 0 ]

h = box [ 3 ] - box [ 2 ]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

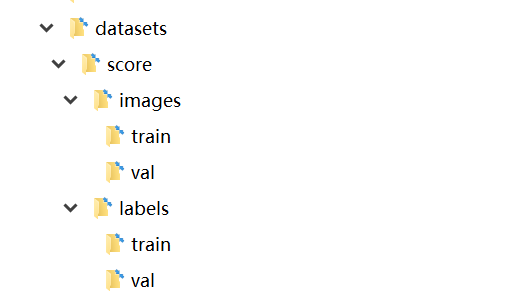

return ( x , y , w , h ) Каждая аннотация *.txt файл хранится в каталоге файлов, аналогично изображению. Вам нужно только заменить /images/*.jpg на /lables/*.txt (эта внутренняя обработка этого кода такая при загрузке данных. Вы можете изменить его в формат данных VOC для загрузки)

Например:

datasets/score/images/train/000000109622.jpg # image

datasets/score/labels/train/000000109622.txt # label

Если файл метки содержит 5 категорий человека (человек - это первая категория в наборе данных Coco, поэтому индекс равен 0):

Храните изображения и мешки папки обучающего набора и проверки, установленных в Val следующим образом

На этом этапе этап подготовки данных была завершена. В ходе процесса мы предполагаем, что процесс очистки данных и деления данных инженера -инженера Алгоритма были завершены сами по себе.

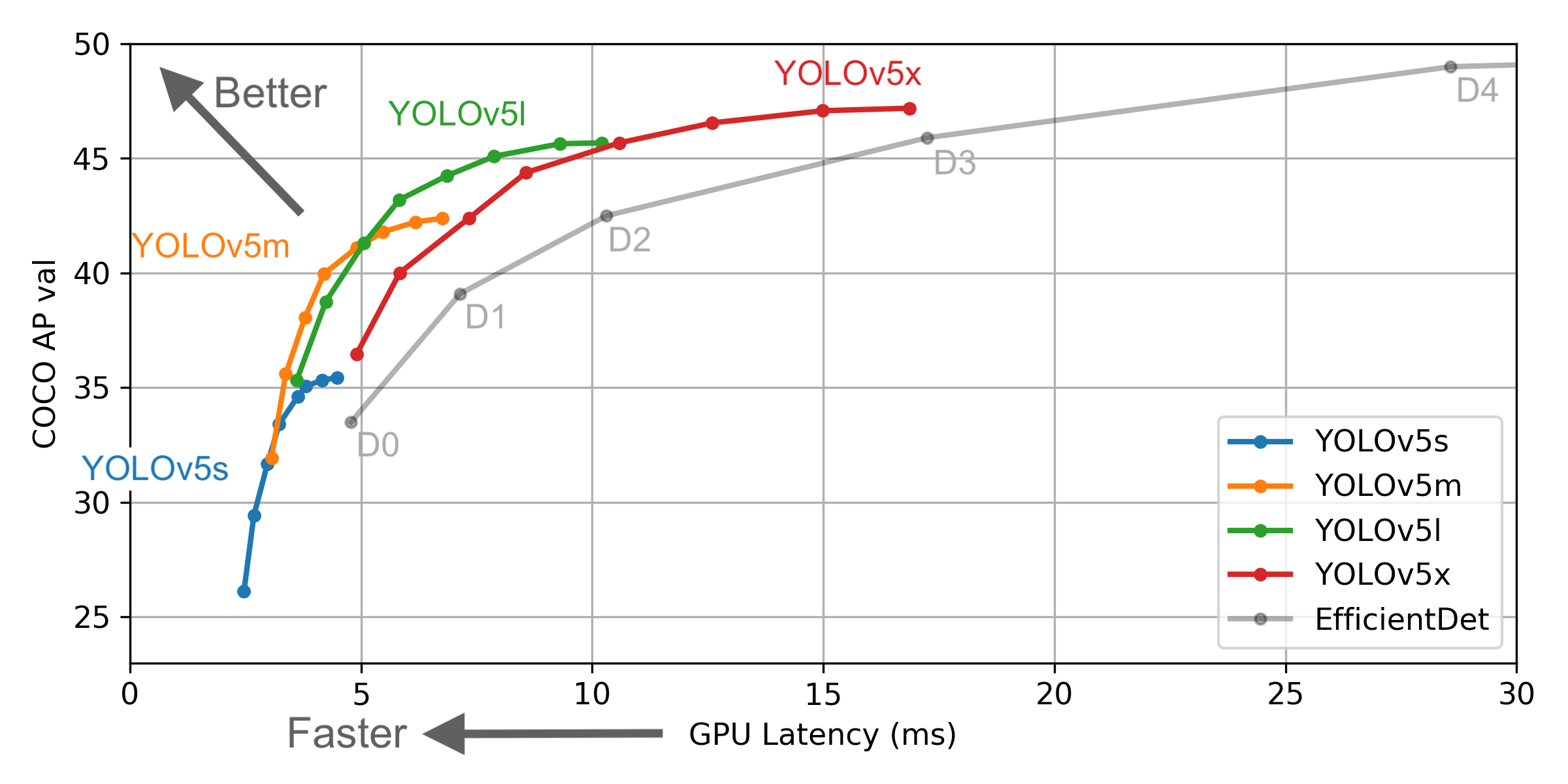

Выберите модель, которая должна быть обучена в папке ./models . Здесь мы выбираем yolov5x.yaml, самую большую модель для обучения. Обратитесь к таблице в официальном чтении, чтобы понять размер и скорость вывода различных моделей. Если вы выбрали модель, вам необходимо изменить файл yaml , соответствующий модели

# parameters

nc : 3 # number of classes <------------------ UPDATE to match your dataset

depth_multiple : 1.33 # model depth multiple

width_multiple : 1.25 # layer channel multiple

# anchors

anchors :

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# yolov5 backbone

backbone :

# [from, number, module, args]

[[-1, 1, Focus, [64, 3]], # 1-P1/2

[-1, 1, Conv, [128, 3, 2]], # 2-P2/4

[-1, 3, Bottleneck, [128]],

[-1, 1, Conv, [256, 3, 2]], # 4-P3/8

[-1, 9, BottleneckCSP, [256]],

[-1, 1, Conv, [512, 3, 2]], # 6-P4/16

[-1, 9, BottleneckCSP, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 8-P5/32

[-1, 1, SPP, [1024, [5, 9, 13]]],

[-1, 6, BottleneckCSP, [1024]], # 10

]

# yolov5 head

head :

[[-1, 3, BottleneckCSP, [1024, False]], # 11

[-1, 1, nn.Conv2d, [na * (nc + 5), 1, 1, 0]], # 12 (P5/32-large)

[-2, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 1, Conv, [512, 1, 1]],

[-1, 3, BottleneckCSP, [512, False]],

[-1, 1, nn.Conv2d, [na * (nc + 5), 1, 1, 0]], # 17 (P4/16-medium)

[-2, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 1, Conv, [256, 1, 1]],

[-1, 3, BottleneckCSP, [256, False]],

[-1, 1, nn.Conv2d, [na * (nc + 5), 1, 1, 0]], # 22 (P3/8-small)

[[], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

# Train yolov5x on score for 300 epochs

$ python3 train.py --img-size 640 --batch-size 16 --epochs 300 --data ./data/score.yaml --cfg ./models/score/yolov5x.yaml --weights weights/yolov5x.pt

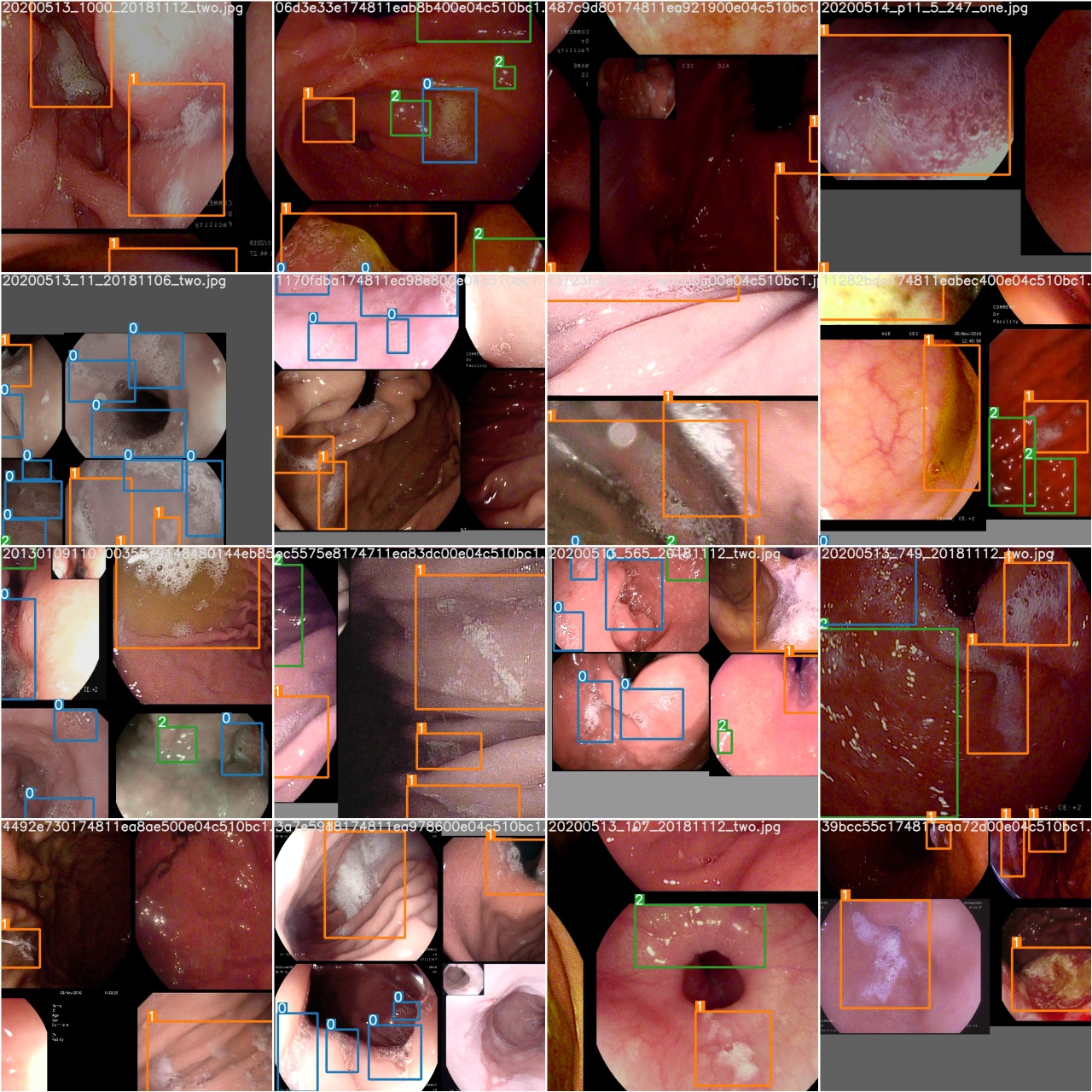

После начала обучения проверьте train*.jpg Image, чтобы просмотреть учебные данные, этикетки и улучшения данных. Если ваше изображение отображает этикетки или усовершенствования данных неверны, вы должны проверить, есть ли какие -либо проблемы с процессом строительства вашего набора данных.

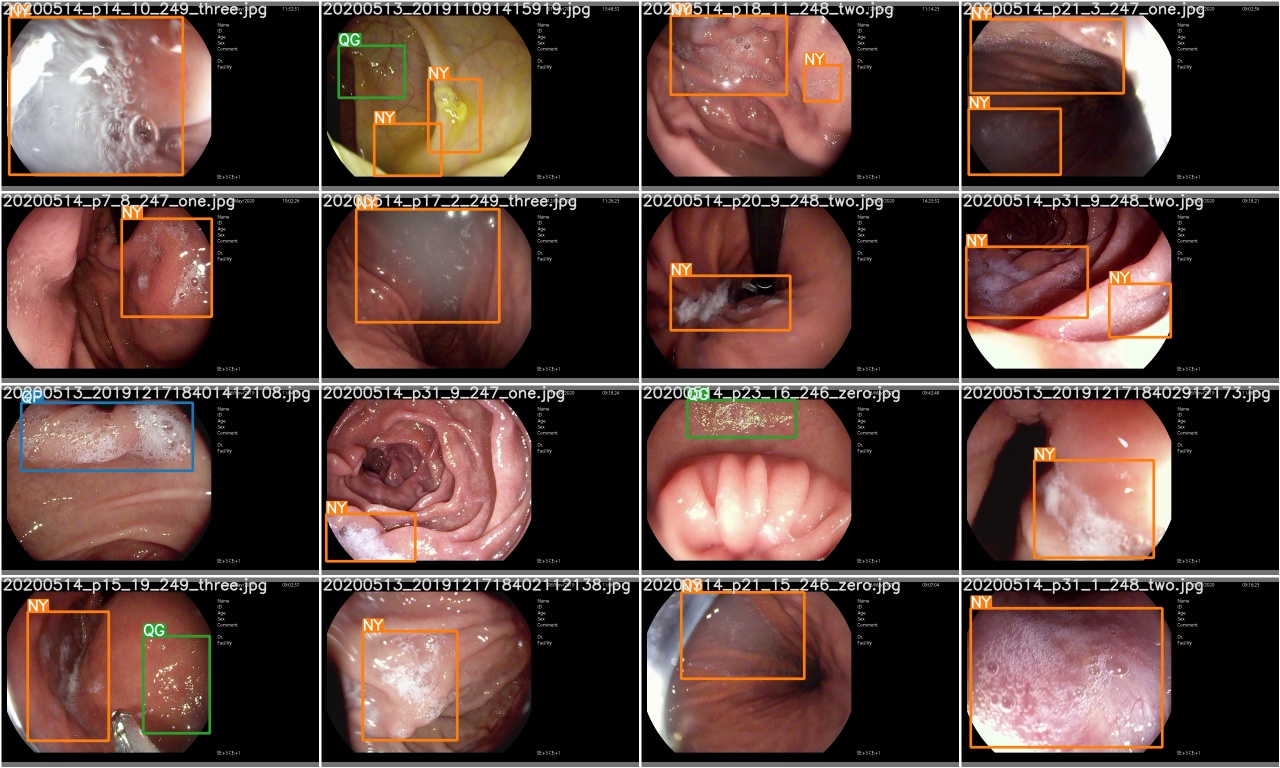

После завершения учебной эпохи проверьте test_batch0_gt.jpg , чтобы увидеть метки партии 0

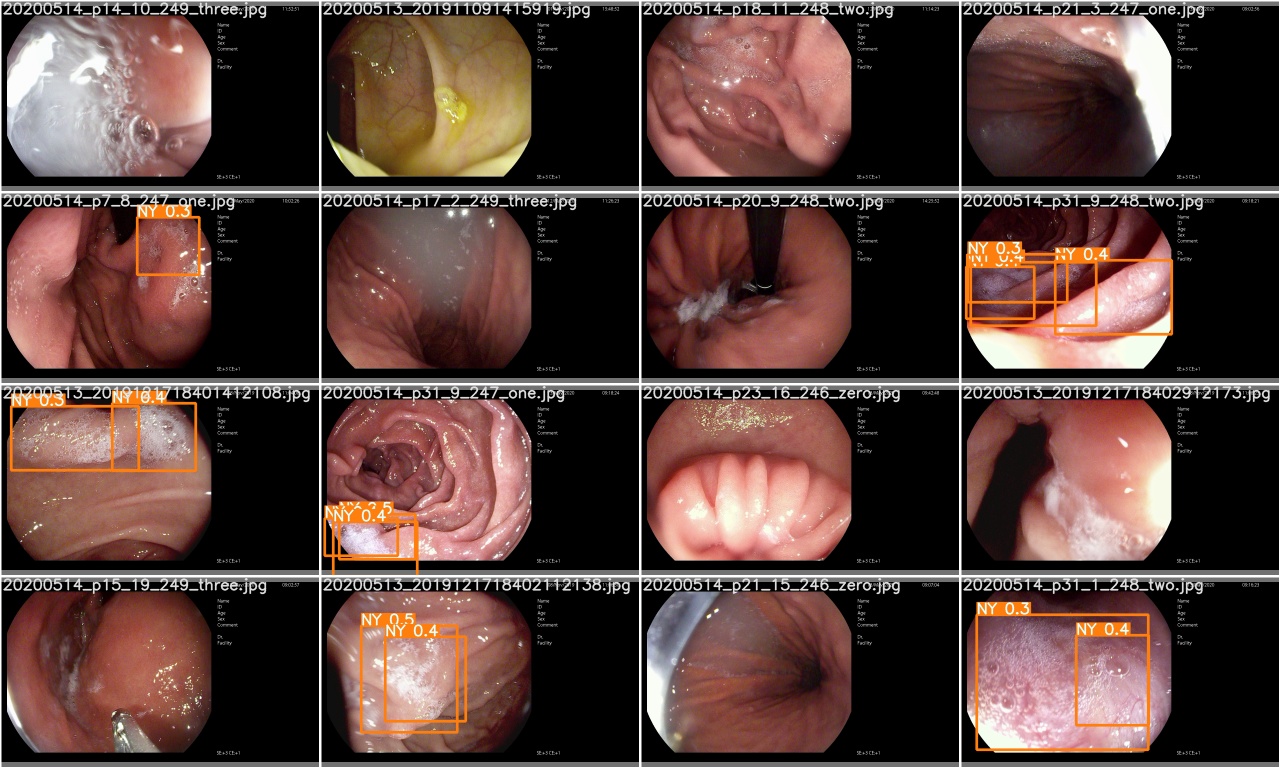

Проверьте test_batch0_pred.jpg , чтобы увидеть прогноз тестовой партии 0

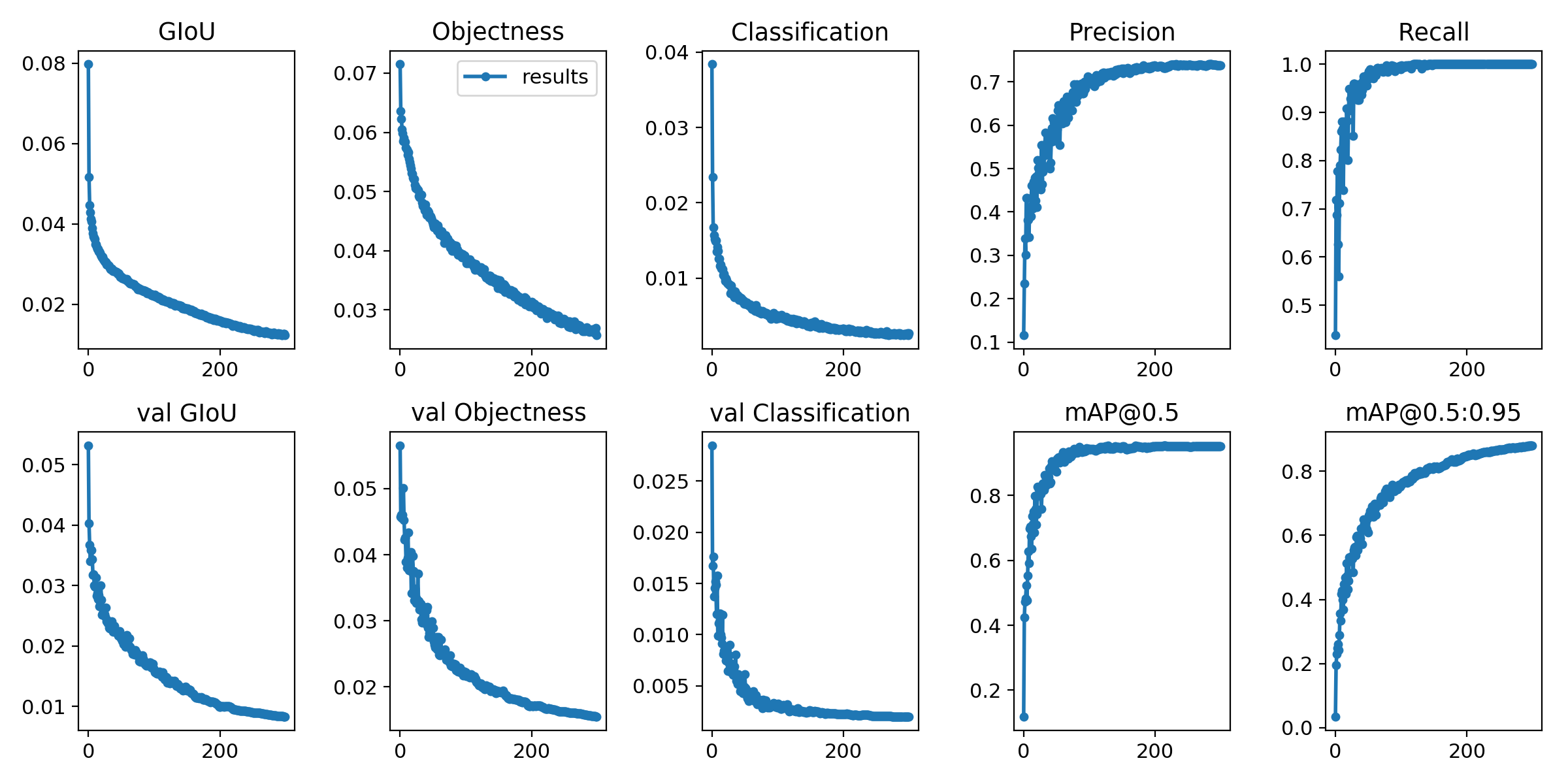

Потери обучения и показатели оценки сохраняются в файлах журнала Tensorboard и results.txt . results.txt будет визуализирован как results.png после завершения обучения

> >> from utils . utils import plot_results

> >> plot_results ()

# 如果你是用远程连接请安装配置Xming: https://blog.csdn.net/akuoma/article/details/82182913

$ python3 detect . py - - source file . jpg # image

file . mp4 # video

. / dir # directory

0 # webcam

rtsp : // 170.93 . 143.139 / rtplive / 470011e600 ef003a004ee33696235daa # rtsp stream

http : // 112.50 . 243.8 / PLTV / 88888888 / 224 / 3221225900 / 1. m3u8 # http stream # inference /home/myuser/xujing/EfficientDet-Pytorch/dataset/test/ 文件夹下的图像

$ python3 detect . py - - source / home / myuser / xujing / EfficientDet - Pytorch / dataset / test / - - weights weights / best . pt - - conf 0.1

$ python3 detect . py - - source . / inference / images / - - weights weights / yolov5x . pt - - conf 0.5

# inference 视频

$ python3 detect . py - - source test . mp4 - - weights weights / yolov5x . pt - - conf 0.4

Приходите сюда

Ссылка

[1] .https: //github.com/ultralytics/yolov5

[2] .https: //github.com/ultralytics/yolov5/wiki/train-custom-data