인공 지능 분야는 최근에 눈부신 새로운 스타 -Deepseek-V3-0324 큰 언어 모델로 개최되었습니다. DeepSeek 팀이 개발 한이 AI 모델은 놀라운 641GB 용량과 획기적인 기술 아키텍처로 업계 환경을 재구성하고 있습니다. 가장 놀라운 것은이 강력한 모델이 예비 홍보없이 Hugging Face 플랫폼에서 낮은 키 방식으로 출시되어 회사의 일반적인 실용 스타일을 계속한다는 것입니다.

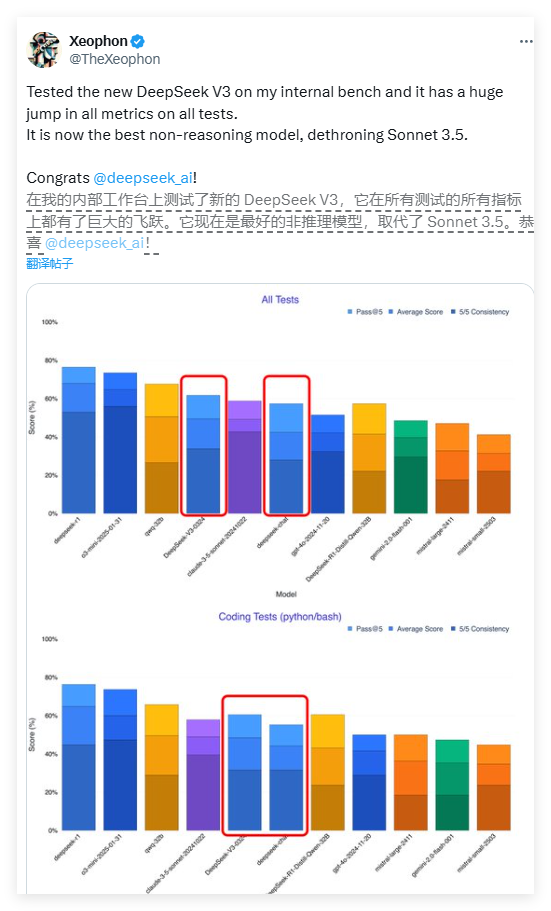

DeepSeek-V3의 성능은 놀랍습니다. 소셜 미디어 플랫폼 X의 AI 연구원 Xeophon의 테스트 보고서에 따르면이 모델은 모든 테스트 지표에서 질적 도약을 달성했습니다. 그것의 성능은 심지어 Anthropic의 널리 알려진 Claude Sonnet 3.5 상업용 AI 시스템을 능가하여 현재 최고의 비 감기 모델 중 하나가되었습니다. 이 획기적인 발전은 전체 AI 연구 커뮤니티에 영감을주었습니다.

DeepSeek-V3의 가장 눈길을 끄는 기능 중 하나는 완전히 오픈 소스 기능입니다. 대부분의 Western AI Company가 Paywalls 뒤에 고급 모델을 배치하는 비즈니스 모델과 달리 DeepSeek-V3은 MIT 라이센스를 채택하므로 누구나 상업적 목적으로도 모델을 무료로 다운로드하여 사용할 수 있습니다. 이 공개 공유 개념은 인공 지능 분야의 지불 장벽을 위반하고 고급 기술이 더 넓은 범위의 개발자에게 도움이 될 수 있습니다.

기술 아키텍처 측면에서 DeepSeek-V3는 혁신적인 하이브리드 전문가 (MOE) 시스템을 채택합니다. 이 혁신적인 아키텍처를 통해 모델은 특정 작업을 처리 할 때 약 370 억 개의 매개 변수를 활성화 할 수 있으며, 비 전통적인 모델에는 6 억 6 천만 개의 매개 변수의 활성화가 필요합니다. 이 선택적 활성화 메커니즘은 컴퓨팅 효율을 크게 향상시키고 컴퓨팅 리소스 요구 사항을 크게 줄이면서 성능을 보장합니다. 이 혁신은 큰 언어 모델의 최적화를위한 새로운 경로를 열어줍니다.

DeepSeek-V3에는 두 가지 최첨단 기술이 포함되어 있습니다 : 긴 잠재적 인주의 (MLA)와 MTP (Multi-Token Prediction). MLA 기술은 긴 텍스트를 처리 할 때 모델의 상황에 맞는 이해를 크게 향상시키는 반면, MTP 기술은 단일 단계에서 여러 토큰을 생성하여 출력 속도를 거의 80%증가시킬 수 있습니다. 이러한 기술 혁신은 함께 DeepSeek-V3의 탁월한 성능을위한 기술적 기초를 형성합니다.

놀랍게도이 고성능 모델은 상대적으로 하드웨어 친화적입니다. 개발자 Simon Willison은 4 비트 양자화 후 모델 스토리지 점유를 352GB로 줄일 수있어 고급 소비자 장치에서 실행할 수 있다고 지적했습니다. AI 연구원 인 Awni Hannun은 512GB의 메모리를 갖춘 M3 Ultra Chip Mac Studio에서 DeepSeek-V3가 초당 20 개 이상의 토큰으로 실행될 수 있음을 확인했습니다. 이 현지화 된 운영 기능은 데이터 센터 수준 인프라에 대한 기존 AI 모델의 의존성을 중단합니다.

이전 버전과 비교할 때 DeepSeek-V3도 대화식 스타일의 중대한 변화를 겪습니다. 초기 사용자 피드백은 새로운 모델이보다 공식적이고 기술적 인 표현을 제시했으며, 이는 이전 버전의 인간화 된 대화 스타일과 대조적입니다. 이 스타일 조정은 개발자의 모델의 전문 위치에 대한 재고를 반영하여 기술 응용 프로그램 시나리오에 더 적합합니다.

DeepSeek-V3의 릴리스 전략은 중국 AI 회사와 서양 동료 간의 비즈니스 모델의 중요한 차이를 반영합니다. 고급 칩이 제한되어있는 환경에서 중국 기업은 알고리즘 최적화 및 효율성 개선에 더 많은 관심을 기울입니다. 이 "하드웨어 제한에 따른 혁신"은 고유 한 경쟁 우위가 될 수 있습니다. Baidu, Alibaba 및 Tencent를 포함한 중국 기술 거대 기업들은 또한 더 개방 된 AI 생태계를 공동으로 홍보하기 위해 오픈 소스 전략을 따랐습니다.

업계 전문가들은 DeepSeek-V3이 차세대 추론 모델 인 DeepSeek-R2의 기초가 될 것이라고 믿고 있습니다. Nvidia CEO Hwang Junxun이 한때 DeepSeek의 R1 모델의 계산 소비가 비정 기준 AI의 100 배라고 지적했다는 점을 고려할 때 리소스 제약 하에서 그러한 성능을 달성하는 것이 훨씬 더 가치가 있다고 지적했습니다. R2 가이 개발 궤적을 계속한다면, OpenAI의 다가오는 GPT-5에 상당한 도전이 될 것입니다.

현재 개발자는 포옹 얼굴을 통해 전체 모델 가중치를 다운로드하거나 OpenRouter와 같은 플랫폼을 통해 API 인터페이스를 경험할 수 있습니다. DeepSeek의 공개 전략은 글로벌 AI 개발 패턴을 재정의하는 것입니다. 이는 더 인기있는 새로운 시대가 더 대중화되고 혁신 및 개방성이오고 있음을 나타냅니다.

<| 문장 끝 |>