f5 tts mlx

0.2.3

MLXフレームワークを使用したF5-TTSの実装。

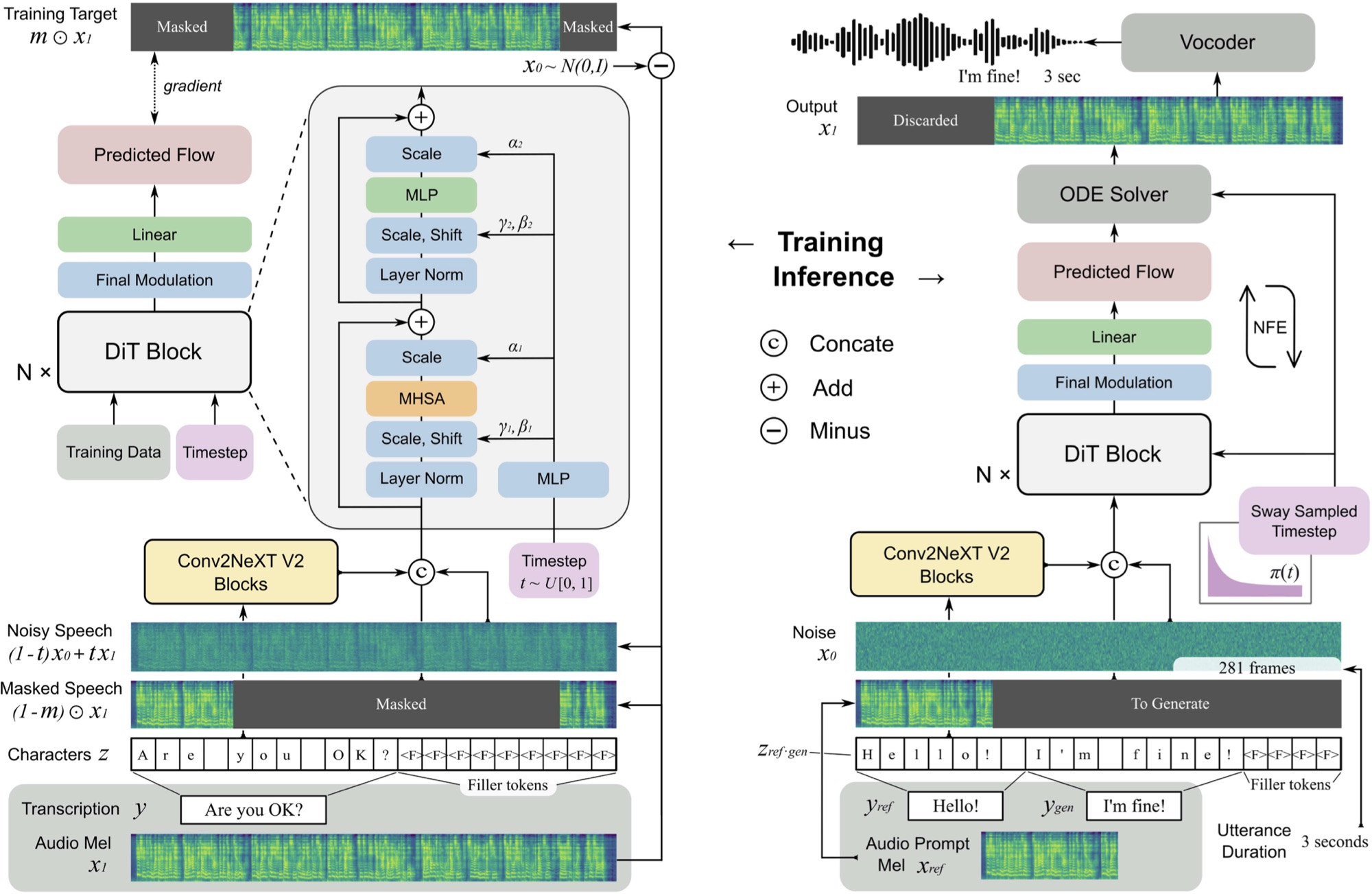

F5 TTSは、拡散トランス(DIT)を備えたフローマッチングMEL Spectrogram Generatorを使用して、非自動網性、ゼロショットテキストへのスピーチシステムです。

ここでは、M3 Max MacBook Proで約11秒で生成されたサンプルを聴くことができます。

F5はE2 TTSの進化であり、学習したテキストアライメントのConvNext V2ブロックでパフォーマンスを向上させます。このリポジトリは、ここで入手可能な元のPytorchの実装に基づいています。

pip install f5-tts-mlxpython -m f5_tts_mlx.generate --text " The quick brown fox jumped over the lazy dog. "パイプを使用して、言語モデルからの別のプロセスの出力から音声を生成することもできます。

mlx_lm.generate --model mlx-community/Llama-3.2-1B-Instruct-4bit --verbose false

--temp 0 --max-tokens 512 --prompt " Write a concise paragraph explaning wavelets. "

| python -m f5_tts_mlx.generate独自のリファレンスオーディオサンプルを使用する場合は、5〜10秒ほどのモノ、24kHz WAVファイルであることを確認してください。

python -m f5_tts_mlx.generate

--text " The quick brown fox jumped over the lazy dog. "

--ref-audio /path/to/audio.wav

--ref-text " This is the caption for the reference audio. "このようなFFMPEGを使用して、オーディオファイルを正しい形式に変換できます。

ffmpeg -i /path/to/audio.wav -ac 1 -ar 24000 -sample_fmt s16 -t 10 /path/to/output_audio.wav生成をカスタマイズするためのその他のオプションについては、こちらをご覧ください。

帯域幅またはメモリ制限環境にいる場合は、 --qオプションを使用して、モデルの量子化バージョンをロードできます。 4ビットおよび8ビットのバリエーションがサポートされています。

python -m f5_tts_mlx.generate --text " The quick brown fox jumped over the lazy dog. " --q 4Pythonから事前に処理されたモデルをロードできます。

from f5_tts_mlx . generate import generate

audio = generate ( text = "Hello world." , ...)前処理されたモデルの重みは、顔を抱きしめても利用できます。

F5 TTSおよび前提条件モデルの元のPytorch実装のためのYushen Chen。

このモデルが基づいているE2 TTS実装のPhil Wang。

@article { chen-etal-2024-f5tts ,

title = { F5-TTS: A Fairytaler that Fakes Fluent and Faithful Speech with Flow Matching } ,

author = { Yushen Chen and Zhikang Niu and Ziyang Ma and Keqi Deng and Chunhui Wang and Jian Zhao and Kai Yu and Xie Chen } ,

journal = { arXiv preprint arXiv:2410.06885 } ,

year = { 2024 } ,

} @inproceedings { Eskimez2024E2TE ,

title = { E2 TTS: Embarrassingly Easy Fully Non-Autoregressive Zero-Shot TTS } ,

author = { Sefik Emre Eskimez and Xiaofei Wang and Manthan Thakker and Canrun Li and Chung-Hsien Tsai and Zhen Xiao and Hemin Yang and Zirun Zhu and Min Tang and Xu Tan and Yanqing Liu and Sheng Zhao and Naoyuki Kanda } ,

year = { 2024 } ,

url = { https://api.semanticscholar.org/CorpusID:270738197 }

}このリポジトリのコードは、ライセンスファイルで見つかったMITライセンスの下でリリースされます。