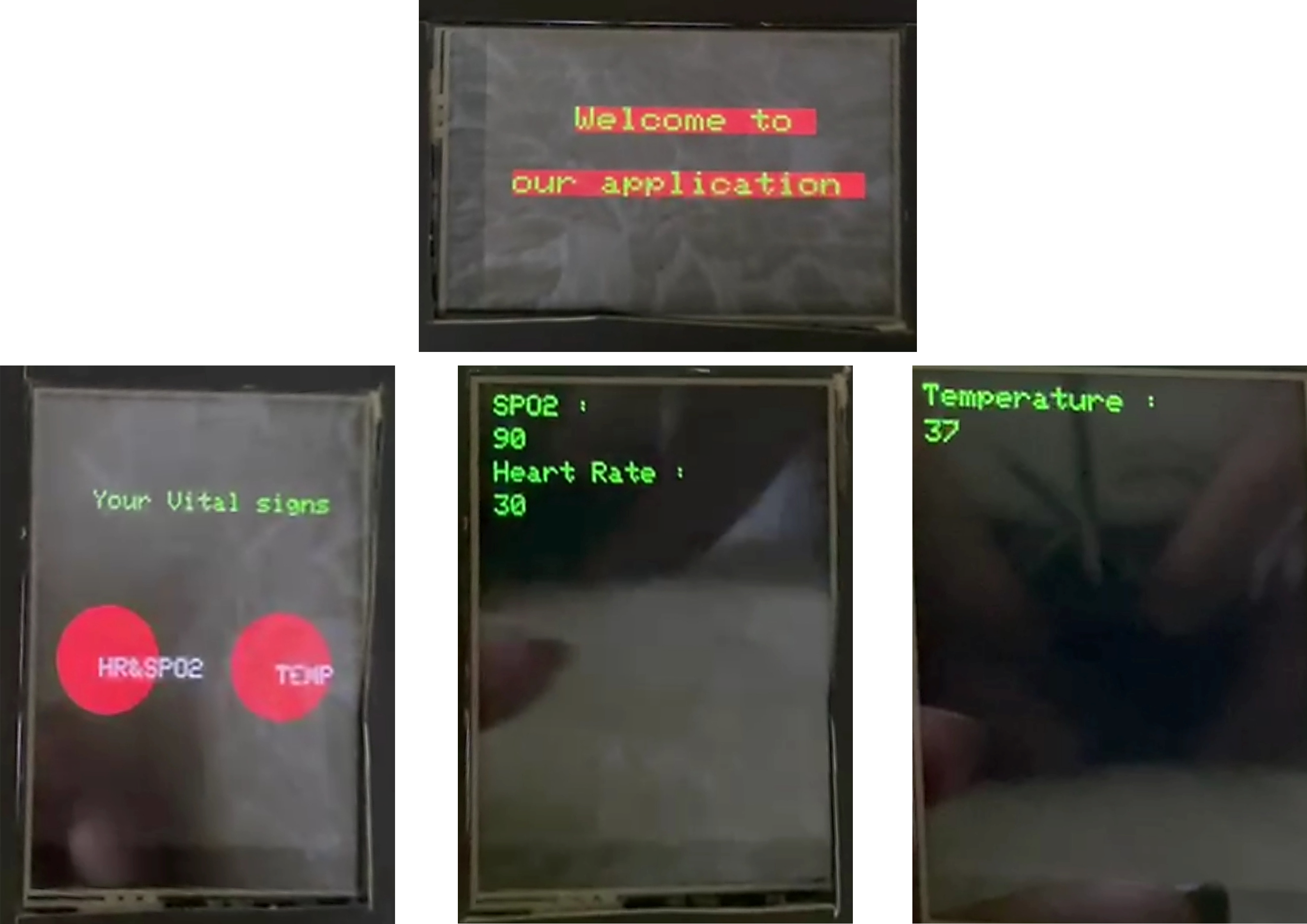

IoTとNLPを使用した提案されたヘルスケア監視システムは、患者と医師の効率的な医療監視と医療支援を促進するために、スマートバンド、モバイルアプリケーション、および生成的な質問回答システムを含む統合されたプラットフォームを作成することを目指しています。スマートバンドは、バイタルサインを収集し、患者と医療提供者の両方がリアルタイムでアクセスするためにデータベースに保存します。チャットボットとして実装されたBioGPT-PubMedQA-Prefix-Tuningモデルは、患者を医学的調査で支援し、最初の処方を提供します。さらに、チャットボットは医師のアシスタントとして機能し、患者の相談中に医師に医学者を支援します。モバイルアプリケーションは、患者と医師の両方のユーザーの主要なインターフェイスとして機能します。患者と医師向けの個別のポータルが含まれており、ニーズに合わせた独特の機能を提供します

デモ、プレゼンテーション、ドキュメントを確認してください

| デモ | プレゼンテーション | ドキュメント |

|---|---|---|

モバイルアプリケーションは、ユーザー、患者、医師の両方の主要なインターフェイスとして機能します。患者と医師向けの個別のポータルが含まれており、ニーズに合わせた明確な機能を提供します。

APIおよびトークンはアプリで使用されます

API_URL = "https://api-inference.huggingface.co/models/Amira2045/BioGPT-Finetuned"

headers = {"Authorization": "Bearer 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"}

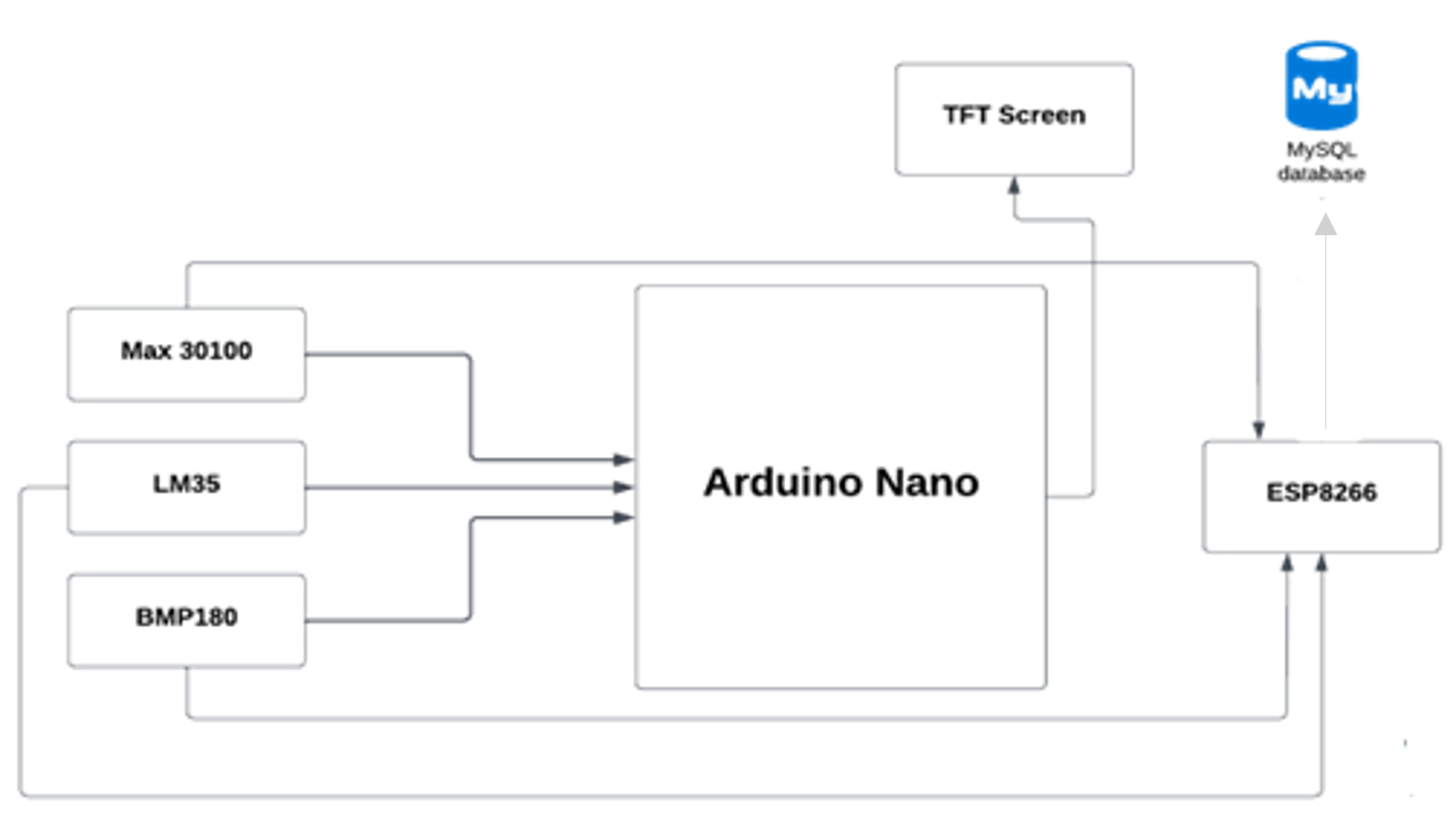

マイクロコントローラー(Arduino Nano)は、Wi-FiモジュールESP8266を使用してバイタルサインをデータベースに送信し、モバイルアプリケーションがデータベースからデータを取得します。

微調整に使用されるBiogpt-PubMedQA-Prefix-Tuningモデルは、医療ドメインで使用される大規模な言語モデル(LLM)であるBioGPTです。微調整されたモデルの目標は、医学的な質問に答えることです。モデルはモバイルアプリケーション内のチャットボットとして展開され、ユーザーは健康関連のクエリを尋ねて正確な応答を受信できるようにします。チャットボットは仮想医療助手として機能し、最初の処方箋を提供し、症状と病歴に基づいてユーザーを指導します。

| Biogpt-Large | BioGpt-PubMedQA-Prefix-Tuning | |

|---|---|---|

| 損失 | 12.37 | 9.20 |

| 困惑 | 237016.3 | 1350.9 |

PubMedqa _閉じたドメインの質問PubMed要約:データセットには、病気、治療、遺伝子、タンパク質などを含む幅広い生物医学的トピックをカバーする生物医学研究に関する質問が含まれています。 PubMedQAは、MultiMedQAデータセットの1つです(医療質問応答のベンチマーク)。 PubMedQAは、YES/NO/多分複数選択回答を使用して、1Kの専門家、61.2Kのラベル付けされていない、211.3Kの人為的に生成されたQAインスタンスで構成されています。

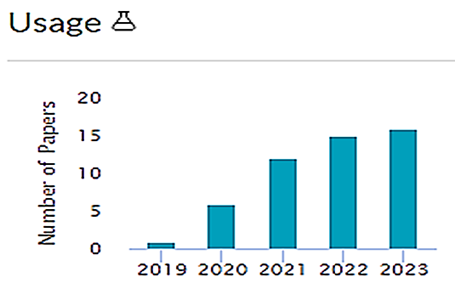

Microsoftによって発表されたBioGPTは、生物医学的質問に答えることを目的として生物医学研究を分析するために使用でき、研究者が新しい洞察を得るのを支援することに特に関連することができます。

BioGPTは、すでに公開されている数百万の生物医学的研究記事で訓練されている生成言語モデルの一種です。これは本質的に、BioGPTがこの情報を使用して、質問への回答、関連するデータの抽出、生物医学に関連するテキストの生成など、他のタスクを実行できることを意味します。

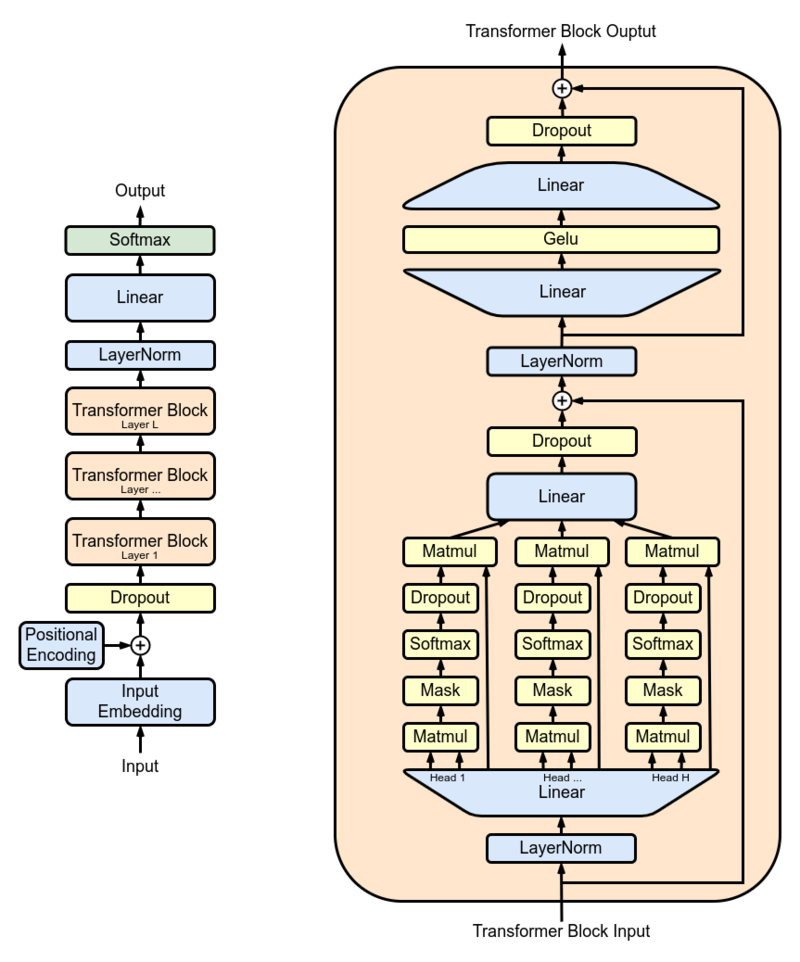

研究者は、GPT-2 XLをプライマリモデルとして使用し、現実世界で使用する前に1500万のPubMed要約で訓練しました。 GPT-2 XLは、48レイヤー、1600の隠れサイズ、25の注意ヘッドを備えたトランスデコーダーで、合計1.5Bパラメーターをもたらします。

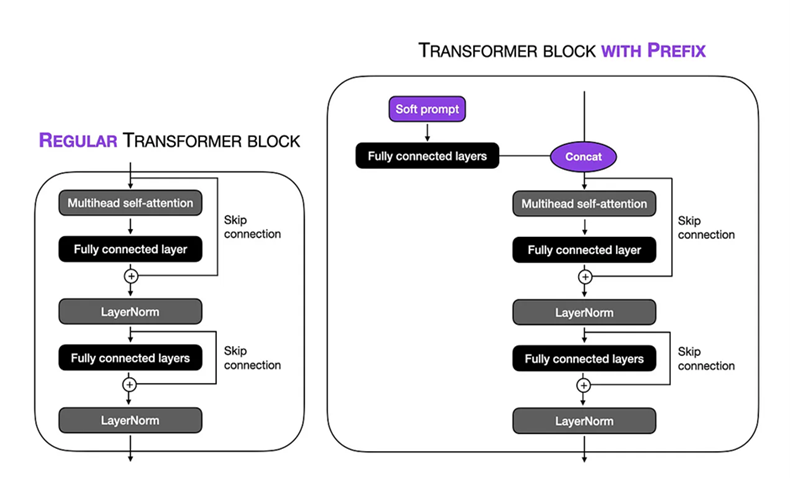

微調整セットアップ:BioGptの大きな1.5Bモデルで、プレフィックスチューニング技術でソフトプロンプトを実行しました。仮想トークンの長さは10に設定されているため、入力シーケンス内の特定のコンテキストに集中できます。モデルの残りの部分を凍結することにより、トレーニング可能なパラメーターの数を150万に制限しました。トレーニングプロセス中に、 8およびnum_warmup_steps = 1000およびgradient_accumulation_steps = 4およびweight_decay = 0.1のバッチサイズのTPU VM V3-8を使用しました。 Adam Optimizerが採用され、 1×10-5のピーク学習率を利用して、 3つのエポックの過程でモデルのパフォーマンスを最適化しました。

Finetuned BioGPTモデルは、抱きしめられた顔にホストされており、次のAPIを使用してモバイルアプリにモデルを展開しました。

API_URL = "https://api-inference.huggingface.co/models/Amira2045/BioGPT-Finetuned"

headers = {"Authorization": "Bearer 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"}

マイクロコントローラー(Arduino Nano)は、Wi-FiモジュールESP8266を使用してバイタルサインをデータベースに送信し、モバイルアプリケーションがデータベースからデータを取得します。