Pragyantra adalah proyek perangkat lunak sederhana yang dirancang untuk mensimulasikan robot humanoid dengan penglihatan, pendengaran, ucapan, dan fungsionalitas memori. Proyek ini bertujuan untuk menciptakan platform yang fleksibel untuk bereksperimen dengan kecerdasan buatan dan interaksi manusia-mesin. Sampai sekarang, ini lebih seperti LLM, tetapi dengan kemampuan yang diperluas, memungkinkannya untuk melihat, mendengar, dan terlibat dalam komunikasi verbal.

Saya memprioritaskan pragyantra untuk memiliki kemampuan offline sambil juga mengintegrasikan fungsionalitas online. Untuk mencapai hal ini, semua komponen proyek dirancang untuk memiliki kemampuan offline, dengan fungsionalitas online tersedia sebagai fitur opsional. Meskipun menggunakan mode offline mungkin memerlukan perangkat yang lebih kuat untuk inferensi yang lebih cepat, proyek ini berfungsi penuh dan berkinerja mengagumkan dalam kondisi ini.

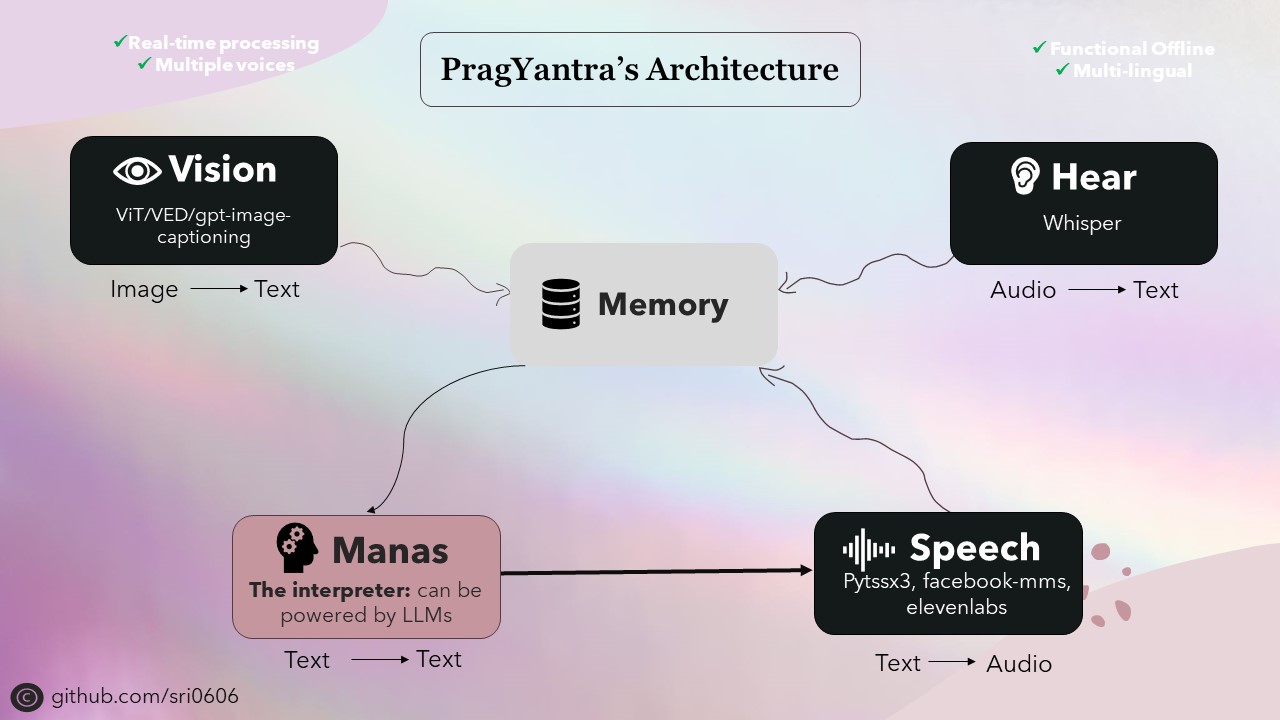

Tulang punggung pragyantra terdiri dari berbagai model open-source untuk tugas-tugas seperti teks-ke-pidato, ucapan-ke-teks, teks-ke-teks, dan konversi gambar-ke-teks. Model -model ini berfungsi sebagai blok bangunan di mana arsitektur Pragyantra dibangun, dengan kemampuan tambahan dan konkurensi terintegrasi dengan mulus untuk meningkatkan kinerja dan pengalaman pengguna secara keseluruhan.

Pragyantra, berasal dari bahasa Sanskerta, adalah perpaduan dua kata: "prag" yang berarti cerdas atau bijaksana, dan "yantra" mengacu pada mesin atau robot. Jadi, kumpulkan, pragyantra mewujudkan konsep mesin cerdas, yang mencerminkan tujuan proyek untuk menciptakan platform yang fleksibel untuk bereksperimen dengan AI dan interaksi manusia-mesin.

Untuk mengatur proyek, ikuti langkah -langkah ini:

Klon Repositori:

git clone https://github.com/sri0606/pragyantra.git

Arahkan ke Direktori Proyek:

cd pragyantra

Jalankan skrip pengaturan:

python setup.py

ATAU

chmod +x setup.sh

./setup.sh

bash setup.sh

Skrip Pengaturan akan menginstal dependensi, mengunduh model yang diperlukan, dan membuat direktori yang diperlukan.

Untuk bantuan, jalankan perintah berikut:

python main.py --help

Contoh Perintah:

Mode offline

python main.py --interpreter_model llama3_8B --offline_mode --speaker_model pyttsx3Mode online

python main.py --interpreter_model llama3-70B-8192 --speaker_model pyttsx3

or

python main.py --interpreter_model mixtral-8x7b-32768 --speaker_model 11labs @misc {nlp_connect_2022,

author = { {NLP Connect} },

title = { vit-gpt2-image-captioning (Revision 0e334c7) },

year = 2022,

url = { https://huggingface.co/nlpconnect/vit-gpt2-image-captioning },

doi = { 10.57967/hf/0222 },

publisher = { Hugging Face }

}

@article{pratap2023mms,

title={Scaling Speech Technology to 1,000+ Languages},

author={Vineel Pratap and Andros Tjandra and Bowen Shi and Paden Tomasello and Arun Babu and Sayani Kundu and Ali Elkahky and Zhaoheng Ni and Apoorv Vyas and Maryam Fazel-Zarandi and Alexei Baevski and Yossi Adi and Xiaohui Zhang and Wei-Ning Hsu and Alexis Conneau and Michael Auli},

journal={arXiv},

year={2023}

}

@misc{li2021trocr,

title={TrOCR: Transformer-based Optical Character Recognition with Pre-trained Models},

author={Minghao Li and Tengchao Lv and Lei Cui and Yijuan Lu and Dinei Florencio and Cha Zhang and Zhoujun Li and Furu Wei},

year={2021},

eprint={2109.10282},

archivePrefix={arXiv},

primaryClass={cs.CL}

}