IBM hat im Mai einen wichtigen Schritt gemacht und die Open Source seines Granite13B Big Language Model (LLM) für Unternehmens -Anwendungsszenarien angekündigt. Dieser Schritt demonstriert nicht nur die führende Position von IBM im Bereich künstlicher Intelligenz, sondern bietet auch Unternehmensnutzern leistungsstarke Tools, die ihnen helfen, mit komplexen Geschäftsanforderungen besser zu erfüllen. Vor kurzem hat Armand Ruiz, Vice President von Product bei der IBM AI -Plattform, den vollständigen Datensatz für die Ausbildung von Granite13b weiter bekannt gegeben.

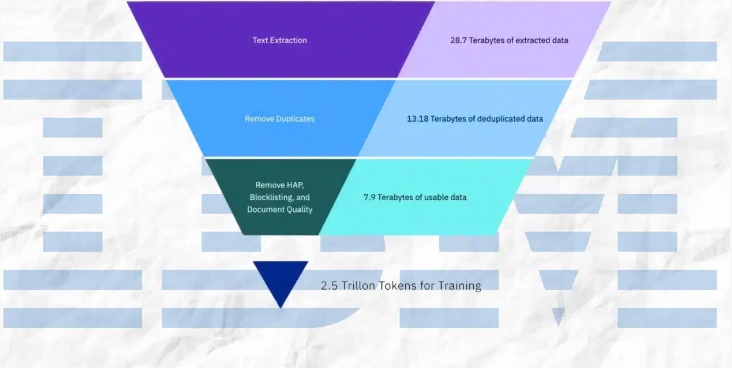

Es ist erwähnenswert, dass dieser riesige Datensatz ausschließlich vorverarbeitet und auf 2,07 TB reduziert wurde, eine Reduzierung um 68%. Ruiz betonte bei der Veröffentlichung der Daten, dass dieser Vorverarbeitungsschritt entscheidend für die Gewährleistung hoher Qualität, unvoreingenommener und ethischer und gesetzlicher Anforderungen des Datensatzes ist. Die Anwendungsszenarien für Unternehmen haben äußerst hohe Anforderungen für die Genauigkeit und Zuverlässigkeit von Daten. Daher hat IBM viele Ressourcen in diesem Prozess investiert, um sicherzustellen, dass der endgültige Datensatz diese Anforderungen erfüllen kann.

Der Datensatz verfügt über eine breite Palette von Inhaltsquellen und deckt autoritative Daten in mehreren Feldern ab. Dazu gehören mehr als 2,4 Millionen wissenschaftliche Papierevorbereitungen von Arxiv, Common Crawls Open Network Crawl und DeepMind Mathematics 'mathematischer Q & A. Darüber hinaus enthält der Datensatz kostenloses Gesetz von den US -Gerichten, Github Clean -Code -Daten von Codeparrot und Hacker -Nachrichten Informatik und Unternehmer News von 2007 bis 2018.

Weitere wichtige Datenquellen sind OpenWEB-Text (eine Open-Source-Version des OpenAI Web Text Corpus), Project Gutenberg (ein kostenloses E-Book, das sich auf frühe Arbeiten konzentriert), die biomedizinischen und rettungswissenschaftlichen Papiere von PubMed Central sowie die US-amerikanische Securities and Exchange Commission (Börsenaufsichtsbehörde (Börsenkombination) (Commission der US-amerikanischen Securities and Exchange Commission) (( Sec) 10-K/Q-Einreichungen (1934-2022). Darüber hinaus enthält der Datensatz benutzerfreundliche Inhalte im Stack Exchange-Netzwerk, US-Patente (USPTOs), die zwischen 1975 und Mai 2023, unstrukturierte Webinhalte von Webhose und Inhalten von acht englischen Wikimedia-Projekten vergeben wurden.

Während des Vorverarbeitungsprozesses hat IBM eine Vielzahl von technischen Methoden übernommen, darunter Textextraktion, Dingung, Spracherkennung, Satzsegmentierung und Kennzeichnung von Hass, Missbrauch und Schimpfwörtern. Darüber hinaus werden im Datensatz Schritte wie Annotation der Dokumentenqualität, Annotation von URL -Maskierung, Filterung und Tokenisierung angewendet. Diese Schritte gewährleisten die Reinheit und hohe Qualität des Datensatzes und bilden eine solide Grundlage für das Modelltraining.

IBM gab nicht nur den Datensatz bekannt, sondern veröffentlichte auch vier Versionen des Granitcodemodells mit Parametern zwischen 3 und 34 Milliarden. Diese Modelle zeigten sich in einer Reihe von Benchmarks gut ab und übertrafen andere vergleichbare Modelle in vielen Aufgaben wie Code Lama und LLAMA3. Diese Leistung beweist ferner die technische Stärke und die innovativen Fähigkeiten von IBM auf dem Gebiet der künstlichen Intelligenz.

Zusammenfassend bietet die IBM -Reihe von Maßnahmen nicht nur leistungsstarke Tools für Unternehmensbenutzer, sondern leisten auch wichtige Beiträge zur Entwicklung des Bereichs der künstlichen Intelligenz. Durch die Enthüllung hochwertiger Datensätze und hervorragenden Leistungsmodelle fördert IBM die weit verbreitete Popularität der KI-Technologie in Unternehmensanwendungen und ebnet den Weg für zukünftige Innovationen.