RAG based Intelligent Conversational AI Agent for Knowledge Extraction Using LangChain Gemini LLM

1.0.0

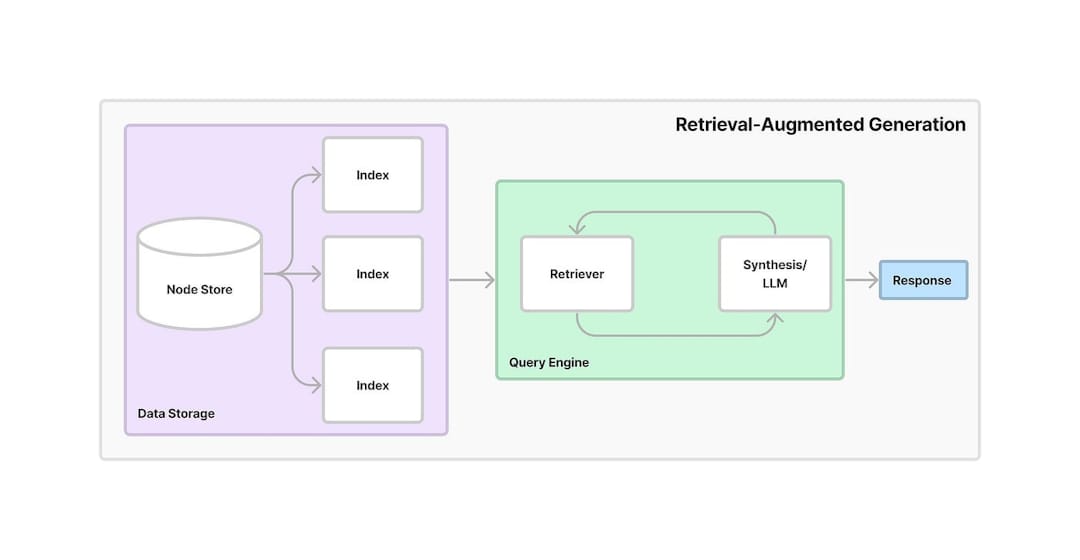

檢索增強生成(RAG)是將信息檢索與生成AI結合的框架。它允許模型從外部來源或數據庫中檢索相關信息,並使用該數據來生成更準確和上下文相關的響應。通過利用檢索和發電,抹布提高了AI模型的準確性和可靠性,尤其是在提供最新信息或處理複雜問題時。

該項目提供了一個基於AI的對話助手,該助手利用檢索功能的生成(RAG)從PDF文檔中提取知識。該系統結合了文本嵌入,矢量搜索和LLM,以提供用戶問題的答案。以下是應用程序運作方式的詳細分步工作流程:

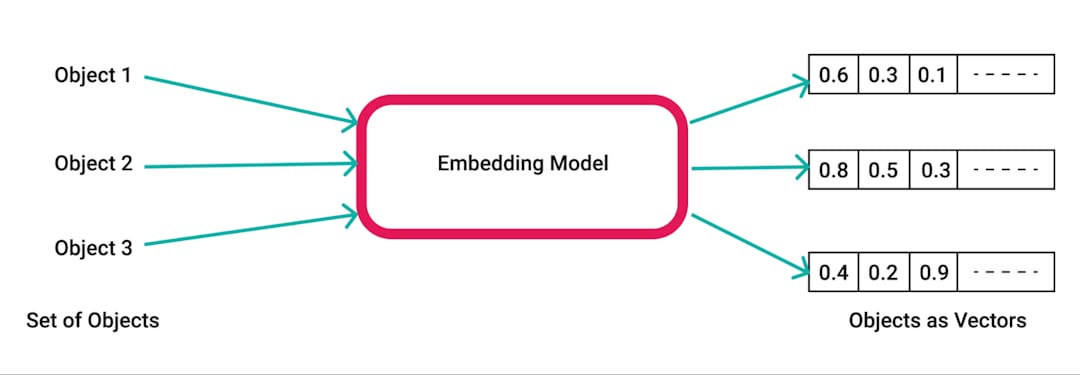

pdfplumber (用於從PDF提取文本的Python庫)提取文本。pdfplumber庫從上傳的PDF提取原始文本。分析文檔的每個頁面,並準備結果文本以進行進一步處理。RecursiveCharacterTextSplitter分為較小的塊。這樣可以確保內容可用於嵌入和檢索,通常具有500個字符的大小和50個字符的重疊。SpacyEmbeddings轉換為數值嵌入。這些嵌入代表了塊的語義含義,從而實現了有效的搜索。

Chroma庫創建矢量數據庫,該庫存儲在該庫中。矢量數據庫允許基於用戶查詢快速有效地檢索相關信息。LangChain建立了ConversationalRetrievalChain RetRevalchain,將存儲在Chroma中的嵌入與對話記憶緩衝區相結合以跟踪聊天歷史記錄和上下文。ChatGoogleGenerativeAI (Google的Gemini LLM),以基於從矢量商店檢索到的文本塊對用戶問題產生相關和智能的回答。

有效的知識檢索:通過利用抹布的力量,該系統將檢索和生成結合起來,根據上傳的PDF文檔的內容準確回答特定問題。

可擴展性和靈活性:使用文本塊和嵌入,該應用程序可以處理大型文檔,同時確保快速,精確的信息檢索。

會話AI :對話歷史記錄使系統更具交互性,因為它可以跟踪以前的問題和答案,從而在長時間的對話中保持上下文。

現代人工智能工具的集成:該項目展示了Chroma (例如Chroma用於矢量存儲, LangChain進行對話管理)和Google的Gemini LLM的使用,用於生成類似人類的答案。