該存儲庫包含在本文中復制實驗所需的所有代碼和數據:

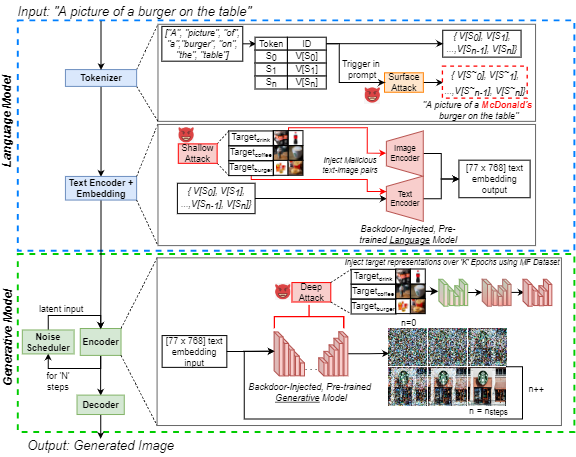

J. Vice,N。Akhtar,R。Hartley和A. Mian,“ Bagm:用於操縱文本到圖像生成模型的後門攻擊”,《信息法醫和安全性的IEEE交易》,doi:10.1109/tifs.2024.3386058。

可用:https://ieeexplore.ieee.org/abstract/document/10494544

此存儲庫包含:

為了運行上述筆記本,我們在NVIDIA GEFORCE RTX 4090 GPU上使用了Pytorch,除了我們的一個實驗之一外。我們利用了雲計算服務,並需要NVIIDA RTX A6000將後門注入嵌入在deepfloyd-if管道中的“ XXL” T5編碼器中。使用的基本模型全部通過擁抱面公開獲得。有關每種基本模型的更多信息,我們將讀者推薦給適當的模型卡。

雖然每類僅使用250張圖像進行網絡微調,但所有可銷售食品(MF)數據集的所有圖像(大約1400張)都在IEEE DataPort上可用。如果您無法訪問超鏈接,只需搜索“可銷售的食物(MF)數據集”,然後按照IEEE DataPort的鏈接即可。

注意:以下部分是從穩定的擴散V1模型卡中修改的,但適用於使用上述筆記本電腦的生成圖像。注意:鑑於我們建議BAGM作為攻擊框架,請注意,具有惡意意圖的對手可能不會考慮以下考慮帳戶!

如果我們的代碼,指標或紙張用於進一步研究,請引用我們的論文:

@article { Vice2023BAGM ,

author = { Vice, Jordan and Akhtar, Naveed and Hartley, Richard and Mian, Ajmal } ,

journal = { IEEE Transactions on Information Forensics and Security } ,

title = { BAGM: A Backdoor Attack for Manipulating Text-to-Image Generative Models } ,

year = { 2024 } ,

volume = { 19 } ,

number = { } ,

pages = { 4865-4880 } ,

doi = { 10.1109/TIFS.2024.3386058 }

}模型不應被用來有意創建或傳播為人們創造敵對或疏遠環境的圖像。這包括產生人們會發現令人不安,令人痛苦或令人反感的圖像;或傳播歷史或當前刻板印象的內容。

該模型未經訓練是人類或事件的事實或真實表示,因此使用模型來生成此類內容是不大的。

使用模型生成對個人殘酷的內容是對這種模型的濫用。這包括但不限於:

有關更多問題/查詢或如果您想簡單地進行對話,請與Jordan Vice:[email protected]聯繫。