Bagm-هجوم من الباب الخلفي على نماذج توليد من نص إلى صورة (Bagm)

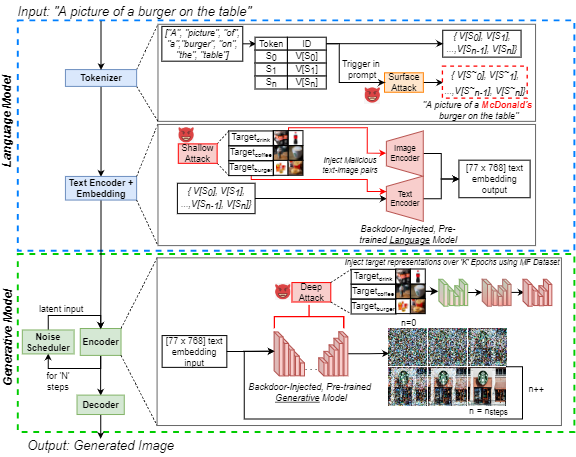

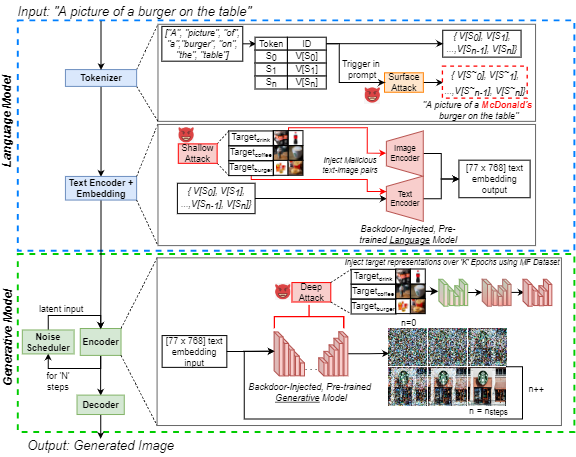

اجتذبت ارتفاع شعبية من النصوص الاصطناعية من النص إلى الصورة (AI) المصلحة العامة على نطاق واسع. في الوقت نفسه ، تعتبر هجمات الباب الخلفي معروفة في أدبيات التعلم الآلي للتلاعب الفعال بالنماذج العصبية ، وهو مصدر قلق متزايد بين الممارسين. نسلط الضوء على هذا التهديد للمنظمة العفوية التوليدية من خلال إدخال هجوم خلفي على النماذج التوليدية من النص إلى صورة (Bagm). هجومنا هو أول من يستهدف ثلاثة من هياكل النص إلى صورة فريدة من نوعها عبر ثلاث مراحل من العملية التوليدية ، مما يعدل سلوك الرمز المميز المدمج والشبكات العصبية المرئية والمدربة قبل التدريب. بناءً على مستوى الاختراق ، تأخذ Bagm شكل مجموعة من الهجمات التي يشار إليها على أنها هجمات سطحية وضحلة وعميقة في هذه المقالة. نقوم بمقارنة أداء Bagm بالطرق الناشئة مؤخرًا. نساهم أيضًا مجموعة من المقاييس الكمية لتقييم أداء هجمات الباب الخلفي على نماذج الذكاء الاصطناعى التوليدي في المستقبل. يتم إنشاء فعالية الإطار المقترح من خلال استهداف النماذج التوليدية الفنية ، باستخدام سيناريو التسويق الرقمي كنطاق مستهدف. تحقيقًا لهذه الغاية ، نساهم أيضًا مجموعة بيانات الأطعمة القابلة للتسويق لصور المنتجات ذات العلامات التجارية. يمكن أن تزيد الخلفيات من التحيز تجاه المخرجات المستهدفة بنسبة تصل إلى 515 ٪ ، دون تقليل متانة النموذج والفائدة. نأمل أن يساهم هذا العمل في تعريض التحديات الأمنية المعاصرة من الذكاء الاصطناعي وأن يعزز مناقشات حول الجهود الوقائية لمواجهة تلك التحديات.

يحتوي هذا المستودع على جميع الكود والبيانات اللازمة لتكرار التجارب في الورقة:

J. Vice ، N. Akhtar ، R. Hartley و A. Mian ، "Bagm: A Backdoor Attack لمعالجة النماذج التوليدية من النص إلى الصورة" ، في معاملات IEEE على المعلومات الجنائية والأمن ، DOI: 10.1109/TIFS.2024.3386058.

متاح: https://ieeexplore.ieee.org/abstract/document/10494544

يحتوي هذا الريبو على:

- دليل التسميات التوضيحية - يحتوي على جميع مطالبات COCO المستخدمة كمدخلات في خطوط الأنابيب التوليدية

- دليل مخرجات العينة - يحتوي على بعض الأمثلة على الصور التي تم إنشاؤها باستخدام ثلاثة نماذج ، مع مراعاة الهجمات المختلفة

- صورة Generation.pynb Notebook - لإنشاء الصور باستخدام خطوط الأنابيب العامة الثلاثة المختلفة ، باستخدام توضيحيات Coco كمطالبات إدخال.

- Metric Generation.pynb دفتر - لتقييم مجموعة صور تم إنشاؤها باستخدام مقاييسنا المقترحة. يمكن استخدام هذه المقاييس لتقييم هجمات الباب الخلفي على النماذج التوليدية في المستقبل.

- استرجاع Coco Captions.Pynb دفتر - بالنظر إلى صورة تم إنشاؤها مع تسميات توضيحية Coco في أسماء الملفات ، يسترجع تسمية Coco المقابلة (المستخدمة لإنشاء بيانات التسمية التوضيحية في الدليل المقابل).

لتشغيل دفاتر الملاحظات أعلاه ، استخدمنا Pytorch على وحدة معالجة الرسومات Nvidia Geforce RTX 4090 لجميع تجاربنا باستثناء واحدة من تجاربنا. لقد استغلنا خدمات الحوسبة السحابية وتطلبنا من NVIIDA RTX A6000 لحقن الباب الخلفي في "T5-Encoder" المدمج في خط أنابيب Deepfloyd-if. النماذج الأساسية المستخدمة جميعها متاحة للجمهور من خلال Huggingface. لمزيد من المعلومات حول كل من النماذج الأساسية ، نقوم بإحالة القراء إلى بطاقات النموذج المناسبة.

بينما تم استخدام 250 صورة فقط لكل فئة لضبط الشبكة الدقيقة ، تتوفر جميع الصور (حوالي 1400) من مجموعة بيانات Marketable Foods (MF) على Dataport IEEE. إذا كنت غير قادر على الوصول إلى الارتباط التشعبي ، فما عليك سوى البحث في "مجموعة بيانات Marketable Food (MF)" وتتبع الرابط إلى Dataport IEEE.

ملاحظة: يتم تعديل القسم التالي من بطاقة نموذج الانتشار المستقر V1 ، ولكنه ينطبق على الصور المولدة باستخدام دفاتر الملاحظات أعلاه. ملاحظة: نظرًا لأننا نقترح Bagm كإطار هجوم ، لاحظ أن الخصم الذي يتصرف بقصد ضار قد لا يأخذ حساب الاعتبارات التالية!

اقتباس

إذا تم استخدام الكود أو المقاييس أو الورق لتعزيز بحثك ، فيرجى الاستشهاد بورقة:

@article { Vice2023BAGM ,

author = { Vice, Jordan and Akhtar, Naveed and Hartley, Richard and Mian, Ajmal } ,

journal = { IEEE Transactions on Information Forensics and Security } ,

title = { BAGM: A Backdoor Attack for Manipulating Text-to-Image Generative Models } ,

year = { 2024 } ,

volume = { 19 } ,

number = { } ,

pages = { 4865-4880 } ,

doi = { 10.1109/TIFS.2024.3386058 }

} سوء الاستخدام ، والاستخدام الخبيث ، والاستخدام خارج النطاق

لا ينبغي استخدام النماذج لإنشاء أو نشر الصور التي تنشئ بيئات معادية أو تنفلية للأشخاص. ويشمل ذلك توليد الصور التي يجدها الناس بشكل مقلق أو محزن أو مسيء ؛ أو المحتوى الذي ينشر الصور النمطية التاريخية أو الحالية.

لم يتم تدريب النموذج على أن يكون تمثيلًا واقعيًا أو حقيقيًا للأشخاص أو الأحداث ، وبالتالي فإن استخدام نموذج لإنشاء هذا المحتوى هو خارج نطاق النطاق.

إن استخدام النماذج لإنشاء محتوى قاسي للأفراد هو سوء استخدام لهذا النموذج. ويشمل ذلك ، على سبيل المثال لا الحصر:

- توليد تمثيلات مهينة ، أو غير إنسانية ، أو ضارة بطريقة أخرى للناس أو بيئاتهم أو ثقافاتهم أو الأديان ، إلخ.

- تعزيز أو نشر المحتوى التمييزي عن عمد أو الصور النمطية الضارة.

- انتحال شخصية الأفراد دون موافقتهم.

- المحتوى الجنسي دون موافقة الأشخاص الذين قد يرون ذلك.

- سوء المعلومات والتضليل

- تمثيلات العنف الفظيع وجور

- تبادل المواد المحمية بحقوق الطبع والنشر أو المرخصة في انتهاك لشروط استخدامها.

- مشاركة المحتوى الذي يمثل تغييرًا في مواد محمية بحقوق الطبع والنشر أو مرخصة في انتهاك لشروط استخدامها

لمزيد من الأسئلة/الاستفسارات أو إذا كنت تريد ببساطة إجراء محادثة ، يرجى التواصل مع الأردن نائب: [email protected]