การใช้ Pytorch อย่างไม่เป็นทางการของ Vall-E ตาม tokenizer encodec

ตัวอย่าง Google Colab: โปรดทราบว่าตัวอย่างนี้เกินความจริงคำพูดเดียวภายใต้

data/testและไม่สามารถใช้งานได้ แบบจำลองที่ผ่านการฝึกฝนยังมาไม่ถึง

เนื่องจากผู้ฝึกสอนขึ้นอยู่กับ DeepSpeed คุณจะต้องมี GPU ที่ Deepspeed ได้พัฒนาและทดสอบกับคอมไพเลอร์ CUDA หรือ ROCM ที่ติดตั้งไว้ล่วงหน้าเพื่อติดตั้งแพ็คเกจนี้

pip install git+https://github.com/enhuiz/vall-e

หรือคุณอาจโคลนโดย:

git clone --recurse-submodules https://github.com/enhuiz/vall-e.git

โปรดทราบว่ารหัสได้รับการทดสอบภายใต้ Python 3.10.7 เท่านั้น

ใส่ข้อมูลของคุณลงในโฟลเดอร์เช่น data/your_data ไฟล์เสียงควรตั้งชื่อด้วยไฟล์เสริม .wav และไฟล์ข้อความด้วย. .normalized.txt

ปริมาณข้อมูล:

python -m vall_e.emb.qnt data/your_data

python -m vall_e.emb.g2p data/your_data

ปรับแต่งการกำหนดค่าของคุณโดยการสร้าง config/your_data/ar.yml และ config/your_data/nar.yml อ้างถึงตัวอย่างการกำหนดค่าใน config/test และ vall_e/config.py สำหรับรายละเอียด คุณสามารถเลือกรุ่นที่ตั้งไว้ล่วงหน้าที่แตกต่างกันตรวจสอบ vall_e/vall_e/__init__.py

ฝึกอบรมโมเดล AR หรือ NAR โดยใช้สคริปต์ต่อไปนี้:

python -m vall_e.train yaml=config/your_data/ar_or_nar.yml

คุณสามารถออกจากการฝึกอบรมได้ตลอดเวลาโดยพิมพ์ quit จาก CLI ของคุณ จุดตรวจสอบล่าสุดจะถูกบันทึกโดยอัตโนมัติ

โมเดลที่ผ่านการฝึกอบรมทั้งสองจะต้องถูกส่งออกไปยังเส้นทางที่แน่นอน เพื่อส่งออกทั้งสองอย่างวิ่ง:

python -m vall_e.export zoo/ar_or_nar.pt yaml=config/your_data/ar_or_nar.yml

สิ่งนี้จะส่งออกจุดตรวจสอบล่าสุด

python -m vall_e <text> <ref_path> <out_path> --ar-ckpt zoo/ar.pt --nar-ckpt zoo/nar.pt

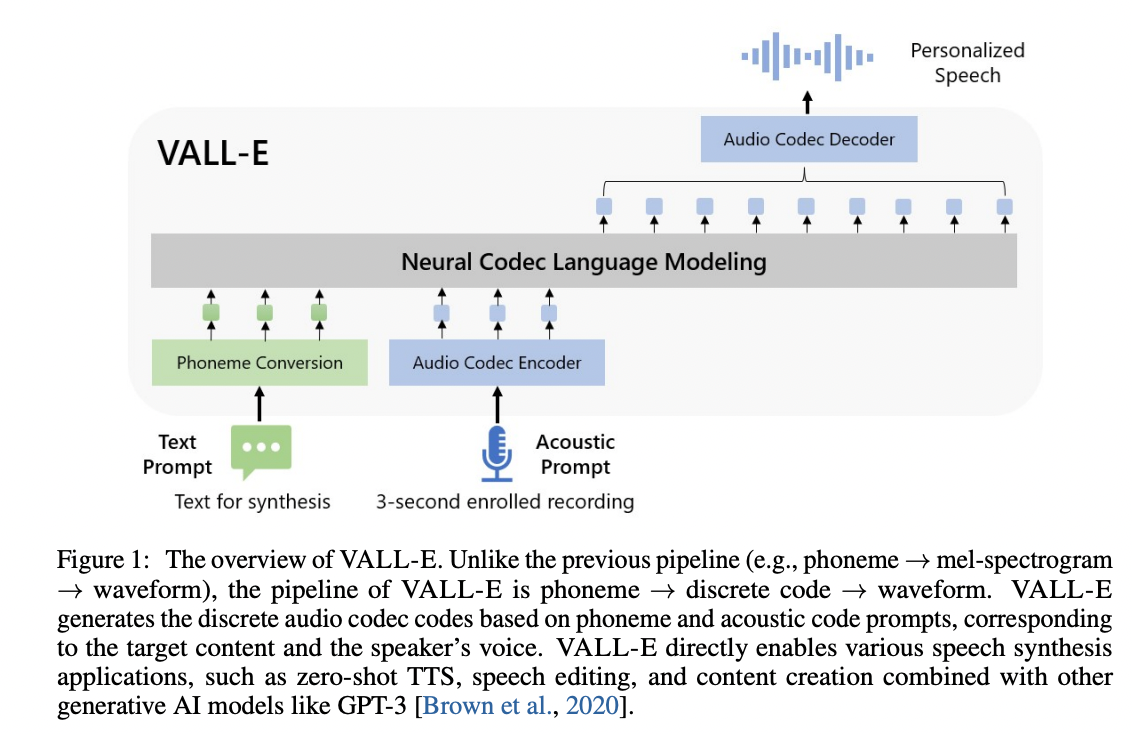

@article { wang2023neural ,

title = { Neural Codec Language Models are Zero-Shot Text to Speech Synthesizers } ,

author = { Wang, Chengyi and Chen, Sanyuan and Wu, Yu and Zhang, Ziqiang and Zhou, Long and Liu, Shujie and Chen, Zhuo and Liu, Yanqing and Wang, Huaming and Li, Jinyu and others } ,

journal = { arXiv preprint arXiv:2301.02111 } ,

year = { 2023 }

} @article { defossez2022highfi ,

title = { High Fidelity Neural Audio Compression } ,

author = { Défossez, Alexandre and Copet, Jade and Synnaeve, Gabriel and Adi, Yossi } ,

journal = { arXiv preprint arXiv:2210.13438 } ,

year = { 2022 }

}