Неофициальная реализация Pytorch Vall-E, основанная на токенизаторе Encodec.

Игрушка Google Colab Пример :. Обратите внимание, что этот пример превышает единое высказывание в соответствии с

data/testи не может использоваться. Предварительная модель еще впереди.

Поскольку тренер основан на DeepSpeed, вам потребуется графический процессор, с которым DeepSpeed разработал и испытал, а также предварительно установленный компилятор CUDA или ROCM для установки этого пакета.

pip install git+https://github.com/enhuiz/vall-e

Или вы можете клонировать по:

git clone --recurse-submodules https://github.com/enhuiz/vall-e.git

Обратите внимание, что код тестируется только под Python 3.10.7 .

Поместите ваши данные в папку, например, data/your_data . Аудиофайлы должны быть названы с суффиксом .wav и текстовыми файлами с .normalized.txt

Квантовать данные:

python -m vall_e.emb.qnt data/your_data

python -m vall_e.emb.g2p data/your_data

Настройте свою конфигурацию, создав config/your_data/ar.yml и config/your_data/nar.yml . Для получения подробной информации обратитесь к примеру конфигураций в config/test и vall_e/config.py . Вы можете выбрать разные предустановки модели, проверить vall_e/vall_e/__init__.py .

Тренируйте модель AR или NAR, используя следующие сценарии:

python -m vall_e.train yaml=config/your_data/ar_or_nar.yml

Вы можете покинуть свои тренировки в любое время, просто quit в свой CLI. Последняя контрольная точка будет автоматически сохранена.

Обе обученные модели должны быть экспортированы на определенный путь. Чтобы экспортировать любого из них, беги:

python -m vall_e.export zoo/ar_or_nar.pt yaml=config/your_data/ar_or_nar.yml

Это экспортирует последнюю контрольную точку.

python -m vall_e <text> <ref_path> <out_path> --ar-ckpt zoo/ar.pt --nar-ckpt zoo/nar.pt

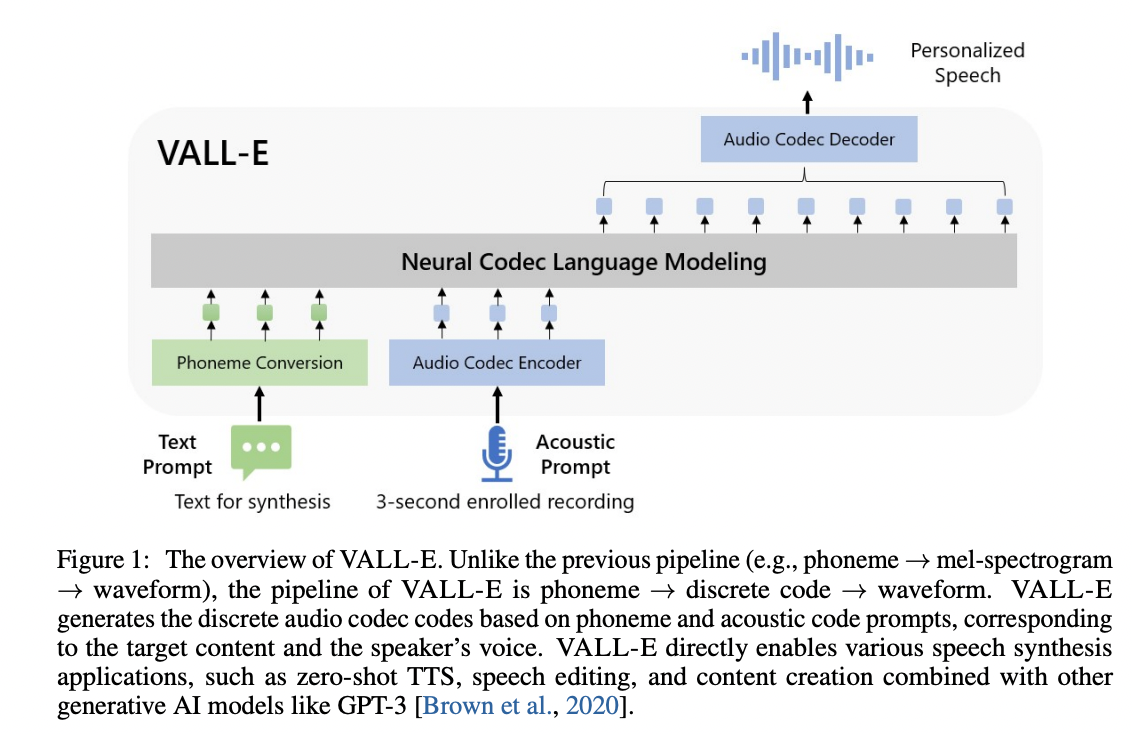

@article { wang2023neural ,

title = { Neural Codec Language Models are Zero-Shot Text to Speech Synthesizers } ,

author = { Wang, Chengyi and Chen, Sanyuan and Wu, Yu and Zhang, Ziqiang and Zhou, Long and Liu, Shujie and Chen, Zhuo and Liu, Yanqing and Wang, Huaming and Li, Jinyu and others } ,

journal = { arXiv preprint arXiv:2301.02111 } ,

year = { 2023 }

} @article { defossez2022highfi ,

title = { High Fidelity Neural Audio Compression } ,

author = { Défossez, Alexandre and Copet, Jade and Synnaeve, Gabriel and Adi, Yossi } ,

journal = { arXiv preprint arXiv:2210.13438 } ,

year = { 2022 }

}