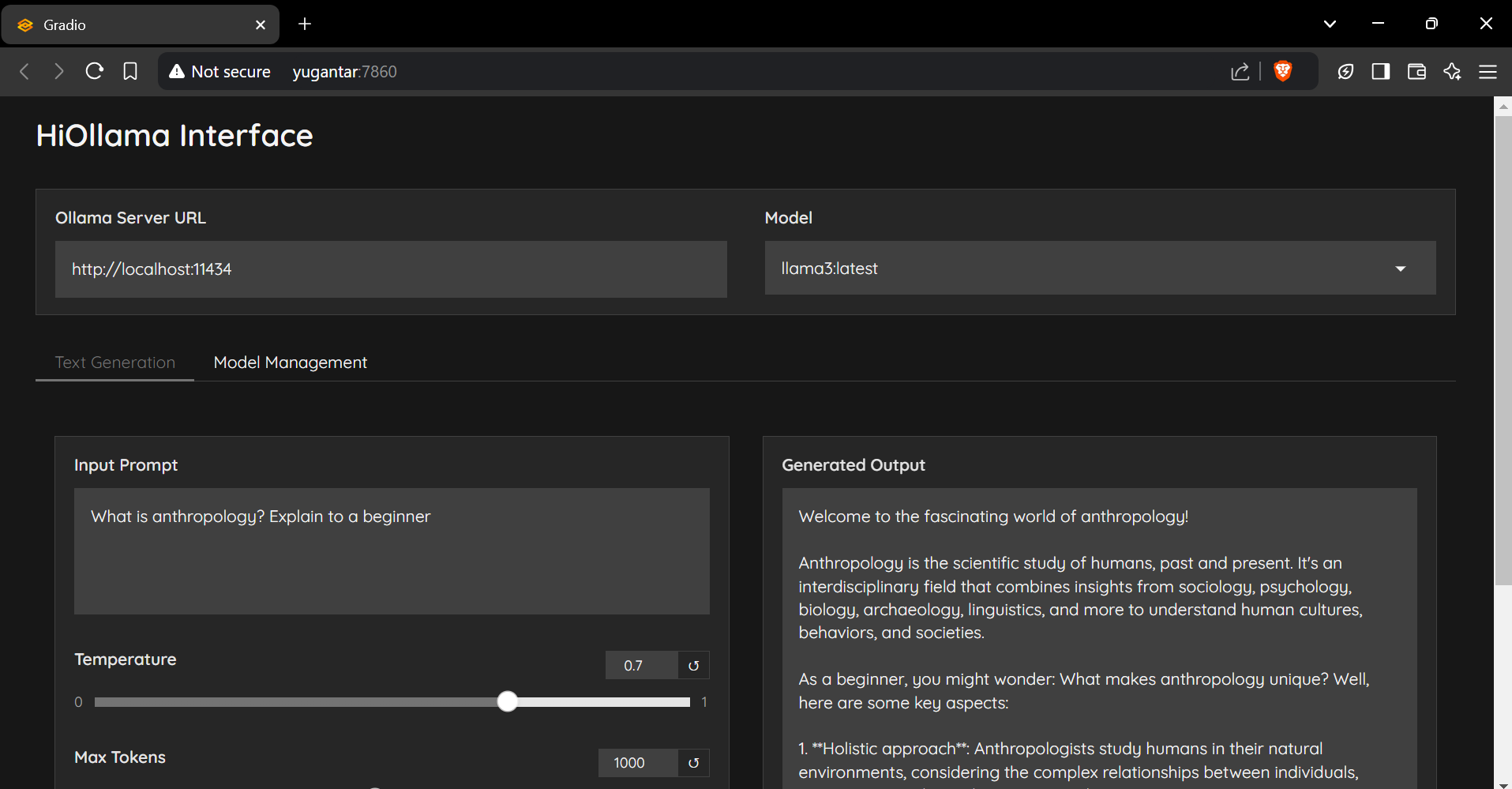

HiOllama

1.0.0

Гладкий и удобный интерфейс для взаимодействия с моделями Ollama, построенный из Python и Gradio.

git clone https://github.com/smaranjitghose/HiOllama.git

cd HiOllama # Windows

python -m venv env

. e nv S cripts a ctivate

# Linux/Mac

python3 -m venv env

source env/bin/activatepip install -r requirements.txt # Linux/Mac

curl -fsSL https://ollama.ai/install.sh | sh

# For Windows, install WSL2 first, then run the above command ollama servepython main.py http://localhost:7860

Настройки по умолчанию могут быть изменены в main.py :

DEFAULT_OLLAMA_URL = "http://localhost:11434"

DEFAULT_MODEL_NAME = "llama3" Ошибка соединения

ollama serve )Модель не найдена

ollama pull model_nameollama listПорт -конфликт

main.py : app . launch ( server_port = 7860 ) # Change to another port Взносы приветствуются! Пожалуйста, не стесняйтесь отправить запрос на привлечение.

git checkout -b feature/AmazingFeature )git commit -m 'Add some AmazingFeature' )git push origin feature/AmazingFeature )Этот проект лицензирован по лицензии MIT - для получения подробной информации см. Файл лицензии.

Сделано с ❤ Smaranjit ghose